Pytanie 1

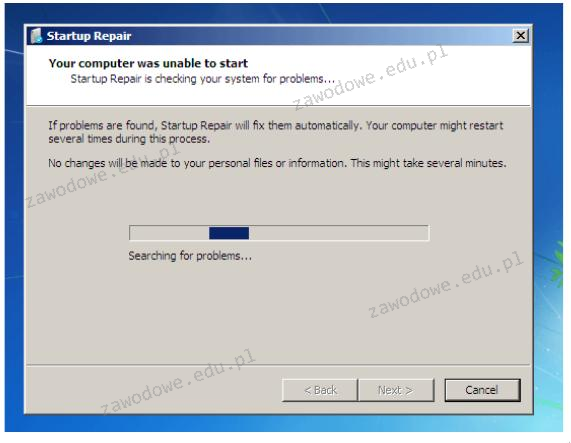

Komunikat, który pojawia się po uruchomieniu narzędzia do naprawy systemu Windows, może sugerować

Wynik: 21/40 punktów (52,5%)

Wymagane minimum: 20 punktów (50%)

Komunikat, który pojawia się po uruchomieniu narzędzia do naprawy systemu Windows, może sugerować

Po zainstalowaniu z domyślnymi uprawnieniami, system Windows XP nie obsługuje formatu systemu plików

Klient przyniósł do serwisu uszkodzony sprzęt komputerowy. W trakcie procedury odbioru sprzętu, przed rozpoczęciem jego naprawy, serwisant powinien

Wskaź, które z poniższych stwierdzeń dotyczących zapory sieciowej jest nieprawdziwe?

W czterech różnych sklepach ten sam model komputera oferowany jest w różnych cenach. Gdzie można go kupić najtaniej?

Matryce monitorów typu charakteryzują się najmniejszymi kątami widzenia

Jaką kwotę łącznie pochłonie robocizna związana z montażem 20 modułów RJ45 z krawędziowym złączem narzędziowym na przewodach 4-parowych, jeśli stawka godzinowa montera wynosi 15 zł/h, a według tabeli KNR czas montażu pojedynczego modułu to 0,10 r-g?

W systemie Windows powiązanie rozszerzeń plików z odpowiednimi programami realizuje się za pomocą polecenia

Użytkownicy dysków SSD powinni unikać wykonywania następujących działań konserwacyjnych

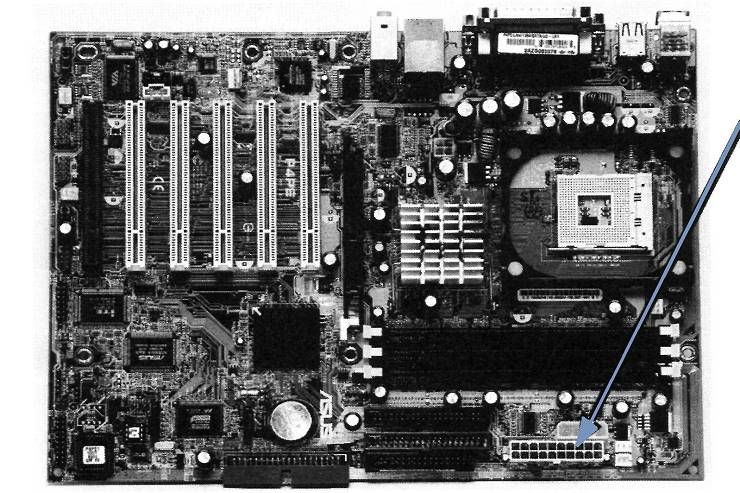

Na zdjęciu widać płytę główną komputera. Strzałka wskazuje na

Jednym z zaleceń w zakresie ochrony przed wirusami jest przeprowadzanie skanowania całego systemu. W związku z tym należy skanować komputer

Który układ mikroprocesora jest odpowiedzialny między innymi za pobieranie rozkazów z pamięci oraz generowanie sygnałów sterujących?

Urządzeniem wykorzystywanym do formowania kształtów oraz grawerowania m.in. w materiałach drewnianych, szklanych i metalowych jest ploter

Jakie narzędzie w systemie Linux pozwala na wyświetlenie danych o sprzęcie zapisanych w BIOS?

Jakie narzędzie jest używane do diagnozowania łączności między hostami w systemie Windows?

W tabeli zaprezentowano parametry trzech dysków twardych w standardzie Ultra320 SCSI. Te dyski są w stanie osiągnąć maksymalny transfer wewnętrzny

| Rotational Speed | 10,025 rpm | ||

| Capacity (Formatted) | 73.5GB | 147GB | 300GB |

| Number of Heads | 2 | 5 | 8 |

| Number of Disks | 1 | 3 | 4 |

| Internal Transfer Rate | Up to 132 MB/s | ||

| Interface Transfer Rate | NP/NC = 320MB/s, FC = 200MB/s | ||

| Buffer Size | |||

| Average Seek (Read/Write) | 4.5/5.0 ms | ||

| Track-to-Track Seek/Read/Write | 0.2ms/0.4ms | ||

| Maximum Seek (Read/Write) | 10/11 ms | ||

| Average Latency | 2.99 ms | ||

| Power Consumption (Idle) | NP/NC = 9.5W, FC = 10.5W | ||

| Acoustic Noise | 3.4 bels | ||

| Shock - Operating/Non-Operating | 65G/225G 2ms | ||

Jaką rolę pełni serwer plików w sieciach komputerowych LAN?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

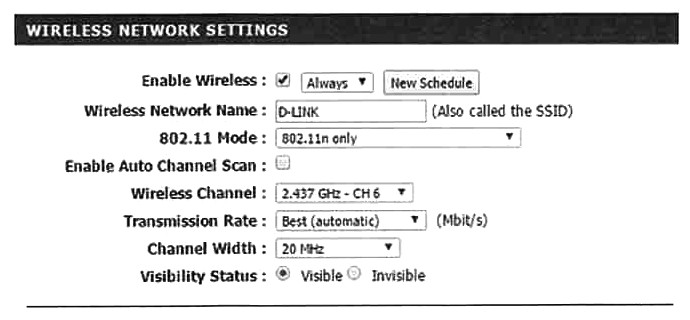

Który z parametrów w ustawieniach punktu dostępowego jest odpowiedzialny za login używany podczas próby połączenia z bezprzewodowym punktem dostępu?

Tryb działania portu równoległego, oparty na magistrali ISA, który umożliwia transfer danych do 2,4 MB/s, przeznaczony dla skanerów oraz urządzeń wielofunkcyjnych, to

W jaki sposób powinno się wpisać w formułę arkusza kalkulacyjnego odwołanie do komórki B3, aby przy przenoszeniu tej formuły w inne miejsce arkusza odwołanie do komórki B3 pozostało stałe?

Jakie urządzenia wyznaczają granice domeny rozgłoszeniowej?

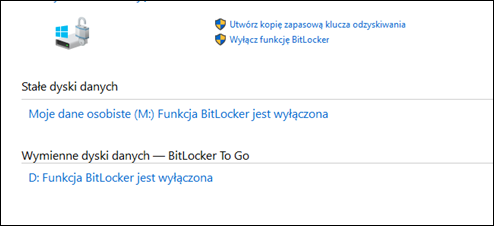

Przedstawione wbudowane narzędzie systemów Windows w wersji Enterprise lub Ultimate służy do

Atak typu hijacking na serwer internetowy charakteryzuje się

Jaką rolę pełni serwer FTP?

Aby przygotować ikony zaprezentowane na załączonym obrazku do wyświetlania na Pasku zadań w systemie Windows, należy skonfigurować

Aby zainstalować openSUSE oraz dostosować jego ustawienia, można skorzystać z narzędzia

Wskaż właściwą formę maski podsieci?

Możliwości zmiany uprawnień dostępu do plików w systemie Windows 10 można uzyskać za pomocą komendy

Graficzny symbol pokazany na ilustracji oznacza

Do utworzenia skompresowanego archiwum danych w systemie Linux można użyć polecenia

Kiedy wygasa autorskie prawo majątkowe dotyczące programu komputerowego, stworzonego przez kilku programistów, którzy jako jego autorzy podpisali aplikację swoimi imionami i nazwiskami?

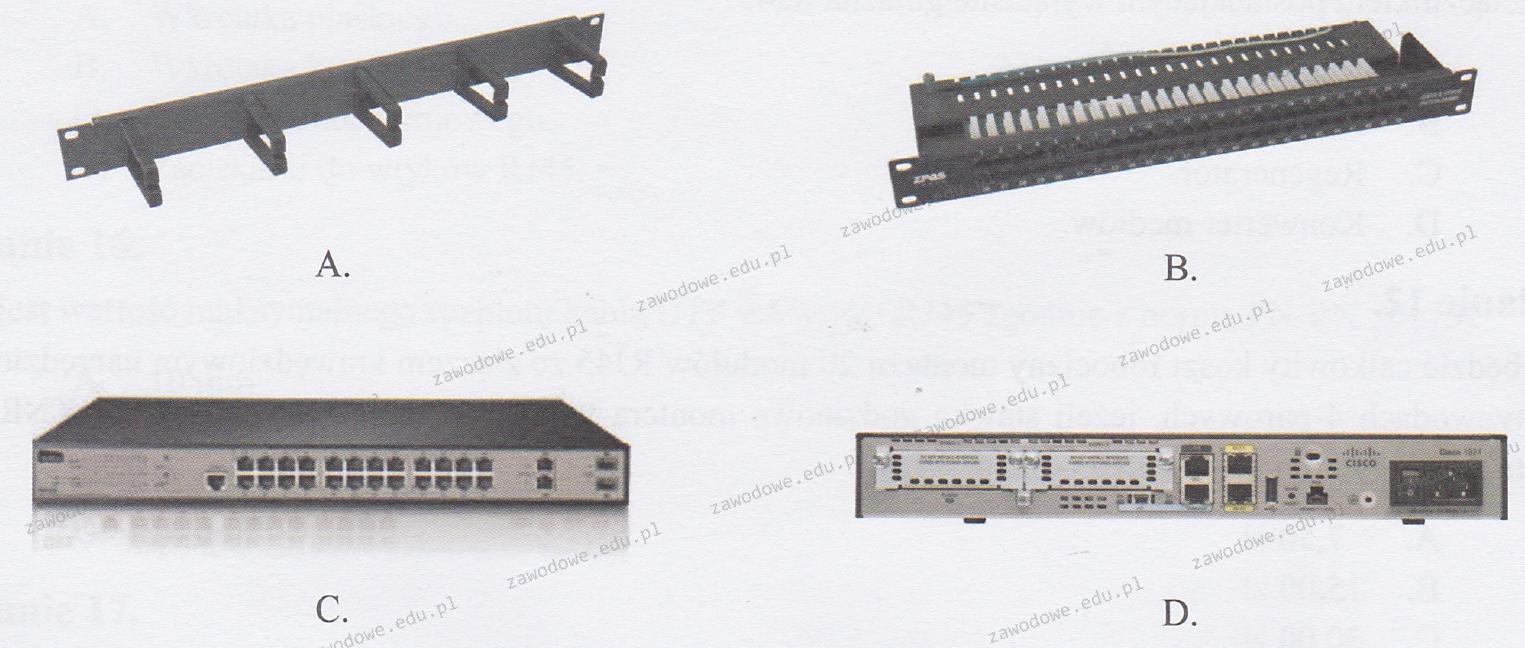

Na którym obrazku przedstawiono panel krosowniczy?

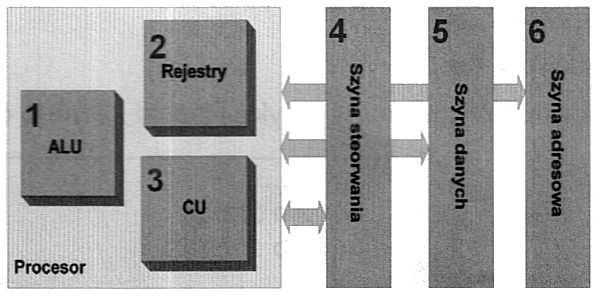

Na diagramie element odpowiedzialny za dekodowanie poleceń jest oznaczony liczbą

Jaki typ złącza powinien być zastosowany w przewodzie UTP Cat 5e, aby połączyć komputer z siecią?

W nagłówku ramki standardu IEEE 802.3 w warstwie łącza danych znajduje się

Który z poniższych protokołów jest używany do bezpiecznego przesyłania danych w sieci?

Za przydzielanie czasu procesora do konkretnych zadań odpowiada

Które z urządzeń sieciowych jest przedstawione na grafice?

Które stwierdzenie odnoszące się do ruterów jest prawdziwe?