Pytanie 1

Zastosowanie programu firewall ma na celu ochronę

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Zastosowanie programu firewall ma na celu ochronę

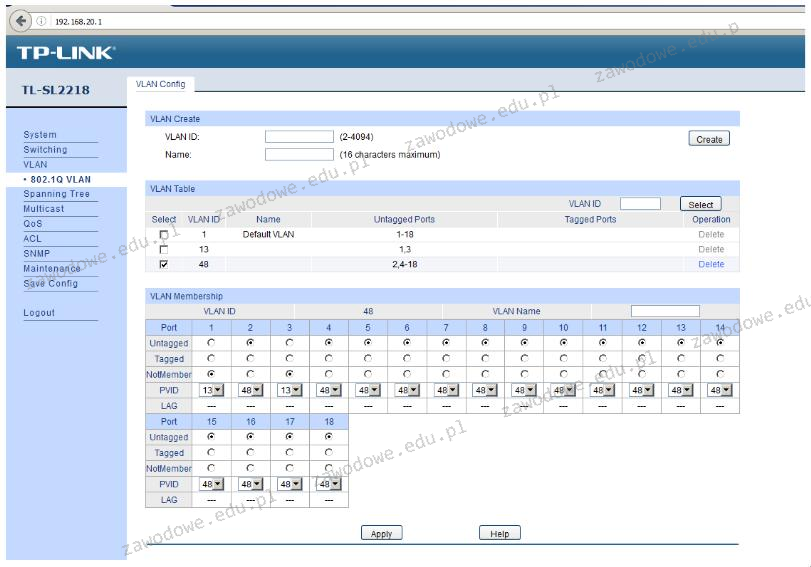

Na ilustracji zaprezentowano konfigurację urządzenia, co sugeruje, że

SuperPi to aplikacja używana do testowania

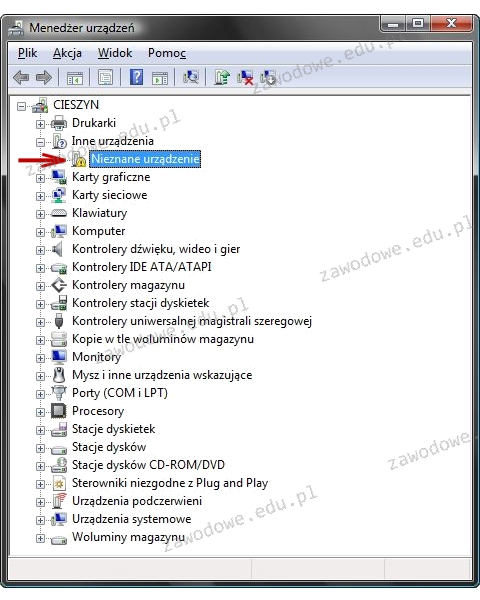

Ikona z wykrzyknikiem, pokazana na ilustracji, która pojawia się obok nazwy sprzętu w Menedżerze urządzeń, wskazuje, że to urządzenie

Po stwierdzeniu przypadkowego usunięcia ważnych danych na dysku twardym, aby odzyskać usunięte pliki, najlepiej

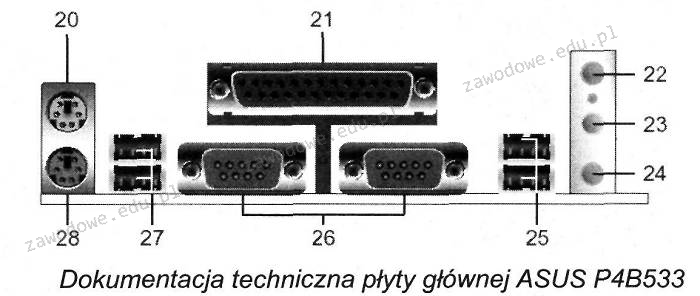

Na zaprezentowanej płycie głównej komputera złącza oznaczono cyframi 25 i 27

Jaki protokół posługuje się portami 20 oraz 21?

Aby zweryfikować schemat połączeń kabla UTP Cat 5e w sieci lokalnej, należy zastosować

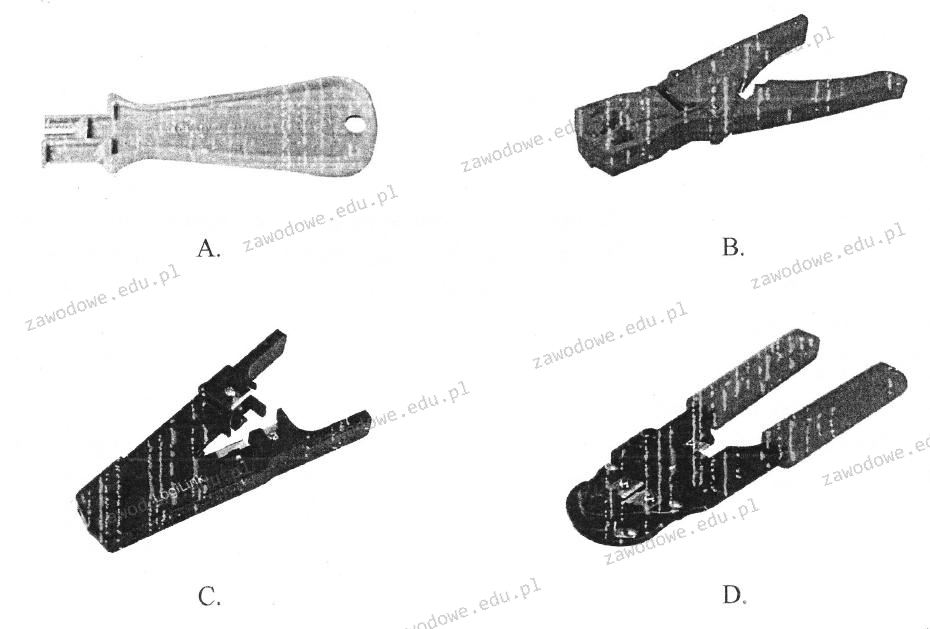

Jaki instrument jest używany do usuwania izolacji?

Jakiego parametru w poleceniu ping należy użyć, aby uzyskać rezultat pokazany na zrzucie ekranu?

Cena wydruku jednej strony tekstu wynosi 95 gr, a koszt wykonania jednej płyty CD to 1,54 zł. Jakie wydatki poniesie firma, tworząc płytę z prezentacjami oraz poradnik liczący 120 stron?

Druk z drukarki igłowej realizowany jest z wykorzystaniem zestawu stalowych igieł w liczbie

Na ilustracji pokazano interfejs w komputerze dedykowany do podłączenia

Jakim protokołem połączeniowym w warstwie transportowej, który zapewnia niezawodność dostarczania pakietów, jest protokół

Program Mozilla Firefox jest udostępniany na zasadach licencji

Który z parametrów okablowania strukturalnego wskazuje na relację mocy sygnału testowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu przewodu?

Aby sprawdzić, czy zainstalowana karta graficzna w komputerze jest przegrzewana, użytkownik ma możliwość użycia programu

Przedstawiona na diagramie strategia zapisu kopii zapasowych na nośnikach nosi nazwę

| Day | 1 | 2 | 3 | 4 | 5 | 6 | 7 | 8 | 9 | 10 | 11 | 12 | 13 | 14 | 15 | 16 |

|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|---|

| Media Set | A | A | A | A | A | A | A | A | ||||||||

| B | B | B | B | |||||||||||||

| C | C | C | ||||||||||||||

| E |

RAMDAC konwerter przekształca sygnał

Jaką liczbę komputerów można zaadresować w sieci z maską 255.255.255.224?

W przypadku planowania wykorzystania przestrzeni dyskowej komputera do przechowywania oraz udostępniania danych, takich jak pliki oraz aplikacje dostępne w internecie, a także ich zarządzania, komputer powinien być skonfigurowany jako

Podaj właściwe przyporządkowanie usługi z warstwy aplikacji oraz standardowego numeru portu, na którym ta usługa działa?

Router w sieci LAN posiada przypisany adres IP 192.168.50.1. Został skonfigurowany w taki sposób, że przydziela komputerom wszystkie dostępne adresy IP w sieci 192.168.50.0 z maską 255.255.255.0. Jaka jest maksymalna liczba komputerów, które mogą działać w tej sieci?

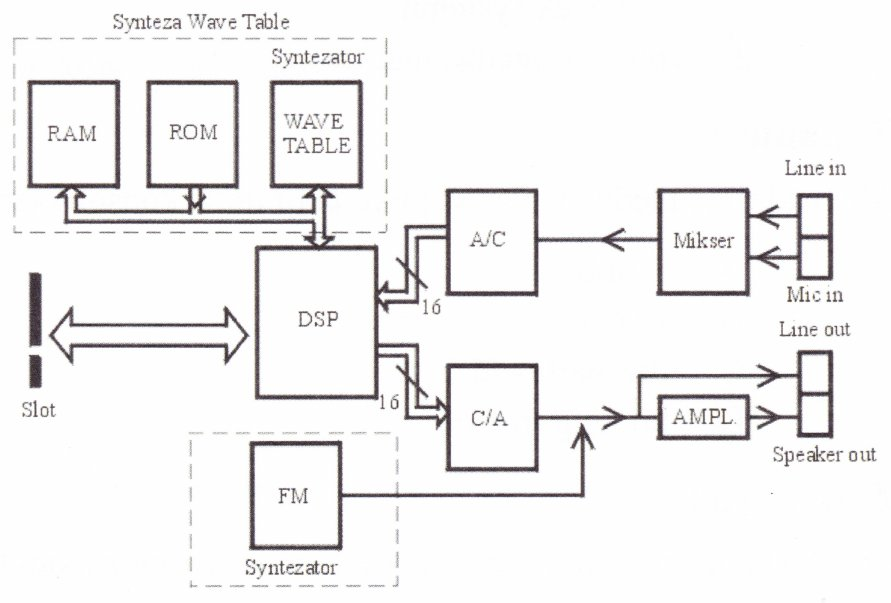

Karta dźwiękowa, która pozwala na odtwarzanie plików w formacie MP3, powinna być zaopatrzona w układ

Wszystkie ustawienia użytkowników komputera są przechowywane w gałęzi rejestru oznaczonej akronimem

W systemie Linux, aby uzyskać informację o nazwie aktualnego katalogu roboczego, należy użyć polecenia

W adresie IP z klasy A, wartość pierwszego bajtu mieści się w zakresie

Jakie będą wydatki na materiały potrzebne do produkcji 20 kabli typu patchcord o długości 50 cm?

| Nazwa towaru | Cena jedn. brutto |

|---|---|

| wtyk RJ45 | 1,00 zł / szt. |

| koszulka ochronna na wtyk RJ45 | 1,00 zł / szt. |

| skrętka UTP | 1,20 zł / m |

Scandisk to narzędzie, które wykorzystuje się do

Wskaż symbol umieszczany na urządzeniach elektrycznych przeznaczonych do sprzedaży i obrotu w Unii Europejskiej?

Na ilustracji przedstawiono diagram funkcjonowania

Serwer zajmuje się rozgłaszaniem drukarek w sieci, organizowaniem zadań do wydruku oraz przydzielaniem uprawnień do korzystania z drukarek

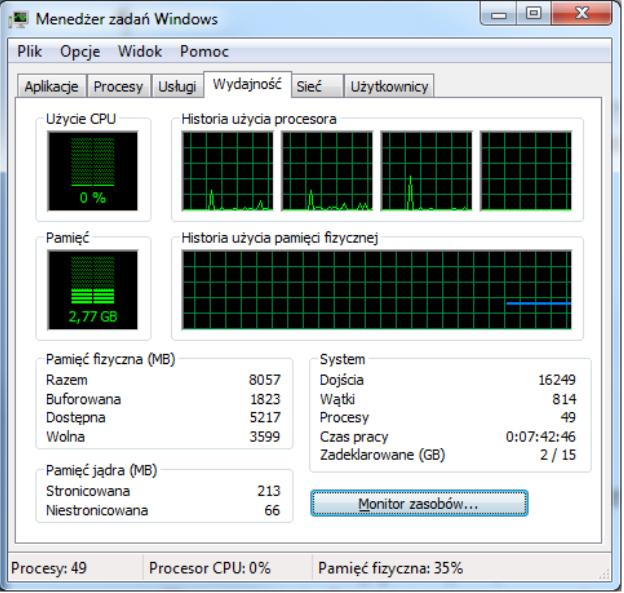

Aby uruchomić przedstawione narzędzie w systemie Windows, jakie polecenie należy zastosować?

W systemie operacyjnym Fedora foldery domowe użytkowników znajdują się w folderze

Proces, który uniemożliwia całkowicie odzyskanie danych z dysku twardego, to

Pojemność pamięci 100 GiB odpowiada zapisowi

Które z wymienionych mediów nie jest odpowiednie do przesyłania danych teleinformatycznych?

Do stworzenia projektu sieci komputerowej dla obiektu szkolnego najlepiej użyć edytora grafiki wektorowej, którym jest oprogramowanie

Standardowo, w systemie Linux, twardy dysk w standardzie SATA jest oznaczany jako

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z