Pytanie 1

Funkcja Intel Turbo Boost w mikroprocesorze umożliwia

Wynik: 14/40 punktów (35,0%)

Wymagane minimum: 20 punktów (50%)

Funkcja Intel Turbo Boost w mikroprocesorze umożliwia

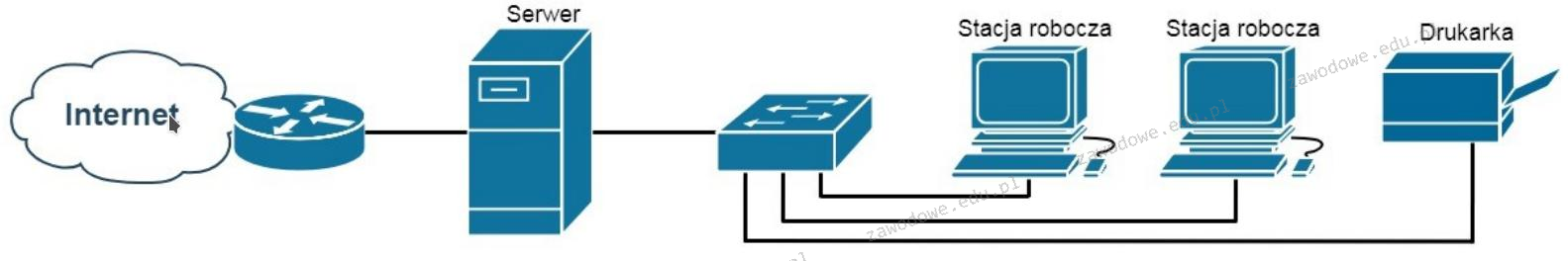

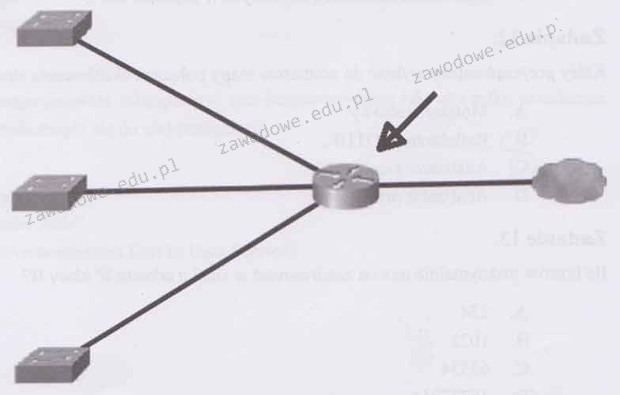

Która z usług na serwerze Windows umożliwi użytkownikom końcowym sieci zaprezentowanej na ilustracji dostęp do Internetu?

Układ cyfrowy wykonujący operację logiczną koniunkcji opiera się na bramce logicznej

Jakie rozwiązanie należy wdrożyć i prawidłowo ustawić, aby chronić lokalną sieć komputerową przed atakami typu Smurf pochodzącymi z Internetu?

Aby użytkownicy lokalnej sieci mogli korzystać z przeglądarek do odwiedzania stron WWW za pomocą protokołów HTTP i HTTPS, brama internetowa musi umożliwiać ruch na portach

Jaki pasywny komponent sieciowy powinno się wykorzystać do podłączenia przewodów z wszystkich gniazd abonenckich do panelu krosowniczego umieszczonego w szafie rack?

Które z poniższych wskazówek jest NIEWłaściwe w kontekście konserwacji skanera płaskiego?

Jak nazywa się topologia fizyczna, w której wszystkie urządzenia końcowe są bezpośrednio połączone z jednym punktem centralnym, takim jak koncentrator lub przełącznik?

Stacja robocza powinna znajdować się w tej samej podsieci co serwer o adresie IP 192.168.10.150 i masce 255.255.255.192. Który adres IP powinien być skonfigurowany w ustawieniach protokołu TCP/IP karty sieciowej stacji roboczej?

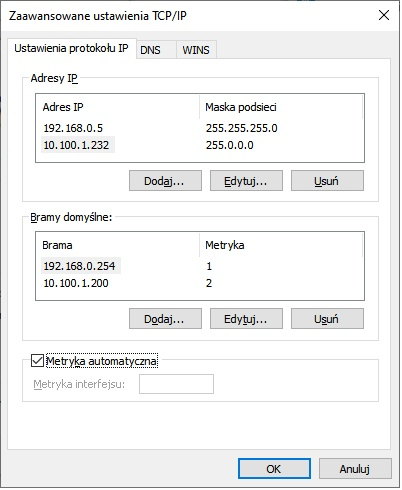

Zamiana taśmy barwiącej jest związana z eksploatacją drukarki

Jaki element sieci SIP określamy jako telefon IP?

Jak nazywa się zestaw usług internetowych dla systemów operacyjnych z rodziny Microsoft Windows, który umożliwia działanie jako serwer FTP oraz serwer WWW?

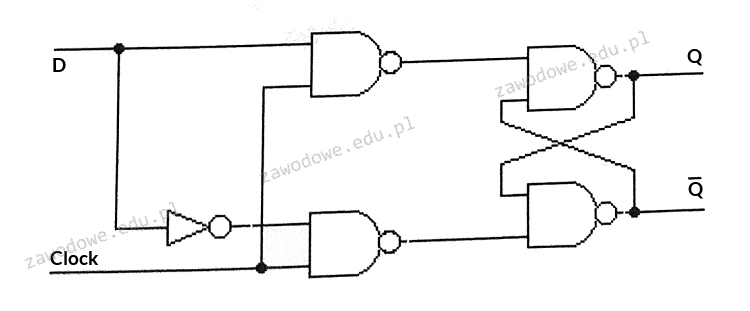

Na podstawie przedstawionej na ilustracji konfiguracji, w przypadku, gdy komputer żąda połączenia z inną siecią, w pierwszej kolejności dane zostaną wysłane do urządzenia o adresie

Minimalną wartość długości hasła użytkownika w systemie Windows można ustawić poprzez komendę

Aby skonfigurować i dostosować środowisko graficzne GNOME w różnych dystrybucjach Linux, należy użyć programu

System S.M.A.R.T jest stworzony do kontrolowania działania i identyfikacji usterek

Która z poniższych wskazówek nie jest właściwa w kontekście konserwacji skanera płaskiego?

Wskaż ilustrację przedstawiającą materiał eksploatacyjny charakterystyczny dla drukarek żelowych?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Na płycie głównej doszło do awarii zintegrowanej karty sieciowej. Komputer nie ma dysku twardego ani innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w sieci firmowej komputery nie mają napędów, a wszystko "czyta" się z serwera. Aby przywrócić utraconą funkcjonalność, należy zainstalować

Komputer jest połączony z siecią Internetową i nie posiada zainstalowanego oprogramowania antywirusowego. Jak można sprawdzić, czy ten komputer jest zainfekowany wirusem, nie wchodząc w ustawienia systemowe?

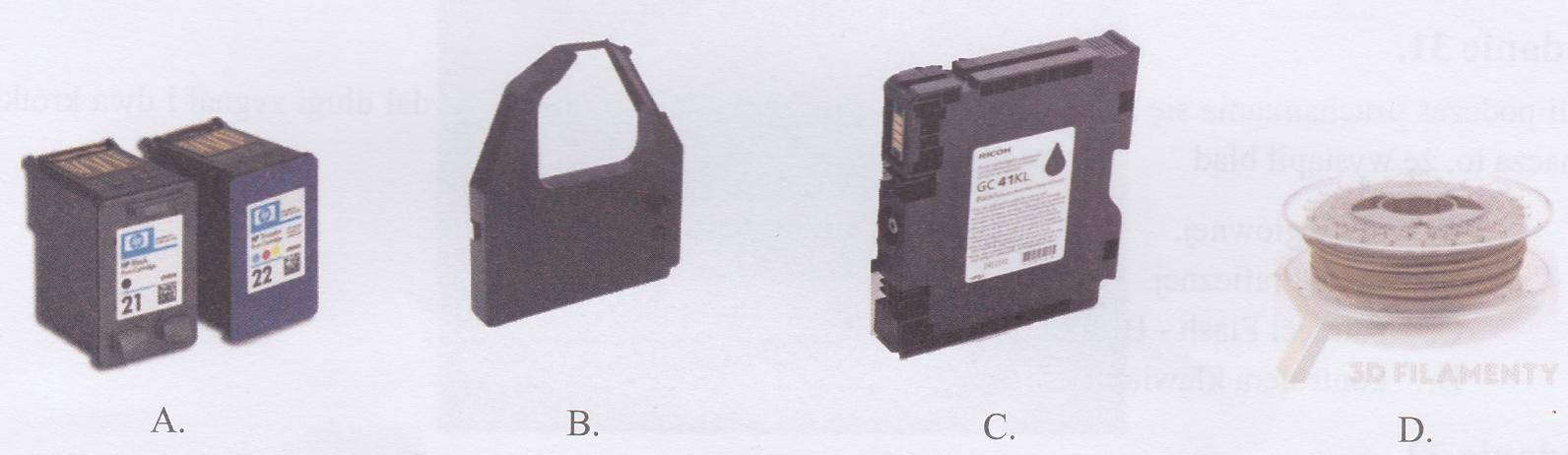

Jak wygląda schemat połączeń bramek logicznych?

Jakie narzędzie w systemie Linux pozwala na wyświetlenie danych o sprzęcie zapisanych w BIOS?

Ustawa z dnia 14 grudnia 2012 roku dotycząca odpadów zobowiązuje

Do wykonania kopii danych na dysk USB w systemie Linux stosuje się polecenie

Jakie parametry mierzy watomierz?

Którego urządzenia dotyczy strzałka na rysunku?

Informacja tekstowa KB/Interface error, widoczna na wyświetlaczu komputera podczas BIOS POST od firmy AMI, wskazuje na problem

Jakie oznaczenie na schematach sieci LAN przypisuje się punktom rozdzielczym dystrybucyjnym znajdującym się na różnych kondygnacjach budynku według normy PN-EN 50173?

Jakiego typu tablicę partycji trzeba wybrać, aby stworzyć partycję o pojemności 3TB na dysku twardym?

Czym wyróżniają się procesory CISC?

Kabel sieciowy z końcówkami RJ45 był testowany za pomocą diodowego urządzenia do sprawdzania okablowania. Na tym urządzeniu diody LED włączały się po kolei, z wyjątkiem diod oznaczonych numerami 2 i 3, które świeciły jednocześnie na jednostce głównej testera, natomiast nie świeciły na jednostce zdalnej. Jaka była tego przyczyna?

W systemie Windows po wykonaniu polecenia systeminfo nie otrzyma się informacji o

Karta rozszerzeń przedstawiona na zdjęciu dysponuje systemem chłodzenia

Komunikat biosu POST od firmy Award o treści "Display switch is set incorrectly" sugeruje

Aby zapewnić użytkownikom Active Directory możliwość logowania oraz dostęp do zasobów tej usługi w sytuacji awarii kontrolera domeny, co należy zrobić?

Jaki rodzaj routingu jest najbardziej odpowiedni w dużych, szybko zmieniających się sieciach?

Element płyty głównej odpowiedzialny za wymianę danych między mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej jest na rysunku oznaczony numerem

Jaki protokół sygnalizacyjny jest wykorzystywany w technologii VoIP?

Jakie narzędzie służy do delikatnego wyginania blachy obudowy komputera oraz przykręcania śruby montażowej w miejscach trudno dostępnych?