Pytanie 1

Jakie urządzenie jest używane do łączenia lokalnej sieci bezprzewodowej z siecią kablową?

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie jest używane do łączenia lokalnej sieci bezprzewodowej z siecią kablową?

Przedstawiona czynność jest związana z eksploatacją drukarki

Wskaż właściwą formę maski podsieci?

Aby stworzyć kontroler domeny w środowisku systemów Windows Server na lokalnym serwerze, konieczne jest zainstalowanie roli

Aby móc zakładać konta użytkowników, komputerów oraz innych obiektów i przechowywać o nich informacje w centralnym miejscu, konieczne jest zainstalowanie na serwerze Windows roli

Do bezprzewodowej transmisji danych pomiędzy dwiema jednostkami, z wykorzystaniem fal radiowych w zakresie ISM 2,4 GHz, przeznaczony jest interfejs

Zgodnie z zamieszczonym cennikiem, średni koszt wyposażenia stanowiska komputerowego wynosi:

| Nazwa sprzętu | Cena minimalna | Cena maksymalna |

|---|---|---|

| Jednostka centralna | 1300,00 zł | 4550,00 zł |

| Monitor | 650,00 zł | 2000,00 zł |

| Klawiatura | 28,00 zł | 100,00 zł |

| Myszka | 22,00 zł | 50,00 zł |

Aby podnieść wydajność komputera w grach, karta graficzna Sapphire Radeon R9 FURY OC, 4GB HBM (4096 Bit), HDMI, DVI, 3xDP została wzbogacona o technologię

Jakie jest maksymalne dozwolone promień gięcia przy układaniu kabla U/UTP kat.5E?

Jak należy rozmieszczać gniazda komputerowe RJ45 w odniesieniu do przestrzeni biurowej zgodnie z normą PN-EN 50174?

Który z wymienionych komponentów jest częścią mechanizmu drukarki igłowej?

Jaką maksymalną długość może mieć kabel miedziany UTP kategorii 5e łączący bezpośrednio dwa urządzenia w sieci, według standardu Fast Ethernet 100Base-TX?

W systemie SI jednostką do mierzenia napięcia jest

Ile pinów znajduje się w wtyczce SATA?

Jakie medium transmisyjne powinno być użyte do połączenia dwóch punktów dystrybucyjnych oddalonych o 600m?

Jaką maksymalną liczbę hostów można przypisać w sieci o adresie IP klasy B?

Jakie właściwości topologii fizycznej sieci zostały przedstawione w poniższej ramce?

W systemie Linux do wyświetlania treści pliku tekstowego służy polecenie

Drukarka fotograficzna ma bardzo brudną obudowę oraz wyświetlacz. Aby usunąć zabrudzenia bez ich uszkodzenia, należy użyć

Wykonanie polecenia net use Z:192.168.20.2data /delete spowoduje?

Jakie informacje można uzyskać dzięki programowi Wireshark?

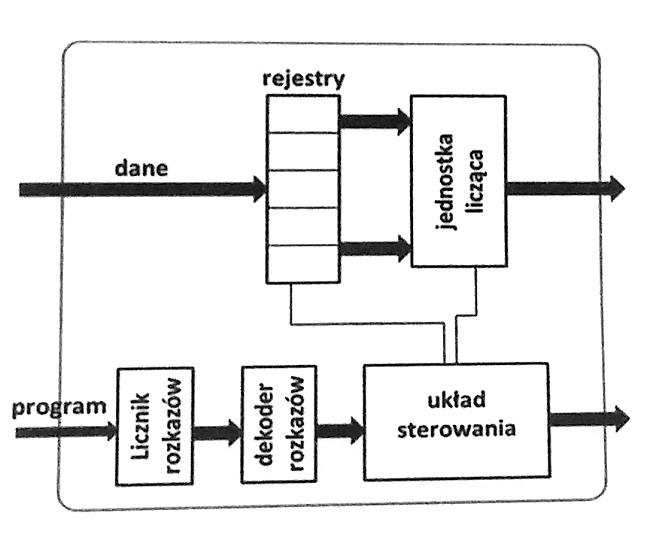

Rejestry przedstawione na diagramie procesora mają zadanie

Po wykonaniu eksportu klucza HKCU zostanie zapisana kopia rejestru zawierająca informacje, dotyczące konfiguracji

Wirus komputerowy to aplikacja, która

Komputer stracił łączność z siecią. Jakie działanie powinno być podjęte w pierwszej kolejności, aby naprawić problem?

Główna rola serwera FTP polega na

Jakim protokołem komunikacyjnym, który gwarantuje niezawodne przesyłanie danych, jest protokół

Które z poniższych wskazówek jest NIEWłaściwe w kontekście konserwacji skanera płaskiego?

Podstawowy rekord uruchamiający na dysku twardym to

Jakie oprogramowanie pełni rolę serwera DNS w systemie Linux?

Określ prawidłową sekwencję działań, które należy wykonać, aby nowy laptop był gotowy do użycia?

Komputer jest połączony z siecią Internetową i nie posiada zainstalowanego oprogramowania antywirusowego. Jak można sprawdzić, czy ten komputer jest zainfekowany wirusem, nie wchodząc w ustawienia systemowe?

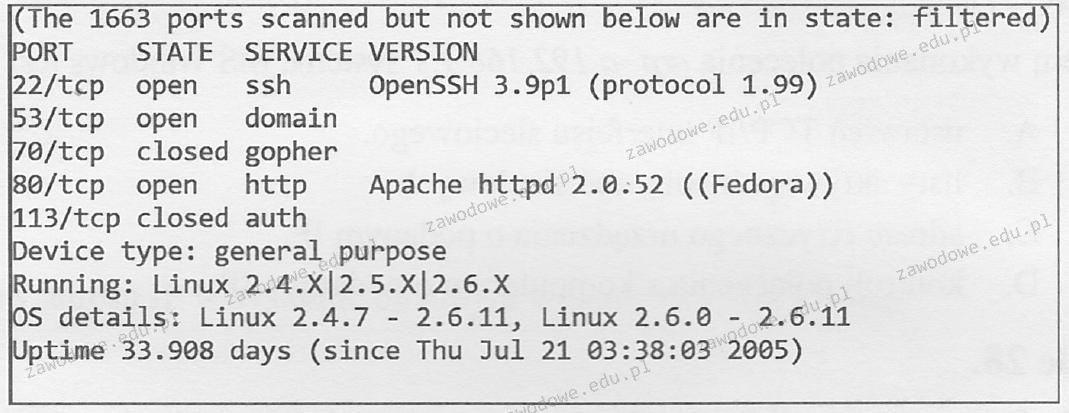

Jaki program został wykorzystany w systemie Linux do szybkiego skanowania sieci?

Cookie to plik

Jakie elementy wchodzą w skład dokumentacji powykonawczej?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaką cechę posiada przełącznik w sieci?

Aby ocenić stabilność systemu Windows Server, należy użyć narzędzia

Aby zabezpieczyć system przed oprogramowaniem mającym możliwość reprodukcji, konieczne jest zainstalowanie

Protokół Transport Layer Security (TLS) jest rozszerzeniem którego z poniższych protokołów?