Pytanie 1

Która z macierzy RAID opiera się na replikacji dwóch lub więcej dysków twardych?

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Która z macierzy RAID opiera się na replikacji dwóch lub więcej dysków twardych?

Urządzenie sieciowe działające w trzeciej warstwie modelu ISO/OSI, obsługujące adresy IP, to

Program typu recovery, w warunkach domowych, pozwala na odzyskanie danych z dysku twardego w przypadku

Algorytm wykorzystywany do weryfikacji, czy ramka Ethernet jest wolna od błędów, to

Aby Jan mógł zmienić właściciela drukarki w systemie Windows, musi mu zostać przypisane prawo do w opcjach zabezpieczeń

Jakie polecenie w systemie Windows należy wpisać w miejsce kropek, aby uzyskać dane przedstawione na załączonym obrazku?

C:\Windows\system32> ................... Nazwa użytkownika Gość Pełna nazwa Komentarz Wbudowane konto do dostępu do komputera/domeny Komentarz użytkownika Kod kraju 000 (Domyślne ustawienia systemu) Konto jest aktywne Nie Wygasanie konta Nigdy Hasło ostatnio ustawiano 2019-11-23 10:55:12 Ważność hasła wygasa Nigdy Hasło może być zmieniane 2019-12-02 10:55:12 Wymagane jest hasło Nie Użytkownik może zmieniać hasło Nie Dozwolone stacje robocze Wszystkie Skrypt logowania Profil użytkownika Katalog macierzysty Ostatnie logowanie Nigdy Dozwolone godziny logowania Wszystkie Członkostwa grup lokalnych *Goście Członkostwa grup globalnych *None Polecenie zostało wykonane pomyślnie. C:\Windows\system32>

Umowa, na mocy której użytkownik ma między innymi wgląd do kodu źródłowego oprogramowania w celu jego analizy oraz udoskonalania, to licencja

Jakie jest oprogramowanie serwerowe dla systemu Linux, które pozwala na współdziałanie z grupami roboczymi oraz domenami Windows?

Tryb działania portu równoległego, oparty na magistrali ISA, który umożliwia transfer danych do 2,4 MB/s, przeznaczony dla skanerów oraz urządzeń wielofunkcyjnych, to

Narzędzie służące do przechwytywania oraz ewentualnej analizy ruchu w sieci to

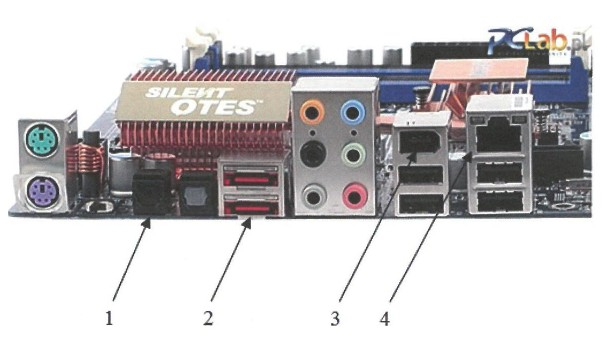

Który z portów na zaprezentowanej płycie głównej umożliwia podłączenie zewnętrznego dysku przez interfejs e-SATA?

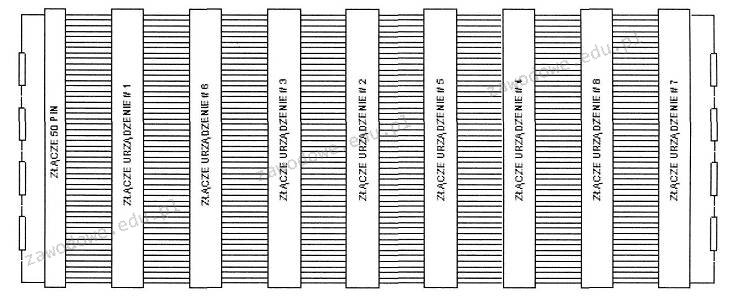

Jakie złącze umożliwia przesył danych między przedstawioną na ilustracji płytą główną a urządzeniem zewnętrznym, nie dostarczając jednocześnie zasilania do tego urządzenia przez interfejs?

Który z wymienionych adresów należy do klasy C?

Polecenie uname -s w systemie Linux jest wykorzystywane do sprawdzenia

Osoba pragnąca wydrukować dokumenty w oryginale oraz w trzech egzemplarzach na papierze samokopiującym powinna zainwestować w drukarkę

Wyświetlony stan ekranu terminala został uzyskany podczas testu realizowanego w środowisku Windows. Techniczny pracownik zdobył w ten sposób informacje o:

Na płycie głównej uszkodzona została zintegrowana karta sieciowa. Komputer nie ma zainstalowanego dysku twardego ani żadnych innych napędów, takich jak stacja dysków czy CD-ROM. Klient informuje, że w firmowej sieci komputery nie mają napędów, a wszystko "czyta" się z serwera. W celu przywrócenia utraconej funkcji należy zainstalować

Wskaż symbol umieszczany na urządzeniach elektrycznych przeznaczonych do sprzedaży i obrotu w Unii Europejskiej?

Aby monitorować stan dysków twardych w serwerach, komputerach osobistych i laptopach, można użyć programu

W sytuacji, gdy brakuje odpowiedniej ilości pamięci RAM do przeprowadzenia operacji, takiej jak uruchomienie aplikacji, system Windows pozwala na przeniesienie nieużywanych danych z pamięci RAM do pliku

Jaki skrót oznacza rodzaj licencji Microsoft dedykowanej dla szkół, uczelni, instytucji rządowych oraz dużych firm?

Jakie urządzenie umożliwia połączenie sieci lokalnej z siecią rozległą?

Router przypisany do interfejsu LAN dysponuje adresem IP 192.168.50.1. Został on skonfigurowany w taki sposób, aby przydzielać komputerom wszystkie dostępne adresy IP w sieci 192.168.50.0 z maską 255.255.255.0. Jaką maksymalną liczbę komputerów można podłączyć w tej sieci?

Serwisant zrealizował w ramach zlecenia działania przedstawione w poniższej tabeli. Całkowity koszt zlecenia obejmuje wartość usług wymienionych w tabeli oraz koszt pracy serwisanta, którego stawka za godzinę wynosi 60,00 zł netto. Oblicz całkowity koszt zlecenia brutto. Stawka VAT na usługi wynosi 23%.

| LP | Czynność | Czas wykonania w minutach | Cena usługi netto w zł |

|---|---|---|---|

| 1. | Instalacja i konfiguracja programu | 35 | 20,00 |

| 2. | Wymiana płyty głównej | 80 | 50,00 |

| 3. | Wymiana karty graficznej | 30 | 25,00 |

| 4. | Tworzenie kopii zapasowej i archiwizacja danych | 65 | 45,00 |

| 5. | Konfiguracja rutera | 30 | 20,00 |

Jaki sprzęt powinno się wybrać do pomiarów schematu okablowania strukturalnego sieci lokalnej?

Sprzęt, na którym można skonfigurować sieć VLAN, to

Jaką ochronę zapewnia program antyspyware?

Aby zweryfikować schemat połączeń kabla UTP Cat 5e w sieci lokalnej, należy zastosować

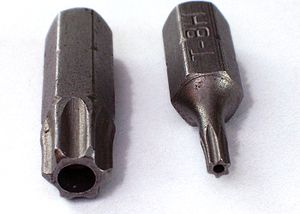

Na ilustracji przedstawiono końcówkę wkrętaka typu

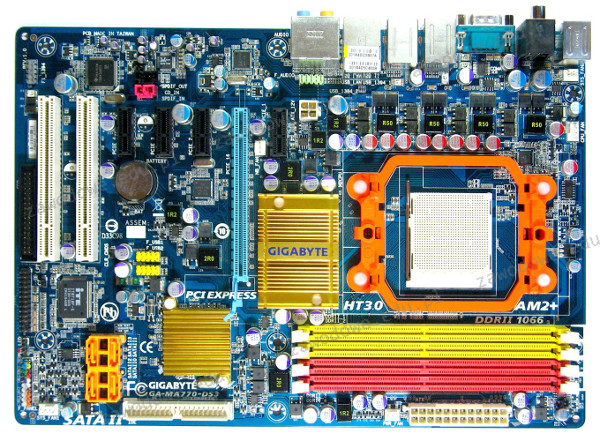

Aby zmontować komputer z poszczególnych elementów, korzystając z obudowy SFF, trzeba wybrać płytę główną w formacie

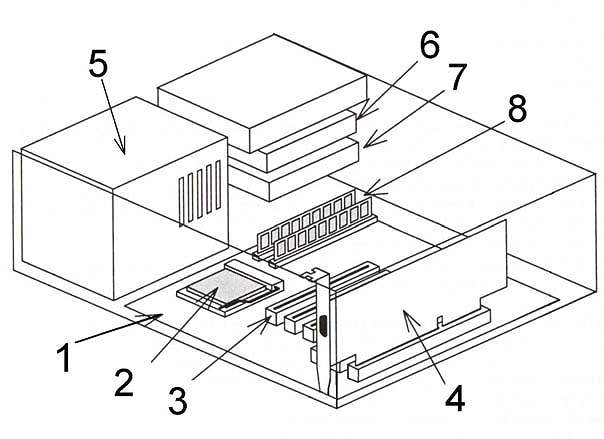

Na ilustracji karta rozszerzeń jest oznaczona numerem

Za pomocą taśmy 60-pinowej pokazanej na ilustracji łączy się z płytą główną komputera

Planując prace modernizacyjne komputera przenośnego, związane z wymianą procesora, należy w pierwszej kolejności

Interfejs, którego magistrala kończy się elementem przedstawionym na ilustracji, jest typowy dla

W załączonej ramce przedstawiono opis technologii

| Technologia ta to rewolucyjna i nowatorska platforma, która pozwala na inteligentne skalowanie wydajności podsystemu graficznego poprzez łączenie mocy kilku kart graficznych NVIDIA pracujących na płycie głównej. Dzięki wykorzystaniu zastrzeżonych algorytmów oraz wbudowanej w każdy z procesorów graficznych NVIDIA dedykowanej logiki sterującej, która odpowiada za skalowanie wydajności, technologia ta zapewnia do 2 razy (w przypadku dwóch kart) lub 2,8 razy (w przypadku trzech kart) wyższą wydajność niż w przypadku korzystania z pojedynczej karty graficznej. |

Administrator sieci LAN dostrzegł przełączenie w tryb awaryjny urządzenia UPS. To oznacza, że wystąpiła awaria systemu

Drukarką przeznaczoną do druku etykiet i kodów kreskowych, która drukuje poprzez roztapianie pokrycia specjalnej taśmy, w wyniku czego barwnik z niej zostaje przyklejony do materiału, na którym następuje drukowanie jest drukarka

Jaki system operacyjny funkcjonuje w trybie tekstowym i umożliwia uruchomienie środowiska graficznego KDE?

Komputer prawdopodobnie jest zainfekowany wirusem typu boot. Jakie działanie umożliwi usunięcie wirusa w najbardziej nieinwazyjny sposób dla systemu operacyjnego?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z