Pytanie 1

Kiedy dysze w drukarce atramentowej wyschną z powodu długotrwałych przerw w użytkowaniu, co powinno się najpierw wykonać?

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Kiedy dysze w drukarce atramentowej wyschną z powodu długotrwałych przerw w użytkowaniu, co powinno się najpierw wykonać?

Parametr pamięci RAM określany czasem jako opóźnienie definiuje się jako

Jakiego rodzaju złącze powinna mieć płyta główna, aby użytkownik był w stanie zainstalować kartę graficzną przedstawioną na rysunku?

W systemie Linux narzędzie do śledzenia zużycia CPU, pamięci, procesów oraz obciążenia systemu z poziomu terminala to

Gdy system operacyjny laptopa działa normalnie, na ekranie wyświetla się komunikat o konieczności sformatowania wewnętrznego dysku twardego. Może to sugerować

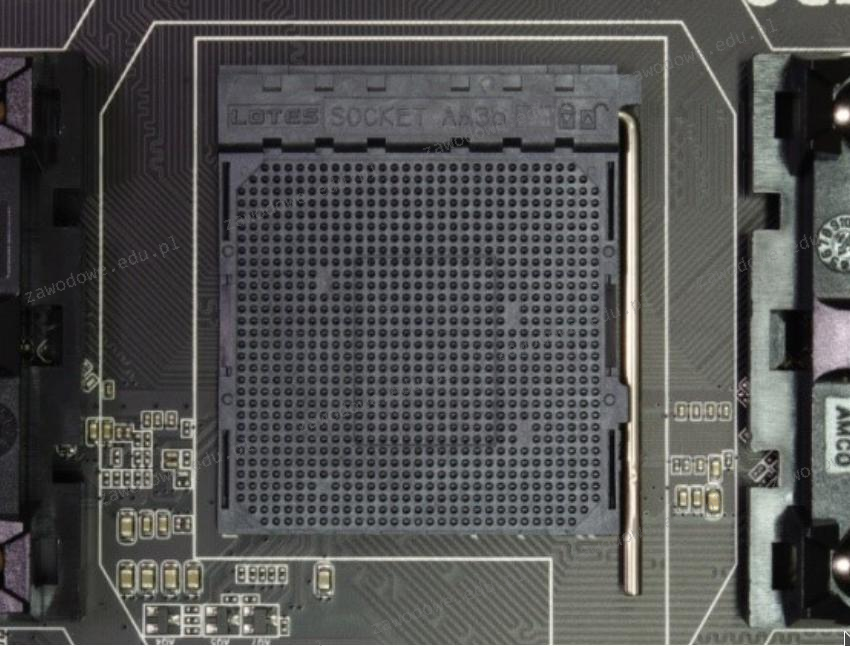

Na płycie głównej z gniazdem pokazanym na fotografii możliwe jest zainstalowanie procesora

Aby sprawdzić, czy zainstalowana karta graficzna w komputerze jest przegrzewana, użytkownik ma możliwość użycia programu

Błąd typu STOP w systemie Windows (Blue Screen), który występuje w momencie, gdy system odwołuje się do niepoprawnych danych w pamięci RAM, to

Zastosowanie symulacji stanów logicznych w obwodach cyfrowych pozwala na

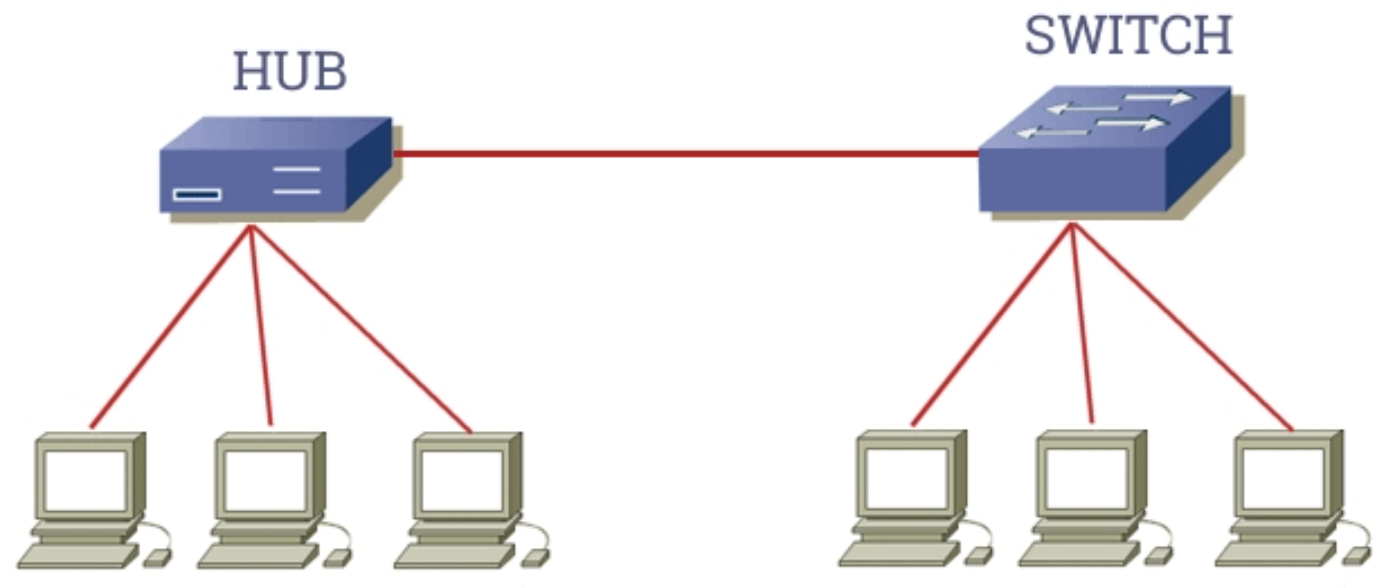

Ile domen kolizyjnych występuje w sieci pokazanej na rysunku?

Ile podsieci tworzą komputery z adresami: 192.168.5.12/25, 192.168.5.50/25, 192.168.5.200/25, 192.158.5.250/25?

Za pomocą narzędzia diagnostycznego Tracert można ustalić trasę do punktu docelowego. Przez ile routerów przeszedł pakiet wysłany dl hosta 172.16.0.99?

C:\>tracert 172.16.0.99 Trasa śledzenia do 172.16.0.99 z maksymalną liczbą przeskoków 30 | ||||

| 1 | 2 ms | 3 ms | 2 ms | 10.0.0.1 |

| 2 | 12 ms | 8 ms | 8 ms | 192.168.0.1 |

| 3 | 10 ms | 15 ms | 10 ms | 172.17.0.2 |

| 4 | 11 ms | 11 ms | 20 ms | 172.17.48.14 |

| 5 | 21 ms | 16 ms | 24 ms | 172.16.0.99 |

Śledzenie zakończone. | ||||

Elementem, który umożliwia wymianę informacji pomiędzy procesorem a magistralą PCI-E, jest

W komputerze o parametrach przedstawionych w tabeli konieczna jest wymiana karty graficznej na kartę GeForce GTX 1070 Ti Titanium 8G DDR5, PCI EX-x16 3.0, 256b, 1683 MHz/1607 MHz, Power consumption 180W, 3x DP, 2x HDMI, recommended power supply 500W, DirectX 12, OpenGL 4.5. W związku z tym należy również zaktualizować

| Podzespół | Parametry | Pobór mocy [W] |

|---|---|---|

| Procesor Intel i5 | Cores: 6, Threads: 6, 2.8 GHz, Tryb Turbo: 4.0 GHz, s-1151 | 30 |

| Moduł pamięci DDR3 | Taktowanie: 1600 MHz, 8 GB (1x8 GB), CL 9 | 6 |

| Monitor LCD | Powłoka: matowa, LED, VGA x1, HDMI x1, DP x1 | 40 |

| Mysz i klawiatura | przewodowa, interfejs: USB | 2 |

| Płyta główna | 2x PCI Ex-x16 3.0, D-Sub x1, USB 2.0 x2, RJ-45 x1, USB 3.1 gen 1 x4, DP x1, PS/2 x1, DDR3, s-1151, 4xDDR4 (Max: 64 GB) | 35 |

| Karta graficzna | 3x DP, 1x DVI-D, 1x HDMI, 2 GB GDDR3 | 150 |

| Dysk twardy 7200 obr/min | 1 TB, SATA III (6 Gb/s), 64 MB | 16 |

| Zasilacz | Moc: 300W | --- |

Protokołem kontrolnym w obrębie rodziny TCP/IP, który ma na celu między innymi identyfikowanie usterek w urządzeniach sieciowych, jest

Program iftop działający w systemie Linux ma na celu

Wskaź zestaw wykorzystywany do diagnozowania logicznych systemów elektronicznych na płycie głównej komputera, który nie reaguje na próbę uruchomienia zasilania?

Wskaż podzespół niekompatybilny z płytą główną o przedstawionych w tabeli parametrach.

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8x USB 2.0, S-AM3+ |

W tabeli przedstawiono numery podzespołów, które są ze sobą kompatybilne

| Lp. | Podzespół | Parametry |

|---|---|---|

| 1. | Procesor | INTEL COREi3-4350- 3.60 GHz, x2/4, 4 MB, 54W, HD 4600, BOX, s-1150 |

| 2. | Procesor | AMD Ryzen 7 1800X, 3.60 GHz, 95W, s-AM4 |

| 3. | Płyta główna | GIGABYTE ATX, X99, 4x DDR3, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8 x USB 2.0, S-AM3+ |

| 4. | Płyta główna | Asus CROSSHAIR VI HERO, X370, SATA3, 4xDDR4, USB3.1, ATX, WI-FI AC, s- AM4 |

| 5. | Pamięć RAM | Corsair Vengeance LPX, DDR4 2x16GB, 3000MHz, CL15 black |

| 6. | Pamięć RAM | Crucial Ballistix DDR3, 2x8GB, 1600MHz, CL9, black |

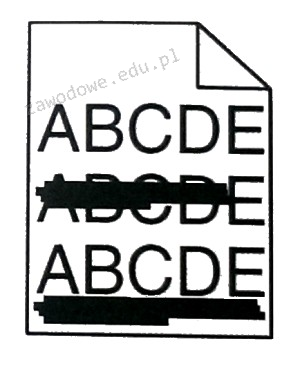

Źródłem problemu z wydrukiem z przedstawionej na rysunku drukarki laserowej jest

Jakie oprogramowanie nie jest przeznaczone do diagnozowania komponentów komputera?

Uszkodzenie mechaniczne dysku twardego w komputerze stacjonarnym może być spowodowane

Jaką konfigurację sieciową może mieć komputer, który należy do tej samej sieci LAN, co komputer z adresem 10.8.1.10/24?

Po włączeniu komputera wyświetlił się komunikat: Non-system disk or disk error. Replace and strike any key when ready. Co może być tego przyczyną?

Zjawisko przesłuchu w sieciach komputerowych polega na

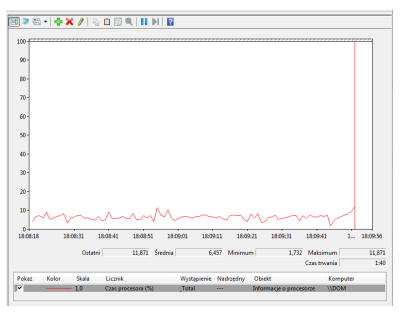

Aby zainicjować w systemie Windows oprogramowanie do monitorowania wydajności komputera przedstawione na ilustracji, należy otworzyć

Jaki jest adres rozgłoszeniowy (broadcast) dla hosta z adresem IP 192.168.35.202 oraz 26-bitową maską?

Podłączona mysz bezprzewodowa sprawia, że kursor na ekranie nie porusza się płynnie i „skacze”. Co może być przyczyną tego problemu?

Jakie urządzenie jest używane do pomiaru napięcia w zasilaczu?

Celem złocenia styków złącz HDMI jest

Komunikat "BIOS checksum error" pojawiający się podczas uruchamiania komputera zazwyczaj wskazuje na

Aby wymienić uszkodzony moduł pamięci RAM, najpierw trzeba

Watomierz jest stosowany do pomiaru

Element płyty głównej odpowiedzialny za wymianę danych między mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej jest na rysunku oznaczony numerem

Do podłączenia projektora multimedialnego do komputera, nie można użyć złącza

Komputer ma podłączoną mysz bezprzewodową, a kursor podczas pracy nie porusza się płynnie, „skacze” po ekranie. Przyczyną usterki urządzenia może być

Narzędziem do monitorowania wydajności i niezawodności w systemach Windows 7, Windows Server 2008 R2 oraz Windows Vista jest

Które wbudowane narzędzie systemu Windows pozwala rozwiązywać problemy z błędnymi sektorami i integralnością plików?

Który zestaw przyrządów pomiarowych jest wystarczający do wykonania w obwodzie prądu stałego pomiaru mocy metodą techniczną?

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?