Pytanie 1

Które polecenie w systemie Linux służy do zakończenia procesu?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Które polecenie w systemie Linux służy do zakończenia procesu?

Podczas normalnego działania systemu operacyjnego w laptopie pojawił się komunikat o konieczności formatowania wewnętrznego dysku twardego. Wskazuje on na

Jakie będą całkowite wydatki na materiały potrzebne do wyprodukowania 20 kabli połączeniowych typu patchcord o długości 1,5 m każdy, jeżeli koszt jednego metra kabla wynosi 1 zł, a wtyk to 50 gr?

Aby zrealizować aktualizację zainstalowanego systemu operacyjnego Linux Ubuntu, należy wykonać polecenie

Z jaką informacją wiąże się parametr TTL po wykonaniu polecenia ping?

W którym trybie działania procesora Intel x86 uruchamiane były aplikacje 16-bitowe?

Jaką funkcję pełni serwer ISA w systemie Windows?

Topologia fizyczna sieci, w której wykorzystywane są fale radiowe jako medium transmisyjne, nosi nazwę topologii

Użytkownik zamierza zmodernizować swój komputer zwiększając ilość pamięci RAM. Zainstalowana płyta główna ma parametry przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Jak wygląda liczba 51210) w systemie binarnym?

Wskaż standard protokołu wykorzystywanego do kablowego połączenia dwóch urządzeń

Jak nazywa się protokół warstwy transportowej modelu TCP/IP, który nie gwarantuje dostarczenia danych?

Jaki sterownik drukarki jest uniwersalny dla różnych urządzeń oraz systemów operacyjnych i stanowi standard w branży poligraficznej?

Jakie medium transmisyjne stosują myszki bluetooth do łączności z komputerem?

Który protokół służy do wymiany danych o trasach oraz dostępności sieci pomiędzy routerami w ramach tego samego systemu autonomicznego?

Zwiększenie zarówno wydajności operacji (zapis/odczyt), jak i bezpieczeństwa przechowywania danych jest możliwe dzięki zastosowaniu macierzy dyskowej

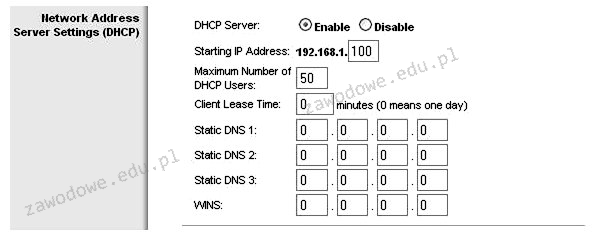

Ilustracja pokazuje panel ustawień bezprzewodowego urządzenia dostępowego, który umożliwia

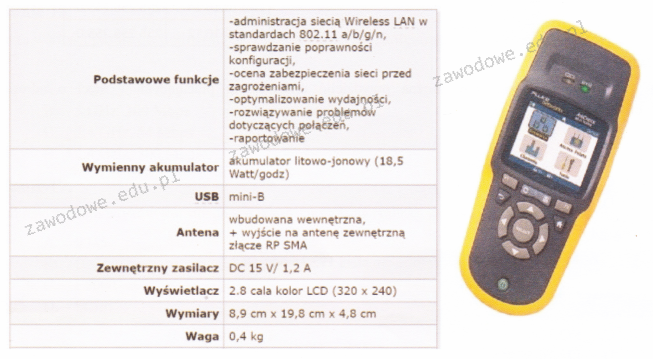

Jakie urządzenie diagnostyczne jest pokazane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?

Planowanie wykorzystania przestrzeni na dysku komputera do gromadzenia i udostępniania informacji takich jak pliki oraz aplikacje dostępne w sieci, a także ich zarządzanie, wymaga skonfigurowania komputera jako

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakim protokołem posługujemy się do przesyłania dokumentów hipertekstowych?

Na ilustracji widoczna jest pamięć operacyjna

Aby zorganizować pliki na dysku w celu poprawy wydajności systemu, należy:

Sekwencja 172.16.0.1, która reprezentuje adres IP komputera, jest zapisana w systemie

Aby w systemie Windows XP stworzyć nowego użytkownika o nazwisku egzamin z hasłem qwerty, powinno się zastosować polecenie

Aby umożliwić połączenie między urządzeniem mobilnym a komputerem za pomocą interfejsu Bluetooth, co należy zrobić?

W złączu zasilania SATA uszkodzeniu uległ żółty kabel. Jakie to ma konsekwencje dla napięcia, które nie jest przesyłane?

Jaką inną formą można zapisać 2^32 bajtów?

Po włączeniu komputera wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Może to być spowodowane

W przedsiębiorstwie zastosowano adres klasy B do podziału na 100 podsieci, z maksymalnie 510 dostępnymi adresami IP w każdej z nich. Jaka maska została użyta do utworzenia tych podsieci?

Bezprzewodową komunikację komputerów w sieci lokalnej zapewnia

Jakie medium transmisyjne powinno być użyte do połączenia dwóch punktów dystrybucyjnych oddalonych o 600m?

Czym wyróżniają się procesory CISC?

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora skutkuje przesłaniem sygnału do komputera, co umożliwia lokalizację kursora?

Jakie korzyści płyną z zastosowania systemu plików NTFS?

Jaki jest maksymalny promień zgięcia przy montażu kabla U/UTP kat 5e?

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

Jakie narzędzie wykorzystuje się do połączenia pigtaila z włóknami światłowodowymi?

Zjawisko, w którym pliki przechowywane na dysku twardym są umieszczane w nieprzylegających do siebie klastrach, nosi nazwę

Na dysku konieczne jest zapisanie 100 tysięcy pojedynczych plików, każdy o wielkości 2570 bajtów. Zajętość zapisanych plików będzie minimalna na dysku o jednostce alokacji wynoszącej