Pytanie 1

Wartość liczby ABBA zapisana w systemie heksadecymalnym odpowiada w systemie binarnym liczbie

Wynik: 31/40 punktów (77,5%)

Wymagane minimum: 20 punktów (50%)

Wartość liczby ABBA zapisana w systemie heksadecymalnym odpowiada w systemie binarnym liczbie

Do czego służy program CHKDSK?

Narzędziem wykorzystywanym do diagnozowania połączeń między komputerami w systemie Windows jest

Po wykonaniu instalacji z domyślnymi parametrami system Windows XP NIE OBSŁUGUJE formatu systemu plików

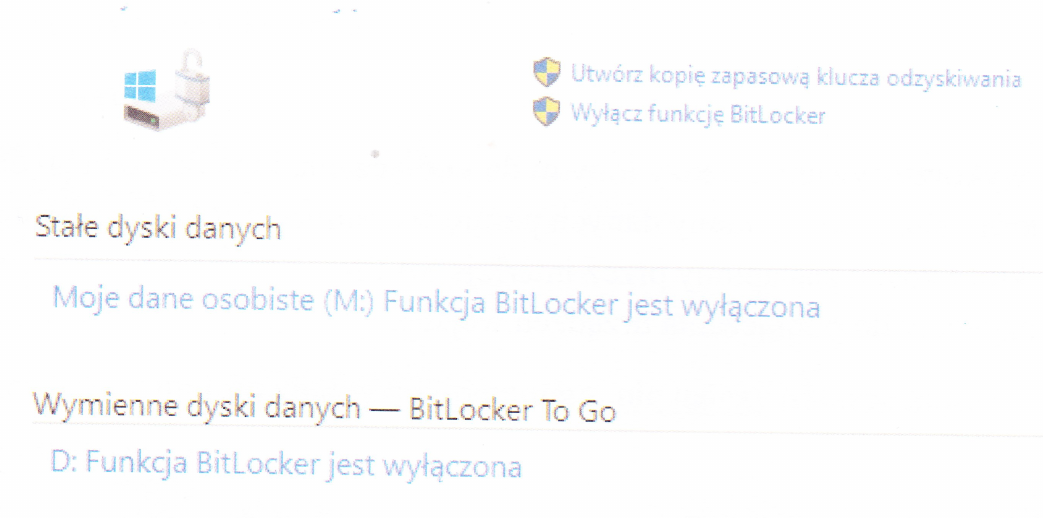

Wbudowane narzędzie dostępne w systemach Windows w edycji Enterprise lub Ultimate jest przeznaczone do

W warstwie łącza danych modelu odniesienia ISO/OSI możliwą przyczyną błędów działania lokalnej sieci komputerowej jest

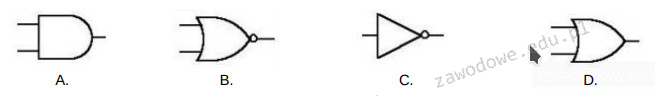

Wskaź rysunek ilustrujący symbol bramki logicznej NOT?

Narzędzie, które chroni przed nieautoryzowanym dostępem do sieci lokalnej, to

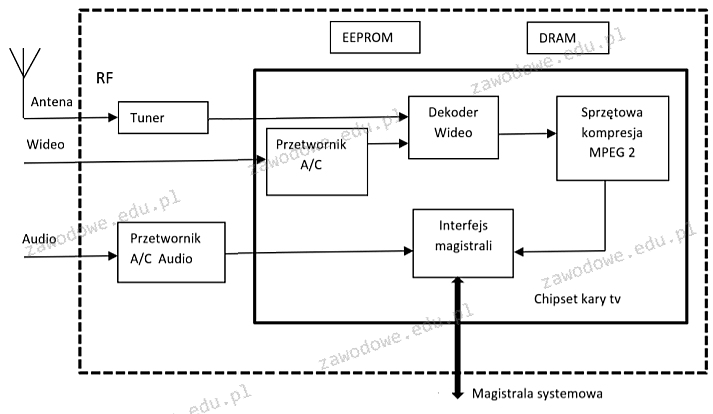

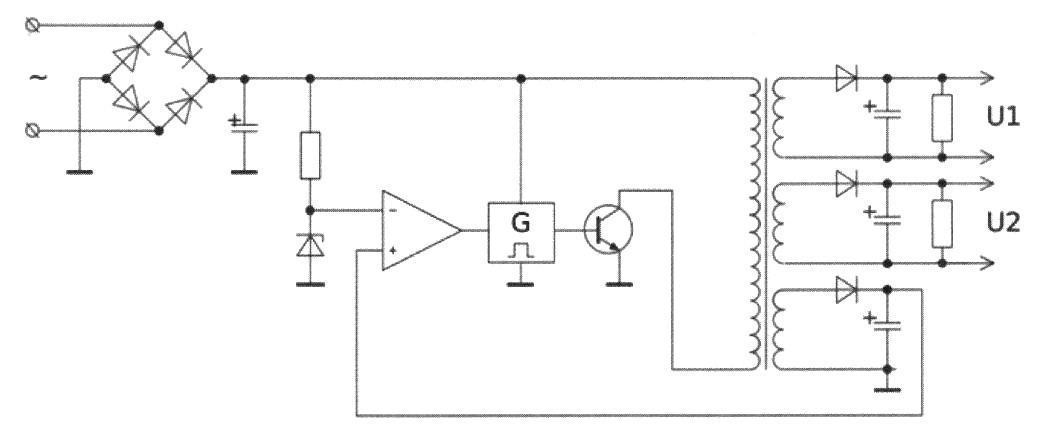

Na ilustracji zaprezentowano schemat blokowy karty

W jakim miejscu są przechowywane dane o kontach użytkowników domenowych w środowisku Windows Server?

Jakiego protokołu używa polecenie ping?

Udostępniono w sieci lokalnej jako udział specjalny folder o nazwie egzamin znajdujący się na komputerze o nazwie SERWER_2 w katalogu głównym dysku C:. Jak powinna wyglądać ścieżka dostępu do katalogu egzamin, w którym przechowywany jest folder macierzysty dla konta użytkownika o określonym loginie?

Zjawisko crosstalk, które występuje w sieciach komputerowych, polega na

Jakie zadanie pełni router?

Co wskazuje oznaczenie danego procesora?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie urządzenie służy do połączenia 6 komputerów w ramach sieci lokalnej?

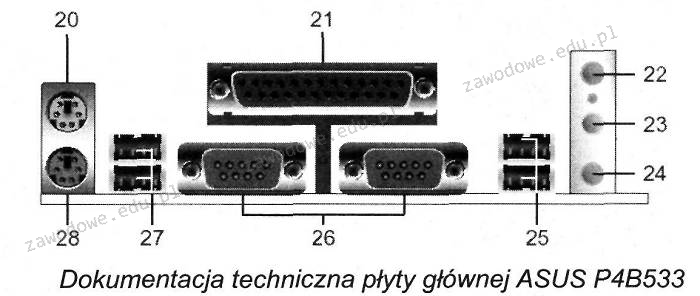

Na zaprezentowanej płycie głównej komputera złącza oznaczono cyframi 25 i 27

Jaką wartość dziesiętną ma liczba FF w systemie szesnastkowym?

Programy CommView oraz WireShark są wykorzystywane do

Jakie właściwości topologii fizycznej sieci zostały przedstawione w poniższej ramce?

Okablowanie strukturalne klasyfikuje się jako część infrastruktury

Jakie parametry otrzyma interfejs sieciowy eth0 po wykonaniu poniższych poleceń w systemie Linux?

Na skutek użycia polecenia ipconfig uzyskano konfigurację przedstawioną na ilustracji. Jaki jest adres IP stacji roboczej, która została poddana testom?

Sufiks DNS konkretnego połączenia :

Opis. . . . . . . . . . . . . . . : Realtek RTL8168C(P)/8111C(P)

PCI-E Gigabit Ethernet NIC

Adres fizyczny. . . . . . . . . . : 00-1F-D0-A5-0B-57

DHCP włączone . . . . . . . . . . : Tak

Autokonfiguracja włączona . . . . : Tak

Adres IP. . . . . . . . . . . . . : 192.168.0.11

Maska podsieci. . . . . . . . . . : 255.255.255.0

Brama domyślna. . . . . . . . . . : 192.168.0.1

Serwer DHCP . . . . . . . . . . . : 192.168.0.1

Serwery DNS . . . . . . . . . . . : 62.21.99.95Analiza uszkodzonych elementów komputera poprzez ocenę stanu wyjściowego układu cyfrowego pozwala na

Aby zatrzymać wykonywanie programu zapisanego w pliku wsadowym Windows do momentu naciśnięcia dowolnego klawisza, należy zastosować komendę

Graficzny symbol odnosi się do standardów sprzętowych

Narzędzie przedstawione do nadzorowania sieci LAN to

C:\Users\egzamin>nmap localhost Starting Nmap 7.80 ( https://nmap.org ) at 2019-11-26 20:23 ?rodkowoeuropejski czas stand. Nmap scan report for localhost (127.0.0.1) Host is up (0.00s latency). Other addresses for localhost (not scanned): ::1 Not shown: 988 closed ports PORT STATE SERVICE 135/tcp open msrpc 445/tcp open microsoft-ds 1025/tcp open NFS-or-IIS 1026/tcp open LSA-or-nterm 1027/tcp open IIS 1029/tcp open ms-lsa 1030/tcp open iad1 1031/tcp open iad2 1044/tcp open dcutility 1234/tcp open hotline 2869/tcp open icslap 16992/tcp open amt-soap-http Nmap done: 1 IP address (1 host up) scanned in 0.94 seconds

Jaką klasę reprezentuje adres IPv4 w postaci binarnej 00101000 11000000 00000000 00000001?

Wykonanie na komputerze z systemem Windows poleceń ipconfig /release oraz ipconfig /renew umożliwia weryfikację, czy usługa w sieci działa poprawnie

Wartość wyrażana w decybelach, będąca różnicą pomiędzy mocą sygnału przekazywanego w parze zakłócającej a mocą sygnału generowanego w parze zakłócanej to

Na rysunku zobrazowano schemat

Wydruk z drukarki igłowej realizowany jest z zastosowaniem zestawu stalowych igieł w liczbie

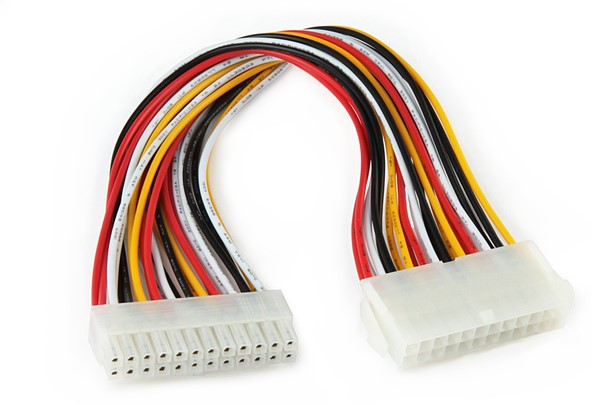

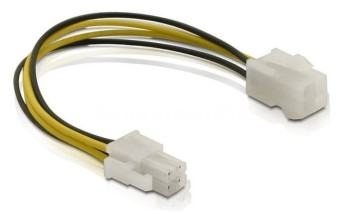

Wskaż złącze, które należy wykorzystać do podłączenia wentylatora, którego parametry przedstawiono w tabeli.

| Wymiar radiatora | 123 x 133 x 163 mm |

| Wentylator | 120 mm + 135 mm |

| Złącze | 4-pin PWM |

| Napięcie zasilające | 12V |

| Żywotność | 300 000h |

Złącze umieszczone na płycie głównej, które umożliwia podłączanie kart rozszerzeń o różnych ilościach pinów, w zależności od wersji, nazywane jest

W przypadku, gdy w tej samej przestrzeni będą funkcjonować jednocześnie dwie sieci WLAN zgodne ze standardem 802.11g, w celu zminimalizowania ryzyka wzajemnych zakłóceń, powinny one otrzymać kanały o numerach różniących się o

W systemie Windows Server, możliwość udostępnienia folderu jako zasobu sieciowego, który jest widoczny na stacji roboczej jako dysk oznaczony literą, można uzyskać poprzez realizację czynności

Polecenie Gpresult

Samodzielną strukturą sieci WLAN jest

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?