Pytanie 1

Na początku procesu uruchamiania sprzętowego komputera, wykonywany jest test

Wynik: 30/40 punktów (75,0%)

Wymagane minimum: 20 punktów (50%)

Na początku procesu uruchamiania sprzętowego komputera, wykonywany jest test

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora skutkuje przesłaniem sygnału do komputera, co umożliwia lokalizację kursora?

Użytkownik pragnie ochronić dane na karcie pamięci przed przypadkowym usunięciem. Taką zabezpieczającą cechę oferuje karta

Zastosowanie symulacji stanów logicznych w obwodach cyfrowych pozwala na

Na podstawie zaprezentowanego cennika oblicz, jaki będzie całkowity koszt jednego dwumodułowego podwójnego gniazda abonenckiego montowanego na powierzchni.

| Lp. | Nazwa | j.m. | Cena jednostkowa brutto |

|---|---|---|---|

| 1. | Puszka natynkowa 45x45 mm dwumodułowa | szt. | 4,00 zł |

| 2. | Ramka + suport 45x45 mm dwumodułowa | szt. | 4,00 zł |

| 3. | Adapter 22,5x45 mm do modułu keystone | szt. | 3,00 zł |

| 4. | Moduł keystone RJ45 kategorii 5e | szt. | 7,00 zł |

Podczas pracy z bazami danych, jakiego rodzaju operację wykonuje polecenie "SELECT"?

Do weryfikacji funkcjonowania serwera DNS na systemach Windows Server można zastosować narzędzie nslookup. Jeżeli w poleceniu jako argument zostanie podana nazwa komputera, np. nslookup host.domena.com, to system sprawdzi

Aplikacja komputerowa, która umożliwia zarządzanie plikami oraz folderami, to:

Cienki klient (thin client) korzysta z protokołu

Wskaź na zakres adresów IP klasy A, który jest przeznaczony do prywatnej adresacji w sieciach komputerowych?

Najskuteczniejszym sposobem na dodanie skrótu do konkretnego programu na pulpitach wszystkich użytkowników w domenie jest

Na ilustracji zaprezentowano końcówkę kabla

Która z usług odnosi się do centralnego zarządzania tożsamościami, uprawnieniami oraz obiektami w sieci?

Sieć 192.200.100.0 z maską 255.255.255.128 podzielono na 4 równe podsieci. Ile maksymalnie adresów hostów jest dostępnych w każdej podsieci?

Proces zapisu na nośnikach BD-R realizowany jest przy użyciu

Najbardziej prawdopodobnym powodem niskiej jakości druku z drukarki laserowej, objawiającym się widocznym rozmazywaniem tonera, jest

Aby w systemie Windows nadać użytkownikowi możliwość zmiany czasu systemowego, potrzebna jest przystawka

W serwisie komputerowym dokumentem zawierającym informacje o sprzęcie, opis usterki, datę zgłoszenia i dane klienta jest

Do przeprowadzenia aktualizacji systemów Linux można zastosować aplikacje

Klient przyniósł do serwisu uszkodzony sprzęt komputerowy. W trakcie procedury odbioru sprzętu, przed rozpoczęciem jego naprawy, serwisant powinien

Ile sieci obejmują adresy IPv4 pokazane w tabeli?

| Adres IPv4 | Maska sieci |

|---|---|

| 10.10.10.10 | 255.255.0.0 |

| 10.10.20.10 | 255.255.0.0 |

| 10.10.20.20 | 255.255.0.0 |

| 10.10.30.30 | 255.255.0.0 |

| 10.20.10.10 | 255.255.0.0 |

| 10.20.20.10 | 255.255.0.0 |

| 10.20.20.30 | 255.255.0.0 |

W systemie Ubuntu, które polecenie umożliwia bieżące monitorowanie działających procesów i aplikacji?

Jakim standardem posługuje się komunikacja między skanerem a aplikacją graficzną?

W systemie Windows można przeprowadzić analizę wpływu uruchomionych aplikacji na wydajność komputera, korzystając z polecenia

Oprogramowanie OEM (Original Equipment Manufacturer) jest związane z

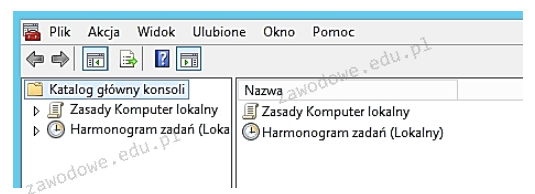

Aby otworzyć konsolę przedstawioną na ilustracji, należy wpisać w oknie poleceń

Zjawisko, w którym pliki przechowywane na dysku twardym są umieszczane w nieprzylegających do siebie klastrach, nosi nazwę

Samodzielną strukturą sieci WLAN jest

Wykonanie polecenia net use Z:192.168.20.2data /delete spowoduje?

Interfejs SATA 2 (3Gb/s) oferuje prędkość transferu

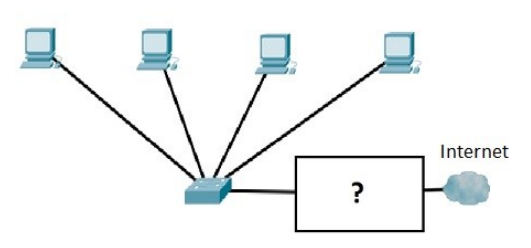

Jakie urządzenie powinno być podłączone do lokalnej sieci w miejscu zaznaczonym na rysunku, aby komputery mogły korzystać z Internetu?

Który z parametrów w poleceniu ipconfig w systemie Windows służy do odnawiania konfiguracji adresów IP?

Aby uzyskać największą prędkość przepływu danych w przypadku, gdy domowy ruter pracuje w paśmie częstotliwości 5 GHz, do notebooka powinno się zamontować bezprzewodową kartę sieciową pracującą w standardzie

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można określić, że ta pamięć

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Zastąpienie koncentratorów przełącznikami w sieci Ethernet doprowadzi do

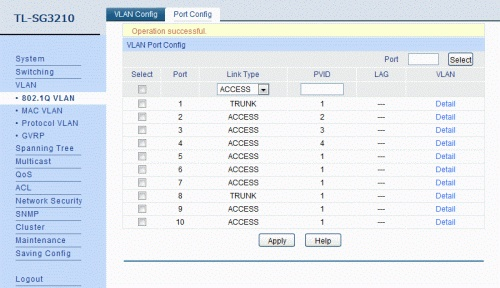

Na ilustracji przedstawiono konfigurację przełącznika z utworzonymi sieciami VLAN. Którymi portami można przesyłać oznaczone ramki z różnych sieci VLAN?

Kluczowe znaczenie przy tworzeniu stacji roboczej dla wielu wirtualnych maszyn ma

W tabeli przedstawiono pobór mocy poszczególnych podzespołów zestawu komputerowego. Zestaw składa się z:

- płyty głównej,

- procesora,

- 2 modułów pamięci DDR3,

- dysku twardego SSD,

- dysku twardego z prędkością obrotową 7200,

- karty graficznej,

- napędu optycznego,

- myszy i klawiatury,

- wentylatora.

Który zasilacz należy zastosować dla przedstawionego zestawu komputerowego, uwzględniając co najmniej 20% rezerwy poboru mocy?

| Podzespół | Pobór mocy [W] | Podzespół | Pobór mocy [W] |

|---|---|---|---|

| Procesor Intel i5 | 60 | Płyta główna | 35 |

| Moduł pamięci DDR3 | 6 | Karta graficzna | 310 |

| Moduł pamięci DDR2 | 3 | Dysk twardy SSD | 7 |

| Monitor LCD | 80 | Dysk twardy 7200 obr./min | 16 |

| Wentylator | 5 | Dysk twardy 5400 obr./min | 12 |

| Mysz i klawiatura | 2 | Napęd optyczny | 30 |

Jakie polecenie trzeba wydać w systemie Windows, aby zweryfikować tabelę mapowania adresów IP na adresy MAC wykorzystywane przez protokół ARP?