Pytanie 1

Jakie czynności należy wykonać, aby przygotować nowego laptopa do użytkowania?

Wynik: 27/40 punktów (67,5%)

Wymagane minimum: 20 punktów (50%)

Jakie czynności należy wykonać, aby przygotować nowego laptopa do użytkowania?

Fizyczna architektura sieci, inaczej określana jako topologia fizyczna sieci komputerowych, definiuje

Aby ocenić stabilność systemu Windows Server, należy użyć narzędzia

Ile adresów można przypisać urządzeniom działającym w sieci o adresie IP 192.168.20.0/26?

Czym jest układ RAMDAC?

Wtyczka zaprezentowana na fotografie stanowi element obwodu elektrycznego zasilającego

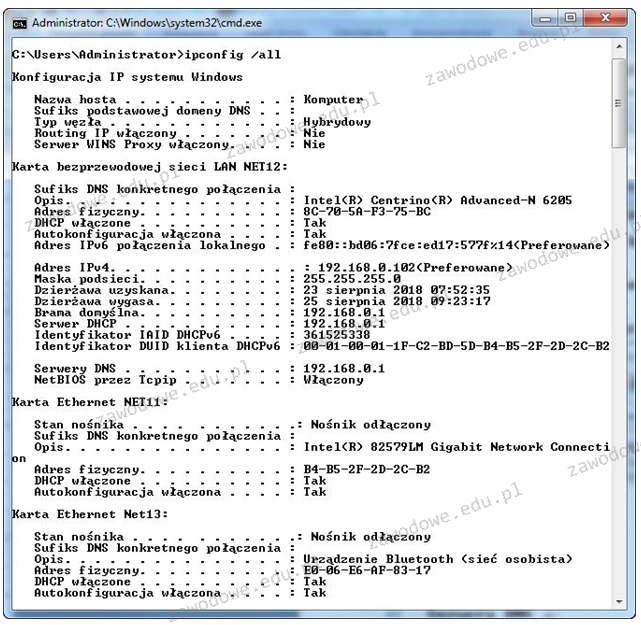

Analizując przedstawione wyniki konfiguracji zainstalowanych kart sieciowych na komputerze, można zauważyć, że

Jakie oprogramowanie dostarcza najwięcej informacji diagnostycznych na temat procesora CPU?

Jakie elementy wchodzą w skład dokumentacji powykonawczej?

Który protokół należy do bezpołączeniowych protokołów warstwy transportowej?

Jakie narzędzie w systemie Windows pozwala na ocenę wpływu poszczególnych procesów i usług na wydajność procesora oraz na obciążenie pamięci i dysku?

Na ilustracji widoczne jest urządzenie służące do

Rodzaj połączenia VPN obsługiwany przez system Windows Server, w którym użytkownicy są uwierzytelniani za pomocą niezabezpieczonych połączeń, a szyfrowanie zaczyna się dopiero po wymianie uwierzytelnień, to

Gdy użytkownik zauważy, że ważne pliki zniknęły z dysku twardego, powinien

Autorskie prawo osobiste twórcy do programu komputerowego

Jakie ustawienia dotyczące protokołu TCP/IP zostały zastosowane dla karty sieciowej, na podstawie rezultatu uruchomienia polecenia IPCONFIG /ALL w systemie Windows?

Karta bezprzewodowej sieci LAN Połączenie sieci bezprzewodowej:

Sufiks DNS konkretnego połączenia :

Opis. . . . . . . . . . . . . . . : Atheros AR5006EG Wireless Network Adapter

Adres fizyczny. . . . . . . . . . : 00-15-AF-35-65-98

DHCP włączone . . . . . . . . . . : Tak

Autokonfiguracja włączona . . . . : Tak

Adres IPv6 połączenia lokalnego . : fe80::8c5e:5e80:f376:fbax9(Preferowane)

Adres IPv4. . . . . . . . . . . . : 192.168.1.102(Preferowane)

Maska podsieci. . . . . . . . . . : 255.255.255.0

Dzierżawa uzyskana. . . . . . . . : 16 lutego 2009 16:51:02

Dzierżawa wygasa. . . . . . . . . : 17 lutego 2009 16:51:01

Brama domyślna. . . . . . . . . . : 192.168.1.1

Serwer DHCP . . . . . . . . . . . : 192.168.1.1

Serwery DNS . . . . . . . . . . . : 194.204.159.1

194.204.152.34

NetBIOS przez Tcpip. . . . . . . : WłączonyUrządzenie, które łączy różne segmenty sieci i przekazuje ramki pomiędzy nimi, wybierając odpowiedni port docelowy dla przesyłanych ramek, to

Jak nazywa się topologia fizyczna sieci, która wykorzystuje fale radiowe jako medium transmisyjne?

Jakie oprogramowanie do wirtualizacji jest dostępne jako rola w systemie Windows Server 2012?

Jak określa się technologię stworzoną przez firmę NVIDIA, która pozwala na łączenie kart graficznych?

Jaki pasywny komponent sieciowy powinno się wykorzystać do podłączenia przewodów z wszystkich gniazd abonenckich do panelu krosowniczego umieszczonego w szafie rack?

Programy antywirusowe mogą efektywnie zabezpieczać komputer. Istotne jest, aby wybrać możliwość uruchamiania aplikacji razem z komputerem oraz opcję

Jaką usługę wykorzystuje się do automatycznego przypisywania adresów IP do komputerów w sieci?

Jaką normę stosuje się w przypadku okablowania strukturalnego w sieciach komputerowych?

Jednym z programów stosowanych do tworzenia kopii zapasowych partycji oraz dysków jest

Jaki instrument jest wykorzystywany do sprawdzania zasilaczy komputerowych?

Wartości 1001 i 100 w pliku /etc/passwd wskazują na

| student:x:1001:100:Jan Kowalski:/home/student:/bin/bash |

Na ilustracji zaprezentowano końcówkę wkrętaka typu

Do wymiany uszkodzonych kondensatorów w karcie graficznej potrzebne jest

W czterech różnych sklepach dostępny jest ten sam komputer w odmiennych cenach. Gdzie można go kupić najtaniej?

| Sklep | Cena netto | Podatek | Informacje dodatkowe |

|---|---|---|---|

| A. | 1500 zł | 23% | Rabat 5% |

| B. | 1600 zł | 23% | Rabat 15% |

| C. | 1650 zł | 23% | Rabat 20% |

| D. | 1800 zł | 23% | Rabat 25 % |

Jakiego systemu operacyjnego powinien nabyć użytkownik, aby zmodernizowany komputer miał możliwość uruchamiania gier obsługujących DirectX12?

Jaki typ zabezpieczeń w sieciach WiFi oferuje najwyższy poziom ochrony?

Wykonanie polecenia ```NET USER GRACZ * /ADD``` w wierszu poleceń systemu Windows spowoduje

Do jakich celów powinno się aktywować funkcję RMON (Remote Network Monitoring) w przełączniku?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Do czego służy narzędzie 'ping' w sieciach komputerowych?

Wskaż błędny sposób podziału dysku MBR na partycje

Urządzenie sieciowe, które umożliwia połączenie pięciu komputerów w tej samej sieci, eliminując kolizje pakietów, to

Który adres IP reprezentuje hosta działającego w sieci o adresie 192.168.160.224/28?

Aby sprawdzić statystyki użycia pamięci wirtualnej w systemie Linux, należy sprawdzić zawartość pliku