Pytanie 1

Jakie urządzenie jest używane do pomiaru wartości rezystancji?

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie jest używane do pomiaru wartości rezystancji?

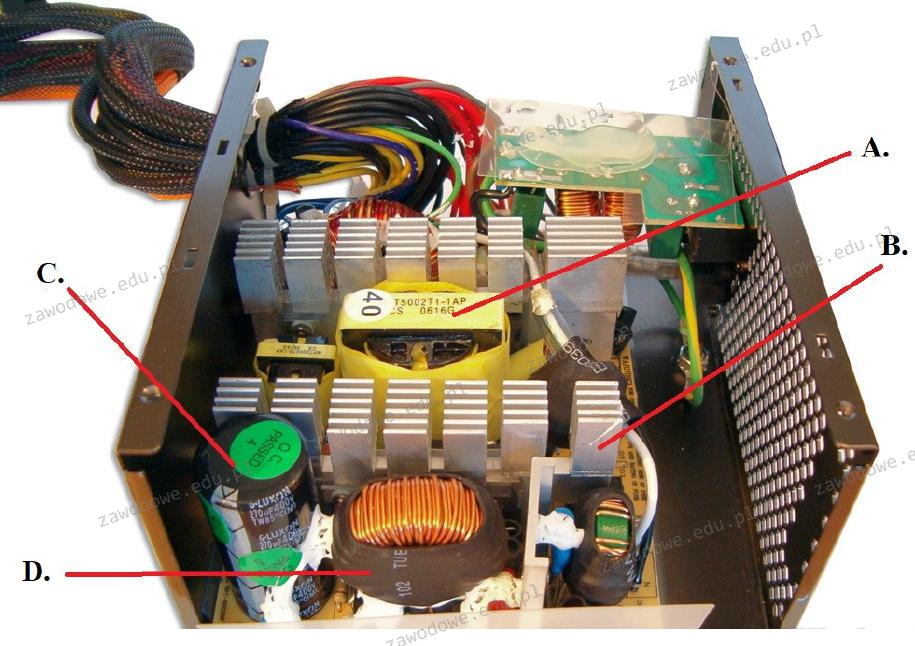

W przedstawionym zasilaczu transformator impulsowy oznaczono symbolami

Klient dostarczył niesprawny sprzęt komputerowy do serwisu. Serwisant w trakcie procedury przyjęcia sprzętu, lecz przed przystąpieniem do jego naprawy, powinien

Jakie czynności należy wykonać, aby przygotować nowego laptopa do użytkowania?

Podczas wyboru zasilacza do komputera kluczowe znaczenie

Który typ drukarki stosuje metodę przenoszenia stałego pigmentu z taśmy na papier odporny na wysoką temperaturę?

Podczas realizacji projektu sieci LAN zastosowano medium transmisyjne zgodne ze standardem Ethernet 1000Base-T. Które z poniższych stwierdzeń jest prawdziwe?

Na dysku należy umieścić 100 tysięcy oddzielnych plików, z których każdy ma rozmiar 2570 bajtów. W takim przypadku, zapisane pliki będą zajmować najmniej miejsca na dysku z jednostką alokacji wynoszącą

Które z urządzeń używanych w sieci komputerowej NIE WPŁYWA na liczbę domen kolizyjnych?

Użytkownicy dysków SSD powinni unikać wykonywania następujących działań konserwacyjnych

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można stwierdzić, że pamięć ta

Jakie urządzenie sieciowe funkcjonuje w warstwie fizycznej modelu ISO/OSI, transmitując sygnał z jednego portu do wszystkich pozostałych portów?

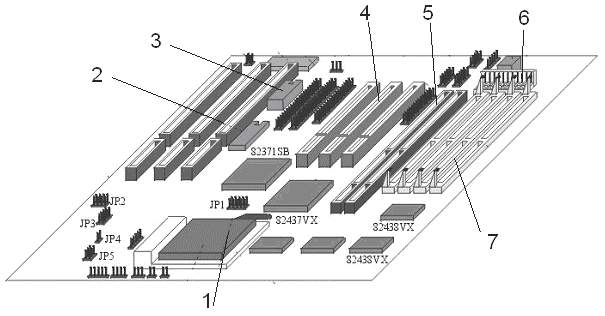

Na schemacie przedstawionej płyty głównej zasilanie powinno być podłączone do gniazda oznaczonego numerem

Jakie urządzenie sieciowe zostało pokazane na ilustracji?

Który rodzaj pracy Access Pointa jest używany, aby umożliwić urządzeniom bezprzewodowym dostęp do przewodowej sieci LAN?

Urządzenie pokazane na ilustracji służy do zgrzewania wtyków

Aby serwerowa płyta główna mogła działać poprawnie, potrzebuje pamięci z rejestrem. Który z poniższych modułów pamięci będzie z nią zgodny?

Adres IP (ang. Internet Protocol Address) to

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Niskopoziomowe formatowanie dysku IDE HDD polega na

Scandisk to narzędzie, które wykorzystuje się do

Skaner, który został przedstawiony, należy podłączyć do komputera za pomocą złącza

Zgodnie z aktualnymi normami BHP, zalecana odległość oczu od ekranu monitora powinna wynosić

Komputery K1, K2, K3, K4 są podłączone do interfejsów przełącznika, które są przypisane do VLAN-ów wymienionych w tabeli. Które z tych komputerów mają możliwość komunikacji ze sobą?

| Nazwa komputera | Adres IP | Nazwa interfejsu | VLAN |

| K1 | 10.10.10.1/24 | F1 | VLAN 10 |

| K2 | 10.10.10.2/24 | F2 | VLAN 11 |

| K3 | 10.10.10.3/24 | F3 | VLAN 10 |

| K4 | 10.10.11.4/24 | F4 | VLAN 11 |

Czy możesz wskazać, jak wygląda zapis maski podsieci /23 w systemie dziesiętnym, wiedząc, że pierwsze 23 bity z 32-bitowej liczby binarnej to jedynki, a pozostałe to zera? Każdemu z kolejnych 8 bitów odpowiada jedna liczba dziesiętna?

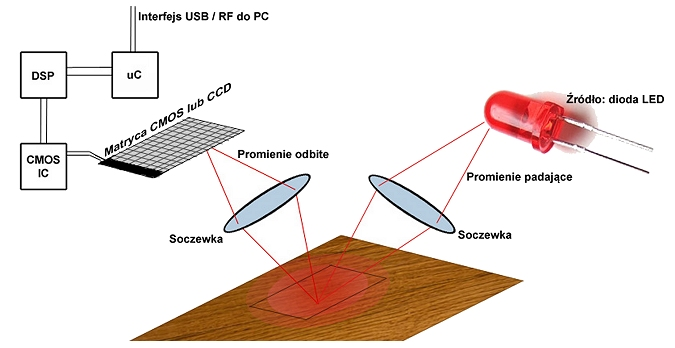

Zaprezentowany diagram ilustruje zasadę funkcjonowania

Jakie oznaczenie wskazuje adres witryny internetowej oraz przypisany do niej port?

Po włączeniu komputera wyświetlił się komunikat: Non-system disk or disk error. Replace and strike any key when ready. Co może być tego przyczyną?

SuperPi to aplikacja używana do oceniania

Jakim skrótem określane są czynności samokontroli komputera po uruchomieniu zasilania?

Jakie stwierdzenie o routerach jest poprawne?

Aby zmierzyć moc zużywaną przez komputer, należy zastosować

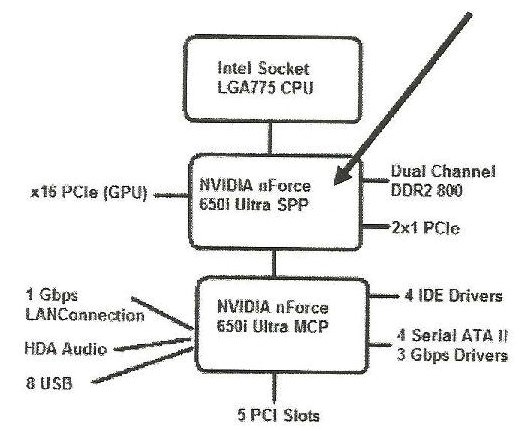

Jaką rolę pełni komponent wskazany strzałką na schemacie chipsetu płyty głównej?

W specyfikacji IEEE 802.3af opisano technologię dostarczania energii elektrycznej do różnych urządzeń sieciowych jako

Jakie oprogramowanie można wykorzystać do wykrywania problemów w pamięciach RAM?

Aby oddzielić komputery pracujące w sieci z tym samym adresem IPv4, które są podłączone do przełącznika zarządzalnego, należy przypisać

Jaki rodzaj dysków jest podłączany do złącza IDE na płycie głównej komputera?

Która z wymienionych właściwości kabla koncentrycznego RG-58 sprawia, że nie jest on obecnie używany do tworzenia lokalnych sieci komputerowych?

PoE to norma

Który z poniższych interfejsów powinien być wybrany do podłączenia dysku SSD do płyty głównej komputera stacjonarnego, aby uzyskać najwyższą szybkość zapisu oraz odczytu danych?