Pytanie 1

Urządzenie sieciowe typu most (ang. Bridge) działa w:

Wynik: 14/40 punktów (35,0%)

Wymagane minimum: 20 punktów (50%)

Urządzenie sieciowe typu most (ang. Bridge) działa w:

Polecenie dsadd służy do

Jaką prędkość transmisji określa standard Ethernet IEEE 802.3z?

Do jakiej warstwy modelu ISO/OSI odnosi się segmentacja danych, komunikacja w trybie połączeniowym z użyciem protokołu TCP oraz komunikacja w trybie bezpołączeniowym z zastosowaniem protokołu UDP?

Powyżej przedstawiono fragment pliku konfiguracyjnego usługi serwerowej w systemie Linux. Jest to usługa

authoritative; ddns-update-style ad-hoc; subnet 192.168.1.0 netmask 255.255.255.0 { range 192.168.1.2 192.168.1.100; option domain-name "egzamin.edu.pl"; option netbios-name-servers 192.168.1.1; option domain-name-servers 194.204.159.1, 194.204.152.34; default-lease-time 90000; option routers 192.168.1.1; option subnet-mask 255.255.255.0; option broadcast-address 192.168.1.255; }

Symbol graficzny przedstawiony na rysunku oznacza

Który ze wskaźników okablowania strukturalnego definiuje stosunek mocy testowego sygnału w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu przewodu?

Jaką funkcję punkt dostępu wykorzystuje do zabezpieczenia sieci bezprzewodowej, aby jedynie urządzenia z określonymi adresami fizycznymi mogły się z nią połączyć?

Jakie urządzenie pozwala na podłączenie drukarki bez karty sieciowej do sieci lokalnej komputerów?

Jakie polecenie służy do analizy statystyk protokołów TCP/IP oraz bieżących połączeń sieciowych w systemach operacyjnych rodziny Windows?

Protokół SNMP (Simple Network Management Protocol) służy do

Jaką funkcję pełni protokół ARP (Address Resolution Protocol)?

Podczas konfigurowania oraz instalacji serwera DHCP w systemach z rodziny Windows Server można wprowadzać zastrzeżenia dotyczące adresów, które określą

NAT64 (Network Address Translation 64) to proces, który przekształca adresy

Jakie jest odpowiednik maski 255.255.252.0 w postaci prefiksu?

Zgodnie z normą EN-50173, klasa D skrętki komputerowej obejmuje zastosowania wykorzystujące zakres częstotliwości

Komputer w sieci lokalnej ma adres IP 172.16.0.0/18. Jaka jest maska sieci wyrażona w postaci dziesiętnej?

Aby zabezpieczyć system Windows przed nieautoryzowanym dostępem poprzez ograniczenie liczby nieudanych prób logowania, należy ustawić

Który standard protokołu IEEE 802.3 powinien być użyty w środowisku z zakłóceniami elektromagnetycznymi, gdy dystans między punktem dystrybucji a punktem abonenckim wynosi 200 m?

Administrator zamierza zorganizować adresację IP w przedsiębiorstwie. Dysponuje pulą adresów 172.16.0.0/16, którą powinien podzielić na 10 podsieci z równą liczbą hostów. Jaką maskę powinien zastosować?

Aplikacja systemowa Linux, której celem jest kontrolowanie ruchu sieciowego zarówno przychodzącego, jak i wychodzącego z określonego urządzenia, to

Proces łączenia sieci komputerowych, który polega na przesyłaniu pakietów protokołu IPv4 przez infrastrukturę opartą na protokole IPv6 oraz w przeciwnym kierunku, nosi nazwę

Brak odpowiedzi na to pytanie.

W systemie Windows narzędzie do zarządzania skryptami wiersza poleceń, które pozwala na przeglądanie lub zmianę konfiguracji sieciowej komputera, który jest włączony, to

Który z poniższych zapisów określa folder noszący nazwę dane, który jest udostępniony na dysku sieciowym urządzenia o nazwie serwer1?

Użytkownik domeny podczas logowania widzi komunikat przedstawiony na rysunku, co oznacza, że użytkownik nie ma

Zalogowano się przy użyciu profilu tymczasowego. Nie masz dostępu do swoich plików, a pliki tworzone w ramach tego profilu zostaną usunięte po wylogowaniu. Aby rozwiązać ten problem, wyloguj się i zaloguj się później. 08:19 |

Podłączając wszystkie elementy sieciowe do switcha, wykorzystuje się topologię fizyczną

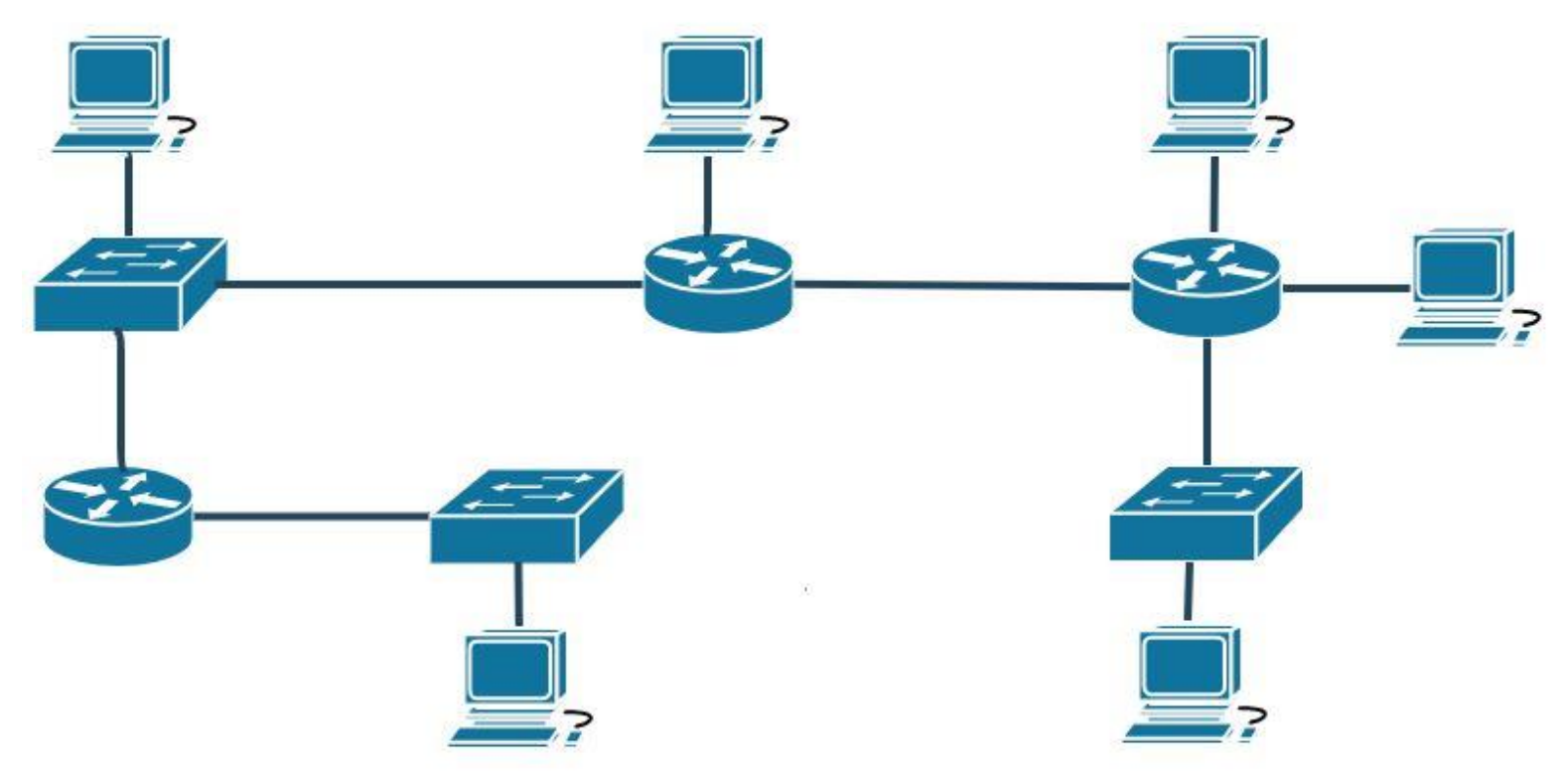

Ile domen rozgłoszeniowych istnieje w sieci o schemacie przedstawionym na rysunku, jeżeli przełączniki pracują w drugiej warstwie modelu ISO/OSI z konfiguracją domyślną?

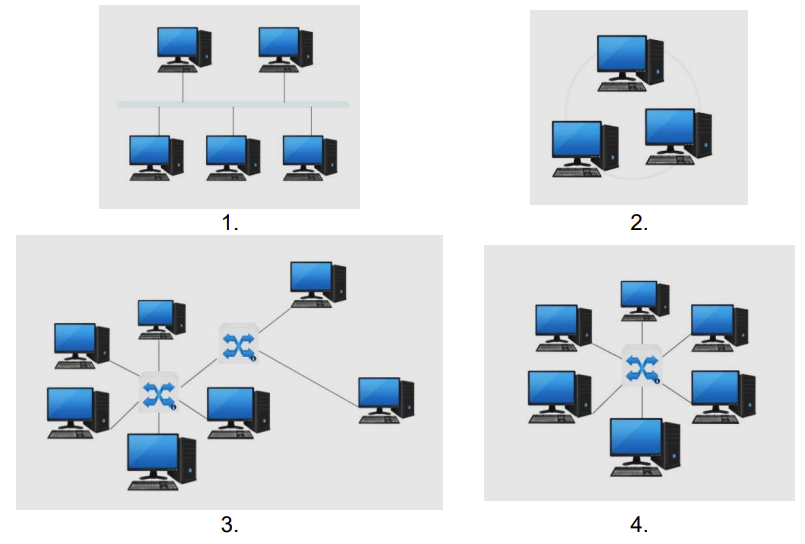

Na którym rysunku przedstawiono topologię gwiazdy?

Jak nazywa się topologia fizyczna, w której wszystkie urządzenia sieciowe są połączone z jednym centralnym urządzeniem?

Które urządzenie sieciowe jest widoczne na zdjęciu?

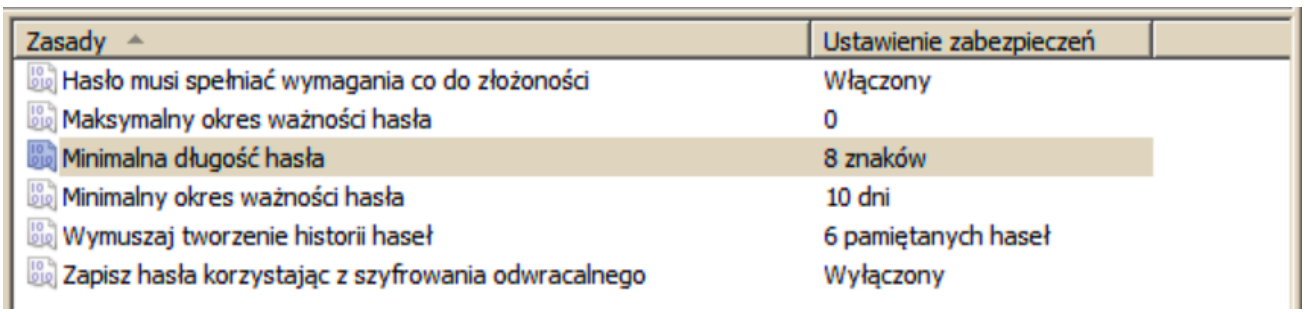

Na zrzucie ekranowym jest przedstawiona konfiguracja zasad haseł w zasadach grup systemu Windows.

Która z opcji zostanie wdrożona w tej konfiguracji?

Który element zabezpieczeń znajduje się w pakietach Internet Security (IS), ale nie występuje w programach antywirusowych (AV)?

Aby uzyskać sześć podsieci z sieci o adresie 192.168.0.0/24, co należy zrobić?

W specyfikacji sieci Ethernet 1000Base-T maksymalna długość segmentu dla skrętki kategorii 5 wynosi

Na ilustracji jest przedstawiona skrętka

The Dude, Cacti oraz PRTG to przykłady aplikacji wykorzystujących protokół SNMP (ang. Simple Network Management Protocol), używanego do

Który z protokołów nie jest wykorzystywany do ustawiania wirtualnej sieci prywatnej?

Które z poniższych poleceń systemu Linux wyświetla aktualną konfigurację interfejsów sieciowych?

W trakcie konfiguracji serwera DHCP administrator przypisał zbyt małą pulę adresów IP. Jakie mogą być skutki tej sytuacji w sieci lokalnej?

W celu zwiększenia bezpieczeństwa sieci firmowej administrator wdrożył protokół 802.1X. Do czego służy ten protokół?