Pytanie 1

W jakim oprogramowaniu trzeba zmienić konfigurację, aby użytkownik mógł wybrać z listy i uruchomić jeden z różnych systemów operacyjnych zainstalowanych na swoim komputerze?

Wynik: 1/40 punktów (2,5%)

Wymagane minimum: 20 punktów (50%)

W jakim oprogramowaniu trzeba zmienić konfigurację, aby użytkownik mógł wybrać z listy i uruchomić jeden z różnych systemów operacyjnych zainstalowanych na swoim komputerze?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Na rysunku można zobaczyć schemat topologii fizycznej, która jest kombinacją topologii

Aby utworzyć kontroler domeny w systemach z rodziny Windows Server na serwerze lokalnym, konieczne jest zainstalowanie roli

Brak odpowiedzi na to pytanie.

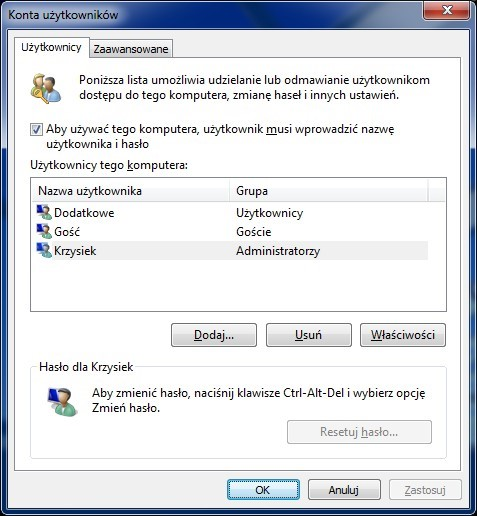

Aby uruchomić przedstawione narzędzie systemu Windows, należy użyć polecenia

Brak odpowiedzi na to pytanie.

Jakiego rodzaju złącze powinna mieć płyta główna, aby użytkownik był w stanie zainstalować kartę graficzną przedstawioną na rysunku?

Brak odpowiedzi na to pytanie.

Jakie urządzenie NIE powinno być serwisowane podczas korzystania z urządzeń antystatycznych?

Brak odpowiedzi na to pytanie.

W systemie Linux plik posiada uprawnienia ustawione na 541. Właściciel ma możliwość pliku

Brak odpowiedzi na to pytanie.

Aby skopiować katalog c: est z podkatalogami na dysk przenośny f: w systemie Windows 7, jakie polecenie należy zastosować?

Brak odpowiedzi na to pytanie.

W ustawieniach haseł w systemie Windows Server aktywowano opcję, że hasło musi spełniać wymagania dotyczące złożoności. Z jakiej minimalnej liczby znaków musi składać się hasło użytkownika?

Brak odpowiedzi na to pytanie.

Jakie pasmo częstotliwości definiuje klasa okablowania D?

Brak odpowiedzi na to pytanie.

Jak nazywa się topologia fizyczna sieci, która wykorzystuje fale radiowe jako medium transmisyjne?

Brak odpowiedzi na to pytanie.

Która funkcja przełącznika zarządzalnego pozwala na łączenie kilku przełączników fizycznych w jedną wirtualną linię, aby zwiększyć przepustowość łącza?

Brak odpowiedzi na to pytanie.

Z analizy danych przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi 184 styki 64-bitowa magistrala danych Pojemność 1024 MB Przepustowość 3200 MB/s

Brak odpowiedzi na to pytanie.

Usługi na serwerze są konfigurowane za pomocą

Brak odpowiedzi na to pytanie.

Aby prawidłowo uzupełnić składnię przedstawionego polecenia, które udostępnia folder 'Dane' pod nazwą 'test', w miejsce kropek należy wpisać odpowiednie słowo:

net ... test=C:\Dane

Brak odpowiedzi na to pytanie.

Podstawowym zadaniem mechanizmu Plug and Play jest

Brak odpowiedzi na to pytanie.

Dwie stacje robocze w tej samej sieci nie są w stanie się skomunikować. Która z poniższych okoliczności może być przyczyną opisanego problemu?

Brak odpowiedzi na to pytanie.

Aby oczyścić zablokowane dysze kartridża drukarki atramentowej, co należy zrobić?

Brak odpowiedzi na to pytanie.

Narzędzie chroniące przed nieautoryzowanym dostępem do lokalnej sieci, to

Brak odpowiedzi na to pytanie.

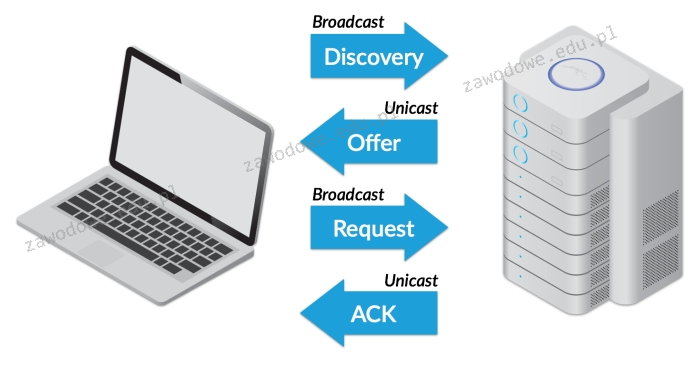

Którego protokołu działanie zostało zaprezentowane na diagramie?

Brak odpowiedzi na to pytanie.

Dobrze zaprojektowana sieć komputerowa powinna zapewniać możliwość rozbudowy, czyli charakteryzować się

Brak odpowiedzi na to pytanie.

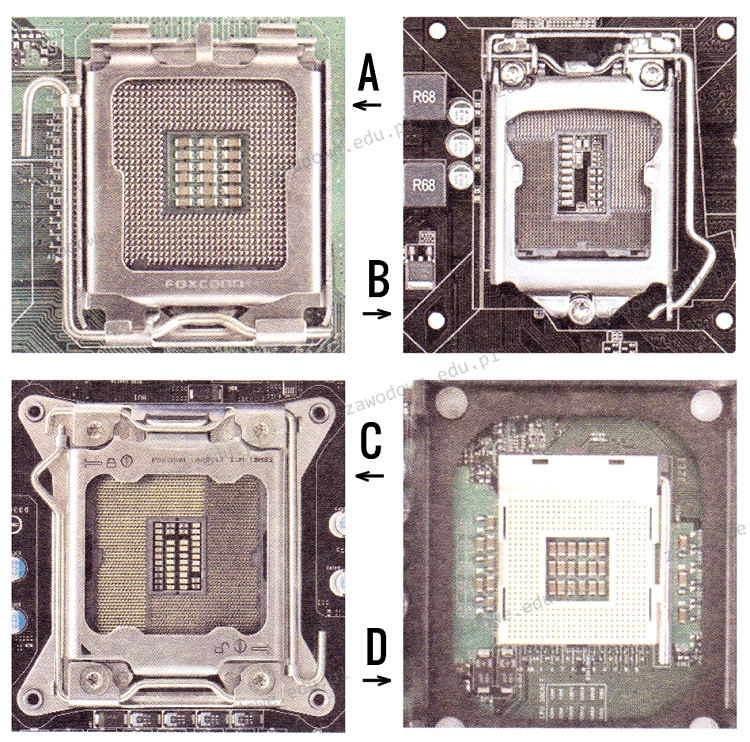

W jakim gnieździe powinien być umieszczony procesor INTEL CORE i3-4350- 3.60 GHz, x2/4, 4MB, 54W, HD 4600, BOX, s-1150?

Brak odpowiedzi na to pytanie.

Narzędziem służącym do monitorowania efektywności oraz niezawodności w systemach Windows 7, Windows Server 2008 R2 i Windows Vista jest

Brak odpowiedzi na to pytanie.

Aby osiągnąć przepustowość 4 GB/s w obydwie strony, konieczne jest zainstalowanie w komputerze karty graficznej używającej interfejsu

Brak odpowiedzi na to pytanie.

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

Brak odpowiedzi na to pytanie.

Który z poniższych adresów stanowi adres rozgłoszeniowy dla sieci 172.16.64.0/26?

Brak odpowiedzi na to pytanie.

Switch jako kluczowy komponent występuje w sieci o strukturze

Brak odpowiedzi na to pytanie.

Zgodnie z przedstawionymi zaleceniami dla drukarki atramentowej, kolorowe dokumenty powinny być drukowane przynajmniej

„Czyszczenie głowicy drukarki …. ….. W tym przypadku najskuteczniejszym rozwiązaniem jest wyczyszczenie głowicy drukarki z zaschniętego tuszu. Z reguły wystarcza przetarcie głównego źródła problemu wilgotnym ręcznikiem. Jeżeli to nie pomoże należy zassać tusz do dysz, co pozwoli usunąć z nich powietrze. ….. Kiedy również i to nie pomoże należy przejść do ręcznego czyszczenia głowicy. Drukarka….. powinna być wyłączana na noc, ponieważ po każdym włączeniu przeprowadzane są mini cykle czyszczenia. Warto również pamiętać o wydrukowaniu przynajmniej raz w tygodniu kolorowego dokumentu, dzięki czemu zminimalizujemy prawdopodobieństwo zaschnięcia tuszu." Fragment instrukcji czyszczenia drukarki |

Brak odpowiedzi na to pytanie.

Aby uporządkować dane pliku zapisane na dysku twardym, które znajdują się w nie sąsiadujących klastrach, tak by zajmowały one sąsiadujące ze sobą klastry, należy przeprowadzić

Brak odpowiedzi na to pytanie.

Jaką konfigurację sieciową może mieć komputer, który należy do tej samej sieci LAN, co komputer z adresem 10.8.1.10/24?

Brak odpowiedzi na to pytanie.

W systemie Windows przy użyciu polecenia assoc można

Brak odpowiedzi na to pytanie.

Norma PN-EN 50173 rekomenduje montaż przynajmniej

Brak odpowiedzi na to pytanie.

Z jaką minimalną efektywną częstotliwością taktowania mogą działać pamięci DDR2?

Brak odpowiedzi na to pytanie.

W przypadku sieci strukturalnej rekomendowane jest zainstalowanie jednego punktu abonenckiego na obszarze wynoszącym

Brak odpowiedzi na to pytanie.

Jakiego rodzaju wkręt powinno się zastosować do przymocowania napędu optycznego o szerokości 5,25" w obudowie, która wymaga użycia śrub do mocowania napędów?

Brak odpowiedzi na to pytanie.

Narzędzie używane do przechwytywania oraz analizy danych przesyłanych w sieci, to

Brak odpowiedzi na to pytanie.

W sytuacji, gdy nie ma możliwości uruchomienia programu BIOS Setup, jak przywrócić domyślne ustawienia płyty głównej?

Brak odpowiedzi na to pytanie.

Komputer jest połączony z myszą bezprzewodową, a kursor w trakcie używania nie porusza się płynnie, tylko "skacze" po ekranie. Możliwą przyczyną awarii urządzenia może być

Brak odpowiedzi na to pytanie.

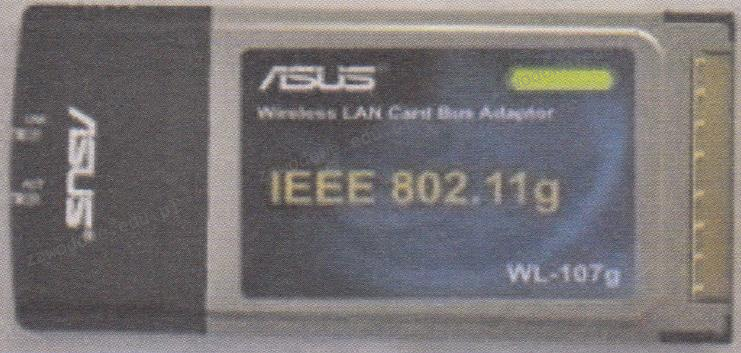

Karta sieciowa przedstawiona na ilustracji ma zdolność przesyłania danych z maksymalną prędkością

Brak odpowiedzi na to pytanie.