Pytanie 1

Interfejs graficzny systemu Windows, który wyróżnia się przezroczystością przypominającą szkło oraz delikatnymi animacjami okien, nazywa się

Wynik: 11/40 punktów (27,5%)

Wymagane minimum: 20 punktów (50%)

Interfejs graficzny systemu Windows, który wyróżnia się przezroczystością przypominającą szkło oraz delikatnymi animacjami okien, nazywa się

Diagnostykę systemu Linux można przeprowadzić używając polecenia

Architecture: x86_64 CPU op-mode(s): 32-bit, 64-bit Byte Order: Little Endian CPU(s): 8 On-line CPU(s) list: 0-7 Thread(s) per core: 2 Core(s) per socket: 4 Socket(s): 1 NUMA node(s): 1 Vendor ID: GenuineIntel CPU family: 6 Model: 42 Stepping: 7 CPU MHz: 1600.000 BogoMIPS: 6784.46 Virtualization: VT-x L1d cache: 32K L1i cache: 32K L2 cache: 256K L3 cache: 8192K NUMA node0 CPU(s): 0-7

Protokół używany do zarządzania urządzeniami w sieci to

W nagłówku ramki standardu IEEE 802.3 w warstwie łącza danych znajduje się

W systemie Windows, gdzie można ustalić wymagania dotyczące złożoności hasła?

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

Zamontowany w notebooku trackpoint jest urządzeniem wejściowym reagującym na

Osoba korzystająca z komputera publikuje w sieci Internet pliki, które posiada. Prawa autorskie zostaną złamane, gdy udostępni

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

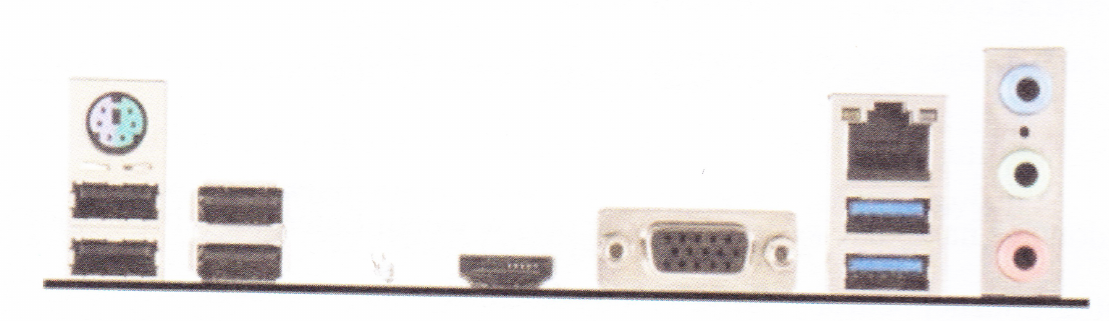

Zidentyfikuj interfejsy znajdujące się na panelu tylnym płyty głównej:

Która z licencji umożliwia korzystanie przez każdego użytkownika z programu bez ograniczeń wynikających z autorskich praw majątkowych?

Dysk twardy IDE wewnętrzny jest zasilany przez połączenie typu

Wskaż nazwę modelu przechowywania i przetwarzania danych opartego na użytkowaniu zasobów dyskowych, obliczeniowych i programowych, udostępnionych przez usługodawcę za pomocą sieci komputerowej.

Administrator pragnie udostępnić w sieci folder C:instrukcje trzem użytkownikom z grupy Serwisanci. Jakie rozwiązanie powinien wybrać?

Element płyty głównej odpowiedzialny za wymianę danych między mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej jest na rysunku oznaczony numerem

Komunikat tekstowy KB/Interface error, wyświetlony na ekranie komputera z BIOS POST firmy AMI, informuje o błędzie

Bezpośrednio po usunięciu istotnych plików z dysku twardego, użytkownik powinien

Brak zabezpieczeń przed utratą danych w wyniku fizycznej awarii jednego z dysków to właściwość

Błąd typu STOP Error (Blue Screen) w systemie Windows, który wiąże się z odniesieniem się systemu do niepoprawnych danych w pamięci RAM, to

Której aplikacji należy użyć, aby sprawdzić parametry S.M.A.R.T.?

Licencja na Office 365 PL Personal (na 1 stanowisko, subskrypcja na 1 rok) ESD jest przypisana do

Jakie urządzenie powinno być wykorzystane do pomiaru mapy połączeń w okablowaniu strukturalnym sieci lokalnej?

Zatrzymując pracę na komputerze, możemy szybko wznowić działania po wybraniu w systemie Windows opcji

Zastosowanie symulacji stanów logicznych w obwodach cyfrowych pozwala na

Kable światłowodowe nie są powszechnie używane w lokalnych sieciach komputerowych z powodu

Autor zamieszczonego oprogramowania zezwala na jego bezpłatne używanie jedynie w przypadku

| Ancient Domains of Mystery | |

|---|---|

| Autor | Thomas Biskup |

| Platforma sprzętowa | DOS, OS/2, Macintosh, Microsoft Windows, Linux |

| Pierwsze wydanie | 23 października 1994 |

| Aktualna wersja stabilna | 1.1.1 / 20 listopada 2002 r. |

| Aktualna wersja testowa | 1.2.0 Prerelease 18 / 1 listopada 2013 |

| Licencja | postcardware |

| Rodzaj | roguelike |

Awaria drukarki igłowej może być spowodowana uszkodzeniem

Jak nazywa się proces dodawania do danych z warstwy aplikacji informacji powiązanych z protokołami funkcjonującymi na różnych poziomach modelu sieciowego?

Termin "PIO Mode" odnosi się do trybu operacyjnego

Podczas uruchamiania komputera wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Jakie polecenie jest używane do monitorowania statystyk protokołów TCP/IP oraz bieżących połączeń sieciowych w systemach operacyjnych z rodziny Windows?

Dysk zewnętrzny 3,5" o pojemności 5 TB, używany do archiwizacji lub wykonywania kopii zapasowych, wyposażony jest w obudowę z czterema interfejsami komunikacyjnymi do wyboru. Który z tych interfejsów powinien być użyty do podłączenia do komputera, aby uzyskać najwyższą prędkość transferu?

Jakie polecenie umożliwia wyświetlanie oraz modyfikację tabel translacji adresów IP do adresów fizycznych?

Aby uzyskać największą prędkość przepływu danych w przypadku, gdy domowy ruter pracuje w paśmie częstotliwości 5 GHz, do notebooka powinno się zamontować bezprzewodową kartę sieciową pracującą w standardzie

Obudowa oraz wyświetlacz drukarki fotograficznej są mocno zabrudzone. Jakie środki należy zastosować, aby je oczyścić bez ryzyka uszkodzenia?

W systemie Windows, domyślne konto administratora po jego dezaktywowaniu oraz ponownym uruchomieniu komputera

W systemie Windows po wykonaniu polecenia systeminfo nie otrzyma się informacji o

Jaką maksymalną długość kabla typu skrętka pomiędzy panelem krosowniczym a gniazdem abonenckim przewiduje norma PN-EN 50174-2?

Które z urządzeń sieciowych jest przedstawione na grafice?

Jakie są nazwy licencji, które umożliwiają korzystanie z programu w pełnym zakresie, ale ograniczają liczbę uruchomień do określonej, niewielkiej ilości od momentu instalacji?