Pytanie 1

Komputer zarejestrowany w domenie Active Directory nie ma możliwości połączenia się z kontrolerem domeny, na którym znajduje się profil użytkownika. Jaki rodzaj profilu użytkownika zostanie utworzony na tym urządzeniu?

Wynik: 14/40 punktów (35,0%)

Wymagane minimum: 20 punktów (50%)

Komputer zarejestrowany w domenie Active Directory nie ma możliwości połączenia się z kontrolerem domeny, na którym znajduje się profil użytkownika. Jaki rodzaj profilu użytkownika zostanie utworzony na tym urządzeniu?

Przed dokonaniem zmian w rejestrze systemu Windows, w celu zapewnienia bezpieczeństwa pracy, należy najpierw

Jakie jest rozwinięcie skrótu, który odnosi się do usług mających na celu m.in. nadawanie priorytetów przesyłanym pakietom oraz zarządzanie przepustowością w sieci?

Sprzętem, który umożliwia wycinanie wzorów oraz grawerowanie w różnych materiałach, takich jak drewno, szkło i metal, jest ploter

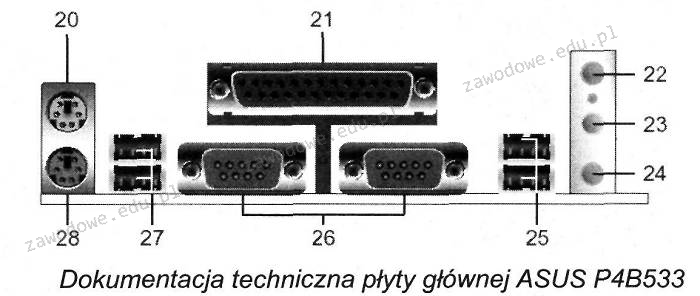

Na zaprezentowanej płycie głównej komputera złącza oznaczono cyframi 25 i 27

Po przeanalizowaniu wyników testu dysku twardego, jakie czynności powinny zostać wykonane, aby zwiększyć jego wydajność?

| Wolumin (C:) | ||

| Rozmiar woluminu | = | 39,06 GB |

| Rozmiar klastra | = | 4 KB |

| Zajęte miejsce | = | 27,48 GB |

| Wolne miejsce | = | 11,58 GB |

| Procent wolnego miejsca | = | 29 % |

| Fragmentacja woluminu | ||

| Fragmentacja całkowita | = | 15 % |

| Fragmentacja plików | = | 31 % |

| Fragmentacja wolnego miejsca | = | 0 % |

Aktywacja opcji OCR podczas ustawiania skanera umożliwia

Jakie jest tworzywo eksploatacyjne w drukarce laserowej?

Użytkownik chce zabezpieczyć mechanicznie dane na karcie pamięci przed przypadkowym skasowaniem. Takie zabezpieczenie umożliwia karta

Jaką wartość liczbową reprezentuje zapis binarny 01010101?

Aby uzyskać wyświetlenie podanych informacji o systemie Linux w terminalu, należy skorzystać z komendy

Zamieszczone atrybuty opisują rodzaj pamięci

| Maksymalne taktowanie | 1600 MHz |

| Przepustowość | PC12800 1600MHz |

| Opóźnienie | Cycle Latency CL 9,0 |

| Korekcja | Nie |

| Dual/Quad | Dual Channel |

| Radiator | Tak |

Ataki mające na celu zakłócenie funkcjonowania aplikacji oraz procesów działających w urządzeniu sieciowym określane są jako ataki typu

Kable łączące poziome punkty dystrybucyjne z centralnym punktem dystrybucyjnym określa się jako

W systemie Linux komenda chown pozwala na

Którego polecenia należy użyć, aby w ruterze skonfigurować trasę statyczną dla adresu następnego skoku 192.168.1.1?

Zastosowanie programu Wireshark polega na

Błąd typu STOP w systemie Windows (Blue Screen), który występuje w momencie, gdy system odwołuje się do niepoprawnych danych w pamięci RAM, to

Narzędziem służącym do tworzenia logicznych podziałów na dysku twardym w systemie GNU/Linux jest

Który standard implementacji sieci Ethernet określa sieć wykorzystującą kabel koncentryczny, z maksymalną długością segmentu wynoszącą 185 m?

W jakiej fizycznej topologii sieci komputerowej każdy węzeł ma łączność fizyczną z każdym innym węzłem w sieci?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W komputerach obsługujących wysokowydajne zadania serwerowe, konieczne jest użycie dysku z interfejsem

Urządzenie przedstawione na rysunku

Materiałem eksploatacyjnym stosowanym w drukarkach tekstylnych jest

Jaki protokół umożliwia nawiązywanie szyfrowanych połączeń terminalowych z zdalnym komputerem?

W dokumentacji przedstawiono typ systemu plików

| „Zaawansowany system plików zapewniający wydajność, bezpieczeństwo, niezawodność i zaawansowane funkcje niespotykane w żadnej wersji systemu FAT. Na przykład dzięki standardowemu rejestrowaniu transakcji i technikom odzyskiwania danych system gwarantuje spójność woluminów. W przypadku awarii system wykorzystuje plik dziennika i informacje kontrolne do przywrócenia spójności systemu plików." |

Na ilustracji zaprezentowano układ

Polecenie uname -s w systemie Linux jest wykorzystywane do sprawdzenia

Jakie składniki systemu komputerowego wymagają utylizacji w wyspecjalizowanych zakładach przetwarzania z powodu obecności niebezpiecznych substancji lub pierwiastków chemicznych?

Napięcie dostarczane przez płytę główną dla pamięci typu SDRAM DDR3 może wynosić

Ile sieci obejmują komputery z adresami IP przedstawionymi w tabeli oraz standardową maską sieci?

| Komputer 1 | 172.16.15.5 |

| Komputer 2 | 172.18.15.6 |

| Komputer 3 | 172.18.16.7 |

| Komputer 4 | 172.20.16.8 |

| Komputer 5 | 172.20.16.9 |

| Komputer 6 | 172.21.15.10 |

Diagnostykę systemu Linux można przeprowadzić za pomocą komendy

| Thread(s) per core: | 1 |

| Core(s) per socket: | 4 |

| Socket(s): | 1 |

| NUMA node(s): | 1 |

Administrator pragnie udostępnić w sieci folder C:instrukcje trzem użytkownikom z grupy Serwisanci. Jakie rozwiązanie powinien wybrać?

Jakie są poszczególne elementy adresu globalnego IPv6 typu unicast pokazane na ilustracji?

| IPv6 | ||

|---|---|---|

| 1 | 2 | 3 |

| 48 bitów | 16 bitów | 64 bity |

W jakiej usłudze wykorzystywany jest protokół RDP?

Narzędzie systemu Windows wykorzystywane do interpretacji poleceń, stosujące logikę obiektową oraz cmdlety, to

Użytkownicy sieci Wi-Fi zauważyli zakłócenia oraz częste przerwy w połączeniu. Przyczyną tej sytuacji może być

Komunikat tekstowy KB/Interface error, wyświetlony na ekranie komputera z BIOS POST firmy AMI, informuje o błędzie

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można stwierdzić, że pamięć ta