Pytanie 1

Jakie urządzenie powinno się zastosować do pomiaru topologii okablowania strukturalnego w sieci lokalnej?

Wynik: 31/40 punktów (77,5%)

Wymagane minimum: 20 punktów (50%)

Jakie urządzenie powinno się zastosować do pomiaru topologii okablowania strukturalnego w sieci lokalnej?

Jakie parametry mierzy watomierz?

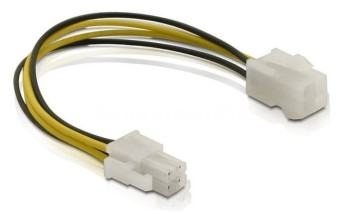

Wskaż złącze, które należy wykorzystać do podłączenia wentylatora, którego parametry przedstawiono w tabeli.

| Wymiar radiatora | 123 x 133 x 163 mm |

| Wentylator | 120 mm + 135 mm |

| Złącze | 4-pin PWM |

| Napięcie zasilające | 12V |

| Żywotność | 300 000h |

Jakie oprogramowanie jest wykorzystywane do kontrolowania stanu dysków twardych?

Moc zasilacza wynosi 450 W, co oznacza, że

Mamy do czynienia z siecią o adresie 192.168.100.0/24. Ile podsieci można utworzyć, stosując maskę 255.255.255.224?

Gdy użytkownik zauważy, że ważne pliki zniknęły z dysku twardego, powinien

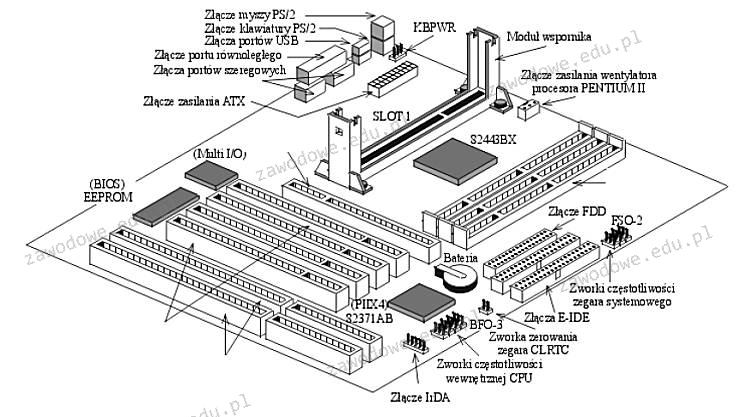

Wskaż procesor współpracujący z przedstawioną płytą główną.

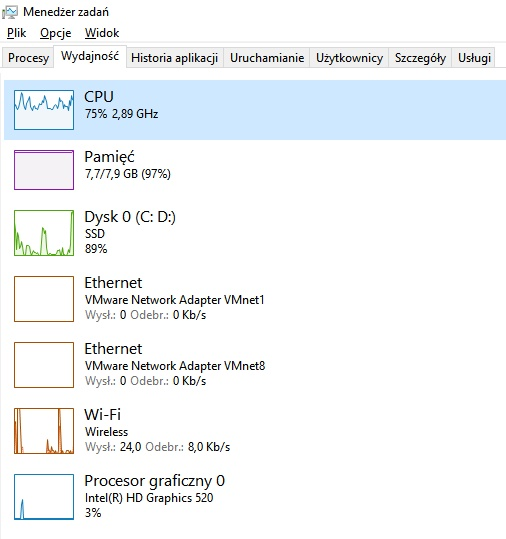

Informacja zawarta na ilustracji może wskazywać na

Planując prace modernizacyjne komputera przenośnego, związane z wymianą procesora, należy w pierwszej kolejności

Jaką pamięć RAM można użyć z płytą główną GIGABYTE GA-X99-ULTRA GAMING/ X99/ 8x DDR4 2133, ECC, obsługującą maksymalnie 128GB, 4x PCI-E 16x, RAID, USB 3.1, S-2011-V3/ATX?

Która z poniższych czynności konserwacyjnych jest specyficzna tylko dla drukarki laserowej?

Jaki jest maksymalny transfer danych napędu CD przy prędkości x42?

Dwie stacje robocze w tej samej sieci nie są w stanie się skomunikować. Która z poniższych okoliczności może być przyczyną opisanego problemu?

Jakie komponenty są obecne na zaprezentowanej płycie głównej?

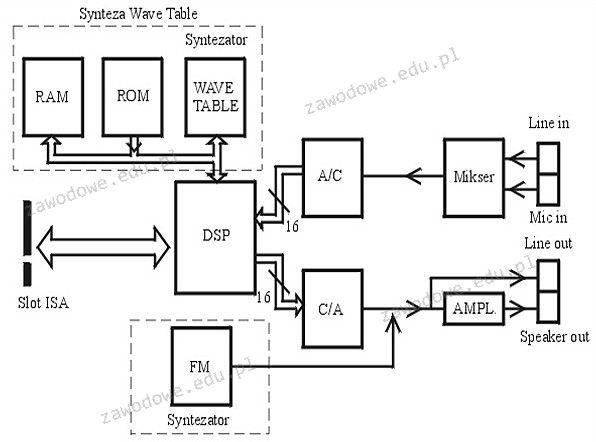

Na rysunku ukazano diagram

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

W załączonej ramce przedstawiono opis technologii

| Technologia ta to rewolucyjna i nowatorska platforma, która pozwala na inteligentne skalowanie wydajności podsystemu graficznego poprzez łączenie mocy kilku kart graficznych NVIDIA pracujących na płycie głównej. Dzięki wykorzystaniu zastrzeżonych algorytmów oraz wbudowanej w każdy z procesorów graficznych NVIDIA dedykowanej logiki sterującej, która odpowiada za skalowanie wydajności, technologia ta zapewnia do 2 razy (w przypadku dwóch kart) lub 2,8 razy (w przypadku trzech kart) wyższą wydajność niż w przypadku korzystania z pojedynczej karty graficznej. |

Aby kontrolować ilość transferu w sieci, administrator powinien zastosować program rodzaju

Przedstawiony panel tylny płyty głównej jest wyposażony między innymi w interfejsy:

Natychmiast po dostrzeżeniu utraty istotnych plików na dysku twardym, użytkownik powinien

Poprzez użycie opisanego urządzenia możliwe jest wykonanie diagnostyki działania

Jeśli podczas podłączania stacji dysków elastycznych 1,44 MB kabel sygnałowy zostanie włożony odwrotnie, to

Jakie będą łączne wydatki na wymianę karty graficznej w komputerze, jeżeli nowa karta kosztuje 250 zł, czas wymiany wynosi 80 minut, a każda rozpoczęta robocza godzina to koszt 50 zł?

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

W komunikacie o błędzie w systemie, informacja przedstawiana w formacie heksadecymalnym oznacza

Jeżeli podczas uruchamiania systemu BIOS od AWARD komputer wydał długi sygnał oraz dwa krótkie, co to oznacza?

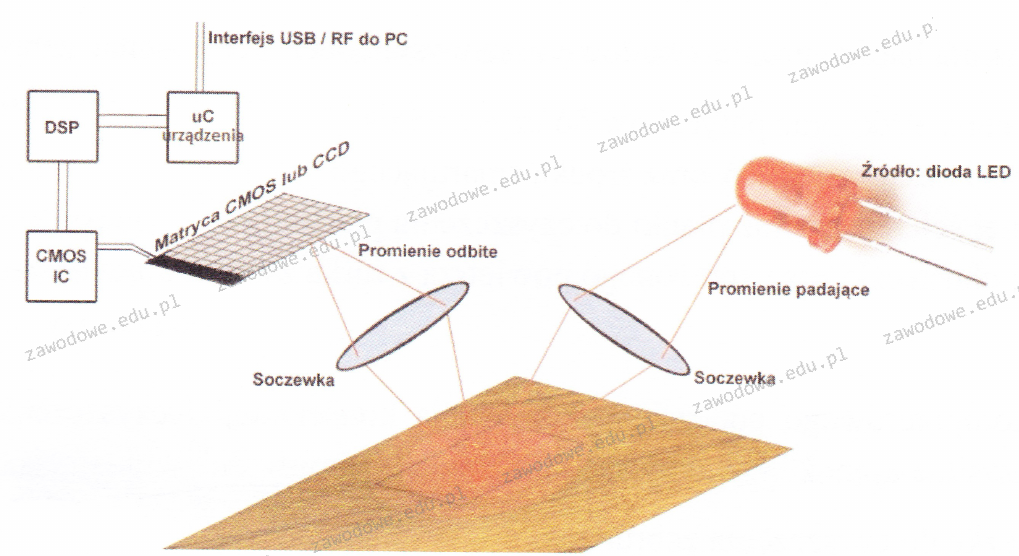

Na ilustracji zaprezentowano schemat działania

Rzeczywistą kalibrację sprzętową monitora można wykonać

Po podłączeniu działającej klawiatury do jednego z portów USB nie ma możliwości wybrania awaryjnego trybu uruchamiania systemu Windows. Mimo to klawiatura działa prawidłowo po uruchomieniu systemu w standardowym trybie. Co to sugeruje?

Na wyświetlaczu drukarki pojawił się komunikat „PAPER JAM”. Aby usunąć usterkę, należy w pierwszej kolejności

Urządzenie pokazane na ilustracji ma na celu

Zastosowanie symulacji stanów logicznych w obwodach cyfrowych pozwala na

Przy pomocy testów statycznych okablowania można zidentyfikować

Który z parametrów okablowania strukturalnego definiuje stosunek mocy sygnału tekstowego w jednej parze do mocy sygnału wyindukowanego w sąsiedniej parze na tym samym końcu kabla?

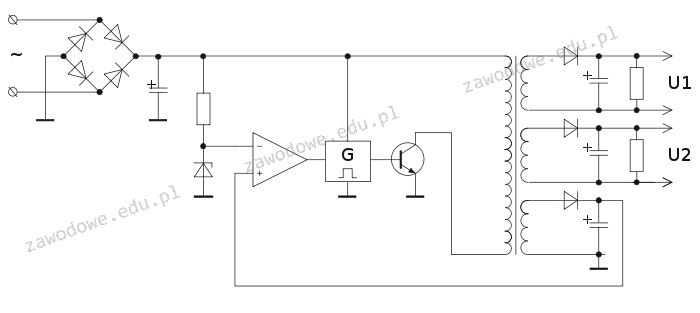

Zilustrowany schemat przedstawia zasadę funkcjonowania

W jakiej technologii produkcji projektorów stosowany jest system mikroskopijnych luster, przy czym każde z nich odpowiada jednemu pikselowi wyświetlanego obrazu?

Który z parametrów należy użyć w poleceniu netstat, aby uzyskać statystyki interfejsu sieciowego dotyczące liczby przesłanych oraz odebranych bajtów i pakietów?

Urządzenie przedstawione na ilustracji oraz jego dane techniczne mogą być użyte do pomiarów rodzaju okablowania

DB-25 służy jako złącze