Pytanie 1

Sprzęt sieciowy umożliwiający połączenie pięciu komputerów w tej samej sieci, minimalizując ryzyko kolizji pakietów, to

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Sprzęt sieciowy umożliwiający połączenie pięciu komputerów w tej samej sieci, minimalizując ryzyko kolizji pakietów, to

Jakim protokołem połączeniowym w warstwie transportowej, który zapewnia niezawodność dostarczania pakietów, jest protokół

W lokalnej sieci protokołem odpowiedzialnym za dynamiczną konfigurację adresów IP jest

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Według specyfikacji JEDEC, napięcie zasilania dla modułów pamięci RAM DDR3L wynosi

Użycie skrętki kategorii 6 (CAT 6) o długości 20 metrów w sieci LAN oznacza jej maksymalną przepustowość wynoszącą

W czterech różnych sklepach ten sam model komputera oferowany jest w różnych cenach. Gdzie można go kupić najtaniej?

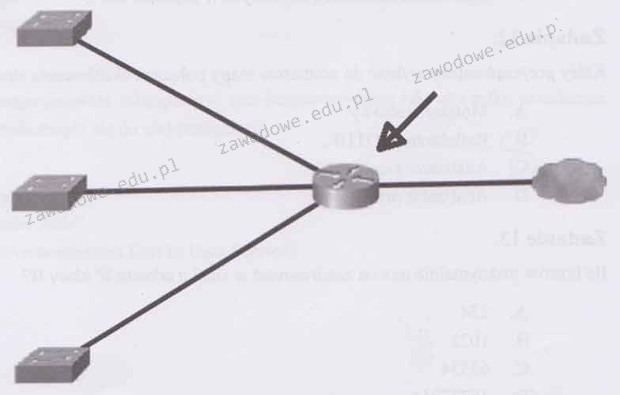

Którego urządzenia dotyczy strzałka na rysunku?

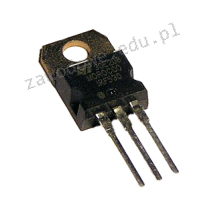

Element elektroniczny przedstawiony na ilustracji to:

Algorytm wykorzystywany do weryfikacji, czy ramka Ethernet jest wolna od błędów, to

Scandisk to narzędzie, które wykorzystuje się do

W której warstwie modelu ISO/OSI odbywa się segmentacja danych, komunikacja w trybie połączeniowym z użyciem protokołu TCP oraz komunikacja w trybie bezpołączeniowym z zastosowaniem UDP?

Adapter USB do LPT może być użyty w przypadku braku kompatybilności złączy podczas podłączania starszych urządzeń

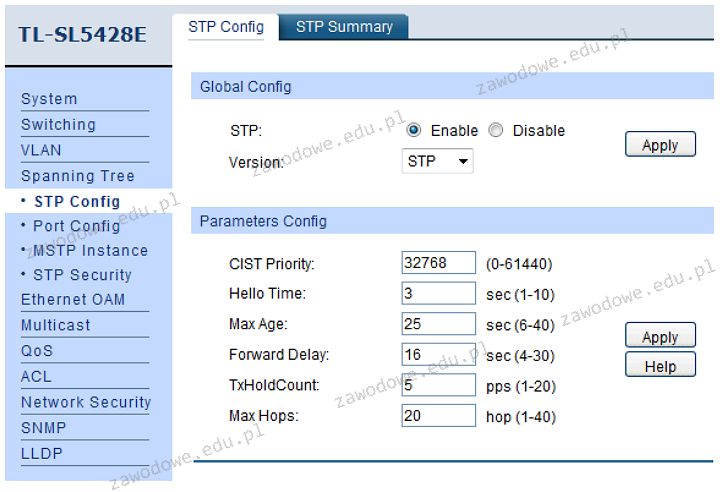

Analizując zrzut ekranu prezentujący ustawienia przełącznika, można zauważyć, że

Na zdjęciu widnieje

Menedżer urządzeń w systemie Windows pozwala na wykrycie

Podaj prefiks, który identyfikuje adresy globalne w protokole IPv6?

Na komputerze z zainstalowanymi systemami operacyjnymi Windows i Linux, po przeprowadzeniu reinstalacji systemu Windows, drugi system przestaje się uruchamiać. Aby przywrócić możliwość uruchamiania systemu Linux oraz zachować dane i ustawienia w nim zgromadzone, co należy zrobić?

Jaki sprzęt powinno się wybrać do pomiarów schematu okablowania strukturalnego sieci lokalnej?

W tabeli zaprezentowano specyfikacje czterech twardych dysków. Dysk, który oferuje najwyższą średnią prędkość odczytu danych, to

| Pojemność | 320 GB | 320 GB | 320 GB | 320 GB |

| Liczba talerzy | 2 | 3 | 2 | 2 |

| Liczba głowic | 4 | 6 | 4 | 4 |

| Prędkość obrotowa | 7200 obr./min | 7200 obr./min | 7200 obr./min | 7200 obr./min |

| Pamięć podręczna | 16 MB | 16 MB | 16 MB | 16 MB |

| Czas dostępu | 8.3 ms | 8.9 ms | 8.5 ms | 8.6 ms |

| Interfejs | SATA II | SATA II | SATA II | SATA II |

| Obsługa NCQ | TAK | NIE | TAK | TAK |

| Dysk | A. | B. | C. | D. |

Która topologia fizyczna umożliwia nadmiarowe połączenia pomiędzy urządzeniami w sieci?

Wykonując polecenie ipconfig /flushdns, można przeprowadzić konserwację urządzenia sieciowego, która polega na

Jaką funkcjonalność oferuje program tar?

Główną metodą ochrony sieci komputerowej przed zewnętrznymi atakami jest wykorzystanie

Medium transmisyjne, które jest odporne na zakłócenia elektromagnetyczne i atmosferyczne, to

Jakim poleceniem w systemie Linux można ustalić trasę pakietu do celu?

Po zainstalowaniu aplikacji VNC, używanej do obserwacji pulpitu konkretnego komputera, oprócz numeru portu należy wskazać jego

Aby utworzyć programową macierz RAID-1, potrzebne jest minimum

Adres IP serwera, na którym znajduje się domena www.wp.pl to 212.77.98.9. Jakie mogą być przyczyny sytuacji przedstawionej na zrzucie ekranu?

C:\>ping 212.77.98.9

Pinging 212.77.98.9 with 32 bytes of data:

Reply from 212.77.98.9: bytes=32 time=7ms TTL=55

Reply from 212.77.98.9: bytes=32 time=7ms TTL=55

Reply from 212.77.98.9: bytes=32 time=8ms TTL=55

Reply from 212.77.98.9: bytes=32 time=7ms TTL=55

Ping statistics for 212.77.98.9:

Packets: Sent = 4, Received = 4, Lost = 0 (0% loss),

Approximate round trip times in milli-seconds:

Minimum = 7ms, Maximum = 11ms, Average = 8ms

C:\>ping wp.pl

Ping request could not find host wp.pl. Please

check the name and try again.

Jednym z metod ograniczenia dostępu do sieci bezprzewodowej dla osób nieuprawnionych jest

Thunderbolt stanowi interfejs

Na ilustracji ukazano narzędzie systemu Windows 7 służące do

Na zdjęciu widać

Protokół trasowania wewnętrznego, który opiera się na analizie stanu łącza, to

Jakie polecenie używa się do tworzenia kopii danych na pamięci USB w systemie Linux?

Do usunięcia elementu Wszystkie programy z prostego Menu Start systemu Windows należy wykorzystać przystawkę

Za przydzielanie czasu procesora do konkretnych zadań odpowiada

Jaki rezultat uzyskamy po wykonaniu odejmowania dwóch liczb heksadecymalnych 60A (h) - 3BF (h)?

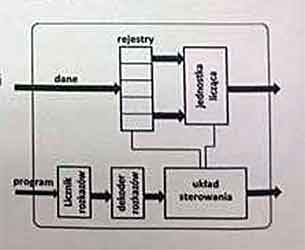

Rejestry widoczne na diagramie procesora mają rolę

Urządzenie, które pozwala komputerom na bezprzewodowe łączenie się z siecią komputerową przewodową, to