Pytanie 1

Urządzenie pokazane na ilustracji ma na celu

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Urządzenie pokazane na ilustracji ma na celu

Dostarczanie błędnych napięć do płyty głównej może spowodować

Niekorzystną właściwością macierzy RAID 0 jest

Którego wbudowanego narzędzia w systemie Windows 8 Pro można użyć do szyfrowania danych?

Obrazek ilustruje rezultat działania programu

│ ├── Checkbox_checked.svg │ └── Checkbox_unchecked.svg │ ├── revisions.txt │ ├── tools │ │ ├── howto.txt │ │ ├── Mangler │ │ │ ├── make.sh │ │ │ └── src │ │ │ └── Mangler.java │ │ └── WiFi101 │ │ ├── tool │ │ │ └── firmwares │ │ │ ├── 19.4.4 │ │ │ │ ├── m2m_aio_2b0.bin │ │ │ │ └── m2m_aio_3a0.bin │ │ │ └── 19.5.2 │ │ │ └── m2m_aio_3a0.bin │ │ └── WiFi101.jar │ ├── tools-builder │ │ └── ctags │ │ └── 5.8-arduino11 │ │ └── ctags │ └── uninstall.sh └── brother └── PTouch └── ql570 └── cupswrapper ├── brcupsconfpt1 └── cupswrapperql570pt1

Aby przywrócić dane z sformatowanego dysku twardego, konieczne jest zastosowanie programu

Jaką maksymalną liczbę podstawowych partycji na dysku twardym z tablicą MBR można utworzyć za pomocą narzędzia Zarządzanie dyskami dostępnego w systemie Windows?

Wskaż błędny podział dysku MBR na partycje?

Jakie polecenie należy wykorzystać, aby zmienić właściciela pliku w systemie Linux?

Kluczowe znaczenie przy tworzeniu stacji roboczej dla wielu wirtualnych maszyn ma

W cenniku usług komputerowych znajdują się przedstawione niżej zapisy. Ile będzie wynosił koszt dojazdu serwisanta do klienta mieszkającego poza miastem, w odległości 15 km od siedziby firmy?

Dojazd do klienta na terenie miasta - 25 zł netto

Dojazd do klienta poza miastem - 2 zł netto za każdy km odległości od siedziby firmy liczony w obie strony.

Jakie protokoły pełnią rolę w warstwie transportowej modelu ISO/OSI?

Jaki akronim oznacza wydajność sieci oraz usługi, które mają na celu między innymi priorytetyzację przesyłanych pakietów?

Jaką standardową wartość maksymalnej odległości można zastosować pomiędzy urządzeniami sieciowymi, które są ze sobą połączone przewodem UTP kat.5e?

Pierwsze trzy bity adresu IP w formacie binarnym mają wartość 010. Jaką klasę reprezentuje ten adres?

Który adres IP jest najwyższy w sieci 196.10.20.0/26?

Który z poniższych adresów należy do klasy B?

Norma EN 50167 odnosi się do rodzaju okablowania

W sieci z maską 255.255.255.128 można przypisać adresy dla

Wskaż koszt brutto wykonanych przez serwisanta usług, jeśli do rachunku doliczony jest również koszt dojazdu w wysokości 55,00 zł netto.

| LP | Wykonana usługa | Cena usługi netto w zł | Stawka podatku VAT |

|---|---|---|---|

| 1. | Instalacja/ konfiguracja programu | 10,00 | 23% |

| 2. | Wymiana zasilacza | 40,00 | |

| 3. | Tworzenie kopii zapasowej i archiwizacja danych | 40,00 | |

| 4. | Konfiguracja przełącznika | 25,00 | |

| 5. | Instalacja i konfiguracja skanera | 45,00 |

Serwisant zrealizował w ramach zlecenia działania przedstawione w poniższej tabeli. Całkowity koszt zlecenia obejmuje wartość usług wymienionych w tabeli oraz koszt pracy serwisanta, którego stawka za godzinę wynosi 60,00 zł netto. Oblicz całkowity koszt zlecenia brutto. Stawka VAT na usługi wynosi 23%.

| LP | Czynność | Czas wykonania w minutach | Cena usługi netto w zł |

|---|---|---|---|

| 1. | Instalacja i konfiguracja programu | 35 | 20,00 |

| 2. | Wymiana płyty głównej | 80 | 50,00 |

| 3. | Wymiana karty graficznej | 30 | 25,00 |

| 4. | Tworzenie kopii zapasowej i archiwizacja danych | 65 | 45,00 |

| 5. | Konfiguracja rutera | 30 | 20,00 |

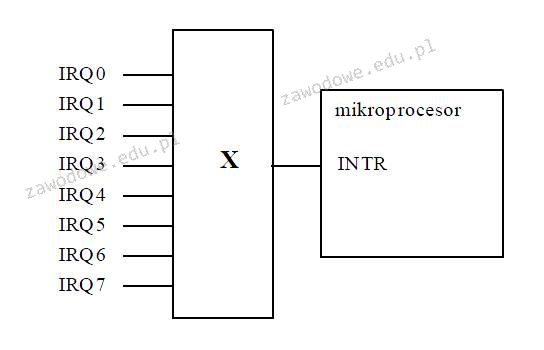

Na podstawie nazw sygnałów sterujących zidentyfikuj funkcję komponentu komputera oznaczonego na schemacie symbolem X?

Jakim protokołem łączności, który gwarantuje pewne dostarczenie informacji, jest protokół

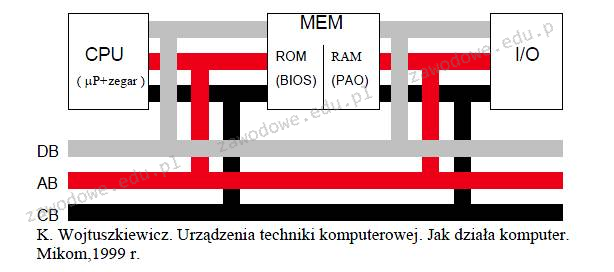

Który z komponentów komputera, gdy zasilanie jest wyłączone, zachowuje program inicjujący uruchamianie systemu operacyjnego?

Urządzenie trwale zainstalowane u abonenta, które zawiera zakończenie poziomego okablowania strukturalnego, to

Jakim sposobem zapisuje się dane na nośnikach BD-R?

W architekturze ISO/OSI protokoły TCP oraz UDP funkcjonują w warstwie

Najmniejszy czas dostępu charakteryzuje się

Wydruk z drukarki igłowej realizowany jest z zastosowaniem zestawu stalowych igieł w liczbie

Urządzenie przedstawione na rysunku

Jakie urządzenie stosuje się do pomiaru rezystancji?

Na podstawie specyfikacji płyty głównej przedstawionej w tabeli, wskaż największą liczbę kart rozszerzeń, które mogą być podłączone do magistrali Peripheral Component Interconnect?

| BIOS Type | AWARD |

| BIOS Version | 1.8 |

| Memory Sockets | 3 |

| Expansion Slots | 1 AGP/5 PCI |

| AGP 8X | Yes |

| AGP Pro | No |

| NorthbridgeCooling Fan | Yes |

| Northbridge | nForce2 SPP |

| Southbridge | nForce2 MCP-T |

| FSB Speeds | 100-300 1 MHz |

| MultiplierSelection | Yes – BIOS |

| CoreVoltages | 1.1V-2.3V |

| DDR Voltages | 2.5V-2.9V |

| AGP Voltages | 1.5V-1.8V |

| Chipset Voltages | 1.4V-1.7V |

| AGP/PCI Divider in BIOS | Yes (AGP) |

Która z warstw modelu ISO/OSI ma związek z protokołem IP?

Aby zapobiec uszkodzeniu układów scalonych, podczas konserwacji sprzętu komputerowego należy używać

Na przedstawionym schemacie urządzeniem, które łączy komputery, jest

Interfejs UDMA to typ interfejsu

Według normy JEDEC, standardowe napięcie zasilające dla modułów pamięci RAM DDR3L o niskim napięciu wynosi

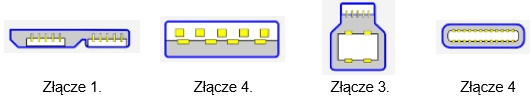

Do podłączenia projektora multimedialnego do komputera, nie można użyć złącza

Użytkownik zamierza zmodernizować swój komputer zwiększając ilość pamięci RAM. Zainstalowana płyta główna ma parametry przedstawione w tabeli. Wybierając dodatkowe moduły pamięci, powinien pamiętać, aby

| Parametry płyty głównej | |

|---|---|

| Model | H97 Pro4 |

| Typ gniazda procesora | Socket LGA 1150 |

| Obsługiwane procesory | Intel Core i7, Intel Core i5, Intel Core i3, Intel Pentium, Intel Celeron |

| Chipset | Intel H97 |

| Pamięć | 4 x DDR3- 1600 / 1333/ 1066 MHz, max 32 GB, ECC, niebuforowana |

| Porty kart rozszerzeń | 1 x PCI Express 3.0 x16, 3 x PCI Express x1, 2 x PCI |

Wskaż kształt złącza USB typu C.