Pytanie 1

Funkcja diff w systemie Linux pozwala na

Wynik: 8/40 punktów (20,0%)

Wymagane minimum: 20 punktów (50%)

Funkcja diff w systemie Linux pozwala na

W systemie Linux, polecenie usermod -s dla danego użytkownika umożliwia

Czym jest parametr, który określa, o ile moc sygnału w danej parze przewodów zmniejszy się po przejściu przez cały tor kablowy?

Technologia procesorów serii Intel Core stosowana w modelach i5, i7 oraz i9, pozwalająca na zwiększenie taktowania w przypadku gdy komputer potrzebuje wyższej mocy obliczeniowej, to

Switch sieciowy w standardzie Fast Ethernet pozwala na przesył danych z maksymalną prędkością

Literowym symbolem P oznacza się

Które zestawienie: urządzenie - funkcja, którą pełni, jest niepoprawne?

Element płyty głównej odpowiedzialny za wymianę danych między mikroprocesorem a pamięcią operacyjną RAM oraz magistralą karty graficznej jest na rysunku oznaczony numerem

Komputer jest połączony z siecią Internetową i nie posiada zainstalowanego oprogramowania antywirusowego. Jak można sprawdzić, czy ten komputer jest zainfekowany wirusem, nie wchodząc w ustawienia systemowe?

Funkcja narzędzia tracert w systemach Windows polega na

Użytkownik chce zabezpieczyć mechanicznie dane na karcie pamięci przed przypadkowym skasowaniem. Takie zabezpieczenie umożliwia karta

W którym systemie operacyjnym może pojawić się komunikat podczas instalacji sterowników dla nowego urządzenia?

| System.......nie może zweryfikować wydawcy tego sterownika. Ten sterownik nie ma podpisu cyfrowego albo podpis nie został zweryfikowany przez urząd certyfikacji. Nie należy instalować tego sterownika, jeżeli nie pochodzi z oryginalnego dysku producenta lub od administratora systemu. |

Na rysunku można zobaczyć schemat topologii fizycznej, która jest kombinacją topologii

Osoba odpowiedzialna za zarządzanie siecią komputerową pragnie ustalić, jakie połączenia są aktualnie nawiązywane na komputerze z systemem operacyjnym Windows oraz które porty są wykorzystywane do nasłuchu. W tym celu powinna użyć polecenia

Podczas wyboru zasilacza do komputera kluczowe znaczenie

W przypadku dysku twardego, w jakiej jednostce wyrażana jest wartość współczynnika MTBF (Mean Time Between Failure)?

Jakie oznaczenie na schematach sieci LAN przypisuje się punktom rozdzielczym dystrybucyjnym znajdującym się na różnych kondygnacjach budynku według normy PN-EN 50173?

Jaką maskę trzeba zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

Zgodnie z przedstawionymi zaleceniami dla drukarki atramentowej, kolorowe dokumenty powinny być drukowane przynajmniej

„Czyszczenie głowicy drukarki …. ….. W tym przypadku najskuteczniejszym rozwiązaniem jest wyczyszczenie głowicy drukarki z zaschniętego tuszu. Z reguły wystarcza przetarcie głównego źródła problemu wilgotnym ręcznikiem. Jeżeli to nie pomoże należy zassać tusz do dysz, co pozwoli usunąć z nich powietrze. ….. Kiedy również i to nie pomoże należy przejść do ręcznego czyszczenia głowicy. Drukarka….. powinna być wyłączana na noc, ponieważ po każdym włączeniu przeprowadzane są mini cykle czyszczenia. Warto również pamiętać o wydrukowaniu przynajmniej raz w tygodniu kolorowego dokumentu, dzięki czemu zminimalizujemy prawdopodobieństwo zaschnięcia tuszu." Fragment instrukcji czyszczenia drukarki |

Osobom pracującym zdalnie, dostęp do serwera znajdującego się w prywatnej sieci za pośrednictwem publicznej infrastruktury, jaką jest Internet, umożliwia

Do czego służy program firewall?

Na którym z zewnętrznych nośników danych nie dojdzie do przeniknięcia wirusa podczas przeglądania jego zawartości?

Który typ profilu użytkownika zmienia się i jest zapisywany na serwerze dla klienta działającego w sieci Windows?

Wskaż komponent, który nie jest zgodny z płytą główną o parametrach przedstawionych w tabeli

| Podzespół | Parametry |

|---|---|

| Płyta główna GIGABYTE | 4x DDR4, 4x PCI-E 16x, RAID, HDMI, D-Port, D-SUB, 2x USB 3.1, 8 x USB 2.0, S-AM3+ |

Aby utworzyć kolejną partycję w systemie Windows, można skorzystać z narzędzia

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Które z urządzeń nie powinno być serwisowane podczas korzystania z urządzeń antystatycznych?

Wynikiem przeprowadzenia polecenia arp -a 192.168.1.1 w systemie MS Windows jest pokazanie

Jakie ustawienie należy wprowadzić przy konfiguracji serwera DHCP?

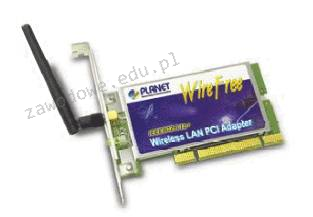

Na przedstawionym zdjęciu widoczna jest

W trakcie instalacji systemu Windows, zaraz po rozpoczęciu instalacji w trybie graficznym, istnieje możliwość otwarcia Wiersza poleceń (konsoli) za pomocą kombinacji klawiszy

Wskaż program do składu publikacji

Programem służącym do archiwizacji danych w systemie Linux jest

Jakie urządzenie należy zastosować do pomiaru mocy zużywanej przez komputer?

Norma EN 50167 odnosi się do rodzaju okablowania

Najbardziej rozwinięty tryb funkcjonowania portu równoległego zgodnego z normą IEEE-1284, który tworzy dwukierunkową szeregę 8-bitową zdolną do przesyłania zarówno danych, jak i adresów z maksymalną prędkością transmisji wynoszącą 2,3 MB/s oraz umożliwia podłączenie do 64 urządzeń, to

W skład sieci komputerowej wchodzi 3 komputery stacjonarne oraz drukarka sieciowa, które są połączone kablem UTP z routerem mającym porty 1 x WAN oraz 5 x LAN. Które urządzenie sieciowe pozwoli na dołączenie kablem UTP dwóch dodatkowych komputerów do tej sieci?

W systemie Linux, aby wyszukać wszystkie pliki z rozszerzeniem txt, które znajdują się w katalogu /home/user i zaczynają się na literę a lub literę b lub literę c, należy wydać polecenie

Rysunek obrazuje zasadę działania drukarki

Która przystawka MMC systemu Windows umożliwia przegląd systemowego Dziennika zdarzeń?