Pytanie 1

Licencja Windows OEM nie umożliwia wymiany

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Licencja Windows OEM nie umożliwia wymiany

Aby utworzyć obraz dysku twardego, można skorzystać z programu

Przypisanie licencji oprogramowania do pojedynczego komputera lub jego komponentów stanowi charakterystykę licencji

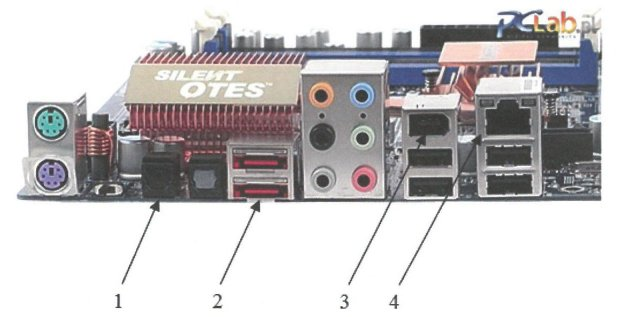

Który z portów na pokazanej płycie głównej pozwala na podłączenie zewnętrznego dysku za pośrednictwem interfejsu e-SATA?

Karta rozszerzeń przedstawiona na ilustracji może być zainstalowana w komputerze, jeśli na płycie głównej znajduje się przynajmniej jeden dostępny slot

W jednostce ALU do rejestru akumulatora wprowadzono liczbę dziesiętną 600. Jak wygląda jej reprezentacja w systemie binarnym?

Na stabilność obrazu w monitorach CRT istotny wpływ ma

Wskaż rysunek ilustrujący symbol używany do oznaczania portu równoległego LPT?

Która struktura partycji pozwala na stworzenie do 128 partycji podstawowych na pojedynczym dysku?

Na zdjęciu ukazano złącze zasilające

Toner stanowi materiał eksploatacyjny w drukarce

Która z grup w systemie Windows Server ma najniższe uprawnienia?

Jaką usługę wykorzystuje się do automatycznego przypisywania adresów IP do komputerów w sieci?

Jakim protokołem jest realizowana kontrola poprawności transmisji danych w sieciach Ethernet?

Aby komputery mogły udostępniać swoje zasoby w sieci, muszą mieć przypisane różne

Które z wymienionych mediów nie jest odpowiednie do przesyłania danych teleinformatycznych?

Aby zapewnić użytkownikom Active Directory możliwość logowania oraz dostęp do zasobów tej usługi w sytuacji awarii kontrolera domeny, co należy zrobić?

Obniżenie ilości jedynek w masce pozwala na zaadresowanie

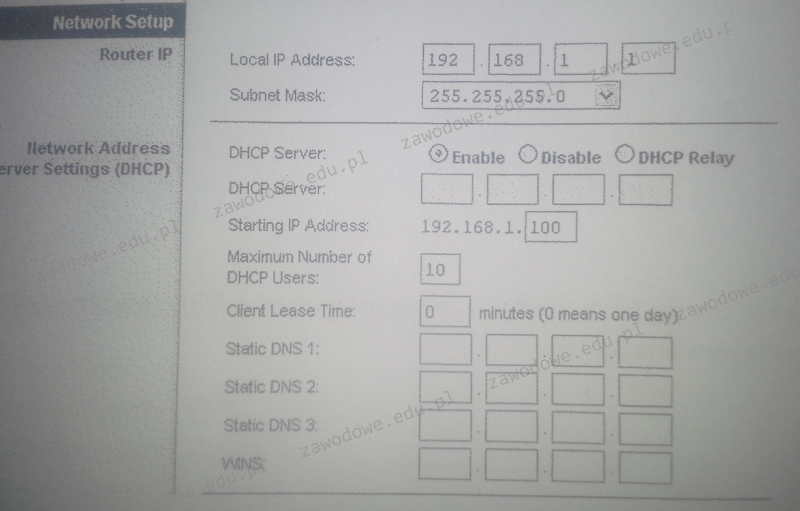

Na przedstawionym zrzucie panelu ustawień rutera można zauważyć, że serwer DHCP

Jakie narzędzie w systemie Linux pozwala na wyświetlenie danych o sprzęcie zapisanych w BIOS?

System operacyjny został poddany atakowi przez oprogramowanie szpiegujące. Po usunięciu problemów, aby zapobiec przyszłym atakom, należy

Które z poniższych stwierdzeń jest prawdziwe w odniesieniu do przedstawionej konfiguracji serwisu DHCP w systemie Linux?

Protokół trasowania wewnętrznego, który opiera się na analizie stanu łącza, to

SuperPi to aplikacja używana do oceniania

Udostępniono w sieci lokalnej jako udział specjalny folder o nazwie egzamin znajdujący się na komputerze o nazwie SERWER_2 w katalogu głównym dysku C:. Jak powinna wyglądać ścieżka dostępu do katalogu egzamin, w którym przechowywany jest folder macierzysty dla konta użytkownika o określonym loginie?

Po podłączeniu działającej klawiatury do któregokolwiek z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Jednakże, klawiatura funkcjonuje prawidłowo po uruchomieniu systemu w standardowym trybie. Co to sugeruje?

Przy zmianach w rejestrze Windows w celu zapewnienia bezpieczeństwa należy najpierw

Zintegrowana karta sieciowa na płycie głównej uległa awarii. Komputer nie może załadować systemu operacyjnego, ponieważ brakuje zarówno dysku twardego, jak i napędów optycznych, a system operacyjny jest uruchamiany z lokalnej sieci. W celu przywrócenia utraconej funkcjonalności, należy zainstalować w komputerze

Jakie oprogramowanie jest wykorzystywane do kontrolowania stanu dysków twardych?

Program do diagnostyki komputera pokazał komunikat NIC ERROR. Co oznacza ten komunikat w kontekście uszkodzenia karty?

Tryb działania portu równoległego, oparty na magistrali ISA, pozwalający na transfer danych do 2.4 MB/s, przeznaczony dla skanerów i urządzeń wielofunkcyjnych, to

Wskaź, który symbol towarowy może wykorzystywać producent finansujący działalność systemu zbierania oraz recyklingu odpadów?

Narzędzie służące do oceny wydajności systemu komputerowego to

Jakie oprogramowanie do wirtualizacji jest dostępne jako rola w systemie Windows Server 2012?

Farad to jednostka

Na zdjęciu widać kartę

Okablowanie wertykalne w sieci strukturalnej łączy

Jaką maskę trzeba zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

Na podstawie oznaczenia pamięci DDR3 PC3-16000 można stwierdzić, że pamięć ta

Którego polecenia należy użyć, aby w ruterze skonfigurować trasę statyczną dla adresu następnego skoku 192.168.1.1?