Pytanie 1

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

Według modelu TCP/IP protokoły DNS, FTP i SMTP są przypisane do warstwy

Proces, który uniemożliwia całkowicie odzyskanie danych z dysku twardego, to

Który adres IP posiada maskę w postaci pełnej, zgodną z klasą adresu?

Na którym standardowym porcie funkcjonuje serwer WWW wykorzystujący domyślny protokół HTTPS w typowym ustawieniu?

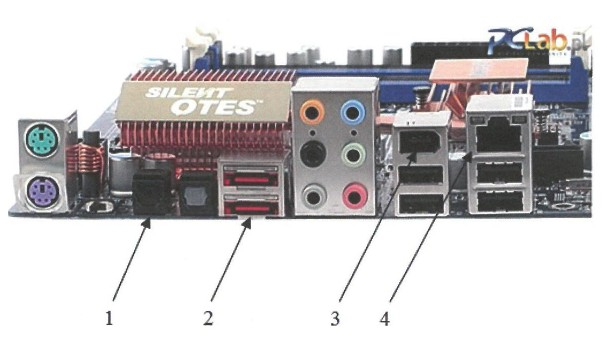

Który z portów na zaprezentowanej płycie głównej umożliwia podłączenie zewnętrznego dysku przez interfejs e-SATA?

Jakie elementy łączy okablowanie pionowe w sieci LAN?

Aby w systemie Linux wykonać kopię zapasową określonych plików, należy wprowadzić w terminalu polecenie programu

Do konwersji kodu źródłowego na program wykonywalny używany jest

Na zdjęciu widać

W nowoczesnych ekranach dotykowych działanie ekranu jest zapewniane przez mechanizm, który wykrywa zmianę

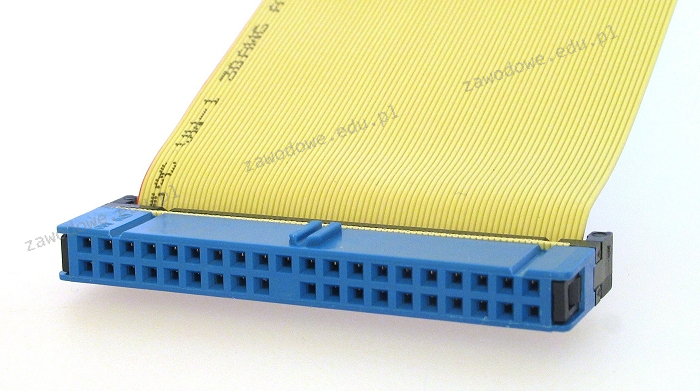

Na ilustracji przedstawiono taśmę (kabel) złącza

Ile pinów znajduje się w wtyczce SATA?

Jaka wartość dziesiętna została zapisana na jednym bajcie w kodzie znak – moduł: 1 1111111?

W jaki sposób skonfigurować zaporę Windows, aby spełniała zasady bezpieczeństwa i umożliwiała użycie polecenia ping do weryfikacji komunikacji z innymi urządzeniami w sieci?

Cechą oprogramowania służącego do monitorowania zdarzeń metodą Out-Of-Band w urządzeniach sieciowych jest

Która lokalizacja umożliwia utworzenie kopii zapasowej dysku systemowego Windows 11?

Jakie jest oznaczenie sieci, w której funkcjonuje host o IP 10.10.10.6 klasy A?

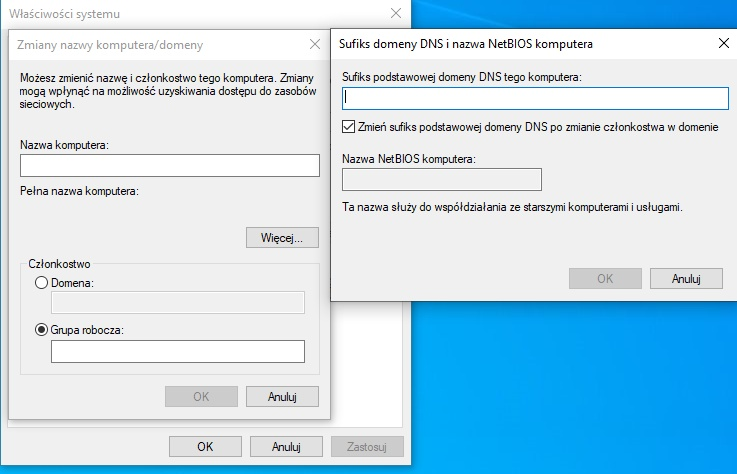

Aby podłączyć stację roboczą z zainstalowanym systemem Windows do domeny zst.local należy

Który rodzaj złącza nie występuje w instalacjach światłowodowych?

Jakie będą łączne wydatki na wymianę karty graficznej w komputerze, jeżeli nowa karta kosztuje 250 zł, czas wymiany wynosi 80 minut, a każda rozpoczęta robocza godzina to koszt 50 zł?

Osoba korzystająca z komputera udostępnia w sieci Internet pliki, które posiada. Prawa autorskie będą złamane, gdy udostępni

Jak ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie funkcjonować w dwóch sieciach lokalnych o różnych adresach IP?

Jakie jest główne zadanie systemu DNS w sieci komputerowej?

Interfejs HDMI w komputerze umożliwia przesyłanie sygnału

Jakie przyporządkowanie: urządzenie - funkcja, którą pełni, jest błędne?

Jak określa się w systemie Windows profil użytkownika, który jest tworzony przy pierwszym logowaniu do komputera i zapisywany na lokalnym dysku twardym, a wszelkie jego modyfikacje dotyczą tylko tego konkretnego komputera?

Chusteczki nasączone substancją o właściwościach antystatycznych służą do czyszczenia

W modelu RGB, kolor w systemie szesnastkowym przedstawia się w ten sposób: ABCDEF. Wartość natężenia koloru niebieskiego w tym zapisie odpowiada liczbie dziesiętnej

W jakiej topologii sieci fizycznej każdy komputer jest połączony z dokładnie dwoma sąsiadującymi komputerami, bez użycia dodatkowych urządzeń aktywnych?

Błąd typu STOP Error (Blue Screen) w systemie Windows, który wiąże się z odniesieniem się systemu do niepoprawnych danych w pamięci RAM, to

W systemie Windows XP, aby zmienić typ systemu plików z FAT32 na NTFS, należy użyć programu

Jakiej kategorii skrętka pozwala na przesył danych w zakresie częstotliwości nieprzekraczającym 100 MHz przy szybkości do 1 Gb/s?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

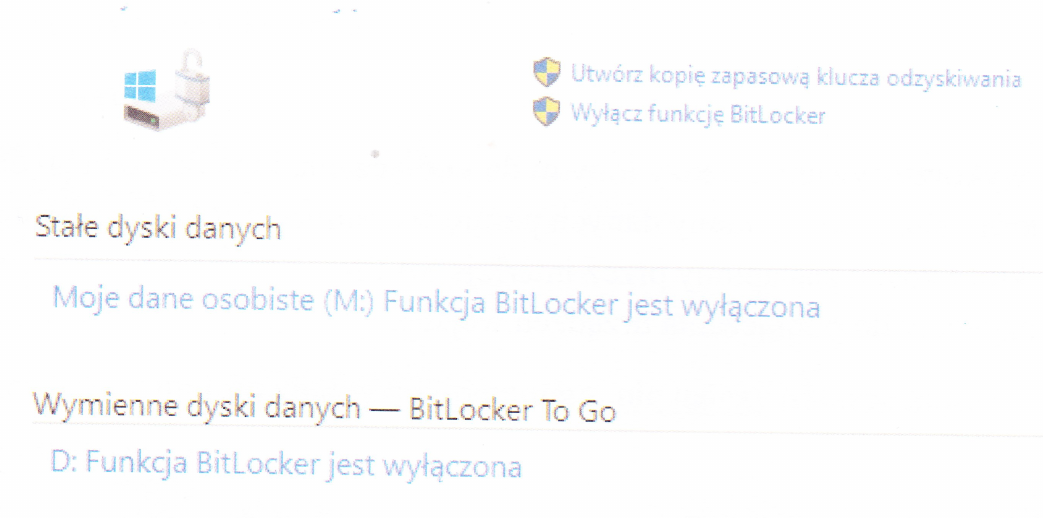

Wbudowane narzędzie dostępne w systemach Windows w edycji Enterprise lub Ultimate jest przeznaczone do

Jakie typy połączeń z Internetem mogą być współdzielone w sieci lokalnej?

Urządzenie, które zamienia otrzymane ramki na sygnały przesyłane w sieci komputerowej, to

W dokumentacji płyty głównej zapisano „Wsparcie dla S/PDIF Out”. Co to oznacza w kontekście tego modelu płyty głównej?

W jakiej topologii sieci komputerowej każdy węzeł ma bezpośrednie połączenie z każdym innym węzłem?

Jaki standard szyfrowania powinien być wybrany przy konfiguracji karty sieciowej, aby zabezpieczyć transmisję w sieci bezprzewodowej?