Pytanie 1

W systemie Linux narzędzie iptables jest wykorzystywane do

Wynik: 10/40 punktów (25,0%)

Wymagane minimum: 20 punktów (50%)

W systemie Linux narzędzie iptables jest wykorzystywane do

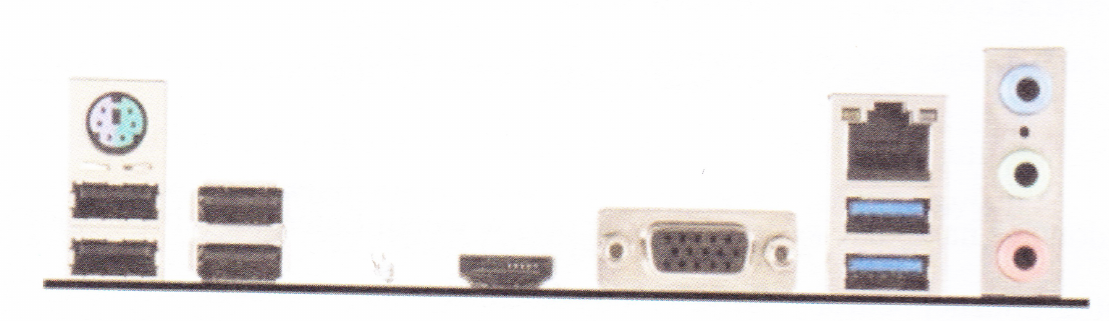

Zidentyfikuj interfejsy znajdujące się na panelu tylnym płyty głównej:

Na dysku obok systemu Windows zainstalowano system Linux Ubuntu. W celu dostosowania kolejności uruchamiania systemów operacyjnych, należy zmienić zawartość

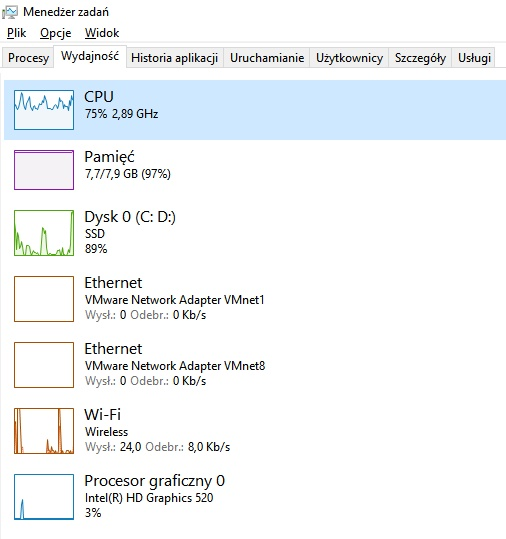

Grafik komputerowy sygnalizuje bardzo wolną pracę komputera. Z ilustracji przedstawiającej okno wydajności komputera wynika, że przyczyną tego może być

Jakiego typu rozbudowa serwera wymaga zainstalowania dodatkowych sterowników?

Które stwierdzenie opisuje profil tymczasowy użytkownika?

Które z metod szyfrowania wykorzystywanych w sieciach bezprzewodowych jest najsłabiej zabezpieczone przed łamaniem haseł?

Jaki protokół umożliwia terminalowe połączenie zdalne z urządzeniami, zapewniając przy tym transfer danych w sposób zaszyfrowany?

Najlepszą metodą ochrony danych przedsiębiorstwa, którego biura znajdują się w różnych, odległych miejscach, jest wdrożenie

Jakie oprogramowanie należy zainstalować, aby serwer Windows mógł obsługiwać usługi katalogowe?

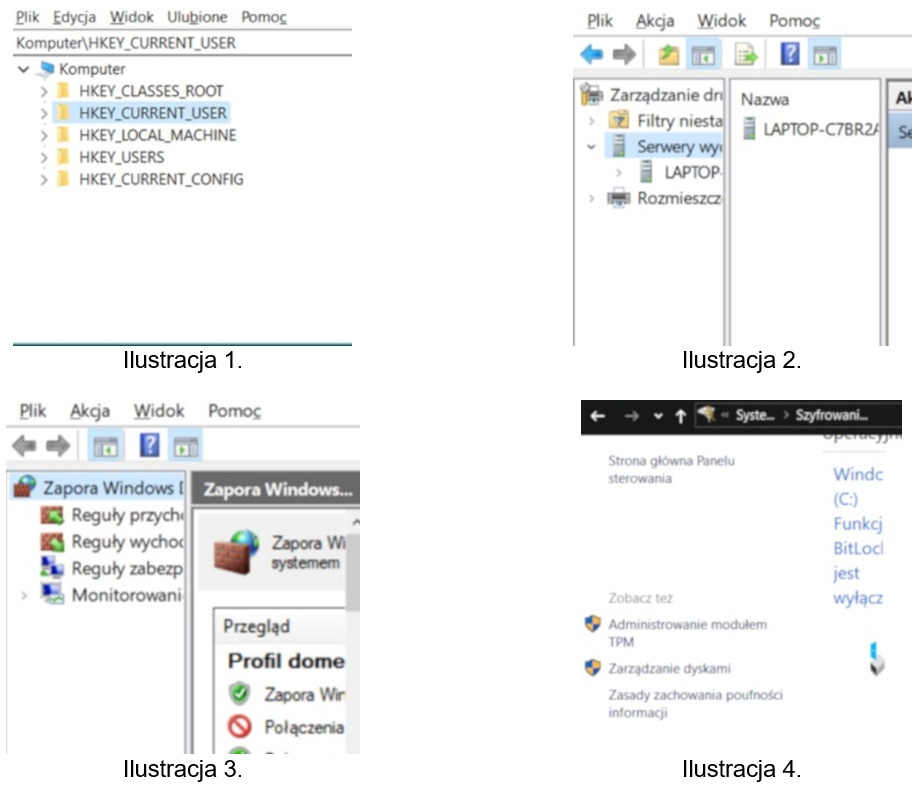

W systemie Windows aktualne ustawienia użytkownika komputera przechowywane są w gałęzi rejestru o skrócie

Aby po załadowaniu systemu Windows program Kalkulator uruchamiał się automatycznie, konieczne jest dokonanie ustawień

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Które z poniższych twierdzeń na temat protokołu DHCP jest poprawne?

Jakie urządzenie jest przedstawione na rysunku?

Na której ilustracji przedstawiono Edytor rejestru w systemie Windows?

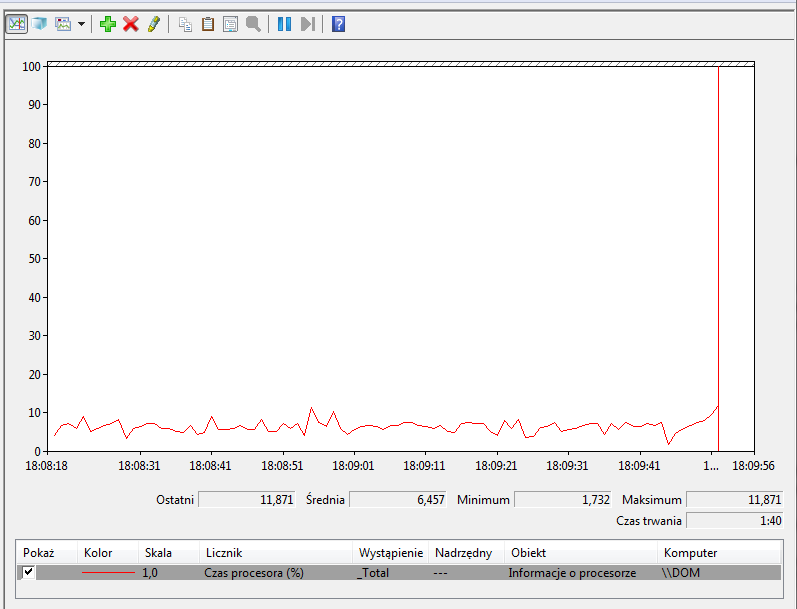

By uruchomić w systemie Windows oprogramowanie narzędziowe monitorujące wydajność komputera przedstawione na rysunku, należy uruchomić

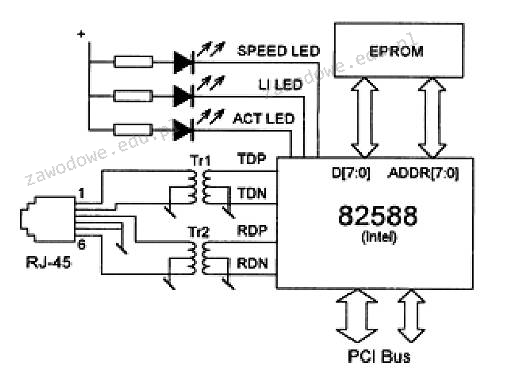

Jaką rolę pełnią elementy Tr1 i Tr2, które są widoczne na schemacie ilustrującym kartę sieciową Ethernet?

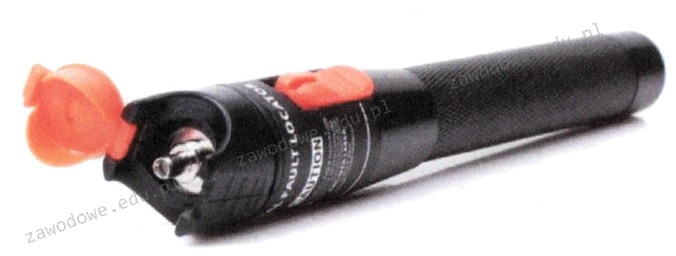

Zaprezentowane narzędzie jest wykorzystywane do

W systemie Windows 7 aby skopiować folder c:\test wraz z jego podfolderami na dysk zewnętrzny f:\, należy zastosować polecenie

Które polecenie systemu Linux wyświetla czas pracy systemu oraz jego średnie obciążenie?

Podaj polecenie w systemie Windows Server, które umożliwia usunięcie jednostki organizacyjnej z katalogu.

Oprogramowanie przypisane do konkretnego komputera lub jego podzespołów, które uniemożliwia instalację na nowym sprzęcie zakupionym przez tego samego użytkownika, to

Nazwa protokołu, który pozwala na konwersję 32-bitowych adresów IP na 48-bitowe fizyczne adresy MAC w sieciach Ethernet, to:

Czym jest procesor Athlon 2800+?

Który z podanych adresów IP należy do klasy A?

Wskaż właściwą formę maski

Który z podanych elementów jest częścią mechanizmu drukarki igłowej?

Jakim portem domyślnie odbywa się przesyłanie poleceń (command) serwera FTP?

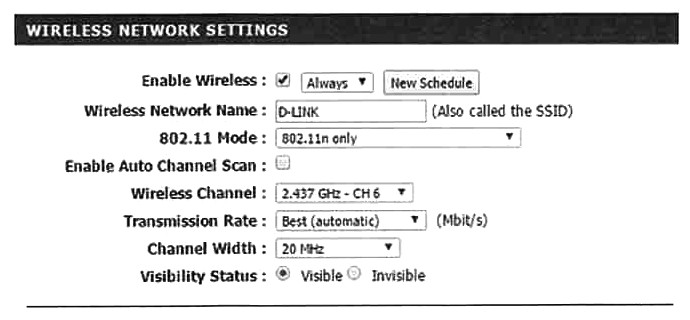

Który z parametrów w ustawieniach punktu dostępowego jest odpowiedzialny za login używany podczas próby połączenia z bezprzewodowym punktem dostępu?

Symbol przedstawiony na ilustracji wskazuje na produkt

Jaką fizyczną topologię sieci komputerowej przedstawiono na załączonym rysunku?

Jaką usługę powinno się aktywować na ruterze, aby każda stacja robocza mogła wymieniać pakiety z siecią Internet, gdy dostępnych jest 5 adresów publicznych oraz 18 stacji roboczych?

Rodzajem macierzy RAID, która nie jest odporna na awarię dowolnego z dysków wchodzących w jej skład, jest

Jak nazywa się technika modyfikowania ramek sieciowych polegająca na oznaczaniu ich identyfikatorem sieci VLAN nadawcy według standardu IEEE 802.1Q?

Jaki element sieci SIP określamy jako telefon IP?

Która z poniższych topologii sieciowych charakteryzuje się centralnym węzłem, do którego podłączone są wszystkie inne urządzenia?

Nierówne wydruki lub bladości w druku podczas korzystania z drukarki laserowej mogą sugerować

Jakie będą całkowite koszty materiałów potrzebnych do stworzenia sieci lokalnej dla 6 komputerów, jeśli do budowy sieci wymagane jest 100 m kabla UTP kat. 5e oraz 20 m kanału instalacyjnego? Ceny komponentów sieci przedstawiono w tabeli.

| Elementy sieci | j.m. | cena brutto |

|---|---|---|

| Kabel UTP kat. 5e | m | 1,00 zł |

| Kanał instalacyjny | m | 8,00 zł |

| Gniazdo komputerowe | szt. | 5,00 zł |

Administrator pragnie udostępnić w sieci folder C:instrukcje trzem użytkownikom z grupy Serwisanci. Jakie rozwiązanie powinien wybrać?