Pytanie 1

Na zdjęciu przedstawiono

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Na zdjęciu przedstawiono

Program testujący wydajność sprzętu komputerowego to

Do stworzenia projektu sieci komputerowej dla obiektu szkolnego najlepiej użyć edytora grafiki wektorowej, którym jest oprogramowanie

Przedstawione narzędzie jest przeznaczone do

Modułem pamięci RAM, kompatybilnym z płytą główną GIGABYTE GA-X99- ULTRA GAMING/ X99/ 8x DDR4 2133, ECC, max 128GB/ 4x PCI-E 16x/ RAID/ USB 3.1/ S-2011-V3/ATX, jest pamięć

Aby powiększyć lub zmniejszyć rozmiar ikony na pulpicie, trzeba obracać rolką myszki, trzymając jednocześnie klawisz

Jednym z czynników, dla których zapis na dysku SSD jest szybszy niż na dysku HDD, jest

Na wydrukach uzyskanych z drukarki laserowej można zauważyć pasma wzdłużne oraz powtarzające się defekty. Jedną z możliwych przyczyn niskiej jakości druku jest wada

Adres MAC (Medium Access Control Address) to sprzętowy identyfikator karty sieciowej Ethernet w warstwie modelu OSI

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Podstawowym zadaniem mechanizmu Plug and Play jest

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

Administrator Active Directory w domenie firma.local pragnie skonfigurować mobilny profil dla wszystkich użytkowników. Ma on być przechowywany na serwerze serwer1, w folderze pliki, który jest udostępniony w sieci jako dane$. Który z parametrów w ustawieniach profilu użytkownika spełnia opisane wymagania?

Jaki protokół stworzony przez IBM służy do udostępniania plików w architekturze klient-serwer oraz do współdzielenia zasobów z sieciami Microsoft w systemach operacyjnych LINUX i UNIX?

W systemach operacyjnych z rodziny Windows, funkcja EFS umożliwia ochronę danych poprzez ich

Liczbą dziesiętną, która odpowiada liczbie 11110101₍U₂₎, jest

Zgodnie z przedstawionymi zaleceniami dla drukarki atramentowej, kolorowe dokumenty powinny być drukowane przynajmniej

„Czyszczenie głowicy drukarki …. ….. W tym przypadku najskuteczniejszym rozwiązaniem jest wyczyszczenie głowicy drukarki z zaschniętego tuszu. Z reguły wystarcza przetarcie głównego źródła problemu wilgotnym ręcznikiem. Jeżeli to nie pomoże należy zassać tusz do dysz, co pozwoli usunąć z nich powietrze. ….. Kiedy również i to nie pomoże należy przejść do ręcznego czyszczenia głowicy. Drukarka….. powinna być wyłączana na noc, ponieważ po każdym włączeniu przeprowadzane są mini cykle czyszczenia. Warto również pamiętać o wydrukowaniu przynajmniej raz w tygodniu kolorowego dokumentu, dzięki czemu zminimalizujemy prawdopodobieństwo zaschnięcia tuszu." Fragment instrukcji czyszczenia drukarki |

Przy realizacji projektu dotyczącego sieci LAN wykorzystano medium transmisyjne standardu Ethernet 1000Base-T. Które z poniższych stwierdzeń jest prawdziwe?

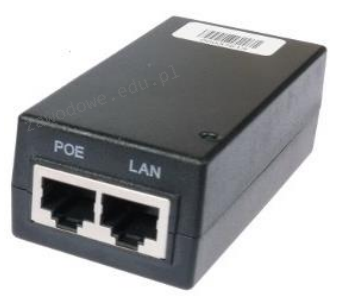

Urządzenie pokazane na ilustracji służy do

Osoba korzystająca z komputera udostępnia w sieci Internet pliki, które posiada. Prawa autorskie będą złamane, gdy udostępni

Jakie polecenie w systemie Linux służy do przypisania adresu IP oraz maski podsieci dla interfejsu eth0?

Dwie stacje robocze w tej samej sieci nie są w stanie się skomunikować. Która z poniższych okoliczności może być przyczyną opisanego problemu?

Jaki typ rozbudowy serwera wymaga zainstalowania dodatkowych sterowników?

Która karta graficzna nie będzie współpracowała z monitorem, wyposażonym w złącza przedstawione na zdjęciu (zakładając, że do podłączenia monitora nie można zastosować adaptera)?

Który z wewnętrznych protokołów routingu bazuje na metodzie wektora odległości?

Zgodnie z normą 802.3u w sieciach FastEthernet 100Base-FX stosuje się

W systemie działającym w trybie wielozadaniowości z wywłaszczeniem program, który zatrzymał się

Jakiego rodzaju papieru należy użyć, aby wykonać "naprasowankę" na T-shircie z własnym zdjęciem przy pomocy drukarki atramentowej?

Jakie jest główne zadanie programu Wireshark?

Która para: protokół – warstwa, w której funkcjonuje protokół, jest prawidłowo zestawiona według modelu TCP/IP?

Do pomiaru wartości mocy pobieranej przez zestaw komputerowy służy

Drukarka ma przypisany stały adres IP 172.16.0.101 oraz maskę 255.255.255.0. Jaki adres IP powinien być ustawiony dla komputera, aby nawiązać komunikację z drukarką w lokalnej sieci?

Aby stworzyć nowego użytkownika o nazwie egzamin z hasłem qwerty w systemie Windows XP, należy wykorzystać polecenie

Jak określa się technologię stworzoną przez firmę NVIDIA, która pozwala na łączenie kart graficznych?

Aby skaner działał prawidłowo, co należy zrobić?

Który z trybów nie jest oferowany przez narzędzie lupa w systemie Windows?

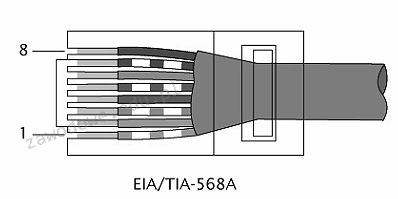

W technologii Ethernet 100BaseTX do przesyłania danych wykorzystywane są żyły kabla UTP podłączone do pinów

Norma TIA/EIA-568-B.2 definiuje parametry specyfikacji transmisyjnej

Jakie protokoły są właściwe dla warstwy internetowej w modelu TCP/IP?

Aby sprawdzić dysk twardy w systemie Linux na obecność uszkodzonych sektorów, użytkownik może zastosować program