Pytanie 1

Jakie złącze jest potrzebne do podłączenia zasilania do CD-ROM?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Jakie złącze jest potrzebne do podłączenia zasilania do CD-ROM?

Który z wymienionych protokołów jest szyfrowanym protokołem do zdalnego dostępu?

Jak nazywa się kod kontrolny, który służy do wykrywania błędów oraz potwierdzania poprawności danych odbieranych przez stację końcową?

Osoba korzystająca z systemu Linux, która chce odnaleźć pliki o konkretnej nazwie przy użyciu polecenia systemowego, może wykorzystać komendę

Brak danych dotyczących parzystości liczby lub znaku rezultatu operacji w ALU może sugerować usterki w funkcjonowaniu

Podczas analizy ruchu sieciowego przy użyciu sniffera zauważono, że urządzenia przesyłają dane na portach 20 oraz 21. Przyjmując standardową konfigurację, oznacza to, że analizowanym protokołem jest protokół

Jaki protokół stosują komputery, aby informować router o zamiarze dołączenia do lub opuszczenia konkretnej grupy multicastowej?

Protokół TCP (Transmission Control Protocol) funkcjonuje w trybie

Jaką maksymalną ilość rzeczywistych danych można przesłać w ciągu 1 sekundy przez łącze synchroniczne o wydajności 512 kbps, bez użycia sprzętowej i programowej kompresji?

Aby aktywować lub dezaktywować usługi w zainstalowanej wersji systemu operacyjnego Windows, należy wykorzystać narzędzie

Co należy zrobić, aby chronić dane przesyłane w sieci przed działaniem sniffera?

Które z wymienionych oznaczeń wskazuje, że jest to kabel typu skrętka z podwójnym ekranowaniem?

Na ilustracji ukazano kartę

Pamięć, która działa jako pośrednik pomiędzy pamięcią operacyjną a procesorem o dużej prędkości, to

Jaką inną formą można zapisać 2^32 bajtów?

Okablowanie pionowe w sieci strukturalnej łączy jakie elementy?

Zgodnie z normą PN-EN 50174, maksymalna długość kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem dystrybucji w panelu krosowym wynosi

W jaki sposób skonfigurować zaporę Windows, aby spełniała zasady bezpieczeństwa i umożliwiała użycie polecenia ping do weryfikacji komunikacji z innymi urządzeniami w sieci?

W systemie Linux do bieżącego monitorowania aktywnych procesów wykorzystuje się polecenie

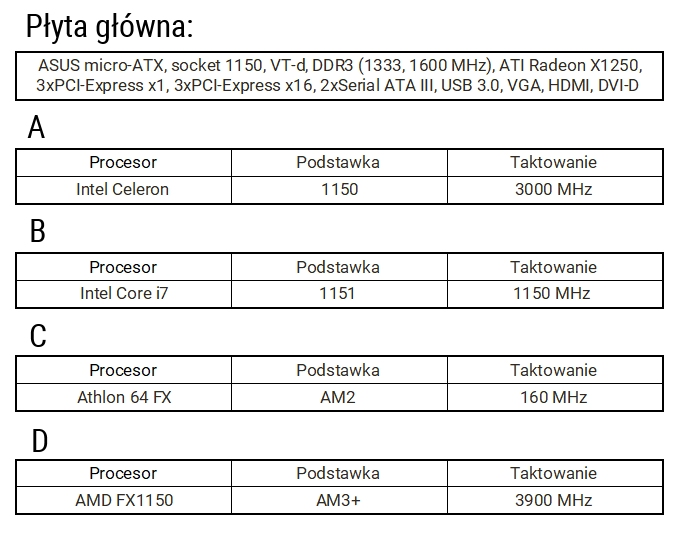

Jaki procesor pasuje do płyty głównej o podanej specyfikacji?

W systemie Windows do wyświetlenia treści pliku tekstowego służy polecenie

Użytkownik drukarki samodzielnie i poprawnie napełnił pojemnik z tonerem. Po jego zamontowaniu drukarka nie podejmuje się próby drukowania. Co może być przyczyną tej usterki?

Jakiego działania nie wykonują serwery plików?

Nawiązywanie szyfrowanych połączeń pomiędzy hostami w sieci publicznej Internet, wykorzystywane w kontekście VPN (Virtual Private Network), to

Jakie polecenie w systemie Linux służy do przypisania adresu IP oraz maski podsieci dla interfejsu eth0?

Które systemy operacyjne są atakowane przez wirusa MS Blaster?

Magistrala komunikacyjna PCI ver. 2.2 (Peripheral Component Interconnect) jest standardem magistrali, zgodnie z którym szyna danych ma maksymalną szerokość

Diody LED RGB funkcjonują jako źródło światła w różnych modelach skanerów

Wynikiem mnożenia dwóch liczb binarnych 11100110 oraz 00011110 jest liczba

Na ilustracji zaprezentowano sieć komputerową w układzie

Jak można skonfigurować interfejs sieciowy w systemie Linux, modyfikując plik

Jaki typ rozbudowy serwera wymaga zainstalowania dodatkowych sterowników?

Czym dokonuje się przekształcenia kodu źródłowego w program do wykonania?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Urządzenie, które łączy różne segmenty sieci i przesyła ramki pomiędzy nimi, wybierając odpowiedni port, do którego są kierowane konkretne ramki, to

Jaki zakres adresów IPv4 jest prawidłowo przypisany do danej klasy?

Menedżer urządzeń w systemie Windows pozwala na wykrycie

Licencja CAL (Client Access License) uprawnia użytkownika do

Jakie narzędzie służy do usuwania izolacji z włókna światłowodowego?

Wskaż błędny sposób podziału dysku MBR na partycje?