Pytanie 1

Wykonanie polecenia net use z:\\192.168.20.2\data /delete, spowoduje

Wynik: 32/40 punktów (80,0%)

Wymagane minimum: 20 punktów (50%)

Wykonanie polecenia net use z:\\192.168.20.2\data /delete, spowoduje

Jakie jest rozwinięcie skrótu, który odnosi się do usług mających na celu m.in. nadawanie priorytetów przesyłanym pakietom oraz zarządzanie przepustowością w sieci?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Program df działający w systemach z rodziny Linux pozwala na wyświetlenie

Który typ macierzy RAID zapewnia tzw. mirroring dysków?

Jak nazywa się protokół oparty na architekturze klient-serwer oraz modelu żądanie-odpowiedź, wykorzystywany do przesyłania plików?

Który z protokołów umożliwia szyfrowanie połączenia?

Serwer WWW o otwartym kodzie źródłowym, który działa na różnych systemach operacyjnych, to

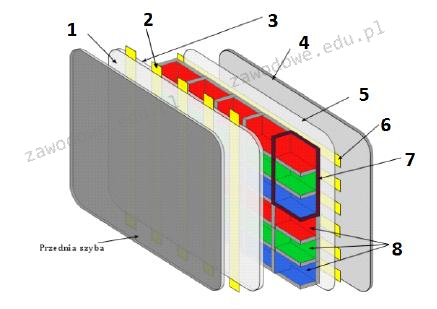

Na diagramie przedstawiającym zasadę funkcjonowania monitora plazmowego numer 6 zaznaczono

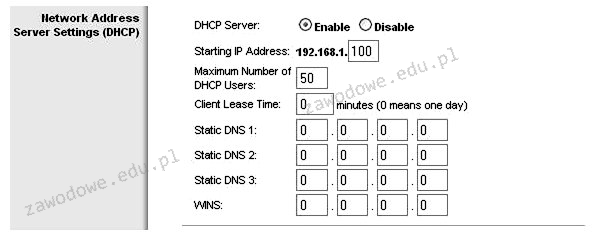

Ilustracja pokazuje panel ustawień bezprzewodowego urządzenia dostępowego, który umożliwia

Jakie polecenie w systemie Linux pokazuje czas działania systemu oraz jego średnie obciążenie?

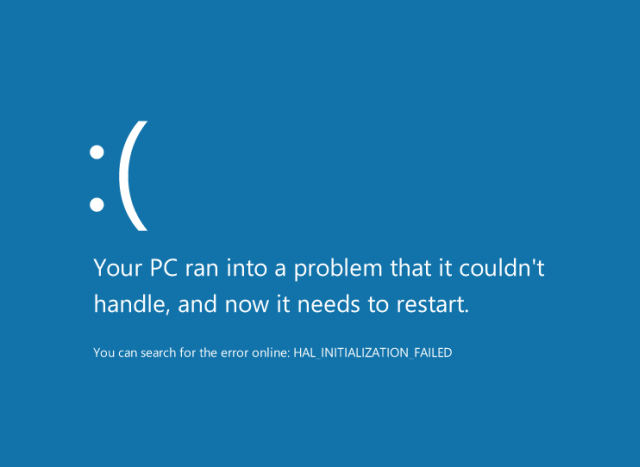

Zamieszczony komunikat tekstowy wyświetlony na ekranie komputera z zainstalowanym systemem Windows wskazuje na

Które polecenie w systemie Windows Server 2008 pozwala na przekształcenie serwera w kontroler domeny?

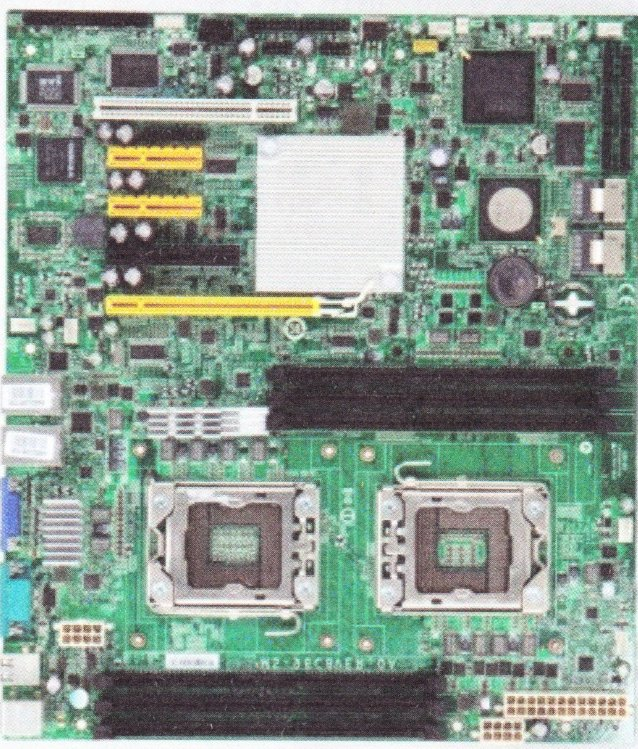

W komputerze użyto płyty głównej widocznej na obrazku. Aby podnieść wydajność obliczeniową maszyny, zaleca się

Jak skrót wskazuje na rozległą sieć komputerową, która obejmuje swoim zasięgiem miasto?

Na komputerze klienckim z systemem Windows XP plik "hosts" to plik tekstowy, który wykorzystywany jest do przypisywania

Po stwierdzeniu przypadkowego usunięcia ważnych danych na dysku twardym, aby odzyskać usunięte pliki, najlepiej

Co jest główną funkcją serwera DHCP w sieci komputerowej?

Liczba 205(10) w zapisie szesnastkowym wynosi

Zabrudzony czytnik w napędzie optycznym powinno się czyścić

Aby określić długość prefiksu w adresie IPv4, należy ustalić

Jak będzie wyglądać liczba 29A16 w systemie binarnym?

Do konserwacji elementów optycznych w komputerach zaleca się zastosowanie

W systemie DNS, aby powiązać nazwę hosta z adresem IPv4, konieczne jest stworzenie rekordu

Aby zminimalizować wpływ zakłóceń elektromagnetycznych na przesyłany sygnał w tworzonej sieci komputerowej, jakie rozwiązanie należy zastosować?

Uszkodzenie mechaniczne dysku twardego w komputerze stacjonarnym może być spowodowane

Które z poniższych twierdzeń nie odnosi się do pamięci cache L1?

W strukturze sieciowej zaleca się umiejscowienie jednego punktu abonenckiego na powierzchni wynoszącej

Które z poniższych poleceń w Windows wyświetla adresy IP interfejsów sieciowych?

Gniazdo w sieciach komputerowych, które jednoznacznie identyfikuje dany proces na urządzeniu, stanowi kombinację

Aby poprawić niezawodność oraz efektywność przesyłania danych na serwerze, należy

Na podstawie danych z "Właściwości systemu" można stwierdzić, że na komputerze zainstalowano fizycznie pamięć RAM o pojemności

| Komputer: Intel(R) Pentium (R)4 CPU 1.8GHz AT/XT Compatible 523 760 kB RAM |

Jakiego rodzaju złącze powinna mieć płyta główna, aby użytkownik był w stanie zainstalować kartę graficzną przedstawioną na rysunku?

Zdiagnostykowane wyniki wykonania polecenia systemu Linux odnoszą się do ```/dev/sda: Timing cached reads: 18100 MB in 2.00 seconds = 9056.95 MB/sec```

Najwyższą prędkość transmisji danych w sieci bezprzewodowej zapewnia standard

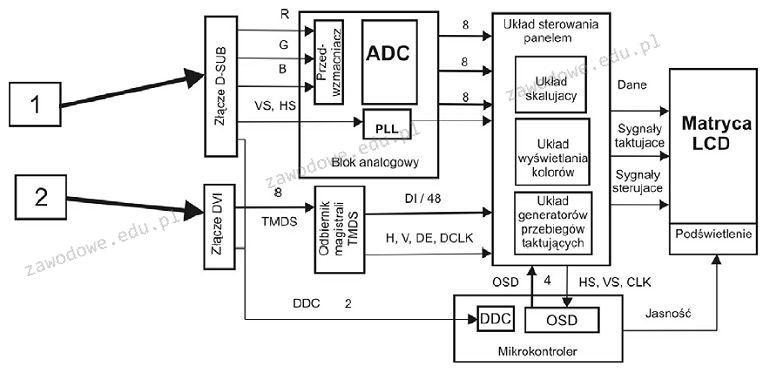

Które z połączeń zaznaczonych strzałkami na diagramie monitora stanowi wejście cyfrowe?

Jaką usługę należy zainstalować na systemie Linux, aby umożliwić bezpieczny zdalny dostęp?

Do kategorii oprogramowania określanego jako malware (z ang. malicious software) nie zalicza się oprogramowanie typu:

Jak brzmi nazwa klucza rejestru w systemie Windows, w którym zapisane są relacje między typami plików a aplikacjami, które je obsługują?

Do sprawdzenia, czy zainstalowana karta graficzna komputera przegrzewa się, użytkownik może wykorzystać program