Pytanie 1

Który interfejs pozwala na korzystanie ze sterowników oraz oprogramowania systemu operacyjnego, umożliwiając m.in. przesył danych pomiędzy pamięcią systemową a dyskiem SATA?

Wynik: 33/40 punktów (82,5%)

Wymagane minimum: 20 punktów (50%)

Który interfejs pozwala na korzystanie ze sterowników oraz oprogramowania systemu operacyjnego, umożliwiając m.in. przesył danych pomiędzy pamięcią systemową a dyskiem SATA?

Po włączeniu komputera na ekranie wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Możliwą przyczyną tego może być

Który instrument służy do pomiaru długości oraz tłumienności przewodów miedzianych?

Jaką partycją w systemie Linux jest magazyn tymczasowych danych, gdy pamięć RAM jest niedostępna?

Jakie rodzaje partycji mogą występować w systemie Windows?

Po wykonaniu eksportu klucza HKCR zostanie zapisana kopia rejestru, zawierająca informacje dotyczące konfiguracji

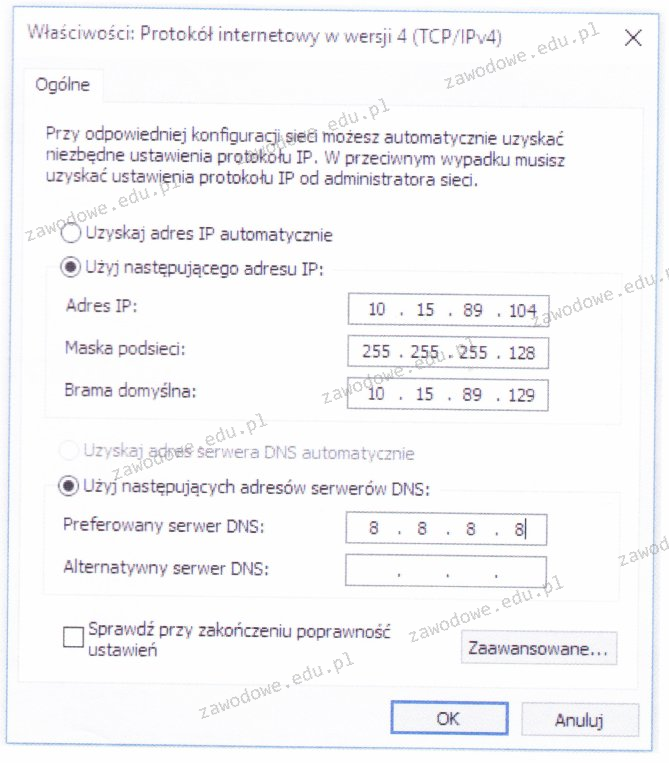

Schemat ilustruje ustawienia karty sieciowej dla urządzenia z adresem IP 10.15.89.104/25. Można z niego wywnioskować, że

Jakie polecenie powinien wydać root w systemie Ubuntu Linux, aby zaktualizować wszystkie pakiety (cały system) do najnowszej wersji, łącznie z nowym jądrem?

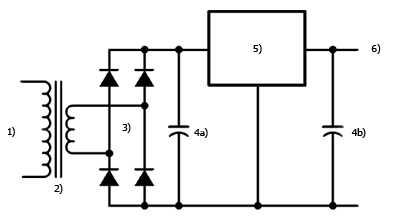

Na schemacie blokowym przedstawiającym zasadę działania zasilacza liniowego numerem 5) oznaczono

Jakie polecenie uruchamia edytor polityk grup w systemach z rodziny Windows Server?

Na zdjęciu pokazano złącza

Po wykonaniu eksportu klucza HKCU zostanie zapisana kopia rejestru zawierająca informacje, dotyczące konfiguracji

Który z poniższych mechanizmów zagwarantuje najwyższy poziom ochrony w sieciach bezprzewodowych opartych na standardzie 802.11n?

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

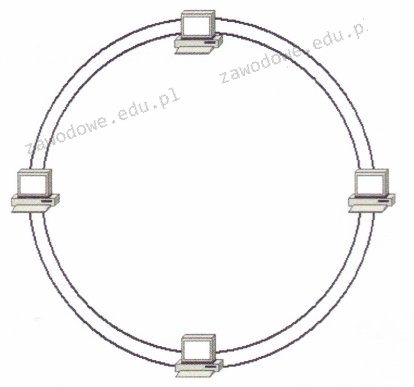

Jakie właściwości topologii fizycznej sieci zostały przedstawione w poniższej ramce?

Jaką topologię fizyczną sieci komputerowej przedstawia rysunek?

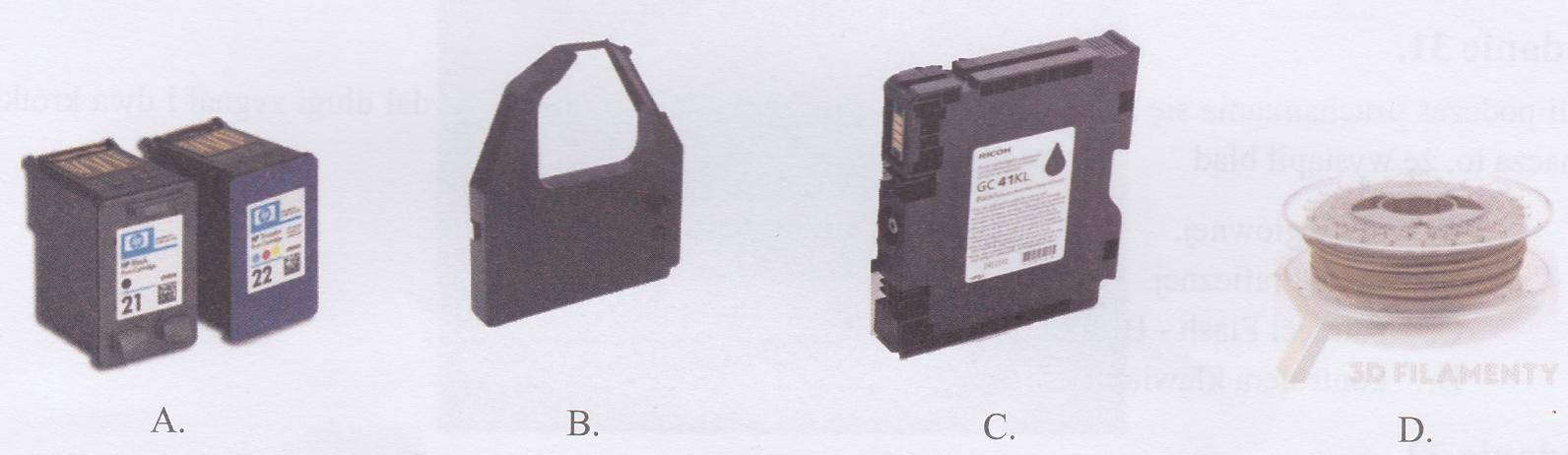

Wskaż ilustrację przedstawiającą materiał eksploatacyjny charakterystyczny dla drukarek żelowych?

Funkcję S.M.A.R.T. w twardym dysku, która jest odpowiedzialna za nadzorowanie i wczesne ostrzeganie o możliwych awariach, można uruchomić poprzez

Jakie są poszczególne elementy adresu globalnego IPv6 typu unicast pokazane na ilustracji?

| IPv6 | ||

|---|---|---|

| 1 | 2 | 3 |

| 48 bitów | 16 bitów | 64 bity |

Protokół transportowy bez połączenia w modelu ISO/OSI to

Jakie zabezpieczenie w dokumentacji technicznej określa mechanizm zasilacza komputerowego zapobiegający przegrzaniu urządzenia?

Element obliczeń zmiennoprzecinkowych to

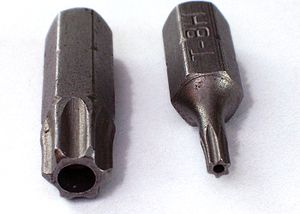

Na ilustracji przedstawiono końcówkę wkrętaka typu

W systemie Linux plik messages zawiera

Jaki będzie rezultat odejmowania dwóch liczb zapisanych w systemie heksadecymalnym 60Ah - 3BFh?

Jaka liczba hostów może być podłączona w sieci o adresie 192.168.1.128/29?

Która z anten charakteryzuje się najwyższym zyskiem energetycznym oraz pozwala na nawiązywanie połączeń na dużą odległość?

Którym poleceniem można skonfigurować uprawnienia do zasobów sieciowych w systemie Windows?

Najmniejszymi kątami widzenia charakteryzują się matryce monitorów typu

Aby zdalnie i jednocześnie bezpiecznie zarządzać systemem Linux, należy zastosować protokół

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Który adres IP jest powiązany z nazwą mnemoniczna localhost?

Aby skutecznie zabezpieczyć system operacyjny przed atakami złośliwego oprogramowania, po zainstalowaniu programu antywirusowego konieczne jest

Menedżer urządzeń w systemie Windows pozwala na wykrycie

Który z standardów Gigabit Ethernet pozwala na stworzenie segmentów sieci o długości 550 m/5000 m przy szybkości przesyłu danych 1 Gb/s?

Urządzenie przedstawione na ilustracji, wraz z podanymi danymi technicznymi, może być zastosowane do pomiarów systemów okablowania

Narzędziem do zarządzania usługami katalogowymi w systemach Windows Server, które umożliwia przeniesienie komputerów do jednostki organizacyjnej wskazanej przez administratora, jest polecenie

Jak ustawić w systemie Windows Server 2008 parametry protokołu TCP/IP karty sieciowej, aby komputer mógł jednocześnie funkcjonować w dwóch sieciach lokalnych o różnych adresach IP?

Która edycja systemu operacyjnego Windows Server 2008 charakteryzuje się najuboższym interfejsem graficznym?

W sieciach komputerowych, gniazdo, które jednoznacznie wskazuje na dany proces na urządzeniu, stanowi połączenie