Pytanie 1

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue press DEL to setup. Naciśnięcie klawisza DEL spowoduje

Jaki element sieci SIP określamy jako telefon IP?

W adresie IP z klasy A, wartość pierwszego bajtu mieści się w zakresie

W układzie SI jednostką, która mierzy napięcie, jest

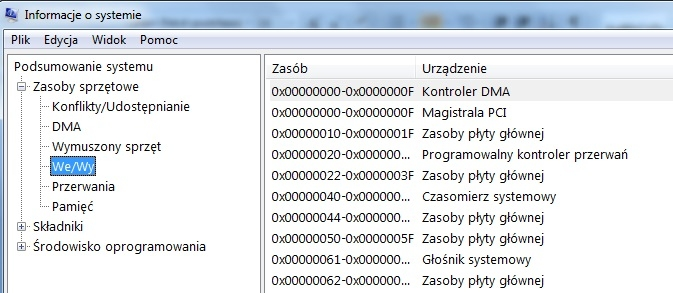

W którym systemie liczbowym zapisano zakresy We/Wy przedstawione na ilustracji?

Jakie urządzenie jest przedstawione na rysunku?

Oświetlenie oparte na diodach LED w trzech kolorach wykorzystuje skanery typu

Jakim złączem zasilany jest wewnętrzny dysk twardy typu IDE?

Brak zabezpieczeń przed utratą danych w wyniku fizycznej awarii jednego z dysków to właściwość

Zaprezentowany komunikat jest rezultatem wykonania następującego polecenia

C:\Windows NT_SERVICE\TrustedInstaller:(F)

NT_SERVICE\TrustedInstaller:(CI)(IO)(F)

ZARZĄDZANIE NT\SYSTEM:(M)

ZARZĄDZANIE NT\SYSTEM:(OI)(CI)(IO)(F)

BUILTIN\Administratorzy:(M)

BUILTIN\Administratorzy:(OI)(CI)(IO)(F)

BUILTIN\Użytkownicy:(RX)

BUILTIN\Użytkownicy:(OI)(CI)(IO)(GR,GE)

TWÓRCA-WŁAŚCICIEL:(OI)(CI)(IO)(F)

W systemie Windows można przeprowadzić analizę wpływu uruchomionych aplikacji na wydajność komputera, korzystając z polecenia

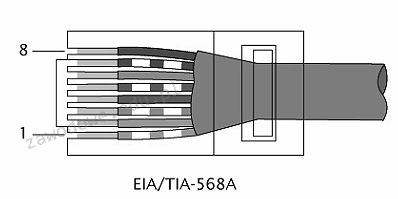

W technologii Ethernet 100BaseTX do przesyłania danych wykorzystywane są żyły kabla UTP podłączone do pinów

Usługa, umożliwiająca zdalną pracę na komputerze z systemem Windows z innego komputera z systemem Windows, który jest połączony z tą samą siecią lub z Internetem, to

Narzędzie w systemie Windows umożliwiające monitorowanie prób logowania do systemu to dziennik

Aby uzyskać adres IPv4, za pomocą usługi DHCP, komputer kliencki wysyła żądania z portu

Dobrze zaprojektowana sieć komputerowa powinna zapewniać możliwość rozbudowy, czyli charakteryzować się

Aby sprawdzić, czy zainstalowana karta graficzna w komputerze jest przegrzewana, użytkownik ma możliwość użycia programu

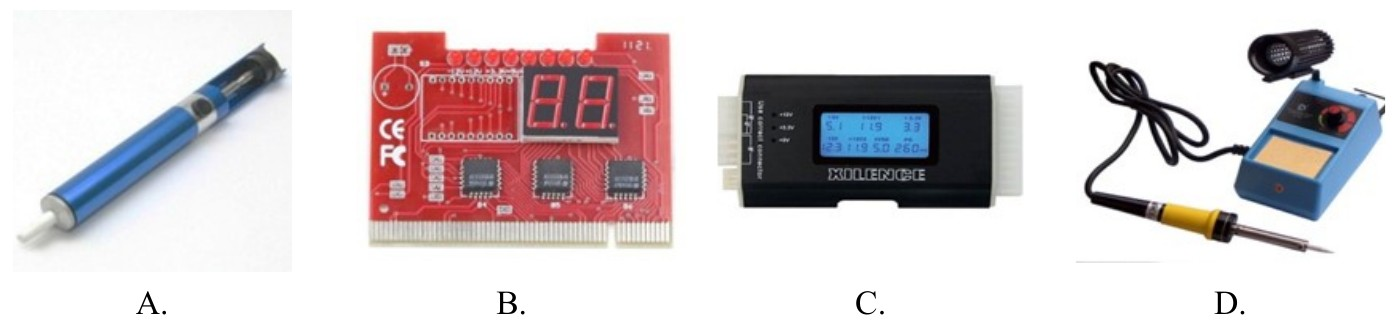

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

Które urządzenie może zostać wykorzystane do rutowania ruchu sieciowego między sieciami VLAN?

Dostosowanie ustawień parametrów TCP/IP urządzenia na podstawie adresu MAC karty sieciowej jest funkcją protokołu

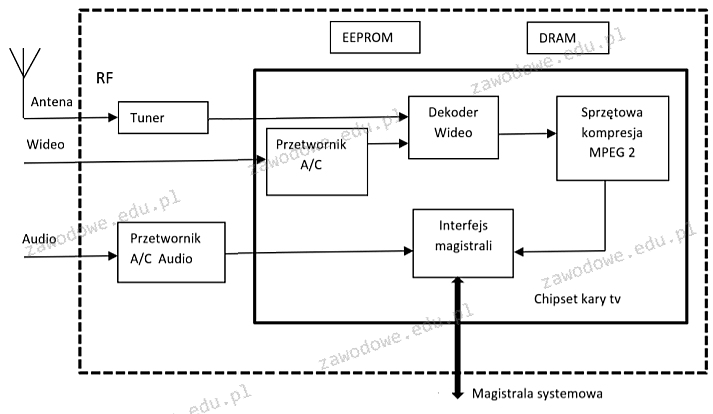

Na ilustracji zaprezentowano schemat blokowy karty

W systemie Linux komenda cd ~ pozwala na

Jakie jednostki stosuje się do wyrażania przesłuchu zbliżonego NEXT?

Użytkownik chce zabezpieczyć mechanicznie dane na karcie pamięci przed przypadkowym skasowaniem. Takie zabezpieczenie umożliwia karta

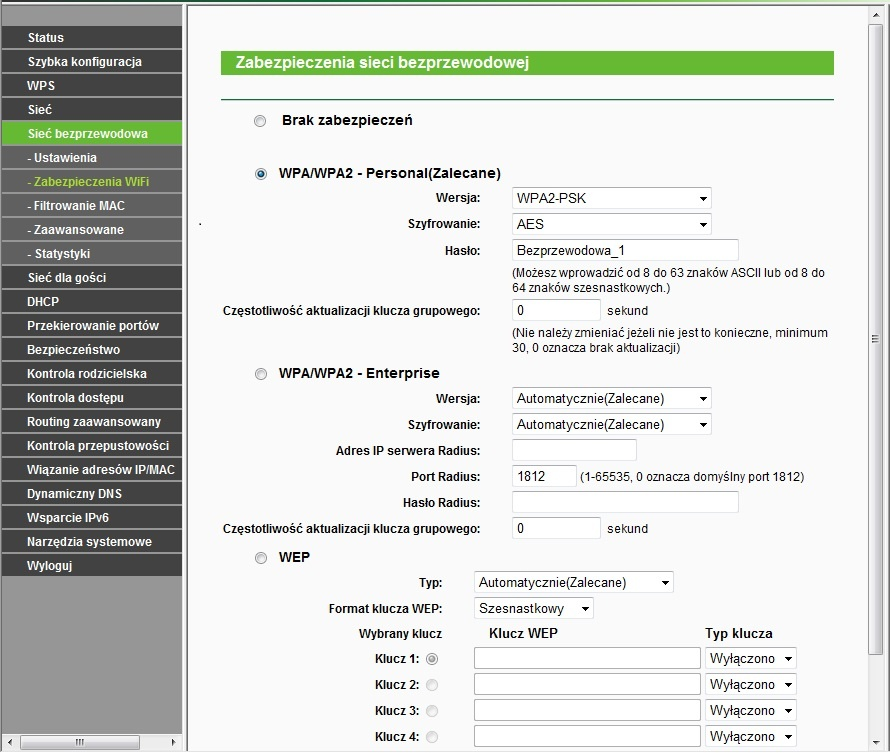

Na ilustracji przedstawiono konfigurację dostępu do sieci bezprzewodowej, która dotyczy

Jak nazywa się topologia fizyczna sieci, która wykorzystuje fale radiowe jako medium transmisyjne?

Które z poniższych wskazówek jest NIEWłaściwe w kontekście konserwacji skanera płaskiego?

Który z wymienionych adresów stanowi adres hosta w obrębie sieci 10.128.0.0/10?

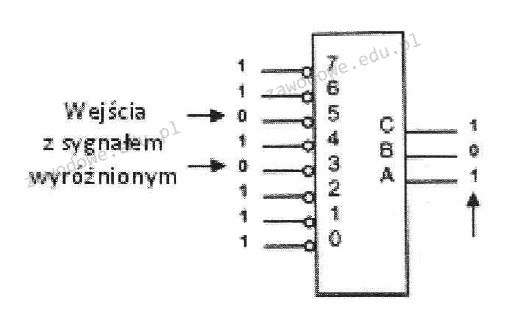

Na ilustracji przedstawiono symbol urządzenia cyfrowego

Oprogramowanie, które wymaga zatwierdzenia na wyświetlanie reklam lub zakupu pełnej licencji, aby usunąć reklamy, jest dystrybuowane na licencji

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W specyfikacji technicznej płyty głównej znajduje się zapis Supports up to Athlon XP 3000+ processor. Co to oznacza w kontekście obsługi procesorów przez tę płytę główną?

Do przeprowadzenia aktualizacji systemów Linux można zastosować aplikacje

Jakie znaczenie ma parametr NVP (Nominal Velocity of Propagation) podczas pomiarów okablowania strukturalnego?

Prawo majątkowe przysługujące twórcy programu komputerowego

Jakie adresy mieszczą się w zakresie klasy C?

Ile wyniesie całkowity koszt wymiany karty sieciowej w komputerze, jeżeli cena karty to 40 zł, czas pracy serwisanta wyniesie 90 minut, a koszt każdej rozpoczętej roboczogodziny to 60 zł?

Która z poniższych czynności NIE przyczynia się do personalizacji systemu operacyjnego Windows?

Użytkownik napotyka trudności przy uruchamianiu systemu Windows. W celu rozwiązania tego problemu, skorzystał z narzędzia System Image Recovery, które

Jakie narzędzie w systemie Windows umożliwia kontrolę prób logowania do systemu?