Pytanie 1

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?

Algorytm wykorzystywany do weryfikacji, czy ramka Ethernet jest wolna od błędów, to

W systemie Linux do obserwacji działania sieci, urządzeń sieciowych oraz serwerów można zastosować aplikację

Zasilacz UPS o mocy rzeczywistej 480 W nie jest przeznaczony do podłączenia

Trollowanie w Internecie polega na

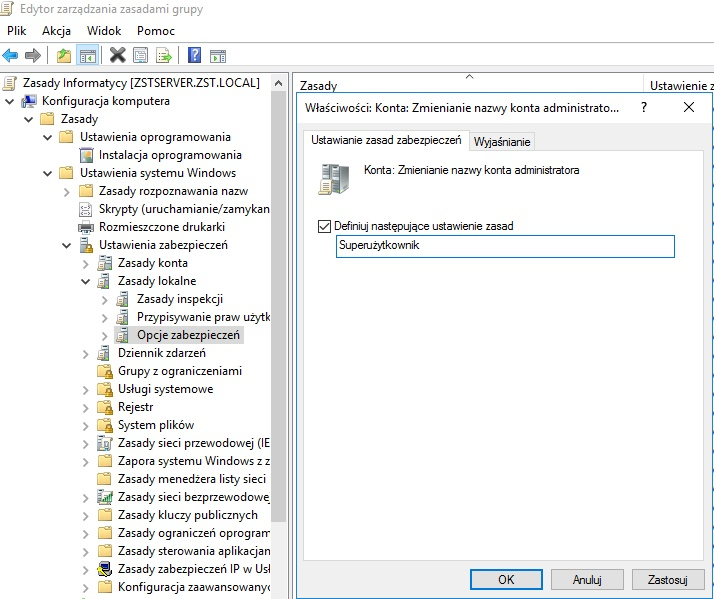

Rezultatem działania przedstawionego na ilustracji okna jest

Która norma odnosi się do okablowania strukturalnego?

Jakiego rodzaju plik należy stworzyć w systemie operacyjnym, aby zautomatyzować rutynowe działania, takie jak kopiowanie lub tworzenie plików oraz folderów?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

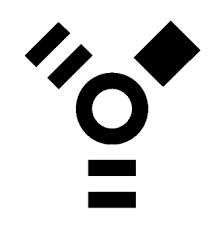

Symbol przedstawiony na ilustracji oznacza rodzaj złącza

Interfejs UDMA to typ interfejsu

Oświetlenie oparte na diodach LED w trzech kolorach wykorzystuje skanery typu

Dobrze zaprojektowana sieć komputerowa powinna zapewniać możliwość rozbudowy, czyli charakteryzować się

Do konserwacji elementów łożyskowanych oraz ślizgowych w urządzeniach peryferyjnych stosuje się

Który interfejs bezprzewodowy, komunikacji krótkiego zasięgu pomiędzy urządzeniami elektronicznymi, korzysta z częstotliwości 2,4 GHz?

Czym jest VOIP?

Której aplikacji należy użyć, aby sprawdzić parametry S.M.A.R.T.?

Za pomocą narzędzia diagnostycznego Tracert można ustalić trasę do punktu docelowego. Przez ile routerów przeszedł pakiet wysłany dl hosta 172.16.0.99?

C:\>tracert 172.16.0.99 Trasa śledzenia do 172.16.0.99 z maksymalną liczbą przeskoków 30 | ||||

| 1 | 2 ms | 3 ms | 2 ms | 10.0.0.1 |

| 2 | 12 ms | 8 ms | 8 ms | 192.168.0.1 |

| 3 | 10 ms | 15 ms | 10 ms | 172.17.0.2 |

| 4 | 11 ms | 11 ms | 20 ms | 172.17.48.14 |

| 5 | 21 ms | 16 ms | 24 ms | 172.16.0.99 |

Śledzenie zakończone. | ||||

Jakim interfejsem można uzyskać transmisję danych o maksymalnej przepustowości 6 Gb/s?

Aby uniknąć uszkodzenia sprzętu podczas modernizacji komputera przenośnego polegającej na wymianie modułów pamięci RAM należy

Jakie urządzenie służy do połączenia 6 komputerów w ramach sieci lokalnej?

Jakiego rekordu DNS należy użyć w strefie wyszukiwania do przodu, aby powiązać nazwę domeny DNS z adresem IP?

Administrator Active Directory w domenie firma.local pragnie skonfigurować profil mobilny dla wszystkich użytkowników. Profil ma być zapisywany na serwerze serwer1, w folderze pliki, udostępnionym w sieci jako dane$. Który z parametrów w ustawieniach profilu użytkownika spełnia te wymagania?

Uruchomienie systemu Windows jest niemożliwe z powodu awarii oprogramowania. W celu przeprowadzenia jak najmniej inwazyjnej diagnostyki i usunięcia tej usterki, zaleca się

Które z poniższych zdań charakteryzuje protokół SSH (Secure Shell)?

W systemie Windows aktualne ustawienia użytkownika komputera przechowywane są w gałęzi rejestru o skrócie

W systemie Windows, gdzie można ustalić wymagania dotyczące złożoności hasła?

Industry Standard Architecture to standard magistrali, który określa, że szerokość szyny danych wynosi:

Jakie oznaczenie wskazuje adres witryny internetowej oraz przypisany do niej port?

Jakie polecenie należy użyć w systemie Windows, aby przeprowadzić śledzenie trasy pakietów do serwera internetowego?

Umożliwienie stacjom roboczym Windows, OS X oraz Linux korzystania z usług drukowania Linuxa i serwera plików zapewnia serwer

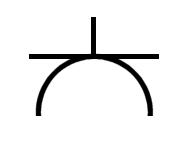

Na rysunkach technicznych dotyczących instalacji sieci komputerowej, wraz z jej dedykowanym systemem elektrycznym, gniazdo oznaczone symbolem przedstawionym na rysunku to

Która para: protokół – warstwa, w której funkcjonuje protokół, jest prawidłowo zestawiona według modelu TCP/IP?

Na ilustracji widoczna jest pamięć operacyjna

Podczas procesu zamykania systemu operacyjnego na wyświetlaczu pojawił się błąd, znany jako bluescreen 0x000000F3 Bug Check 0xF3 DISORDERLY_SHUTDOWN - nieudane zakończenie pracy systemu, spowodowane brakiem pamięci. Co może sugerować ten błąd?

Po wykonaniu instalacji z domyślnymi parametrami system Windows XP NIE OBSŁUGUJE formatu systemu plików

Programem wykorzystywanym w systemie Linux do odtwarzania muzyki jest

Aby w edytorze Regedit przywrócić stan rejestru systemowego za pomocą wcześniej utworzonej kopii zapasowej, należy użyć funkcji

Jakie narzędzie jest używane do zarządzania alokacjami dyskowymi w systemach Windows 7 i Windows 8?

Zgodnie z normą 802.3u technologia sieci FastEthernet 100Base-FX stosuje