Pytanie 1

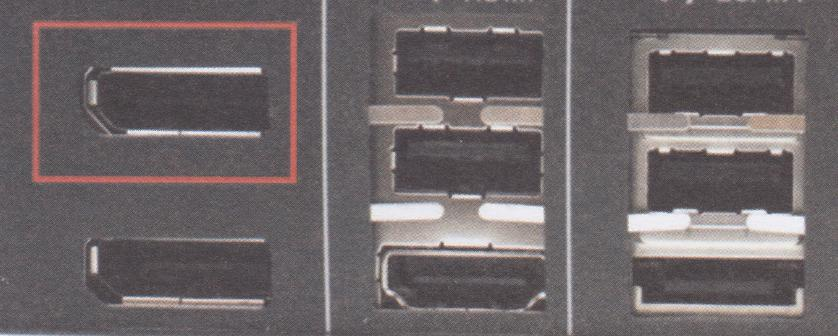

Na ilustracji, złącze monitora zaznaczone czerwoną ramką, będzie kompatybilne z płytą główną, która ma interfejs

Wynik: 17/40 punktów (42,5%)

Wymagane minimum: 20 punktów (50%)

Na ilustracji, złącze monitora zaznaczone czerwoną ramką, będzie kompatybilne z płytą główną, która ma interfejs

Która z anten charakteryzuje się najwyższym zyskiem energetycznym oraz pozwala na nawiązywanie połączeń na dużą odległość?

Usterka przedstawiona na ilustracji, widoczna na monitorze komputera, nie może być spowodowana przez

System S.M.A.R.T. służy do śledzenia funkcjonowania oraz identyfikacji usterek

Który z wymienionych komponentów jest częścią mechanizmu drukarki igłowej?

Jaki protokół służy do przesyłania plików bez konieczności tworzenia połączenia?

Wskaź zestaw do diagnostyki logicznych układów elektronicznych umiejscowionych na płycie głównej komputera, który nie reaguje na próby uruchomienia zasilania?

Jakie urządzenie powinno być użyte do podłączenia żył kablowych skrętki do gniazda Ethernet?

Złącze SC powinno być zainstalowane na przewodzie

Jak nazywa się urządzenie wskazujące, które współpracuje z monitorami CRT i ma końcówkę z elementem światłoczułym, a jego dotknięcie ekranu monitora wysyła sygnał do komputera, co pozwala na określenie pozycji kursora?

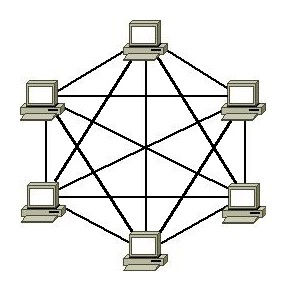

Jakiego rodzaju fizyczna topologia sieci komputerowej jest zobrazowana na rysunku?

Najwyższy stopień zabezpieczenia sieci bezprzewodowej zapewnia szyfrowanie

Która norma odnosi się do okablowania strukturalnego?

Jaki protokół jest używany do ściągania wiadomości e-mail z serwera pocztowego na komputer użytkownika?

Active Directory w systemach MS Windows Server 2000 oraz MS Windows Server 2003 to

Jaką operację należy wykonać, aby chronić dane przesyłane w sieci przed działaniem sniffera?

Częścią zestawu komputerowego, która zajmuje się zarówno przetwarzaniem danych wejściowych, jak i wyjściowych, jest

Który z protokołów służy do weryfikacji poprawności połączenia między dwoma hostami?

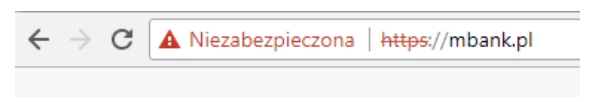

Zidentyfikuj powód pojawienia się komunikatu, który został pokazany na ilustracji

Najmniejszy czas dostępu charakteryzuje się

Czym jest odwrotność bezstratnego algorytmu kompresji danych?

Po wykonaniu instalacji z domyślnymi parametrami system Windows XP NIE OBSŁUGUJE formatu systemu plików

Aby zidentyfikować, który program najbardziej obciąża CPU w systemie Windows, należy otworzyć program

Wskaż nazwę modelu przechowywania i przetwarzania danych opartego na użytkowaniu zasobów dyskowych, obliczeniowych i programowych, udostępnionych przez usługodawcę za pomocą sieci komputerowej.

Jakie polecenie należy wydać, aby skonfigurować statyczny routing do sieci 192.168.10.0?

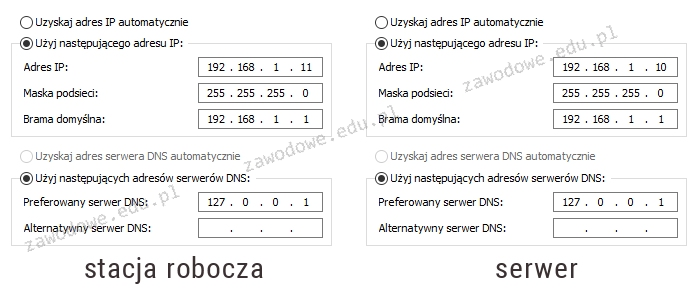

Na schemacie przedstawiono konfigurację protokołu TCP/IP pomiędzy serwerem a stacją roboczą. Na serwerze zainstalowano rolę DNS. Wykonanie polecenia ping www.cke.edu.pl na serwerze zwraca pozytywny wynik, natomiast na stacji roboczej jest on negatywny. Jakie zmiany należy wprowadzić w konfiguracji, aby usługa DNS na stacji funkcjonowała poprawnie?

Do jakiej grupy w systemie Windows Server 2008 powinien być przypisany użytkownik odpowiedzialny jedynie za archiwizację danych zgromadzonych na dysku serwera?

Martwy piksel, będący defektem monitorów LCD, to punkt, który trwa niezmiennie w kolorze

Aby użytkownicy lokalnej sieci mogli korzystać z przeglądarek do odwiedzania stron WWW za pomocą protokołów HTTP i HTTPS, brama internetowa musi umożliwiać ruch na portach

Aby była możliwa komunikacja pomiędzy dwiema różnymi sieciami, do których należą karty sieciowe serwera, należy w systemie Windows Server dodać rolę

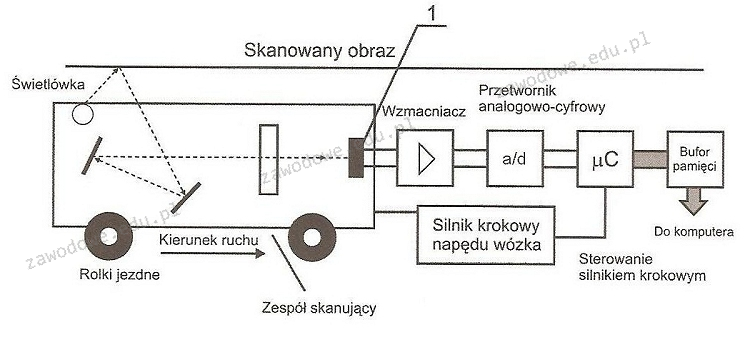

Na diagramie działania skanera, element oznaczony numerem 1 odpowiada za

Rodzaj ataku komputerowego, który polega na pozyskiwaniu wrażliwych informacji osobistych poprzez podszywanie się pod zaufaną osobę lub instytucję, to

Jakie składniki systemu komputerowego wymagają utylizacji w wyspecjalizowanych zakładach przetwarzania z powodu obecności niebezpiecznych substancji lub pierwiastków chemicznych?

Nie można uruchomić systemu Windows z powodu błędu oprogramowania. Jak można przeprowadzić diagnozę i usunąć ten błąd w jak najmniej inwazyjny sposób?

W przedsiębiorstwie zainstalowano pięć komputerów z adresami kart sieciowych zawartymi w tabeli. W związku z tym można wyróżnić

| Adres IP | Maska |

|---|---|

| 10.1.61.10 | 255.255.0.0 |

| 10.1.61.11 | 255.255.0.0 |

| 10.3.63.20 | 255.255.0.0 |

| 10.3.63.21 | 255.255.0.0 |

| 10.5.63.10 | 255.255.0.0 |

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie będą całkowite wydatki na materiały potrzebne do stworzenia 20 kabli połączeniowych typu patchcord, z których każdy ma długość 1,5m, jeśli cena 1 metra bieżącego kabla wynosi 1zł, a cena wtyku to 50 gr?

Czym jest procesor Athlon 2800+?

Aby zainstalować openSUSE oraz dostosować jego ustawienia, można skorzystać z narzędzia

Notacja #102816 oznacza zapis w systemie liczbowym