Pytanie 1

W drukarce laserowej do stabilizacji druku na papierze używane są

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

W drukarce laserowej do stabilizacji druku na papierze używane są

Złośliwe oprogramowanie, które może umożliwić atak na zainfekowany komputer, np. poprzez otwarcie jednego z portów, to

Jeżeli w konfiguracji karty graficznej zostanie wybrane odświeżanie obrazu większe od zalecanego, monitor CRT spełniający normy TCO 99

Osoba korzystająca z systemu Linux, która chce odnaleźć pliki o konkretnej nazwie przy użyciu polecenia systemowego, może wykorzystać komendę

Adresy IPv6 są reprezentowane jako liczby

Po wykonaniu eksportu klucza HKCU zostanie zapisana kopia rejestru zawierająca informacje, dotyczące konfiguracji

Brak informacji o parzystości liczby lub o znaku wyniku operacji w ALU może sugerować problemy z funkcjonowaniem

Jaki adres IP należy do grupy A?

Który z standardów Gigabit Ethernet pozwala na stworzenie segmentów sieci o długości 550 m/5000 m przy szybkości przesyłu danych 1 Gb/s?

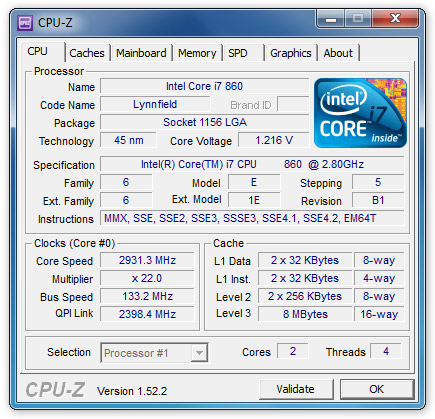

W dokumentacji technicznej procesora producent umieścił wyniki testu, który został wykonany przy użyciu programu CPU-Z. Z tych danych wynika, że procesor dysponuje

Kable łączące dystrybucyjne punkty kondygnacyjne z głównym punktem dystrybucji są określane jako

Protokół Datagramów Użytkownika (UDP) należy do kategorii

Licencja Windows OEM nie umożliwia wymiany

Lokalny komputer dysponuje adresem 192.168.0.5. Po otwarciu strony internetowej z tego urządzenia, która identyfikuje adresy w sieci, uzyskano informację, że adresem komputera jest 195.182.130.24. Co to oznacza?

Przerywając działalność na komputerze, możemy szybko wrócić do pracy, wybierając w systemie Windows opcję:

Układ na karcie graficznej, którego zadaniem jest zamiana cyfrowego sygnału generowanego poprzez kartę na sygnał analogowy, który może być wyświetlony poprzez monitor to

Licencja obejmująca oprogramowanie układowe, umieszczone na stałe w sprzętowej części systemu komputerowego, to

Tryb działania portu równoległego, oparty na magistrali ISA, który umożliwia transfer danych do 2,4 MB/s, przeznaczony dla skanerów oraz urządzeń wielofunkcyjnych, to

Wymianę uszkodzonych kondensatorów karty graficznej umożliwi

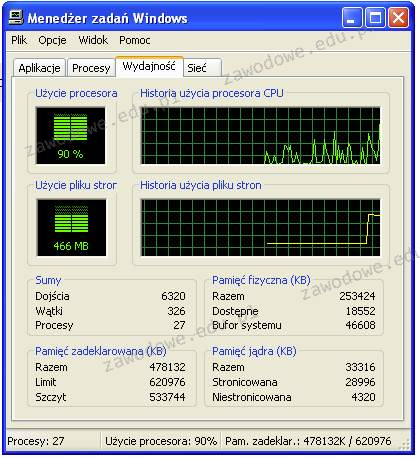

Jakie narzędzie w systemie Windows pozwala na ocenę wpływu poszczególnych procesów i usług na wydajność procesora oraz na obciążenie pamięci i dysku?

Przyglądając się przedstawionemu obrazkowi, można dostrzec, że deklarowany limit pamięci wynosi 620976 KB. Zauważamy również, że zainstalowana pamięć fizyczna w badanym systemie jest mniejsza niż pamięć zadeklarowana. Który typ pamięci wpływa na podniesienie limitu pamięci zadeklarowanej powyżej rozmiaru zainstalowanej pamięci fizycznej?

Komputer z BIOS-em firmy Award wyświetlił komunikat o treści Primary/Secondary master/slave hard disk fail. Co taki komunikat może sugerować w kontekście konieczności wymiany?

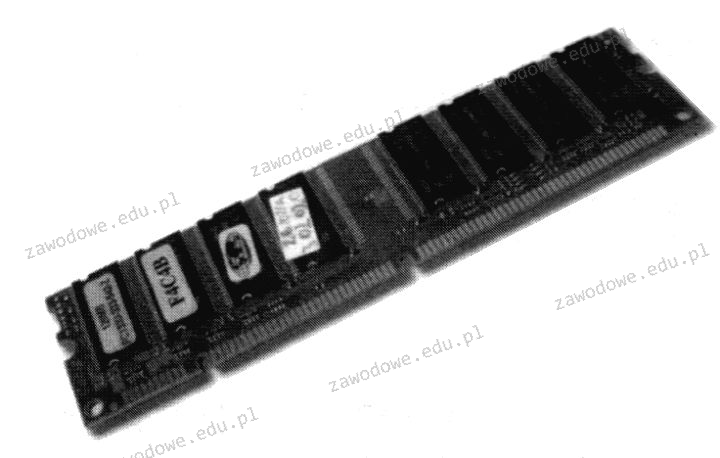

Jakie urządzenie ilustruje zamieszczony rysunek?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Impulsator pozwala na diagnozowanie uszkodzonych układów logicznych komputera między innymi poprzez

Symbol graficzny przedstawiony na rysunku wskazuje na opakowanie

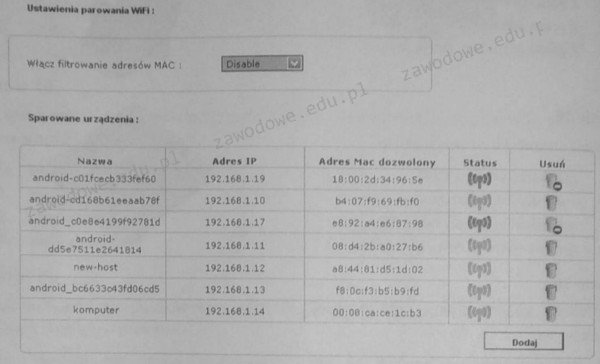

Schemat ilustruje ustawienia urządzenia WiFi. Wskaż, które z poniższych stwierdzeń na temat tej konfiguracji jest prawdziwe?

Której funkcji należy użyć do wykonania kopii zapasowej rejestru systemowego w edytorze regedit?

Po zainstalowaniu systemu Linux, użytkownik pragnie skonfigurować kartę sieciową poprzez wprowadzenie ustawień dotyczących sieci. Jakie działanie należy podjąć, aby to osiągnąć?

Jakie środowisko powinien wybrać administrator sieci, aby zainstalować serwer dla stron WWW w systemie Linux?

Wskaż nazwę modelu przechowywania i przetwarzania danych opartego na użytkowaniu zasobów dyskowych, obliczeniowych i programowych, udostępnionych przez usługodawcę za pomocą sieci komputerowej.

Uruchomienie systemu Windows jest niemożliwe z powodu awarii oprogramowania. W celu przeprowadzenia jak najmniej inwazyjnej diagnostyki i usunięcia tej usterki, zaleca się

Która topologia fizyczna umożliwia nadmiarowe połączenia pomiędzy urządzeniami w sieci?

W systemie Windows 7 konfigurację interfejsu sieciowego można przeprowadzić, używając rozwinięcia polecenia

Złącze IrDA służy do bezprzewodowej komunikacji i jest

Na fotografii ukazana jest pamięć o 168 stykach

Rodzaje ataków mających na celu zakłócenie funkcjonowania aplikacji oraz procesów w urządzeniach sieciowych to ataki klasy

Jakiego typu rozbudowa serwera wymaga zainstalowania dodatkowych sterowników?

Która norma w Polsce definiuje zasady dotyczące okablowania strukturalnego?

Wskaż ilustrację ilustrującą symbol stosowany do oznaczania portu równoległego LPT?