Pytanie 1

Które z kart sieciowych o podanych adresach MAC zostały wytworzone przez tego samego producenta?

Wynik: 31/40 punktów (77,5%)

Wymagane minimum: 20 punktów (50%)

Które z kart sieciowych o podanych adresach MAC zostały wytworzone przez tego samego producenta?

Poleceniem systemu Linux służącym do wyświetlenia informacji, zawierających aktualną godzinę, czas działania systemu oraz liczbę zalogowanych użytkowników, jest

Przedstawiony moduł pamięci należy zamontować na płycie głównej w gnieździe

Który z wymienionych protokołów przekształca 48-bitowy adres MAC na 32-bitowy adres IP?

Użytkownik chce zabezpieczyć mechanicznie dane na karcie pamięci przed przypadkowym skasowaniem. Takie zabezpieczenie umożliwia karta

Której komendy wiersza poleceń z opcji zaawansowanych naprawy systemu Windows należy użyć, aby naprawić uszkodzony MBR dysku?

Jakim sposobem zapisuje się dane na nośnikach BD-R?

Klient dostarczył wadliwy sprzęt komputerowy do serwisu. W trakcie procedury przyjmowania sprzętu, ale przed rozpoczęciem jego naprawy, serwisant powinien

Jaki protokół jest używany do ściągania wiadomości e-mail z serwera pocztowego na komputer użytkownika?

Jakie narzędzie powinno być użyte do zbadania wyników testu POST dla modułów na płycie głównej?

Aby osiągnąć przepustowość wynoszącą 4 GB/s w obie strony, konieczne jest zainstalowanie w komputerze karty graficznej korzystającej z interfejsu

Jakie protokoły przesyłają cykliczne kopie tablic routingu do sąsiadującego rutera i NIE ZAWIERAJĄ pełnych informacji o dalekich ruterach?

Jaką rolę pełni usługa NAT działająca na ruterze?

Administrator pragnie udostępnić w sieci folder C:instrukcje trzem użytkownikom z grupy Serwisanci. Jakie rozwiązanie powinien wybrać?

Elementem płyty głównej, który odpowiada za wymianę informacji pomiędzy procesorem a innymi komponentami płyty, jest

W tabeli przedstawiono pobór mocy poszczególnych podzespołów zestawu komputerowego. Zestaw składa się z:

- płyty głównej,

- procesora,

- 2 modułów pamięci DDR3,

- dysku twardego SSD,

- dysku twardego z prędkością obrotową 7200,

- karty graficznej,

- napędu optycznego,

- myszy i klawiatury,

- wentylatora.

Który zasilacz należy zastosować dla przedstawionego zestawu komputerowego, uwzględniając co najmniej 20% rezerwy poboru mocy?

| Podzespół | Pobór mocy [W] | Podzespół | Pobór mocy [W] |

|---|---|---|---|

| Procesor Intel i5 | 60 | Płyta główna | 35 |

| Moduł pamięci DDR3 | 6 | Karta graficzna | 310 |

| Moduł pamięci DDR2 | 3 | Dysk twardy SSD | 7 |

| Monitor LCD | 80 | Dysk twardy 7200 obr./min | 16 |

| Wentylator | 5 | Dysk twardy 5400 obr./min | 12 |

| Mysz i klawiatura | 2 | Napęd optyczny | 30 |

Aby podłączyć dysk z interfejsem SAS, konieczne jest użycie kabla przedstawionego na ilustracji

Co nie ma wpływu na utratę danych z dysku HDD?

Najmniejszymi kątami widzenia charakteryzują się matryce monitorów typu

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

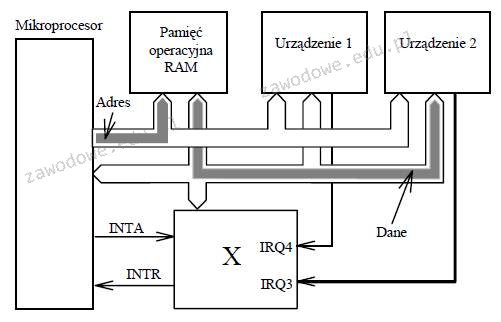

Na przedstawionym schemacie blokowym fragmentu systemu mikroprocesorowego, co oznacza symbol X?

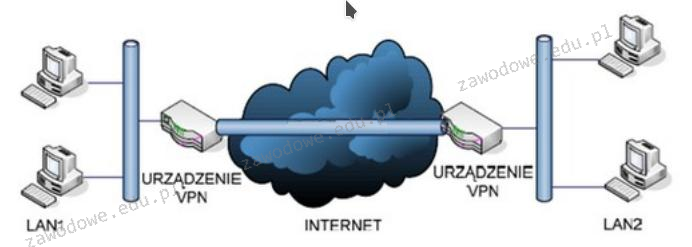

Schemat ilustruje zasadę funkcjonowania sieci VPN o nazwie

Ile hostów można zaadresować w podsieci z maską 255.255.255.248?

Który protokół jest odpowiedzialny za przekształcanie adresów IP na adresy MAC w kontroli dostępu do nośnika?

W adresacji IPv6 standardowy podział długości dla adresu sieci oraz identyfikatora hosta wynosi odpowiednio

Demon serwera Samba pozwala na udostępnianie plików oraz drukarek w sieci

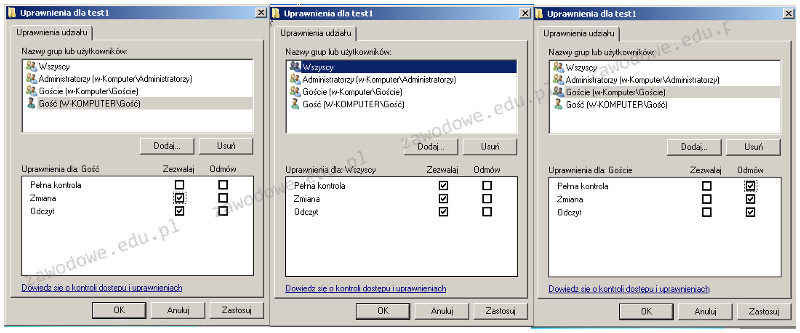

Użytkownik o nazwie Gość należy do grupy o nazwie Goście. Grupa Goście jest częścią grupy Wszyscy. Jakie ma uprawnienia użytkownik Gość w folderze test1?

W systemie Windows odpowiednikiem macierzy RAID 1 jest wolumin o nazwie

Członkowie grupy Pracownicy nie mają możliwości drukowania dokumentów za pośrednictwem serwera wydruku w systemie Windows Server. Posiadają jedynie przydzielone uprawnienia 'Zarządzanie dokumentami'. Co trzeba zrobić, aby rozwiązać ten problem?

Na świeżo zainstalowanym komputerze program antywirusowy powinno się zainstalować

Pomiar strukturalnego okablowania metodą Permanent Link polega na

Użytkownicy dysków SSD powinni unikać wykonywania następujących działań konserwacyjnych

Jak określa się niechciane oprogramowanie komputerowe, które zwykle instaluje się bez wiedzy użytkownika?

Który z komponentów NIE JEST zgodny z płytą główną MSI A320M Pro-VD-S socket AM4, 1x PCI-Ex16, 2x PCI-Ex1, 4x SATA III, 2x DDR4- max 32 GB, 1x D-SUB, 1x DVI-D, ATX?

Na stabilność obrazu w monitorach CRT istotny wpływ ma

Jaki jest główny cel stosowania maski podsieci?

Członkostwo komputera w danej sieci wirtualnej nie może być ustalane na podstawie

Liczba 10011001100 w systemie heksadecymalnym przedstawia się jako

Zjawisko, w którym pliki przechowywane na dysku twardym są umieszczane w nieprzylegających do siebie klastrach, nosi nazwę

Jakiego materiału używa się w drukarkach tekstylnych?