Pytanie 1

Do zaktualizowania rekordu tabeli należy zastosować polecenie

Wynik: 39/40 punktów (97,5%)

Wymagane minimum: 20 punktów (50%)

Do zaktualizowania rekordu tabeli należy zastosować polecenie

W jakim celu stosuje się podział użytkowników na grupy w systemie operacyjnym?

Jeżeli węzeł zatokowo–przedsionkowy będzie pobudzał serce generując bodźce elektryczne z częstotliwością 1 Hz, to wartość rytmu serca będzie wynosiła

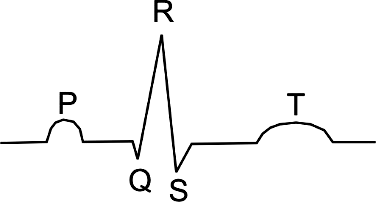

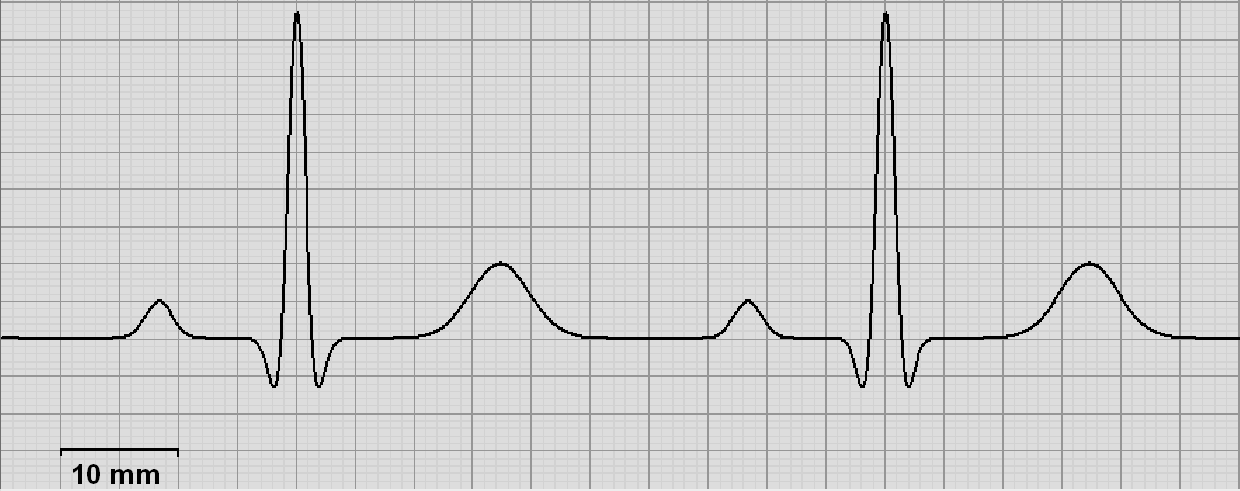

W sygnale elektrokardiograficznym za repolaryzację mięśnia komór odpowiada załamek

Dla której wartości z wymienionych rezystancji, zastosowanie układu poprawnie mierzonego prądu zapewnia najmniejszy błąd pomiaru?

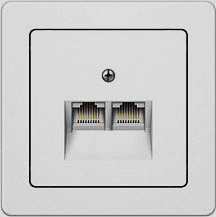

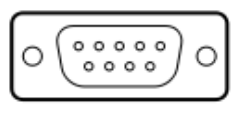

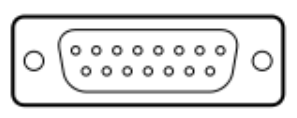

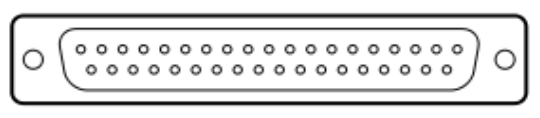

W sieci centralnego monitoringu zamontowane są gniazda przedstawione na rysunku. Jakiego typu wtykami muszą być zakończone kable?

Który system montażu urządzeń przedstawiono na rysunku?

Jak nazywa się w programowaniu obiektowym instancję klasy?

Aby zainstalować brakujące oprogramowanie w systemie z rodziny Linux należy wykorzystać polecenie

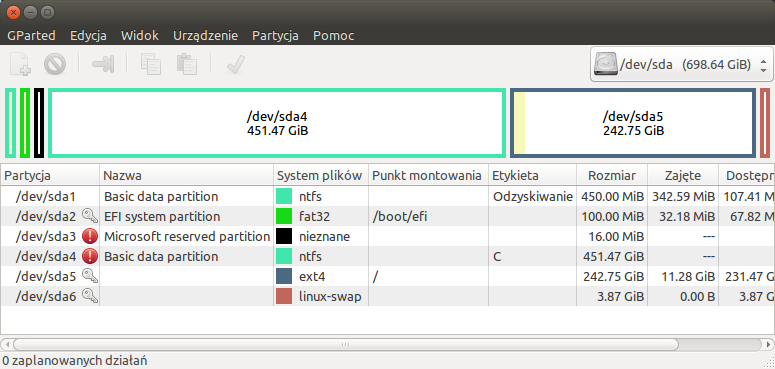

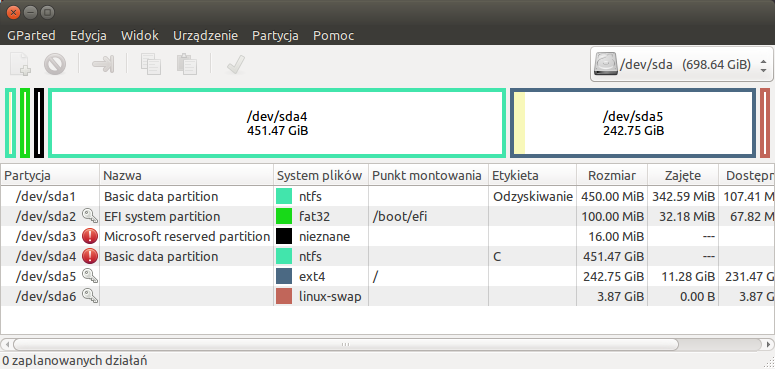

Które systemy operacyjne mogą być zainstalowane na dysku, którego działanie obrazuje GParted?

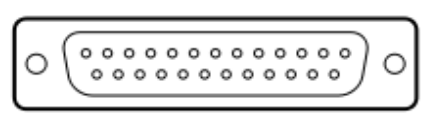

Do którego interfejsu (komunikacja z komputerem odbywa się poprzez port RS 232) należy podłączyć cykloergometr przeznaczony do współpracy z systemem do badań wysiłkowych?

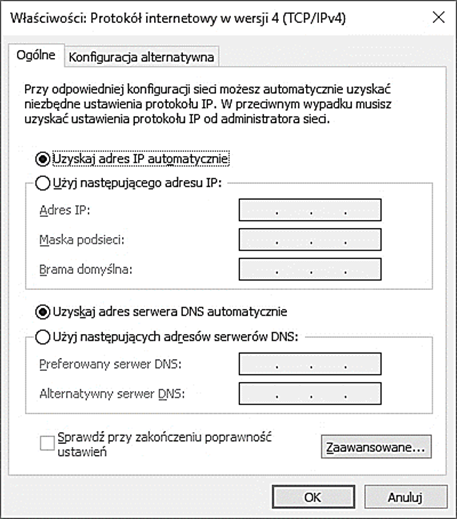

Aby karta sieciowa automatycznie uzyskiwała adres IP, ruter musi mieć włączony serwer

Ile dysków i z jakim interfejsem zostało wykazanych na zrzucie programu GParted?

Jaki format danych należy zastosować do archiwizacji, kompresji i szyfrowania danych?

W dokumentacji elektrokardiografu znajduje się informacja o wyposażeniu aparatu w filtry cyfrowe 50 Hz, 35 Hz i filtr antydriftowy. Które zakłócenia eliminuje z sygnału EKG filtr 50 Hz?

Który zasilacz pozwala na tymczasowe utrzymanie zasilania akumulatorowego w razie braku zasilania sieciowego?

Wymianą informacji pomiędzy układami znajdującymi się na płycie głównej komputera steruje

W celu archiwizacji danych w systemie Windows, jest wymagane kopiowanie z katalogu źródłowego (kat_zrodlowy) do katalogu docelowego (kat_docelowy). Do kopiowania danych należy użyć polecenia

Aby dodać nowe konto „rejestracja” w systemie Windows, należy wykorzystać polecenie

Jaki wpływ na organizm ludzki ma promieniowanie podczerwone IR?

Jaka jest prędkość przesuwu prezentowanego elektrokardiogramu, jeżeli zmierzona częstotliwość rytmu serca wynosi 60 uderzeń na minutę?

W programowaniu, aby przerwać wykonywanie pętli i wyjść z niej, należy użyć polecenia

Jaki wpływ na organizm ludzki ma krioterapia?

Aby uruchomić w systemie linux program nazwa.py, należy wpisać

W celu połączenia komputera z systemem do badań wysiłkowych komunikującym się za pomocą interfejsu opisanego przedstawionym symbolem, należy w ustawieniach systemu włączyć

Jeżeli procesor graficzny wykonuje także operacje arytmetyczne, oznacza to, że pracuje w architekturze

Zapisana w ramce funkcja zawiera

| Funkcja oblicz(n) Jeżeli n=0 oblicz=1 W przeciwnym wypadku oblicz=(n-1)*oblicz(n-1) |

Technologie SLI i CrossFire pozwalają na podłączenie dwóch kart

Na rysunku przedstawiono urządzenie z dodatkową kartą pamięci. Który rodzaj karty może zostać zastosowany w urządzeniu?

System informatyczny wymaga zabezpieczenia danych poprzez tworzenie kopii zapasowych. Dysponując 2 dyskami, można je połączyć w

Zapis w dokumentacji kardiotokografu „prezentacja sygnału FHR” dotyczy

Dla sieci o adresie 192.150.160.0/26 pula adresów IP dla urządzeń w tej sieci zawiera się w zakresie

Fale mózgowe alfa, beta, gamma, delta i theta są rejestrowane w

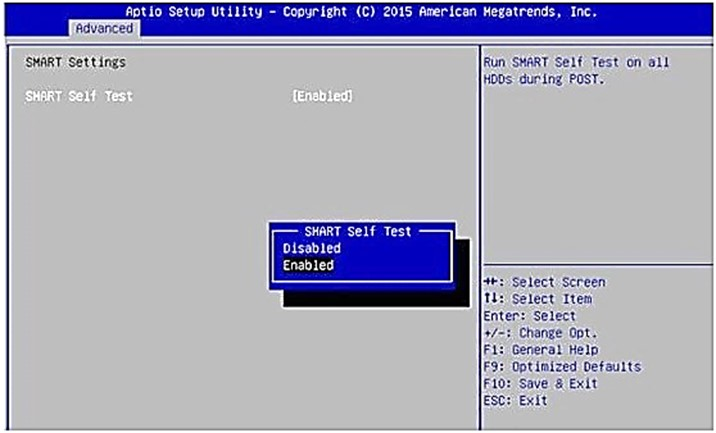

Jaką funkcję pełni przedstawiona na rysunku procedura BIOS?

Aby system komputerowy współpracujący z ultrasonografem mógł nagrywać na jednej płycie DVD dane z kolejnych, wykonywanych na bieżąco badań, musi być wyposażony w nagrywanie

Na którym rysunku przedstawiony jest interfejs zapewniający najwyższą prędkość transferu urządzeń elektroniki medycznej?

Podczas pracy z układami elektronicznymi CMOS na stanowisku montażowym należy stosować

Ile operacji inkrementacji wykonano w przedstawionej liście kroków?

i=0; Dopóki i>3 wykonaj i=i+1; |

Znak ~ na początku ciągu znaków w systemach uniksowych oznacza

W dokumentacji Medycznego Systemu Informatycznego zapisano, że „przed użyciem programów instalacyjnych należy się upewnić, że niektóre porty w środowisku są dostępne do użycia z instalowanym oprogramowaniem pośrednim.” W celu sprawdzenia dostępności portu należy użyć programu narzędziowego