Pytanie 1

Zaćma fotochemiczna jest wywoływana promieniowaniem

Wynik: 18/40 punktów (45,0%)

Wymagane minimum: 20 punktów (50%)

Zaćma fotochemiczna jest wywoływana promieniowaniem

Parametr CL (czas opóźnienia, jaki upływa między wysłaniem przez kontroler RAM żądania dostępu do kolumny pamięci a otrzymaniem danych z tej kolumny) jest wyrażany w

Zestaw przedstawiony na rysunku przeznaczony jest do przeprowadzania testu aparatu

Zapis w dokumentacji technicznej elektrokardiografu określający V1, V2, …V6 dotyczy odprowadzeń

Aby usunąć katalog w systemie Windows należy wykonać polecenie

Wynikiem działania funkcji F(n) będzie

funkcja F(n) jeżeli n>1 F(n)=3*F(n-1) w przeciwnym wypadku F(n)=3 |

Do zaktualizowania rekordu tabeli należy zastosować polecenie

Na którym rysunku przedstawiony jest interfejs zapewniający najwyższą prędkość transferu urządzeń elektroniki medycznej?

Pierwszym krokiem podczas prac serwisowych wymagających modyfikowania rejestru w systemie Windows jest wykonanie

Funkcja f(n) = nf(n-1) dla n>1 w przeciwnym wypadku f(n) = 1 jest przykładem

Który system informatyki medycznej umożliwia archiwizację obrazów?

Aby zapobiec utracie danych w programie obsługi przychodni, należy codziennie wykonywać

Dla której wartości z wymienionych rezystancji, zastosowanie układu poprawnie mierzonego prądu zapewnia najmniejszy błąd pomiaru?

Jaki format danych należy zastosować do archiwizacji, kompresji i szyfrowania danych?

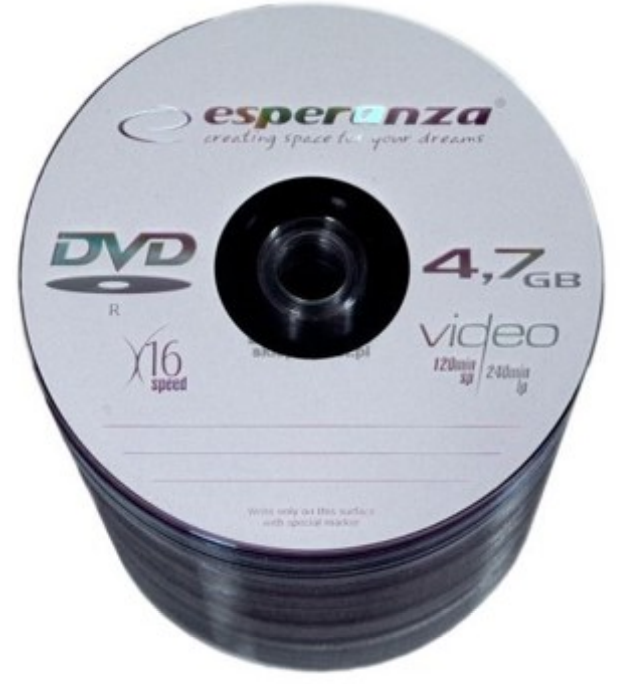

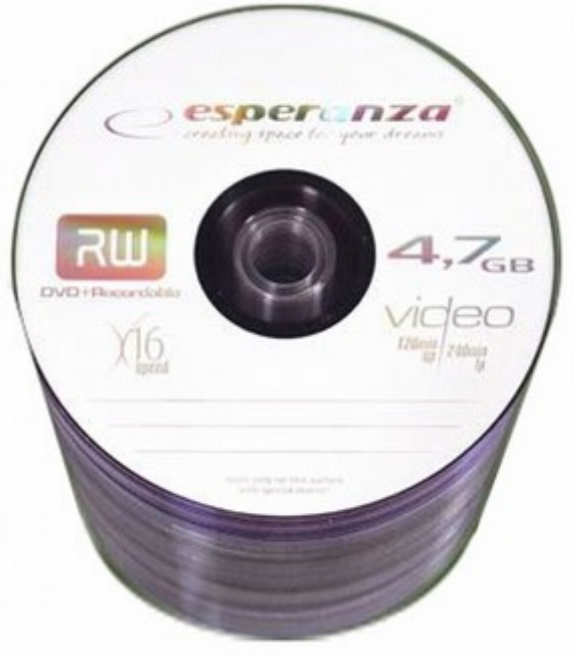

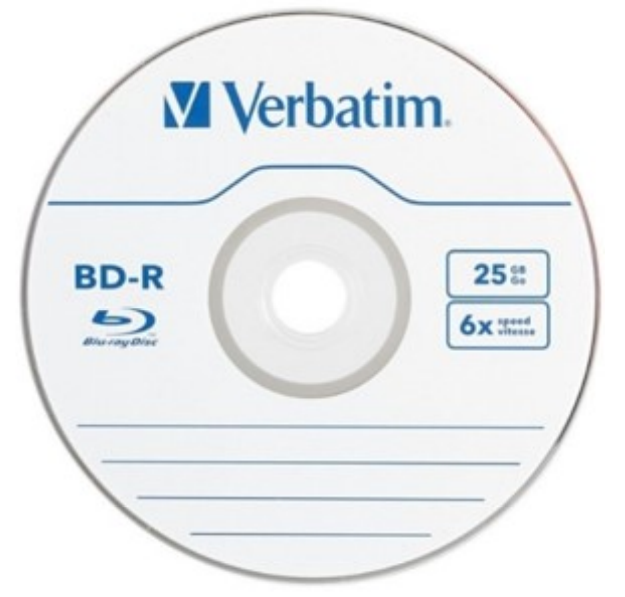

Który z nośników danych umożliwia wielokrotny zapis i ma największą pojemność?

W dokumentacji sieci centralnego monitoringu zapisano, że sieć jest wykonana w standardzie 802.11 Do montażu takiej sieci są wymagane urządzenia wykorzystujące

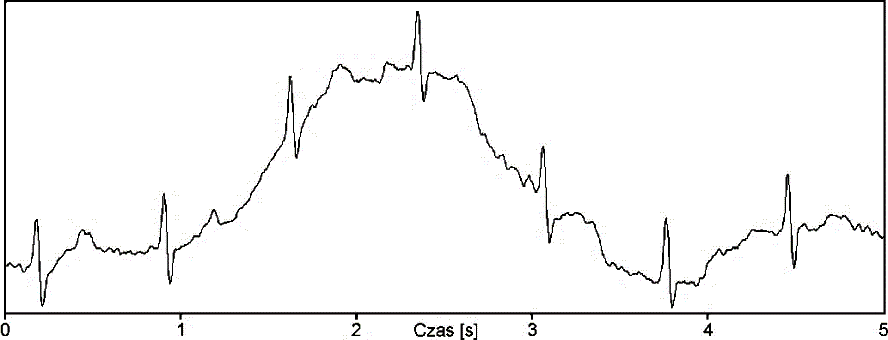

Urządzenie przedstawione na rysunku jest przeznaczone do

W celu podłączenia monitora do systemu wizualizacji obrazów wymagany jest interfejs Display Port. Ile takich interfejsów posiada karta graficzna przedstawiona na rysunku?

Podstawowym elementem sztucznej nerki jest pompa do przetłaczania krwi, zwana

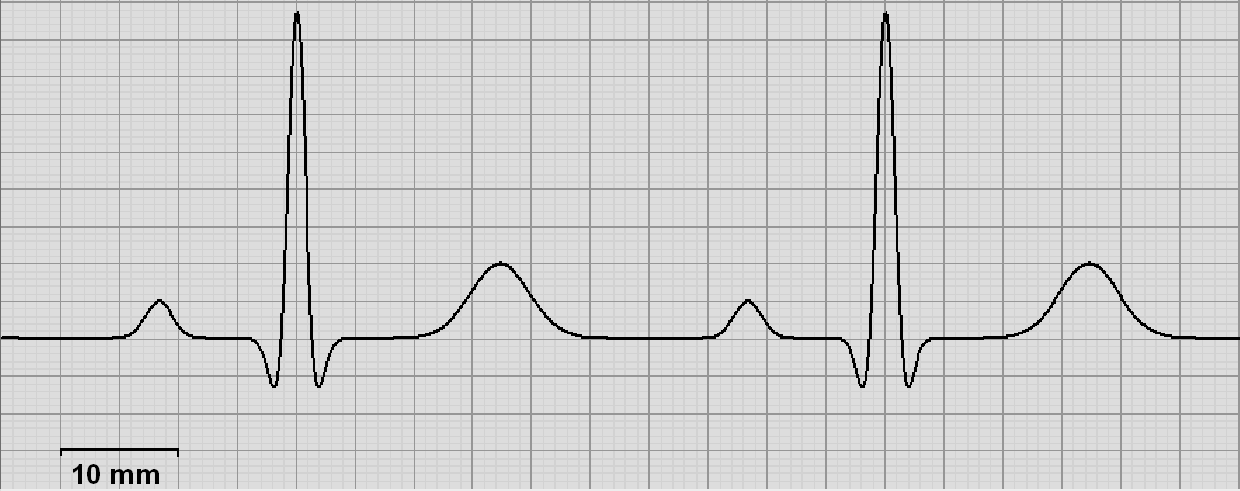

Jaka jest prędkość przesuwu prezentowanego elektrokardiogramu, jeżeli zmierzona częstotliwość rytmu serca wynosi 60 uderzeń na minutę?

W systemie komputerowym przeznaczonym do pracy z dużymi plikami graficznymi należy zwiększyć ilość

Którą metodę montażu należy zastosować w celu zakończenia przewodu zasilającego końcówkami przedstawionymi na fotografii?

Które badanie endoskopowe należy wykorzystać do wizualizacji jamy stawu?

Zjawisko polegające na zmianie częstotliwości fali odbitej od poruszającego się obiektu jest wykorzystywane w

Dokręcenie śrub mocujących z wartością momentu 6 Nm, zgodnie z instrukcją montażową, należy wykonać kluczem

Jak nazywa się w programowaniu obiektowym instancję klasy?

Na zdjęciu przedstawiono

Z elektrokardiogramu wynika, że rytm serca rejestrowany i wskazywany przez elektrokardiograf wynosi

W dokumentacji Medycznego Systemu Informatycznego zapisano, że „przed użyciem programów instalacyjnych należy się upewnić, że niektóre porty w środowisku są dostępne do użycia z instalowanym oprogramowaniem pośrednim.” W celu sprawdzenia dostępności portu należy użyć programu narzędziowego

Zapis w dokumentacji układu holterowskiego „metoda pomiaru – oscylometryczna” świadczy o możliwości monitorowania

Który rodzaj promieniowania jonizującego jest całkowicie pochłaniany przez naskórek, nie docierając do głębszych warstw tkanek?

W programowaniu obiektowym zmienne widoczne w ramach klasy oraz poza nią nazywane są

Jakiego typu papier należy zastosować w aparacie elektrokardiograficznym?

W dokumentacji skanera zapisano „rozdzielczość optyczna 600 x 600 [dpi]”. Skrót dpi określa liczbę punktów

Technika diagnostyki obrazowej polegająca na badaniu struktur serca i dużych naczyń krwionośnych za pomocą ultradźwięków jest określana skrótem

W programowaniu, aby przerwać wykonywanie pętli i wyjść z niej, należy użyć polecenia

Która magistrala służy do szeregowej transmisji danych?

Który system plików jest dedykowany systemowi Linux oraz nie jest używany w systemie Windows?

Promieniowanie IR jest wykorzystywane w

Który zabieg wymusza naprzemienną pracę mięśni zginaczy i prostowników poprzez stymulację mięśni impulsem prądowym?