Pytanie 1

Jaki element sieci SIP określamy jako telefon IP?

Wynik: 22/40 punktów (55,0%)

Wymagane minimum: 20 punktów (50%)

Jaki element sieci SIP określamy jako telefon IP?

Interfejs UDMA to interfejs

W systemie Windows informacje o aktualnym użytkowniku komputera są przechowywane w gałęzi rejestru o skróconej nazwie:

Jak określa się typ licencji, który pozwala na pełne korzystanie z programu, lecz można go uruchomić tylko przez ograniczoną, niewielką liczbę razy od momentu instalacji?

W systemie Linux, aby wyświetlić informację o nazwie bieżącego katalogu roboczego, należy zastosować polecenie

Usługa odpowiedzialna za konwersję nazw domen na adresy sieciowe to

Podstawowym warunkiem archiwizacji danych jest

Jaki jest największy rozmiar pojedynczego datagramu IPv4, uwzględniając jego nagłówek?

Jakie urządzenie służy do połączenia 6 komputerów w ramach sieci lokalnej?

Jaką maskę powinno się zastosować, aby podzielić sieć z adresem 192.168.1.0 na 4 podsieci?

Organizacja zajmująca się normalizacją na świecie, która stworzyła 7-warstwowy Model Referencyjny Otwartej Architektury Systemowej, to

Z jaką minimalną efektywną częstotliwością taktowania mogą działać pamięci DDR2?

Emisja dźwięków: jednego długiego oraz dwóch krótkich przez BIOS firmy AMI wskazuje na

Zgodnie z normą 802.3u w sieciach FastEthernet 100Base-FX stosuje się

Firma świadcząca usługi sprzątania potrzebuje drukować faktury tekstowe w czterech kopiach równocześnie, na papierze samokopiującym. Jaką drukarkę powinna wybrać?

Która operacja może skutkować nieodwracalną utratą danych w przypadku awarii systemu plików?

Według normy JEDEC, standardowe napięcie zasilające dla modułów pamięci RAM DDR3L o niskim napięciu wynosi

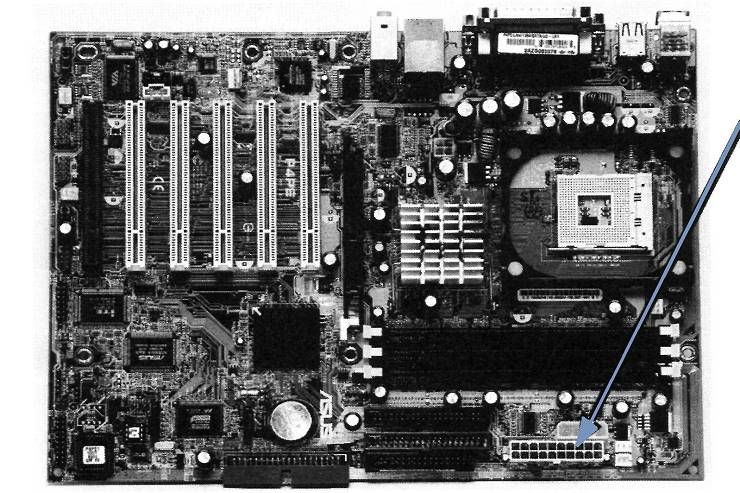

Na zdjęciu widać płytę główną komputera. Strzałka wskazuje na

Analiza tłumienia w kablowym systemie przesyłowym umożliwia ustalenie

Jakie narzędzie chroni komputer przed niechcianym oprogramowaniem pochodzącym z sieci?

Jaki adres IP w formacie dziesiętnym odpowiada adresowi IP 10101010.00001111.10100000.11111100 zapisanym w formacie binarnym?

Jakim interfejsem można uzyskać transmisję danych o maksymalnej przepustowości 6 Gb/s?

Narzędzie pokazane na ilustracji służy do

Aby bezpośrednio połączyć dwa komputery w przewodowej sieci LAN, należy zastosować

Które dwa urządzenia sieciowe CISCO wyposażone w moduły z portami smart serial można połączyć przy użyciu kabla szeregowego?

Na komputerze klienckim z systemem Windows XP plik "hosts" to plik tekstowy, który wykorzystywany jest do przypisywania

Błąd typu STOP w systemie Windows (Blue Screen), który występuje w momencie, gdy system odwołuje się do niepoprawnych danych w pamięci RAM, to

Do dynamicznej obsługi sprzętu w Linuxie jest stosowany system

Najwyższą prędkość transmisji danych w sieciach bezprzewodowych zapewnia standard

Zgodnie z aktualnymi przepisami BHP, odległość oczu od ekranu monitora powinna wynosić

W systemie Windows pamięć wirtualna ma na celu

Podczas próby zapisania danych na karcie SD wyświetla się komunikat „usuń ochronę przed zapisem lub skorzystaj z innego nośnika”. Najczęstszą przyczyną takiego komunikatu jest

Ile urządzeń jest w stanie współpracować z portem IEEE1394?

Jaki jest standard 1000Base-T?

Który z protokołów przesyła datagramy użytkownika BEZ GWARANCJI ich dostarczenia?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Która z wymienionych czynności nie jest związana z personalizacją systemu operacyjnego Windows?

Aby zapewnić łączność urządzenia mobilnego z komputerem za pośrednictwem interfejsu Bluetooth, konieczne jest

Jednym z metod ograniczenia dostępu do sieci bezprzewodowej dla osób nieuprawnionych jest

Cena wydrukowania jednej strony tekstu to 95 gr, a koszt przygotowania jednej płyty CD wynosi 1,54 zł. Jakie wydatki poniesie firma, tworząca płytę z prezentacjami oraz 120-stronicowy poradnik?