Pytanie 1

Zwiększenie napięcia na lampie rentgenowskiej powoduje

Wynik: 40/40 punktów (100,0%)

Wymagane minimum: 20 punktów (50%)

Zwiększenie napięcia na lampie rentgenowskiej powoduje

Wiązka elektronów najczęściej stosowana jest do leczenia zmian nowotworowych w obrębie

Dawka graniczna wyrażona jako dawka skuteczna (efektywna), dla osób zawodowo narażonych na działanie promieniowania jonizującego wynosi w ciągu roku kalendarzowego

Centratory laserowe zamontowane w kabinie aparatu terapeutycznego służą do

Wysoką rozdzielczość przestrzenną obrazowania MR uzyskuje się przez

Który radioizotop jest emiterem promieniowania alfa?

Która struktura może być oknem akustycznym w badaniu ultrasonograficznym?

Technika stereotaktyczna polega na napromienianiu nowotworu

Ligand stosuje się

W badaniu MR czas repetycji TR jest parametrem określającym odstęp czasu między

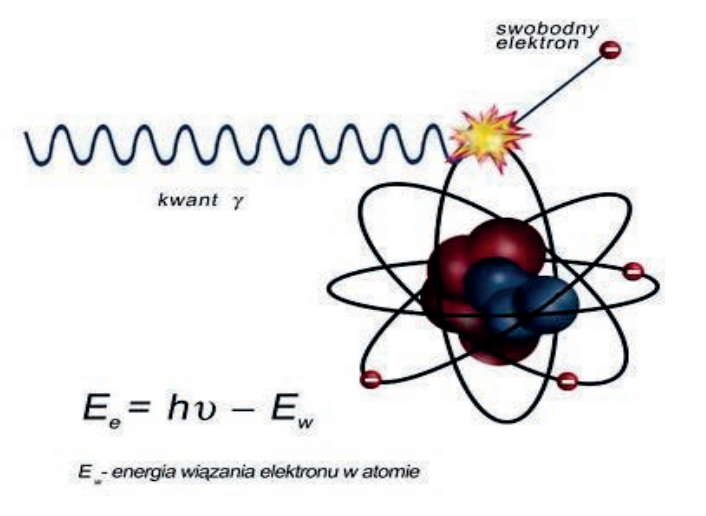

Promieniowanie jonizujące pośrednio to

W badaniu PET stosuje się tylko radioizotopy emitujące

Który system informatyczny służy do archiwizacji i transmisji obrazów radiologicznych?

Gruboziarnista folia wzmacniająca wpływa na zwiększenie na obrazie rentgenowskim nieostrości

Brachyterapia polegająca na wielokrotnym wsuwaniu i wysuwaniu źródła promieniowania do tego samego aplikatora nosi nazwę

Na zamieszczonej rycinie przedstawiono

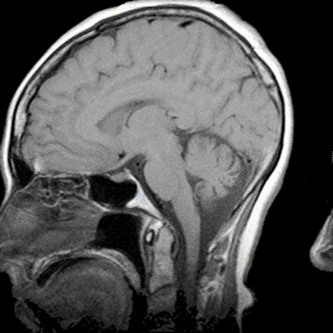

Który artefakt uwidoczniono na skanie RM głowy?

Jaka jest standardowa odległość OF do wykonania rentgenowskich zdjęć kości i stawów kończyny górnej?

W technice napromieniania SSD mierzona jest odległość źródła promieniowania

Z kratką przeciwrozproszeniową należy wykonać zdjęcie

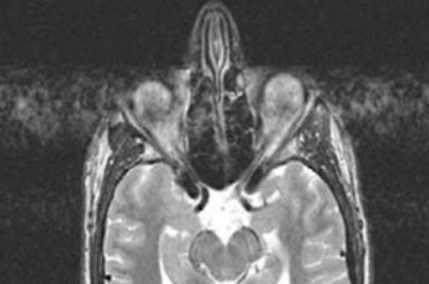

Co jest przyczyną artefaktu widocznego na obrazie MR?

Po zakończeniu badania angiograficznego należy zapisać w dokumentacji medycznej pacjenta:

W obrazowaniu MR wykorzystuje się moment magnetyczny

Wysoką rozdzielczość przestrzenną obrazowania MR uzyskuje się przez

Radiofarmaceutyki stosowane w medycynie nuklearnej powstają dzięki połączeniu radioizotopu

W radiografii mianem SID określa się

Folia wzmacniająca umieszczona w kasecie rentgenowskiej emituje pod wpływem promieniowania X światło

Który detektor w radiografii wymaga laserowego czytnika obrazu?

Kolimator wielolistkowy w akceleratorze liniowym jest stosowany do

Które środki kontrastujące wykorzystywane są w diagnostyce rezonansem magnetycznym?

Brachyterapia polegająca na wielokrotnym wsuwaniu i wysuwaniu źródła promieniowania do tego samego aplikatora nosi nazwę

Podstawowym elementem diagnostycznym aparatury izotopowej wykorzystującej emisyjne metody pomiaru jest

Jaka jest moc dawki pochłoniętej w brachyterapii HDR?

W medycznym przyspieszaczu liniowym jest generowana wiązka fotonów o energii w zakresie

W sekwencji echa spinowego obraz T2-zależny uzyskuje się przy czasie repetycji TR

Testy podstawowe z zakresu geometrii pola rentgenowskiego, przeznaczone do sprawdzenia zgodności pola wiązki promieniowania rentgenowskiego z symulacją świetlną, są wykonywane raz

W sekwencji echa spinowego obraz T2-zależny uzyskuje się przy czasie repetycji TR

Standardowo do wykonania których zdjęć należy zastosować kratkę przeciwrozproszeniową?

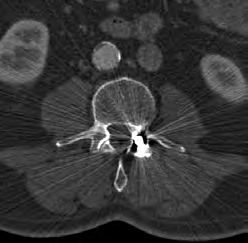

Który artefakt jest widoczny na skanie tomografii komputerowej?

W lampie rentgenowskiej promieniowanie X powstaje w wyniku hamowania