Pytanie 1

W systemie Linux plik posiada uprawnienia ustawione na 541. Właściciel ma możliwość pliku

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

W systemie Linux plik posiada uprawnienia ustawione na 541. Właściciel ma możliwość pliku

Jaką usługę trzeba zainstalować na serwerze, aby umożliwić korzystanie z nazw domen?

Jak można zaktualizować wprowadzone zmiany w konfiguracji systemu operacyjnego Windows, korzystając z edytora zasad grup?

Na rysunku ukazany jest diagram blokowy zasilacza

Wykorzystane kasety od drukarek powinny być

W topologii gwiazdy każde urządzenie działające w sieci jest

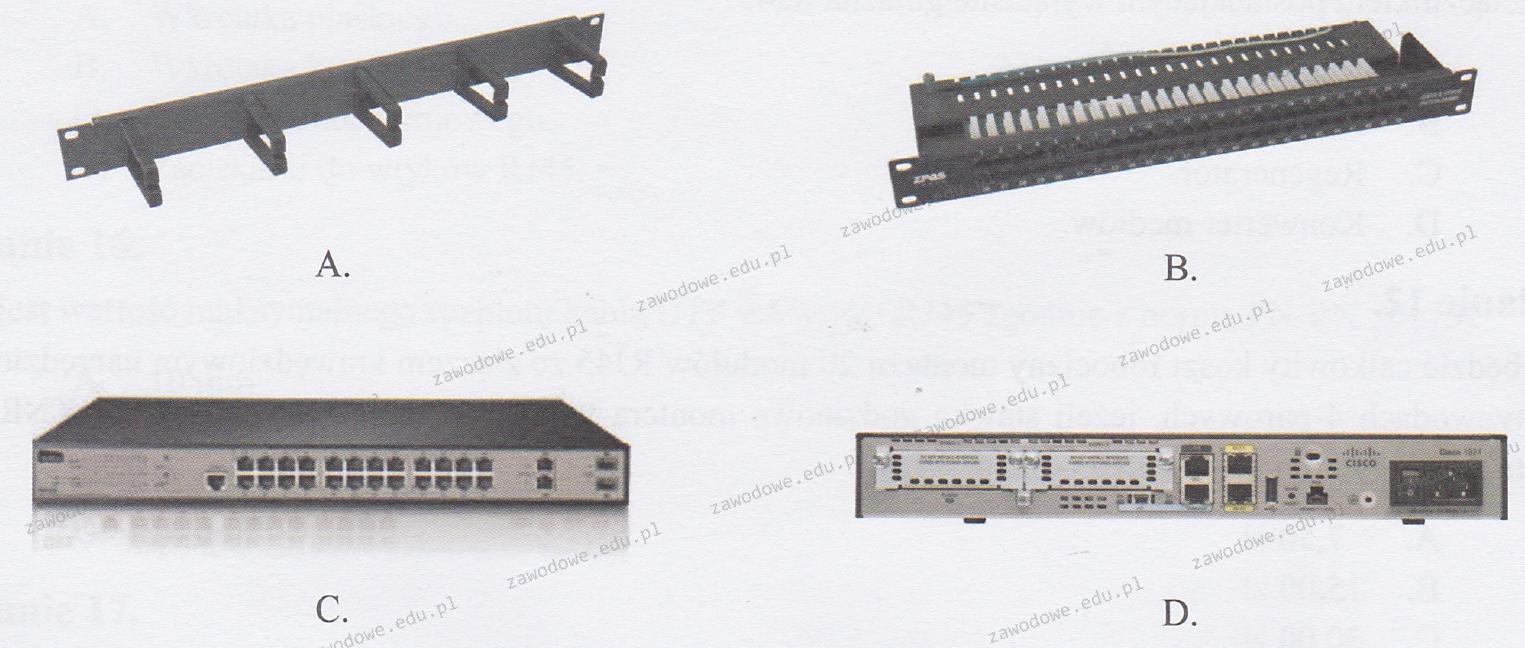

Na którym obrazku przedstawiono panel krosowniczy?

Do czego służy program firewall?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jaki tryb funkcjonowania Access Pointa jest wykorzystywany do umożliwienia urządzeniom bezprzewodowym łączności z przewodową siecią LAN?

Z jaką informacją wiąże się parametr TTL po wykonaniu polecenia ping?

Użytkownik systemu Linux, który pragnie usunąć konto innej osoby wraz z jej katalogiem domowym, powinien użyć polecenia

Aby była możliwa komunikacja pomiędzy dwiema różnymi sieciami, do których należą karty sieciowe serwera, należy w systemie Windows Server dodać rolę

Dobrze zaprojektowana sieć komputerowa powinna zapewniać możliwość rozbudowy, czyli charakteryzować się

Zgodnie z normą PN-EN 50174, poziome okablowanie w systemie strukturalnym to segment okablowania pomiędzy

Który z komponentów komputera można wymienić bez konieczności wyłączania zasilania?

W jakiej warstwie modelu ISO/OSI wykorzystywane są adresy logiczne?

Który adres IP jest przypisany do klasy A?

Podczas testowania połączeń sieciowych za pomocą polecenia ping użytkownik otrzymał wyniki przedstawione na rysunku. Jakie może być źródło braku odpowiedzi serwera przy pierwszym teście, zakładając, że domena wp.pl ma adres 212.77.100.101?

C:\Users\uczen>ping wp.pl

Żądanie polecenia ping nie może znaleźć hosta wp.pl. Sprawdź nazwę i ponów próbe.

C:\Users\uczen>ping 212.77.100.101

Badanie 212.77.100.101 z 32 bajtami danych:

Odpowiedź z 212.77.100.101: bajtów=32 czas=19ms TTL=127

Odpowiedź z 212.77.100.101: bajtów=32 czas=35ms TTL=127

Odpowiedź z 212.77.100.101: bajtów=32 czas=40ms TTL=127

Odpowiedź z 212.77.100.101: bajtów=32 czas=20ms TTL=127

Statystyka badania ping dla 212.77.100.101:

Pakiety: Wysłane = 4, Odebrane = 4, Utracone = 0

(0% straty),

Szacunkowy czas błądzenia pakietów w millisekundach:

Minimum = 19 ms, Maksimum = 40 ms, Czas średni = 28 msKtóry z podanych programów pozwoli na stworzenie technicznego rysunku ilustrującego plan instalacji logicznej sieci lokalnej w budynku?

Aby zainstalować usługę Active Directory w systemie Windows Server, konieczne jest uprzednie zainstalowanie oraz skonfigurowanie serwera

Wskaż ikonę programu stosowanego do rozpakowania archiwum plików RAR.

Na ilustracji zaprezentowano graficzny symbol

W którym systemie operacyjnym może pojawić się komunikat podczas instalacji sterowników dla nowego urządzenia?

| System.......nie może zweryfikować wydawcy tego sterownika. Ten sterownik nie ma podpisu cyfrowego albo podpis nie został zweryfikowany przez urząd certyfikacji. Nie należy instalować tego sterownika, jeżeli nie pochodzi z oryginalnego dysku producenta lub od administratora systemu. |

Który standard w połączeniu z odpowiednią kategorią kabla skrętki jest skonfigurowany w taki sposób, aby umożliwiać maksymalny transfer danych?

W doborze zasilacza do komputera kluczowe znaczenie

Protokół, który pozwala urządzeniom na uzyskanie od serwera informacji konfiguracyjnych, takich jak adres IP bramy sieciowej, to

Instalacja serwera stron www w rodzinie systemów Windows Server jest możliwa dzięki roli

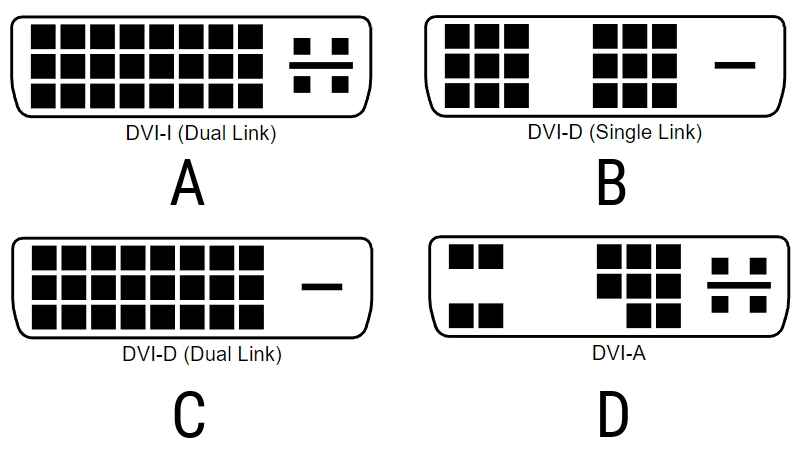

Który standard złącza DVI pozwala na przesyłanie jedynie sygnału analogowego?

Jakie polecenie w systemie operacyjnym Linux służy do prezentowania konfiguracji interfejsów sieciowych?

Urządzeniem w zestawie komputerowym, które obsługuje zarówno dane wejściowe, jak i wyjściowe, jest

Oblicz koszt realizacji okablowania strukturalnego od 5 punktów abonenckich do panelu krosowego, wliczając wykonanie kabli łączących dla stacji roboczych. Użyto przy tym 50 m skrętki UTP. Każdy punkt abonencki posiada 2 gniazda typu RJ45.

| Materiał | Jednostka | Cena |

|---|---|---|

| Gniazdo podtynkowe 45x45, bez ramki, UTP 2xRJ45 kat.5e | szt. | 17 zł |

| UTP kabel kat.5e PVC 4PR 305m | karton | 305 zł |

| RJ wtyk UTP kat.5e beznarzędziowy | szt. | 6 zł |

Jakie polecenie w systemie Windows powinno być użyte do obserwacji listy bieżących połączeń karty sieciowej w komputerze?

Wskaż rysunek ilustrujący symbol używany do oznaczania portu równoległego LPT?

W systemie Linux polecenie touch ma na celu

Proces zapisywania kluczy rejestru do pliku określamy jako

System operacyjny został poddany atakowi przez oprogramowanie szpiegujące. Po usunięciu problemów, aby zapobiec przyszłym atakom, należy

Jaką wartość ma moc wyjściowa (ciągła) zasilacza według parametrów przedstawionych w tabeli?

| Napięcie wyjściowe | +5 V | +3.3 V | +12 V1 | +12 V2 | -12 V | +5 VSB |

| Prąd wyjściowy | 18,0 A | 22,0 A | 18,0 A | 17,0 A | 0,3 A | 2,5 A |

| Moc wyjściowa | 120 W | 336W | 3,6 W | 12,5 W |

Które z metod szyfrowania wykorzystywanych w sieciach bezprzewodowych jest najsłabiej zabezpieczone przed łamaniem haseł?

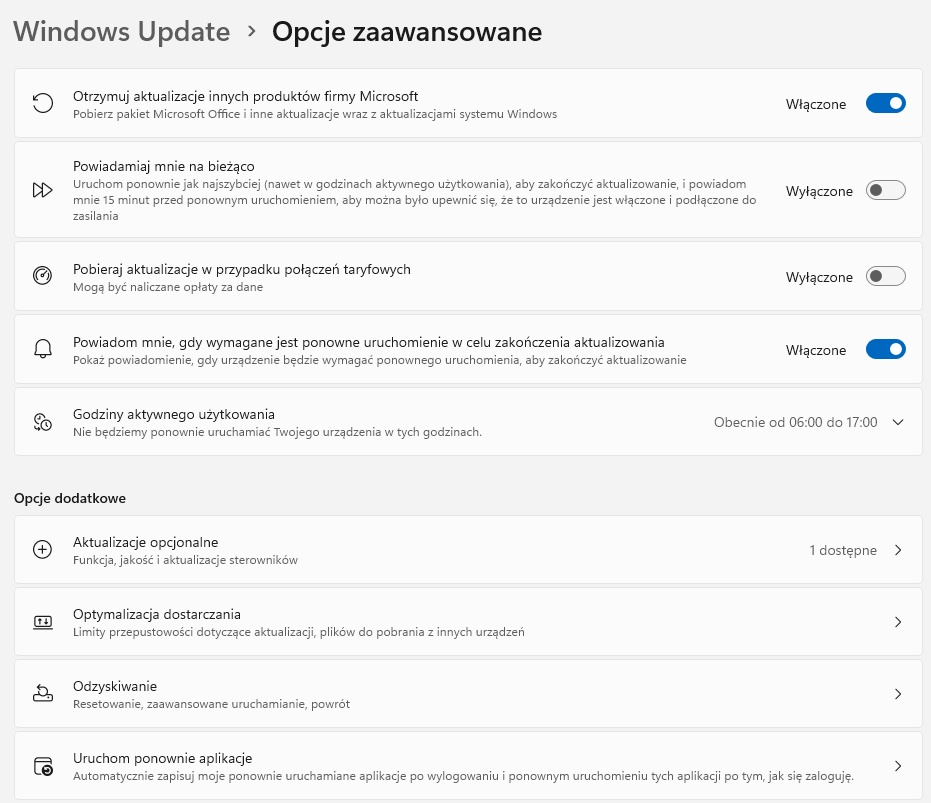

Biorąc pod uwagę konfigurację wykonywaną na ilustracji, administrator po zainstalowaniu systemu operacyjnego uznał za istotne, aby