Pytanie 1

Na których urządzeniach do przechowywania danych uszkodzenia mechaniczne są najczęściej spotykane?

Wynik: 39/40 punktów (97,5%)

Wymagane minimum: 20 punktów (50%)

Na których urządzeniach do przechowywania danych uszkodzenia mechaniczne są najczęściej spotykane?

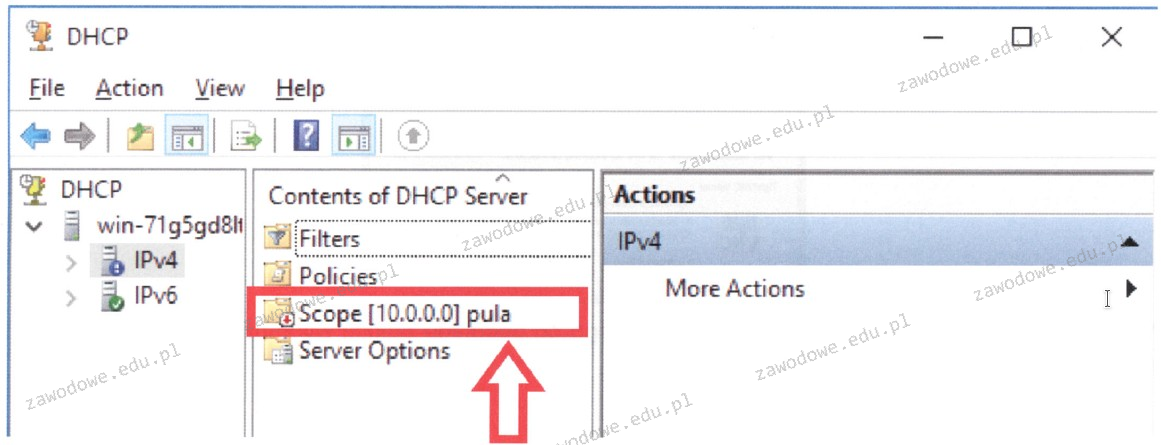

W systemie serwerowym Windows widoczny jest zakres adresów IPv4. Ikona umieszczona obok jego nazwy sugeruje, że

W systemie Windows, który obsługuje przydziały dyskowe, użytkownik o nazwie Gość

int a;

Podaną zmienną wyświetl na 2 sposoby.

Jakie porty powinny zostać zablokowane w firewallu, aby nie pozwolić na łączenie się z serwerem FTP?

W serwerach warto korzystać z dysków, które obsługują tryb Hot plugging, ponieważ

Diagnozowanie uszkodzonych komponentów komputera przez sprawdzenie stanu wyjściowego układu cyfrowego umożliwia

Jaki protokół jest stosowany do przesyłania danych w warstwie transportowej modelu ISO/OSI?

Podstawowym zadaniem mechanizmu Plug and Play jest

W systemie Windows do instalacji aktualizacji oraz przywracania sterowników urządzeń należy użyć przystawki

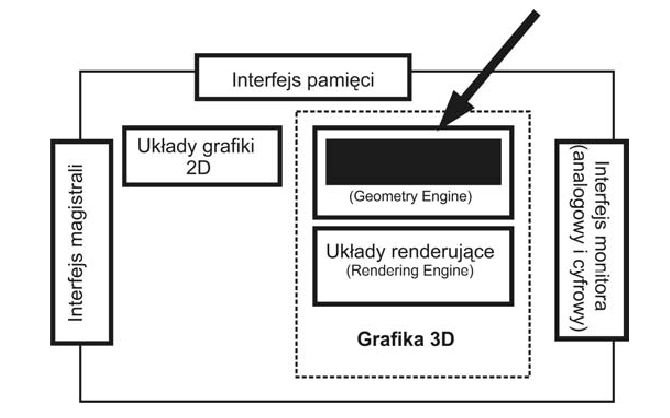

Jakie zadanie realizuje układ oznaczony strzałką na diagramie karty graficznej?

W sieci komputerowej działającej pod systemem Linux do udostępniania drukarek można zastosować serwer

Prawo majątkowe przysługujące twórcy programu komputerowego

Na początku procesu uruchamiania sprzętowego komputera, wykonywany jest test

Jaką konfigurację sieciową może posiadać komputer, który należy do tej samej sieci LAN co komputer z adresem 192.168.1.10/24?

W formacie plików NTFS, do zmiany nazwy pliku potrzebne jest uprawnienie

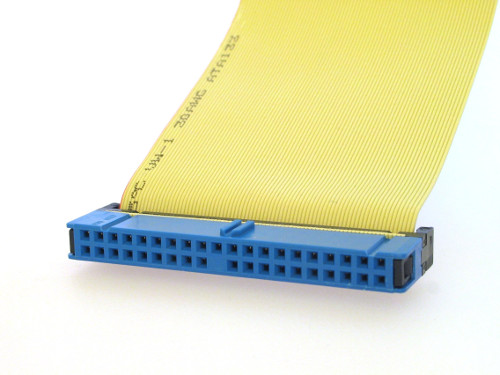

Na ilustracji pokazano wtyczkę taśmy kabel)

Zaprezentowany tylny panel płyty głównej zawiera następujące interfejsy:

Wskaż program do składu publikacji

Firma świadcząca usługi sprzątania potrzebuje drukować faktury tekstowe w czterech kopiach równocześnie, na papierze samokopiującym. Jaką drukarkę powinna wybrać?

Nie można uruchomić systemu Windows z powodu błędu oprogramowania. Jak można przeprowadzić diagnozę i usunąć ten błąd w jak najmniej inwazyjny sposób?

Wirus komputerowy to aplikacja, która

Jakie porty powinny być odblokowane w firewallu komputera, aby uzyskać dostęp do zainstalowanej usługi FTP?

Który program pozwoli na zarządzanie zasobami i czasem oraz stworzenie harmonogramu prac montażowych zgodnie z projektem sieci lokalnej w budynku?

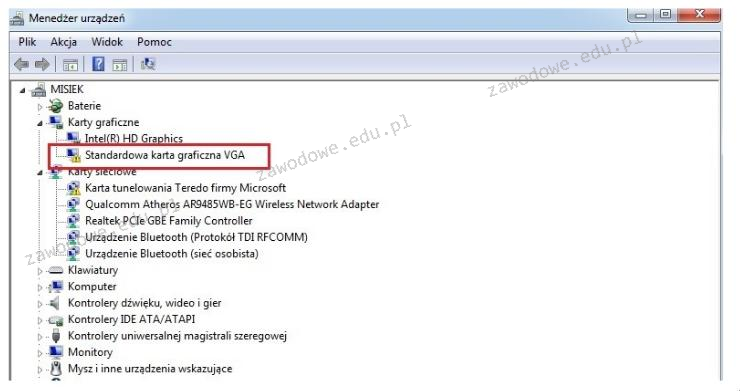

Który z interfejsów stanowi port równoległy?

Czynnikiem zagrażającym bezpieczeństwu systemu operacyjnego, który zmusza go do automatycznej aktualizacji, są

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Złącze widoczne na obrazku pozwala na podłączenie

Na ilustracji widoczny jest komunikat systemowy. Jaką czynność powinien wykonać użytkownik, aby naprawić występujący błąd?

Aby sprawdzić statystyki użycia pamięci wirtualnej w systemie Linux, należy sprawdzić zawartość pliku

Jakie oznaczenie wskazuje adres witryny internetowej oraz przypisany do niej port?

Ilustracja pokazuje panel ustawień bezprzewodowego urządzenia dostępowego, który umożliwia

Instalacja systemów Linux oraz Windows 7 przebiegła bez żadnych problemów. Systemy zainstalowały się poprawnie z domyślnymi ustawieniami. Na tym samym komputerze, przy tej samej konfiguracji, podczas instalacji systemu Windows XP pojawił się komunikat o braku dysków twardych, co może sugerować

Które polecenie pozwala na mapowanie zasobów sieciowych w systemie Windows Serwer?

Na którym z zewnętrznych nośników danych nie dojdzie do przeniknięcia wirusa podczas przeglądania jego zawartości?

Granice domeny kolizyjnej nie są określane przez porty takich urządzeń jak

Podczas uruchamiania komputera wyświetla się komunikat CMOS checksum error press F1 to continue, press Del to setup) naciśnięcie klawisza Del skutkuje

Protokół transportowy bez połączenia w modelu ISO/OSI to

Ustawienie rutingu statycznego na ruterze polega na

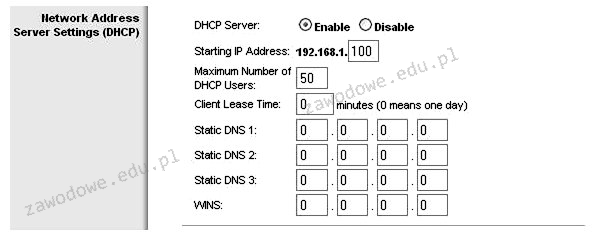

Jakie polecenie należy wprowadzić w wierszu polecenia systemów Windows Server, aby zaktualizować dzierżawy adresów DHCP oraz przeprowadzić rejestrację nazw w systemie DNS?