Pytanie 1

Norma opisująca standard transmisji Gigabit Ethernet to

Wynik: 28/40 punktów (70,0%)

Wymagane minimum: 20 punktów (50%)

Norma opisująca standard transmisji Gigabit Ethernet to

Jakie medium transmisyjne charakteryzuje się najmniejszym ryzykiem zakłóceń elektromagnetycznych sygnału przesyłanego?

Aby ustalić fizyczny adres karty sieciowej, w terminalu systemu Microsoft Windows należy wpisać komendę

Jaką częstotliwość odświeżania należy ustawić, aby obraz na monitorze był odświeżany 85 razy na sekundę?

Jak nazywa się seria procesorów produkowanych przez firmę Intel, charakteryzująca się małymi wymiarami oraz niskim zużyciem energii, zaprojektowana z myślą o urządzeniach mobilnych?

Symbol błyskawicy pokazany na rysunku jest używany do oznaczania złącza

Aby uzyskać na ekranie monitora odświeżanie obrazu 85 razy w ciągu sekundy, trzeba częstotliwość jego odświeżania ustawić na

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Która z anten charakteryzuje się najwyższym zyskiem energetycznym oraz pozwala na nawiązywanie połączeń na dużą odległość?

Podaj nazwę funkcji przełącznika, która pozwala na przypisanie wyższego priorytetu dla transmisji VoIP?

NAT64 (Network Address Translation 64) to proces, który przekształca adresy

W firmie konieczne jest regularne wykonywanie kopii zapasowych znacznych ilości danych, które znajdują się na serwerze, osiągających kilka set GB. Jakie urządzenie będzie najbardziej odpowiednie do realizacji tego zadania?

Dostosowanie ustawień parametrów TCP/IP urządzenia na podstawie adresu MAC karty sieciowej jest funkcją protokołu

W której warstwie modelu ISO/OSI odbywa się segmentacja danych, komunikacja w trybie połączeniowym z użyciem protokołu TCP oraz komunikacja w trybie bezpołączeniowym z zastosowaniem UDP?

Industry Standard Architecture to norma magistrali, według której szerokość szyny danych wynosi

Co wskazuje oznaczenie danego procesora?

Moduł funkcjonalny, który nie znajduje się w kartach dźwiękowych, to skrót

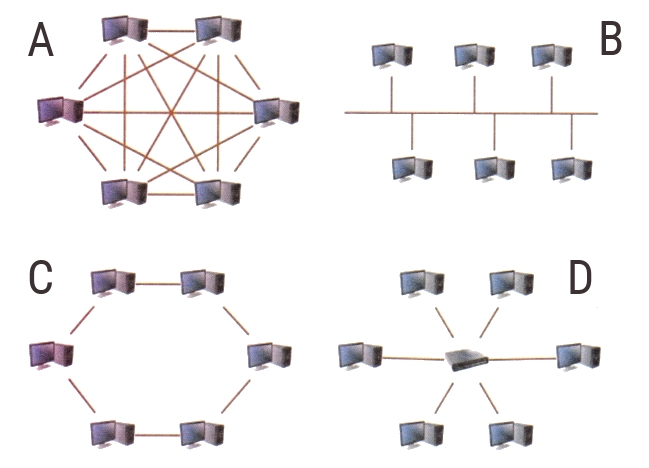

Która z przedstawionych na rysunkach topologii jest topologią siatkową?

Usługa odpowiedzialna za konwersję nazw domen na adresy sieciowe to

W systemie Linux do bieżącego śledzenia działających procesów wykorzystuje się polecenie:

Wskaż złącze żeńskie o liczbie pinów 24 lub 29, które jest w stanie przesyłać skompresowany cyfrowy sygnał do monitora?

Osoba korzystająca z komputera udostępnia w sieci Internet pliki, które posiada. Prawa autorskie będą złamane, gdy udostępni

Gdy użytkownik zauważy, że ważne pliki zniknęły z dysku twardego, powinien

Jakie polecenie w systemie Linux przyzna możliwość zapisu dla wszystkich obiektów w /usr/share dla wszystkich użytkowników, nie modyfikując innych uprawnień?

Aby zmierzyć tłumienie światłowodowego łącza w dwóch zakresach długości fal 1310 nm i 1550 nm, należy zastosować

W systemie Linux narzędzie do śledzenia zużycia CPU, pamięci, procesów oraz obciążenia systemu z poziomu terminala to

Jaką maksymalną prędkość transferu danych umożliwia interfejs USB 3.0?

Do przechowywania fragmentów dużych plików programów i danych, które nie mieszczą się w pamięci, wykorzystuje się

Zgodnie z normą PN-EN 50174, maksymalna długość kabla poziomego kategorii 6 pomiędzy punktem abonenckim a punktem dystrybucji w panelu krosowym wynosi

Co umożliwia zachowanie jednolitego rozkładu temperatury pomiędzy procesorem a radiatorem?

Funkcja systemu operacyjnego, która umożliwia jednoczesne uruchamianie wielu aplikacji w trybie podziału czasu, z tym że realizacja tego podziału odbywa się przez same aplikacje, nosi nazwę

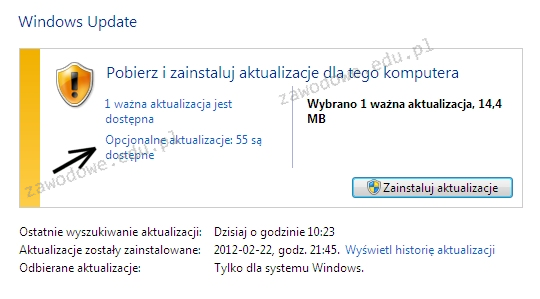

Jeżeli użytkownik zaznaczy opcję wskazaną za pomocą strzałki, będzie miał możliwość instalacji aktualizacji

Pamięć RAM ukazana na grafice jest instalowana w płycie głównej z gniazdem

Aby wymusić na użytkownikach lokalnych systemów z rodziny Windows Server regularną zmianę haseł oraz stosowanie haseł o odpowiedniej długości, które spełniają kryteria złożoności, należy ustawić

Który symbol przedstawia przełącznik?

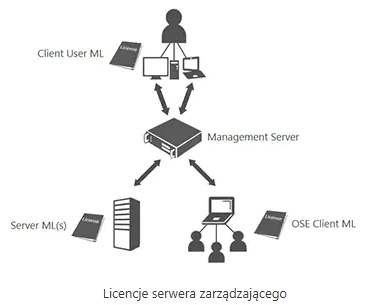

Wskaż model licencjonowania serwera zarządzającego (Management Serwer), oferowanego firmom przez Microsoft, którego schemat przedstawiono na ilustracji.

Jaką funkcję pełni mechanizm umożliwiający przechowywanie fragmentów dużych plików programów i danych, które nie mogą być w pełni załadowane do pamięci?

Usługa umożliwiająca przechowywanie danych na zewnętrznym serwerze, do którego dostęp możliwy jest przez Internet to

Jakie znaczenie ma termin "wykonanie kopii zapasowej systemu"?

Wskaź na błędny układ dysku z użyciem tablicy partycji MBR?