Pytanie 1

Ile operacji inkrementacji wykonano w przedstawionej liście kroków?

i=0; Dopóki i>3 wykonaj i=i+1; |

Wynik: 24/40 punktów (60,0%)

Wymagane minimum: 20 punktów (50%)

Ile operacji inkrementacji wykonano w przedstawionej liście kroków?

i=0; Dopóki i>3 wykonaj i=i+1; |

Zapis w dokumentacji układu holterowskiego „metoda pomiaru – oscylometryczna” świadczy o możliwości monitorowania

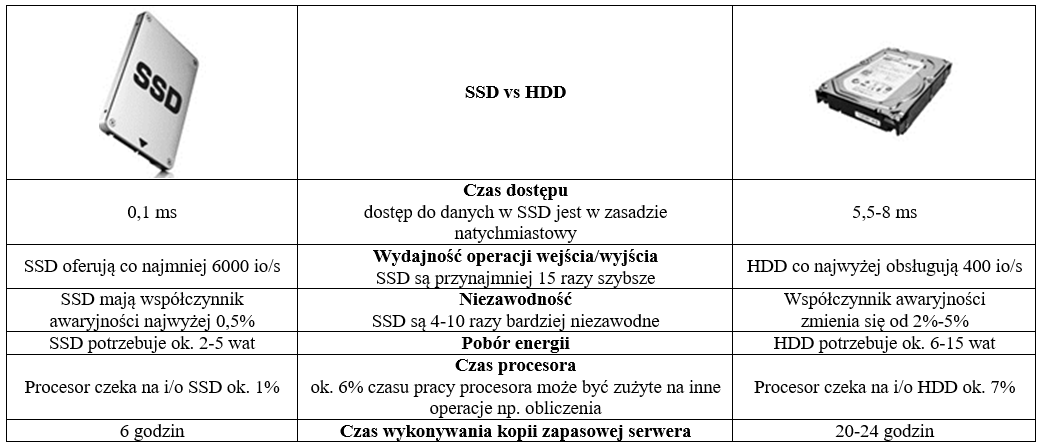

W tabeli zestawiono parametry pamięci półprzewodnikowej i pamięci magnetycznej. Zastosowanie którego rodzaju pamięci umożliwi szybszą pracę komputera?

W celu połączenia komputera z systemem do badań wysiłkowych komunikującym się za pomocą interfejsu opisanego przedstawionym symbolem, należy w ustawieniach systemu włączyć

Operacje stałoprzecinkowe w procesorze wykonuje jednostka oznaczona jako

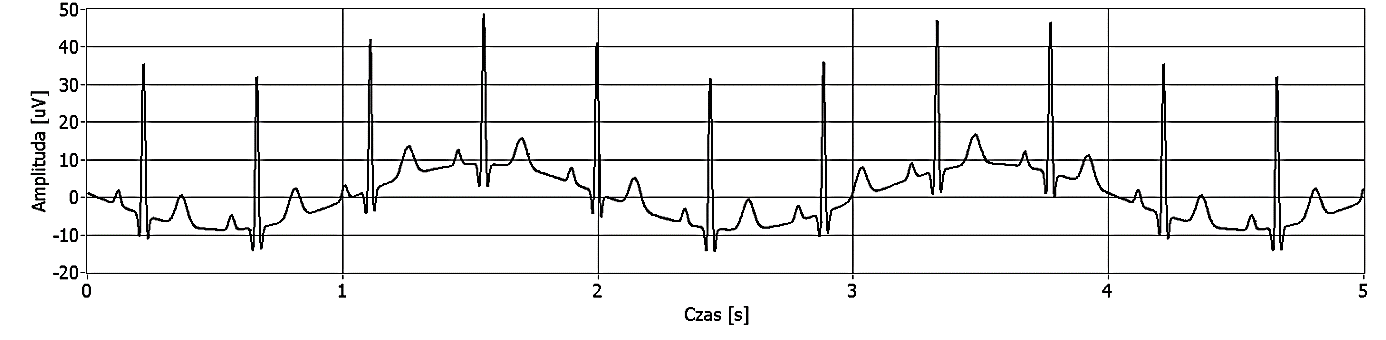

Podczas testowania elektrokardiografu otrzymano przedstawiony przebieg. Na jego podstawie stwierdzono, że nieprawidłowo działa filtr zakłóceń

Zapis w dokumentacji technicznej elektrokardiografu określający V1, V2, …V6 dotyczy odprowadzeń

Dla sieci o adresie 192.150.160.0/26 pula adresów IP dla urządzeń w tej sieci zawiera się w zakresie

Który sterownik odpowiada za bezpośredni dostęp do pamięci?

Urządzenie przedstawione na rysunku jest przeznaczone do

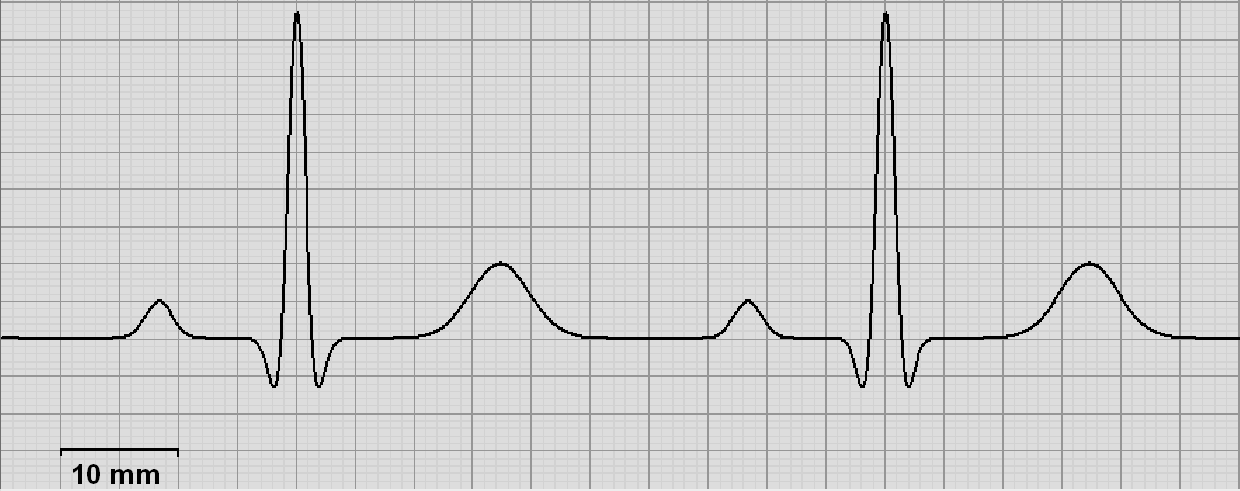

Jaka jest prędkość przesuwu prezentowanego elektrokardiogramu, jeżeli zmierzona częstotliwość rytmu serca wynosi 60 uderzeń na minutę?

Wysłanie obrazów z urządzenia diagnostycznego do serwera PACS odbywa się zgodnie ze standardem

Proces, w którym w bazie danych są usuwane nadmiarowe dane, jest określany jako

Procesor GPU jest odpowiedzialny za wykonywanie operacji obliczeniowych w karcie

Zjawisko polegające na zmianie częstotliwości fali odbitej od poruszającego się obiektu jest wykorzystywane w

Która tkanka najsilniej pochłania fale ultradźwiękowe?

Nie uzyskamy pomocy na temat polecenia „net” w wierszu poleceń systemu Windows wpisując

Które oznaczenie określa zapis elektryczny aktywności mózgu?

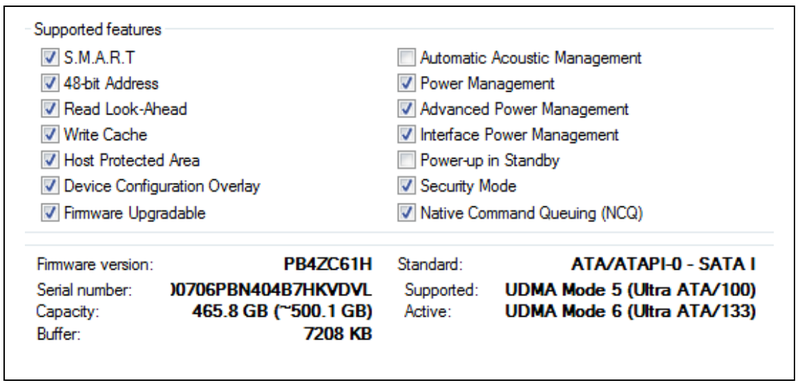

Przedstawiony zrzut ekranu prezentuje parametry

W opisanym programie zostaną wykonane 4

for (i=0;i<=3;i++) suma=suma+i; |

Rysunek przedstawia wynik działania polecenia ipconfig urządzenia w sieci LAN. Który adres rutera umożliwia dostęp tego urządzenia do sieci WAN?

Z przedstawionej dokumentacji pamięci wynika że jest ona przeznaczona do

rodzaj pamięci : SO-DIMM standard : DDR3-1333 (PC3-10600) pojemność pojedynczego modułu : 4 GB |

Programowanie obiektowe wykorzystuje dziedziczenie, które polega na

Organizm człowieka ma zakłóconą zdolność do termoregulacji, gdy wartość temperatury wewnętrznej organizmu spada poniżej

Do zaktualizowania rekordu tabeli należy zastosować polecenie

Jeżeli węzeł zatokowo–przedsionkowy będzie pobudzał serce generując bodźce elektryczne z częstotliwością 1 Hz, to wartość rytmu serca będzie wynosiła

Do badania przewodnictwa powietrznego i kostnego służy

Zaćma fotochemiczna jest wywoływana promieniowaniem

Do badań ultrasonograficznych struktur płytko położonych (np. tarczycy) stosuje się głowicę

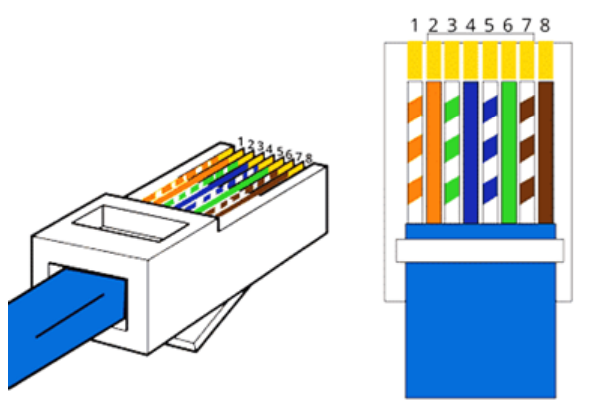

W którym standardzie jest wykonane zakończenie przewodu sieciowego przedstawione na rysunku?

| 1. White Orange | 5. White Blue |

| 2. Orange | 6. Green |

| 3. White Green | 7. White Brown |

| 4. Blue | 8. Brown |

Jaki wpływ na organizm ludzki ma krioterapia?

Elementem sieci komputerowej w topologii gwiazdy, pozwalającym przyłączyć wiele urządzeń sieciowych, jest

Rysunek przedstawia raport sprawdzający połączenie pomiędzy stacjami monitorującymi informatycznego systemu medycznego. Którego polecenia należy użyć aby go uzyskać?

Zapis w dokumentacji kardiotokografu „prezentacja sygnału FHR” dotyczy

Którego nośnika pamięci należy użyć w komputerze, aby zapewnić najszybsze ładowanie się systemu operacyjnego podczas jego uruchamiania?

Najważniejszą cechą pamięci operacyjnych serwerowych jest ich niezawodność, dlatego powinny być wyposażone w mechanizm kontroli błędów określany skrótem

Na rysunku przedstawiono kartę rozszerzeń umożliwiającą

W celu przerwania działania funkcji i powrotu do miejsca jej wywołania należy użyć instrukcji

Który przyrząd należy wybrać celem sprawdzenia poprawnej prędkości transmisji danych na łączu RS232 urządzenia elektroniki medycznej?

Które badanie endoskopowe należy wykorzystać do wizualizacji jamy stawu?