Pytanie 1

Zaprezentowany tylny panel płyty głównej zawiera następujące interfejsy:

Wynik: 29/40 punktów (72,5%)

Wymagane minimum: 20 punktów (50%)

Zaprezentowany tylny panel płyty głównej zawiera następujące interfejsy:

Komunikat tekstowy BIOS POST od firmy Award o treści "Display switch is set incorrectly" sugeruje

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

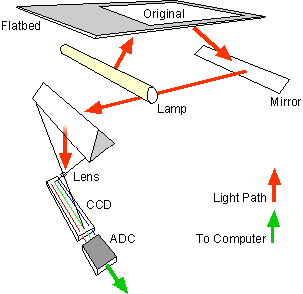

Przedstawiony schemat przedstawia zasadę działania

Jaką rolę pełni usługa NAT działająca na ruterze?

Pamięć RAM pokazana na ilustracji jest instalowana na płycie głównej posiadającej gniazdo

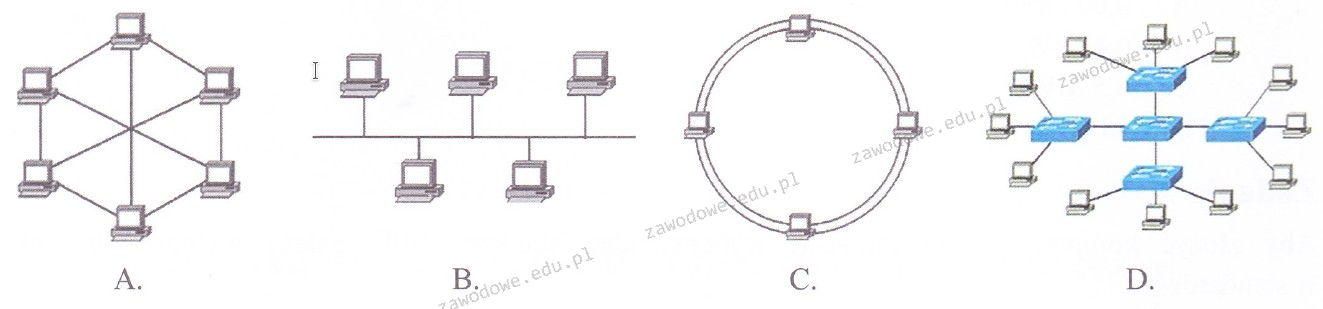

Na którym z przedstawionych rysunków ukazano topologię sieci typu magistrala?

Jaką usługę należy zainstalować na systemie Linux, aby umożliwić bezpieczny zdalny dostęp?

W systemie Linux komenda, która pozwala na wyświetlenie informacji o aktywnych procesach, to

W biurowcu należy podłączyć komputer do routera ADSL za pomocą przewodu UTP Cat 5e. Jaka powinna być maksymalna odległość między komputerem a routerem?

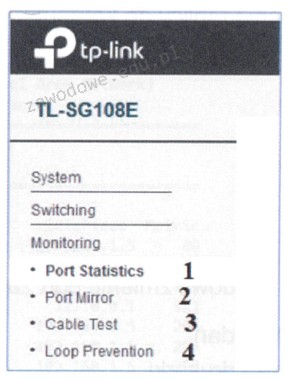

Aby sprawdzić stan podłączonego kabla oraz zdiagnozować odległość do miejsca awarii w sieci, należy użyć funkcji przełącznika oznaczonej numerem

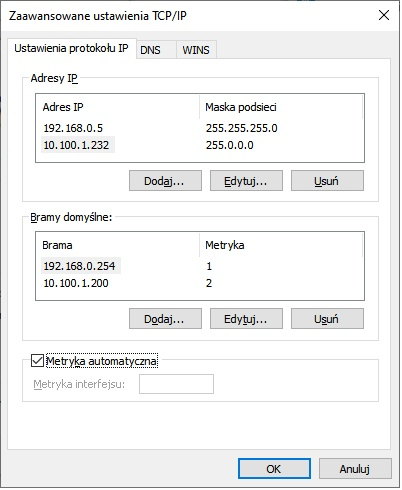

Na podstawie przedstawionej na ilustracji konfiguracji, w przypadku, gdy komputer żąda połączenia z inną siecią, w pierwszej kolejności dane zostaną wysłane do urządzenia o adresie

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

Aby w systemie Windows ustawić właściwości wszystkich zainstalowanych urządzeń lub wyświetlić ich listę, należy użyć narzędzia

Użytkownicy dysków SSD powinni unikać wykonywania następujących działań konserwacyjnych

W systemie Linux program top umożliwia

Jakie narzędzie jest używane do diagnozowania łączności między hostami w systemie Windows?

Aby uniknąć różnic w kolorystyce pomiędzy zeskanowanymi zdjęciami na wyświetlaczu komputera a ich oryginałami, konieczne jest przeprowadzenie

Ile adresów urządzeń w sieci jest dostępnych dzięki zastosowaniu klasy adresowej C w systemach opartych na protokołach TCP/IP?

Na dysku należy umieścić 100 tysięcy oddzielnych plików, z których każdy ma rozmiar 2570 bajtów. W takim przypadku, zapisane pliki będą zajmować najmniej miejsca na dysku z jednostką alokacji wynoszącą

Program firewall nie zapewnia ochrony przed

Protokół, który pozwala urządzeniom na uzyskanie od serwera informacji konfiguracyjnych, takich jak adres IP bramy sieciowej, to

Kluczowe znaczenie przy tworzeniu stacji roboczej, na której ma funkcjonować wiele maszyn wirtualnych, ma:

Jaką metodę stosuje się do dostępu do medium transmisyjnego z wykrywaniem kolizji w sieciach LAN?

Jaką liczbę bitów posiada adres logiczny IPv6?

Urządzenie klienckie automatycznie uzyskuje adres IP od serwera DHCP. W sytuacji, gdy serwer DHCP przestanie działać, karcie sieciowej przydzielony zostanie adres IP z przedziału

Który z poniższych protokołów jest używany do bezpiecznego przesyłania danych w sieci?

Program antywirusowy oferowany przez Microsoft bezpłatnie dla posiadaczy legalnych wersji systemu operacyjnego Windows to

W dokumentacji jednego z komponentów komputera zamieszczono informację, że to urządzenie obsługuje OpenGL. Jakiego elementu dotyczy ta dokumentacja?

Co jest przyczyną wysokiego poziomu przesłuchu zdalnego w kablu?

Jaką funkcję pełni mechanizm umożliwiający przechowywanie fragmentów dużych plików programów i danych, które nie mogą być w pełni załadowane do pamięci?

Który rodzaj pracy Access Pointa jest używany, aby umożliwić urządzeniom bezprzewodowym dostęp do przewodowej sieci LAN?

Jak nazywa się protokół warstwy transportowej modelu TCP/IP, który nie gwarantuje dostarczenia danych?

Jaką maksymalną długość kabla typu skrętka pomiędzy panelem krosowniczym a gniazdem abonenckim przewiduje norma PN-EN 50174-2?

Jakim parametrem definiuje się stopień zmniejszenia mocy sygnału w danej parze przewodów po przejściu przez cały tor kablowy?

W systemie Windows konto użytkownika można założyć za pomocą polecenia

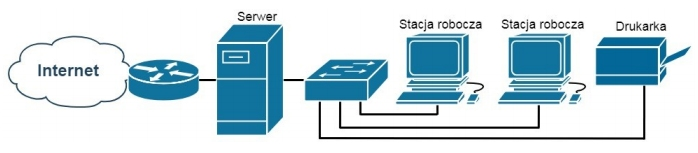

Która funkcja serwera Windows umożliwia użytkownikom końcowym sieci pokazanej na rysunku dostęp do Internetu?

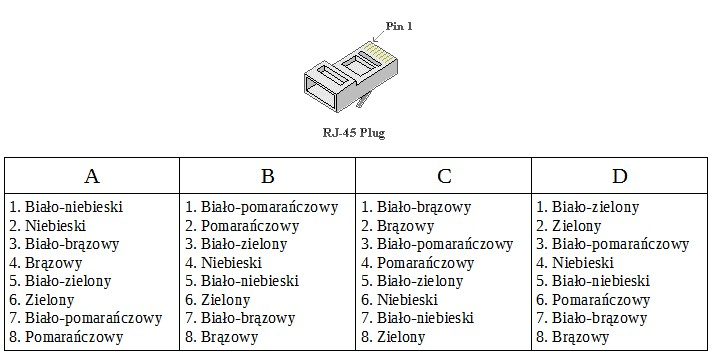

Jakie jest usytuowanie przewodów w złączu RJ45 według schematu T568A?

Wskaż błędny podział dysku MBR na partycje?

Użytkownik systemu Windows napotyka komunikaty o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?