Pytanie 1

Który rodzaj kopii zapasowej należy wybrać, aby wykonać przyrostową kopię danych?

Wynik: 7/40 punktów (17,5%)

Wymagane minimum: 20 punktów (50%)

Który rodzaj kopii zapasowej należy wybrać, aby wykonać przyrostową kopię danych?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Aby wyświetlić przedstawioną informację o systemie Linux w terminalu, należy użyć polecenia

Aby umożliwić jedynie wybranym urządzeniom dostęp do sieci WiFi, konieczne jest w punkcie dostępowym

Jakie porty powinny być odblokowane w firewallu komputera, aby uzyskać dostęp do zainstalowanej usługi FTP?

Wszystkie ustawienia użytkowników komputera są przechowywane w gałęzi rejestru oznaczonej akronimem

Według modelu TCP/IP protokoły DNS, FTP i SMTP są przypisane do warstwy

Jaka usługa, opracowana przez firmę Microsoft, pozwala na konwersję nazw komputerów na adresy URL?

W którym programie należy zmodyfikować ustawienia, aby użytkownik komputera mógł wybrać z menu i uruchomić jeden z kilku systemów operacyjnych zainstalowanych na jego komputerze?

Jak można skonfigurować interfejs sieciowy w systemie Linux, modyfikując plik

Jakie narzędzie w systemie Windows pozwala na kontrolowanie stanu sprzętu, aktualizowanie sterowników oraz rozwiązywanie problemów z urządzeniami?

Które z poleceń systemu Linux nie umożliwia przeprowadzenia diagnostyki sprzętu komputerowego?

Użytkownicy z grupy Pracownicy nie mają możliwości drukowania dokumentów za pośrednictwem serwera drukarskiego w systemie operacyjnym Windows Server. Przysługuje im jedynie uprawnienie 'Zarządzanie dokumentami'. Co należy uczynić, aby rozwiązać przedstawiony problem?

Lokalny komputer dysponuje adresem 192.168.0.5. Po otwarciu strony internetowej z tego urządzenia, która identyfikuje adresy w sieci, uzyskano informację, że adresem komputera jest 195.182.130.24. Co to oznacza?

Jakie zagrożenia eliminują programy antyspyware?

Aby stworzyć las w strukturze AD DS (Active Directory Domain Services), konieczne jest utworzenie przynajmniej

Jaki typ rozbudowy serwera wymaga zainstalowania dodatkowych sterowników?

Program wirusowy, którego zasadniczym zamiarem jest samoistne rozprzestrzenianie się w sieci komputerowej, to:

Po podłączeniu działającej klawiatury do któregokolwiek z portów USB nie ma możliwości wyboru awaryjnego trybu uruchamiania systemu Windows. Jednakże, klawiatura funkcjonuje prawidłowo po uruchomieniu systemu w standardowym trybie. Co to sugeruje?

Jaką minimalną ilość pamięci RAM powinien mieć komputer, aby zainstalować 32-bitowy system operacyjny Windows 7 i móc efektywnie korzystać z trybu graficznego?

Informacje ogólne dotyczące zdarzeń systemowych w systemie Linux są zapisywane w

Podaj domyślny port używany do przesyłania poleceń (command) w serwerze FTP

W trakcie konserwacji oraz czyszczenia drukarki laserowej, która jest odłączona od zasilania, pracownik serwisu komputerowego może zastosować jako środek ochrony osobistej

Administrator pragnie udostępnić w sieci folder c:\instrukcje tylko trzem użytkownikom z grupy Serwisanci. Jakie działanie powinien podjąć?

Główny księgowy powinien mieć możliwość przywracania zawartości folderów z kopii zapasowej plików. Do jakiej grupy użytkowników w systemie MS Windows XP powinien zostać przypisany?

Jakie jest główne zadanie programu Wireshark?

Do zainstalowania serwera proxy w systemie Linux, konieczne jest zainstalowanie aplikacji

W wierszu poleceń systemu Windows polecenie md jest używane do

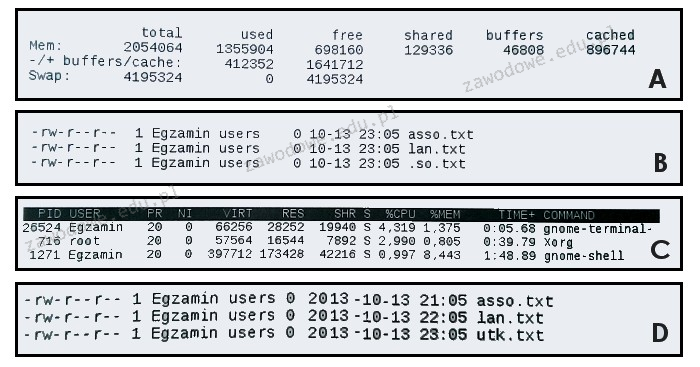

Wynik wykonania polecenia ```ls -l``` w systemie Linux przedstawia poniższy rysunek

Do zrealizowania macierzy RAID 1 wymagane jest co najmniej

Jakim procesem jest nieodwracalne usunięcie możliwości odzyskania danych z hard dysku?

Lokalny komputer posiada adres 192.168.0.5. Po otwarciu strony internetowej z tego urządzenia, która rozpoznaje adresy w sieci, wyświetla się informacja, że jego adres to 195.182.130.24. Co to oznacza?

Użytkownik laptopa z systemem Windows 7 widzi dostępne sieci Wi-Fi przedstawione na rysunku. Przy konfiguracji połączenia z siecią Z1 musi określić dla tej sieci

Który z protokołów umożliwia szyfrowanie połączenia?

Termin gorącego podłączenia (hot-plug) wskazuje, że podłączane urządzenie działa

Po zainstalowaniu systemu Windows 7 zmieniono konfigurację dysku SATA w BIOS-ie komputera z AHCI na IDE. Przy ponownym uruchomieniu komputera system będzie

Programem antywirusowym oferowanym bezpłatnie przez Microsoft dla posiadaczy legalnych wersji systemu Windows jest

Zainstalowanie serwera WWW w środowisku Windows Server zapewnia rola

Aby osiągnąć wysoką jakość połączeń głosowych VoIP kosztem innych przesyłanych informacji, konieczne jest włączenie i skonfigurowanie na routerze usługi

Podstawowym zadaniem mechanizmu Plug and Play jest