Pytanie 1

Jakie elementy łączy okablowanie pionowe w sieci LAN?

Wynik: 11/40 punktów (27,5%)

Wymagane minimum: 20 punktów (50%)

Jakie elementy łączy okablowanie pionowe w sieci LAN?

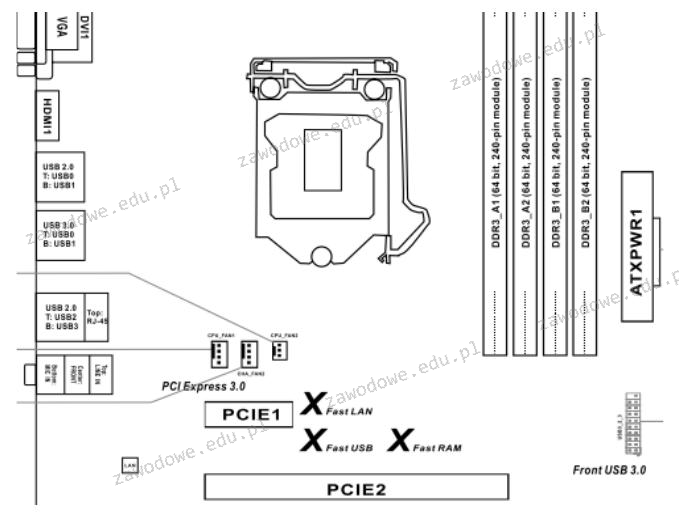

Na wskazanej płycie głównej możliwe jest zainstalowanie procesora w obudowie typu

Technik serwisowy, po przeprowadzeniu testu na serwerze NetWare, otrzymał informację, że obiekt dysponuje prawem

Moduł funkcjonalny, który nie znajduje się w kartach dźwiękowych, to skrót

Złącze umieszczone na płycie głównej, które umożliwia podłączanie kart rozszerzeń o różnych ilościach pinów, w zależności od wersji, nazywane jest

Podczas zmiany ustawień rejestru Windows w celu zapewnienia bezpieczeństwa operacji, na początku należy

Jakie polecenie jest używane do monitorowania statystyk protokołów TCP/IP oraz bieżących połączeń sieciowych w systemach operacyjnych z rodziny Windows?

Jaka jest maska dla adresu IP 192.168.1.10/8?

Jakiego typu rozbudowa serwera wymaga zainstalowania dodatkowych sterowników?

Jaki jest adres rozgłoszeniowy (broadcast) dla hosta z adresem IP 192.168.35.202 oraz maską 26 bitową?

W jakich jednostkach opisuje się przesłuch zbliżny NEXT?

Który z standardów korzysta z częstotliwości 5 GHz?

W systemie Linux komenda ps wyświetli

W trakcie instalacji systemu Windows, zaraz po rozpoczęciu instalacji w trybie graficznym, istnieje możliwość otwarcia Wiersza poleceń (konsoli) za pomocą kombinacji klawiszy

Przydzielaniem adresów IP w sieci zajmuje się serwer

Na zdjęciu widoczny jest

Jakie protokoły przesyłają cykliczne kopie tablic routingu do sąsiadującego rutera i NIE ZAWIERAJĄ pełnych informacji o dalekich ruterach?

Element płyty głównej, który jest odpowiedzialny za wymianę danych między procesorem a innymi komponentami płyty, to

W jakiej warstwie modelu ISO/OSI wykorzystywane są adresy logiczne?

Wynikiem wykonania komendy arp -a 192.168.1.1 w systemie MS Windows jest pokazanie

Wskaź zestaw do diagnostyki logicznych układów elektronicznych umiejscowionych na płycie głównej komputera, który nie reaguje na próby uruchomienia zasilania?

Aby zminimalizować ryzyko wyładowań elektrostatycznych podczas wymiany komponentów komputerowych, technik powinien wykorzystać

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Prawo majątkowe twórcy dotyczące oprogramowania komputerowego

Usługa, umożliwiająca zdalną pracę na komputerze z systemem Windows z innego komputera z systemem Windows, który jest połączony z tą samą siecią lub z Internetem, to

Jakie protokoły są właściwe dla warstwy internetowej w modelu TCP/IP?

W wyniku polecenia net accounts /MINPWLEN:11 w systemie Windows, wartość 11 będzie przypisana do

Co należy zrobić, aby chronić dane przesyłane w sieci przed działaniem sniffera?

Wskaż technologię stosowaną do zapewnienia dostępu do Internetu w połączeniu z usługą telewizji kablowej, w której światłowód oraz kabel koncentryczny pełnią rolę medium transmisyjnego

Urządzeniem wejściowym komputera, realizującym z najwyższą precyzją funkcje wskazujące w środowisku graficznym 3D, jest

ARP (Adress Resolution Protocol) jest protokołem, który umożliwia przekształcenie adresu IP na

Z jakim protokołem związane są terminy 'sequence number' oraz 'acknowledgment number'?

Sequence number: 117752 (relative sequence number) Acknowledgment number: 33678 (relative ack number) Header Length: 20 bytes Flags: 0x010 (ACK) Window size value: 258

Jaki jest adres rozgłoszeniowy w sieci mającej adres IPv4 192.168.0.0/20?

Urządzenie sieciowe funkcjonujące w trzeciej warstwie modelu ISO/OSI, posługujące się adresami IP, to

Element na karcie graficznej, który ma za zadanie przekształcenie cyfrowego sygnału wytwarzanego przez kartę na analogowy sygnał, zdolny do wyświetlenia na monitorze to

Który standard w połączeniu z odpowiednią kategorią kabla skrętki jest skonfigurowany w taki sposób, aby umożliwiać maksymalny transfer danych?

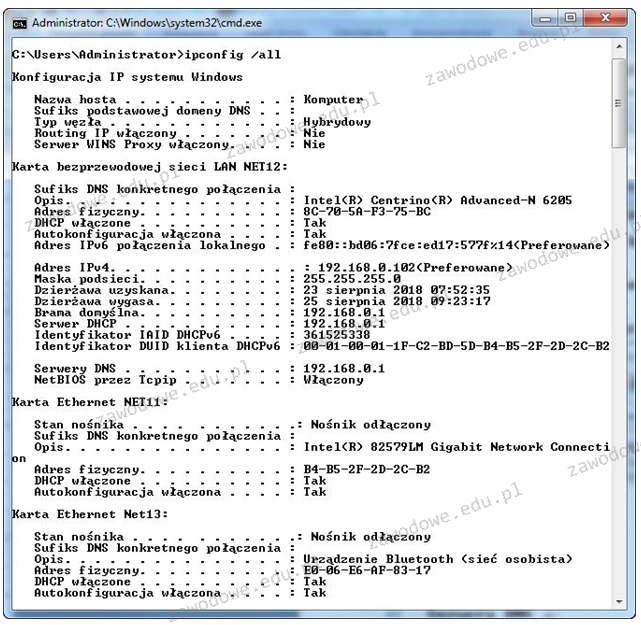

Analizując przedstawione wyniki konfiguracji zainstalowanych kart sieciowych na komputerze, można zauważyć, że

Jaka jest maksymalna ilość pamięci RAM w GB, do której może uzyskać dostęp 32-bitowa wersja systemu Windows?

Industry Standard Architecture to standard magistrali, który określa, że szerokość szyny danych wynosi:

Z informacji przedstawionych w tabeli wynika, że efektywna częstotliwość pamięci DDR SDRAM wynosi

| 184 styki |

| 64-bitowa szyna danych |

| Pojemność 1024 MB |

| Przepustowość 3200 MB/s |