Pytanie 1

W przypadku zalania układu elektronicznego klawiatury słodkim napojem należy natychmiast odłączyć ją od zestawu komputerowego, a następnie

Wynik: 19/40 punktów (47,5%)

Wymagane minimum: 20 punktów (50%)

W przypadku zalania układu elektronicznego klawiatury słodkim napojem należy natychmiast odłączyć ją od zestawu komputerowego, a następnie

Hosty A i B nie mają możliwości komunikacji z hostem C. Natomiast komunikacja między hostami A i B przebiega poprawnie. Jakie może być źródło problemu w komunikacji pomiędzy hostami A i C oraz B i C?

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Jakie działanie może skutkować nieodwracalną utratą danych w przypadku awarii systemu plików?

Komputer prawdopodobnie jest zainfekowany wirusem typu boot. Jakie działanie umożliwi usunięcie wirusa w najbardziej nieinwazyjny sposób dla systemu operacyjnego?

Która struktura partycji pozwala na stworzenie do 128 partycji podstawowych na pojedynczym dysku?

Aplikacją systemu Windows, która umożliwia analizę wpływu różnych procesów i usług na wydajność CPU oraz oceny stopnia obciążenia pamięci i dysku, jest

Na podstawie danych z "Właściwości systemu" można stwierdzić, że na komputerze zainstalowano fizycznie pamięć RAM o pojemności

| Komputer: Intel(R) Pentium (R)4 CPU 1.8GHz AT/XT Compatible 523 760 kB RAM |

Problemy z laptopem, objawiające się zmienionymi barwami lub brakiem określonego koloru na ekranie, mogą być spowodowane uszkodzeniem

W jednostce ALU do akumulatora została zapisana liczba dziesiętna 240. Jak wygląda jej reprezentacja w systemie binarnym?

Jaką liczbę dziesiętną reprezentuje liczba 11110101U2)?

Moc zasilacza wynosi 450 W, co oznacza, że

Jakie zastosowanie ma oprogramowanie Microsoft Hyper-V?

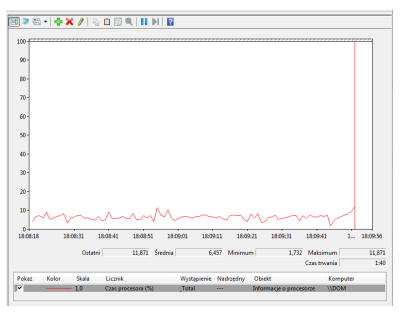

Aby zainicjować w systemie Windows oprogramowanie do monitorowania wydajności komputera przedstawione na ilustracji, należy otworzyć

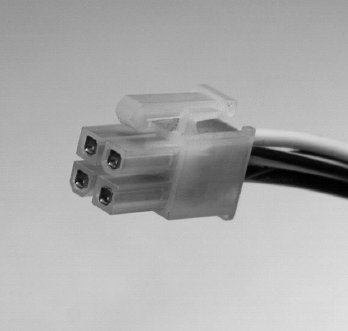

Wtyczka zaprezentowana na fotografie stanowi element obwodu elektrycznego zasilającego

Jakie funkcje posiada program tar?

Gdy komputer się uruchamia, na ekranie wyświetla się komunikat "CMOS checksum error press F1 to continue press DEL to setup". Naciśnięcie klawisza DEL spowoduje

Z jakiego oprogramowania NIE można skorzystać, aby przywrócić dane w systemie Windows na podstawie wcześniej wykonanej kopii?

Które stwierdzenie opisuje profil tymczasowy użytkownika?

Aby określić rozmiar wolnej oraz zajętej pamięci RAM w systemie Linux, można skorzystać z polecenia

Oznaczenie CE świadczy o tym, że

W układzie SI jednostką, która mierzy napięcie, jest

Aby uzyskać największą prędkość przepływu danych w przypadku, gdy domowy ruter pracuje w paśmie częstotliwości 5 GHz, do notebooka powinno się zamontować bezprzewodową kartę sieciową pracującą w standardzie

Jakie urządzenie pozwala na podłączenie kabla światłowodowego wykorzystywanego w okablowaniu pionowym sieci do przełącznika z jedynie gniazdami RJ45?

Jakie typy połączeń z Internetem mogą być współdzielone w sieci lokalnej?

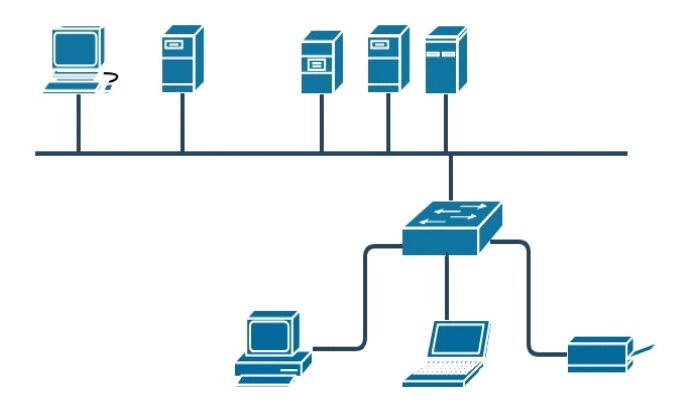

Ilustracja pokazuje schemat fizycznej topologii będącej kombinacją topologii

Przedstawiony zestaw komputerowy jest niekompletny. Który element nie został uwzględniony w tabeli, a jest niezbędny do prawidłowego działania zestawu i należy go dodać?

| Lp. | Nazwa podzespołu |

|---|---|

| 1. | Cooler Master obudowa komputerowa CM Force 500W czarna |

| 2. | Gigabyte GA-H110M-S2H, Realtek ALC887, DualDDR4-2133, SATA3, HDMI, DVI, D-Sub, LGA1151, mATX |

| 3. | Intel Core i5-6400, Quad Core, 2.70GHz, 6MB, LGA1151, 14nm, 65W, Intel HD Graphics, VGA, TRAY/OEM |

| 4. | Patriot Signature DDR4 2x4GB 2133MHz |

| 5. | Seagate BarraCuda, 3.5", 1TB, SATA/600, 7200RPM, 64MB cache |

| 6. | LG SuperMulti SATA DVD+/-R24x,DVD+RW6x,DVD+R DL 8x, bare bulk (czarny) |

| 7. | Gembird Bezprzewodowy Zestaw Klawiatura i Mysz |

| 8. | Monitor Iiyama E2083HSD-B1 19.5inch, TN, HD+, DVI, głośniki |

| 9. | Microsoft OEM Win Home 10 64Bit Polish 1pk DVD |

Według normy JEDEC, standardowe napięcie zasilające dla modułów pamięci RAM DDR3L o niskim napięciu wynosi

Liczba FAFC w systemie heksadecymalnym odpowiada wartości liczbowej

Wskaż symbol, który znajduje się na urządzeniach elektrycznych przeznaczonych do handlu w Unii Europejskiej?

Na ilustracji widoczny jest

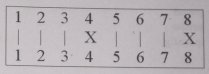

Jaki błąd w okablowaniu można dostrzec na ekranie testera, który pokazuje mapę połączeń żył kabla typu "skrętka"?

Protokołem umożliwiającym dostęp do sieci pakietowej o prędkości nieprzekraczającej 2 Mbit/s jest protokół

Firma świadcząca usługi sprzątania potrzebuje drukować faktury tekstowe w czterech kopiach równocześnie, na papierze samokopiującym. Jaką drukarkę powinna wybrać?

Czym nie jest program antywirusowy?

Pamięć RAM ukazana na grafice jest instalowana w płycie głównej z gniazdem

W warstwie łącza danych modelu odniesienia ISO/OSI możliwą przyczyną błędów działania lokalnej sieci komputerowej jest

Jakie jest odpowiednik maski 255.255.252.0 w postaci prefiksu?

Urządzenie pokazane na ilustracji służy do zgrzewania wtyków

Jaki instrument służy do określania długości oraz tłumienności kabli miedzianych?