Pytanie 1

Licencja Windows OEM nie umożliwia wymiany

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Licencja Windows OEM nie umożliwia wymiany

Minimalna odległość toru nieekranowanego kabla sieciowego od instalacji oświetleniowej powinna wynosić

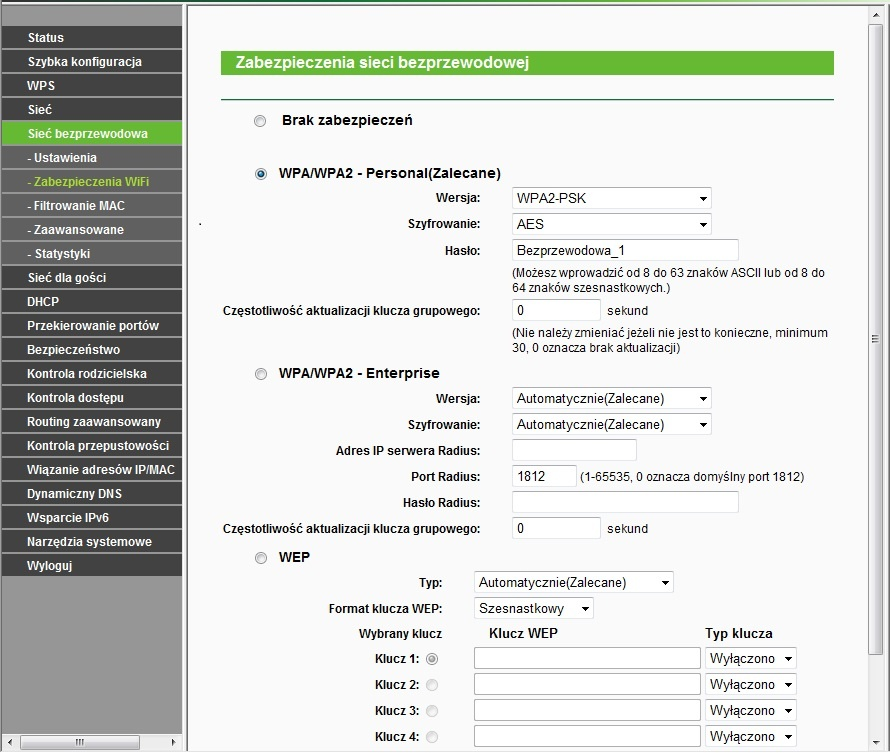

Na ilustracji przedstawiono konfigurację dostępu do sieci bezprzewodowej, która dotyczy

Aby połączyć dwa przełączniki oddalone o 200 m i zapewnić minimalną przepustowość 200 Mbit/s, powinno się użyć

Wykorzystane kasety od drukarek powinny być

Które medium transmisyjne charakteryzuje się najmniejszym ryzykiem narażenia na zakłócenia elektromagnetyczne przesyłanego sygnału?

Jakie elementy wspierają okablowanie pionowe w sieci LAN?

Wskaź, które zdanie dotyczące zapory sieciowej jest nieprawdziwe?

Aby przywrócić dane, które zostały usunięte dzięki kombinacji klawiszy Shift+Delete, trzeba

Jak można przywrócić domyślne ustawienia płyty głównej, gdy nie ma możliwości uruchomienia BIOS Setup?

ARP (Adress Resolution Protocol) jest protokołem, który umożliwia przekształcenie adresu IP na

W systemie Windows, po dezaktywacji domyślnego konta administratora i ponownym uruchomieniu komputera

W systemie Windows, aby założyć nową partycję podstawową, trzeba skorzystać z przystawki

Symbol błyskawicy pokazany na rysunku jest używany do oznaczania złącza

Jakie urządzenie stosuje technikę detekcji zmian w pojemności elektrycznej do sterowania kursorem na monitorze?

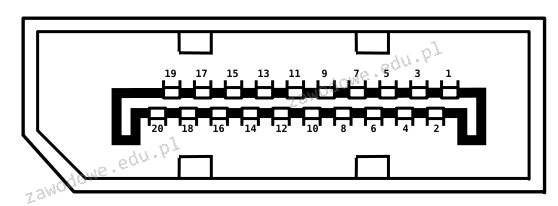

Na ilustracji pokazano złącze:

Jak nazywa się magistrala, która w komputerze łączy procesor z kontrolerem pamięci i składa się z szyny adresowej, szyny danych oraz linii sterujących?

Jakie są zasadnicze różnice pomiędzy poleceniem ps a poleceniem top w systemie Linux?

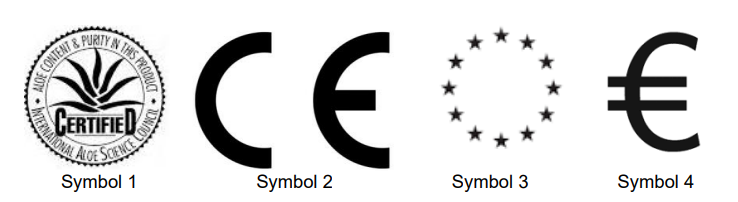

Jakim symbolem powinien być oznaczony sprzęt komputerowy, aby spełniał wymogi prawne konieczne do sprzedaży w Unii Europejskiej?

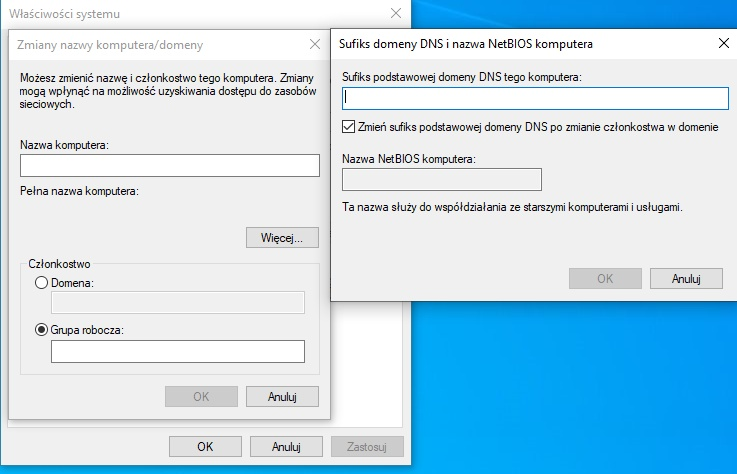

Aby podłączyć stację roboczą z zainstalowanym systemem Windows do domeny zst.local należy

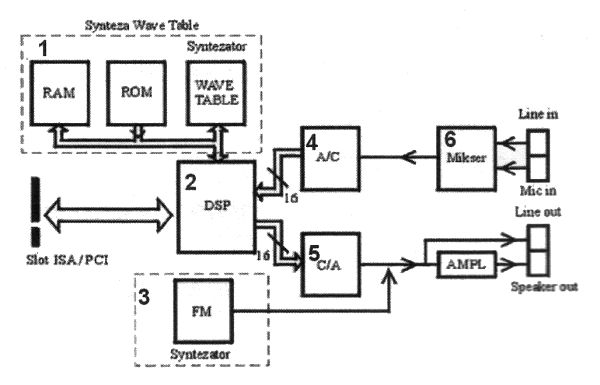

Na diagramie zaprezentowano strukturę

Podaj adres rozgłoszeniowy dla podsieci 86.10.20.64/26?

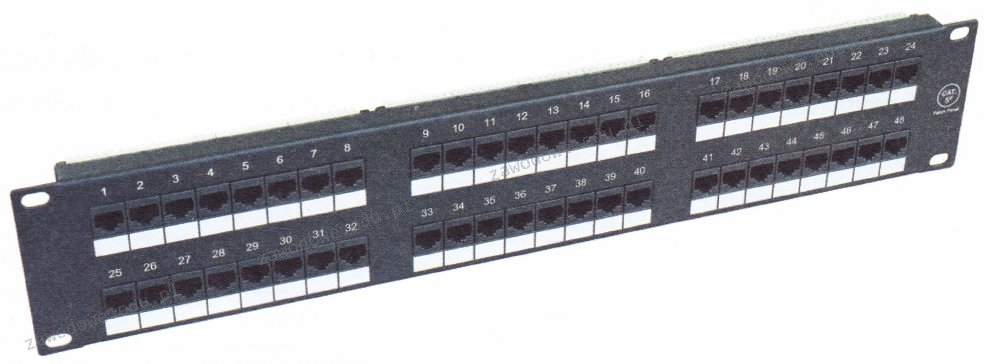

Na ilustracji widoczny jest

Jakie oprogramowanie chroni komputer przed niechcianym softwarem pochodzącym z sieci?

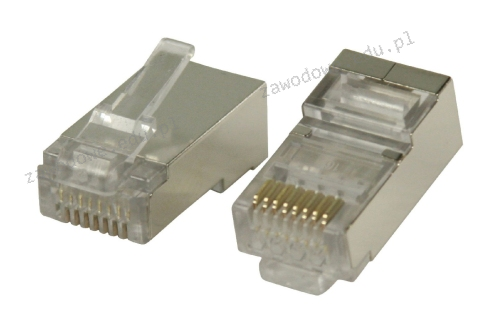

Jakie złącze jest przypisane do kategorii 7?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Dane dotyczące kont użytkowników w systemie Linux są przechowywane w pliku

Liczba 10011001100 zaprezentowana w systemie heksadecymalnym ma formę

Po przeprowadzeniu diagnostyki komputerowej ustalono, że temperatura pracy karty graficznej z wyjściami HDMI oraz D-SUB, zainstalowanej w gnieździe PCI Express komputera stacjonarnego, wynosi 87°C. W związku z tym, serwisant powinien

Na diagramie blokowym karty dźwiękowej komponent odpowiedzialny za konwersję sygnału analogowego na cyfrowy jest oznaczony numerem

Organizacja zajmująca się normalizacją na świecie, która stworzyła 7-warstwowy Model Referencyjny Otwartej Architektury Systemowej, to

Aby zweryfikować mapę połączeń kabla UTP Cat 5e w sieci lokalnej, konieczne jest wykorzystanie

Skrót określający translację adresów w sieciach to

Komputer, którego serwis ma być wykonany u klienta, nie odpowiada na naciśnięcie przycisku POWER. Jakie powinno być pierwsze zadanie w planie działań związanych z identyfikacją i naprawą tej awarii?

Protokół Transport Layer Security (TLS) jest rozwinięciem standardu

W doborze zasilacza do komputera kluczowe znaczenie

Kluczowe znaczenie przy tworzeniu stacji roboczej, na której ma funkcjonować wiele maszyn wirtualnych, ma:

Jakie urządzenie pozwoli na podłączenie drukarki, która nie jest wyposażona w kartę sieciową, do lokalnej sieci komputerowej?

Dysk z systemem plików FAT32, na którym regularnie przeprowadza się działania usuwania starych plików oraz dodawania nowych plików, doświadcza

Wtyczka (modularne złącze męskie) przedstawiona na rysunku stanowi zakończenie przewodu