Pytanie 1

Na pliku z uprawnieniami zapisanymi w systemie liczbowym: 740 przeprowadzono polecenie chmod g-r. Jakie będą nowe uprawnienia pliku?

Wynik: 20/40 punktów (50,0%)

Wymagane minimum: 20 punktów (50%)

Na pliku z uprawnieniami zapisanymi w systemie liczbowym: 740 przeprowadzono polecenie chmod g-r. Jakie będą nowe uprawnienia pliku?

Jednym z rezultatów wykonania poniższego polecenia jest:

sudo passwd -n 1 -x 5 test

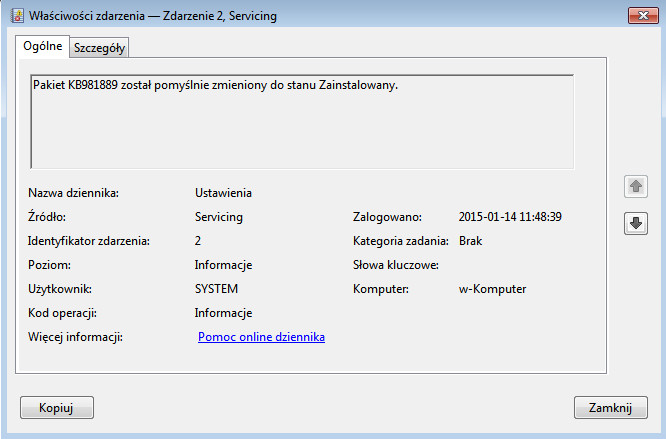

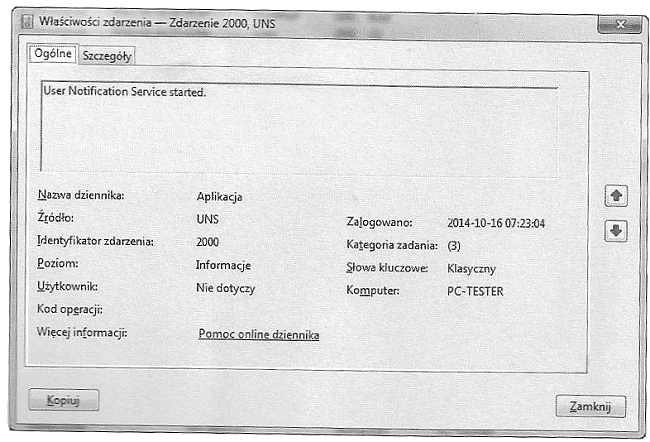

Wpis w dzienniku zdarzeń przedstawiony na ilustracji należy zakwalifikować do zdarzeń typu

Aby Jan mógł zmienić właściciela drukarki w systemie Windows, musi mu zostać przypisane prawo do w opcjach zabezpieczeń

Oznaczenie CE świadczy o tym, że

Jakie działanie może skutkować nieodwracalną utratą danych w przypadku awarii systemu plików?

W systemie Windows 7 program Cipher.exe w trybie poleceń jest używany do

Jak najlepiej chronić zebrane dane przed dostępem w przypadku kradzieży komputera?

Aby poprawić bezpieczeństwo zasobów sieciowych, administrator sieci komputerowej w firmie został zobowiązany do podziału istniejącej lokalnej sieci komputerowej na 16 podsieci. Pierwotna sieć miała adres IP 192.168.20.0 z maską 255.255.255.0. Jaką maskę sieci powinien zastosować administrator?

Jakie miejsce nie powinno być wykorzystywane do przechowywania kopii zapasowych danych z dysku twardego komputera?

Który z poniższych mechanizmów zagwarantuje najwyższy poziom ochrony w sieciach bezprzewodowych opartych na standardzie 802.11n?

Aby poprawić niezawodność oraz efektywność przesyłania danych na serwerze, należy

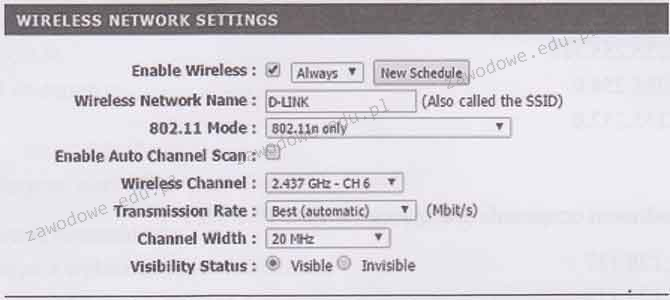

Aby dezaktywować transmitowanie nazwy sieci Wi-Fi, należy w punkcie dostępowym wyłączyć opcję

Który z parametrów w ustawieniach punktu dostępowego działa jako login używany podczas próby połączenia z punktem dostępowym w sieci bezprzewodowej?

Jakie porty powinny być odblokowane w ustawieniach firewalla na komputerze, na którym działa usługa serwera WWW?

Który z protokołów umożliwia terminalowe połączenie ze zdalnymi urządzeniami, zapewniając jednocześnie transfer danych w zaszyfrowanej formie?

Jakie jest zastosowanie maty antystatycznej oraz opaski podczas instalacji komponentu?

AppLocker to funkcjonalność dostępna w systemach Windows Server, która umożliwia

Oznaczenie CE wskazuje, że

Jednym z zaleceń w zakresie ochrony przed wirusami jest przeprowadzanie skanowania całego systemu. W związku z tym należy skanować komputer

Jakie narzędzie w systemie Windows umożliwia kontrolę prób logowania do systemu?

Gdy użytkownik zauważy, że ważne pliki zniknęły z dysku twardego, powinien

Nowe komponenty komputerowe, takie jak dyski twarde czy karty graficzne, są umieszczane w metalizowanych opakowaniach foliowych, których głównym celem jest zabezpieczenie

Jest to najnowsza edycja klienta wieloplatformowego, docenianego przez użytkowników na całym świecie, serwera wirtualnej sieci prywatnej, umożliwiającego nawiązanie połączenia między hostem a komputerem lokalnym, obsługującego uwierzytelnianie z wykorzystaniem kluczy, certyfikatów, nazwy użytkownika oraz hasła, a także, w wersji dla Windows, dodatkowych zakładek. Który z programów został wcześniej opisany?

Jakie miejsce nie jest zalecane do przechowywania kopii zapasowej danych z dysku twardego komputera?

Do jakiej grupy w systemie Windows Server 2008 powinien być przypisany użytkownik odpowiedzialny wyłącznie za archiwizację danych przechowywanych na serwerowym dysku?

Aby zminimalizować ryzyko wyładowań elektrostatycznych podczas wymiany komponentów komputerowych, technik powinien wykorzystać

Program wirusowy, którego zasadniczym zamiarem jest samoistne rozprzestrzenianie się w sieci komputerowej, to:

Osoba korzystająca z lokalnej sieci musi mieć możliwość dostępu do dokumentów umieszczonych na serwerze. W tym celu powinna

Wpis przedstawiony na ilustracji w dzienniku zdarzeń klasyfikowany jest jako zdarzenie typu

Kluczowym mechanizmem zabezpieczającym dane przechowywane na serwerze jest

Który z protokołów zapewnia bezpieczne połączenie między klientem a witryną internetową banku, zachowując prywatność użytkownika?

Aby wymusić na użytkownikach lokalnych systemów z rodziny Windows Server regularną zmianę haseł oraz stosowanie haseł o odpowiedniej długości, które spełniają kryteria złożoności, należy ustawić

Co nie wpływa na utratę z pamięci masowej HDD?

Procesem nieodwracalnym, całkowicie uniemożliwiającym odzyskanie danych z dysku twardego, jest

Aktualizacja systemów operacyjnych to proces, którego głównym zadaniem jest

Aby w edytorze Regedit przywrócić stan rejestru systemowego za pomocą wcześniej utworzonej kopii zapasowej, należy użyć funkcji

Do wykonania obrazu dysku twardego można użyć programu

Najefektywniejszym zabezpieczeniem danych firmy, której siedziby znajdują się w różnych, odległych od siebie lokalizacjach, jest zastosowanie

Który rodzaj kopii zapasowej należy wybrać, aby wykonać przyrostową kopię danych?