Pytanie 1

Która z macierzy RAID opiera się na replikacji dwóch lub więcej dysków twardych?

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Która z macierzy RAID opiera się na replikacji dwóch lub więcej dysków twardych?

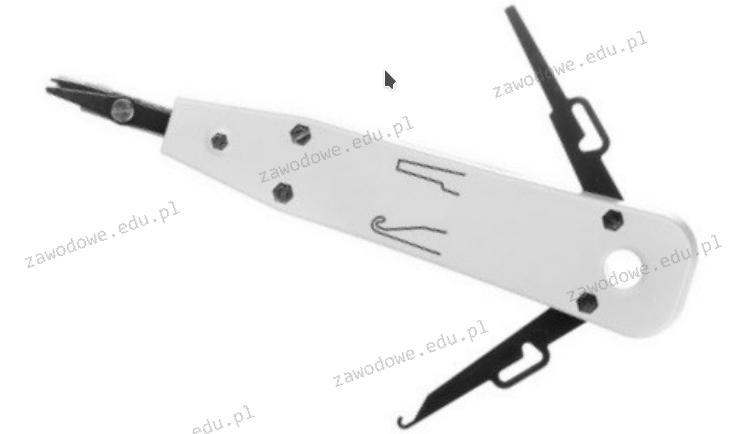

Urządzenie pokazane na ilustracji służy do

Aby uzyskać wyświetlenie podanych informacji o systemie Linux w terminalu, należy skorzystać z komendy

Jakie urządzenie sieciowe funkcjonuje w warstwie fizycznej modelu ISO/OSI, transmitując sygnał z jednego portu do wszystkich pozostałych portów?

Jakie polecenie należy wykorzystać, aby w terminalu pokazać przedstawione informacje o systemie Linux?

Arch Linux 2.6.33-ARCH (myhost) (tty1)

myhost login: root

Password:

[root@myhost ~]#

Linux myhost 2.6.33-ARCH #1 SMP PREEMPT Thu May 13 12:06:25 CEST 2010 i686 Intel

(R) Pentium(R) 4 CPU 2.80GHz GenuineIntel GNU/LinuxOptyczna rozdzielczość to jeden z właściwych parametrów

Usługi na serwerze są konfigurowane za pomocą

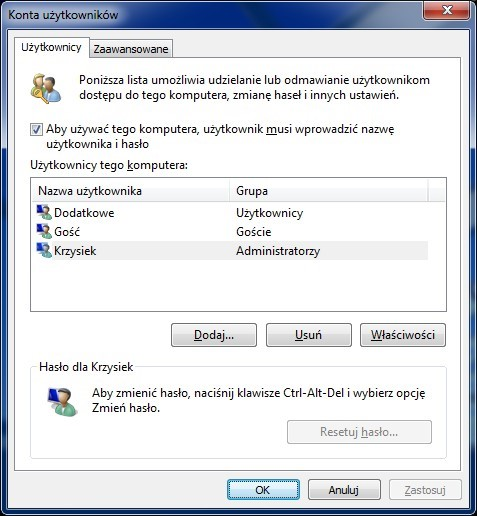

Aby uruchomić przedstawione narzędzie systemu Windows, należy użyć polecenia

Przygotowując ranking dostawców łączy internetowych należy zwrócić uwagę, aby jak najmniejsze wartości miały parametry

Wskaż znak umieszczany na urządzeniach elektrycznych przeznaczonych do obrotu i sprzedaży w Unii Europejskiej.

Rodzaj ataku komputerowego, który polega na pozyskiwaniu wrażliwych informacji osobistych poprzez podszywanie się pod zaufaną osobę lub instytucję, to

Aby zweryfikować połączenia kabla U/UTP Cat. 5e w systemie okablowania strukturalnego, jakiego urządzenia należy użyć?

Zjawiskiem typowym, które może świadczyć o nadchodzącej awarii twardego dysku, jest wystąpienie

Który standard złącza DVI pozwala na przesyłanie wyłącznie sygnałów analogowych?

Jakim systemem operacyjnym jest system czasu rzeczywistego?

Ile liczb w systemie szesnastkowym jest wymaganych do zapisania pełnej formy adresu IPv6?

Złocenie styków złącz HDMI ma na celu

Sieć komputerowa, która obejmuje wyłącznie urządzenia jednej organizacji, w której dostępne są usługi realizowane przez serwery w sieci LAN, takie jak strony WWW czy poczta elektroniczna to

Która norma w Polsce definiuje zasady dotyczące okablowania strukturalnego?

Aby osiągnąć przepustowość 4 GB/s w obydwie strony, konieczne jest zainstalowanie w komputerze karty graficznej używającej interfejsu

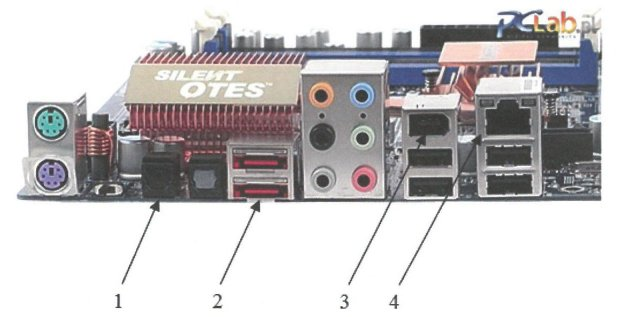

Który z portów na pokazanej płycie głównej pozwala na podłączenie zewnętrznego dysku za pośrednictwem interfejsu e-SATA?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

Aby zweryfikować poprawność przebiegów oraz wartości napięć w układzie urządzenia elektronicznego, można zastosować

Wskaż błędny sposób podziału dysku MBR na partycje?

Pracownik serwisu komputerowego podczas wykonywania konserwacji i czyszczenia drukarki laserowej, odłączonej od źródła zasilania, może wykorzystać jako środek ochrony indywidualnej

Cechą oprogramowania służącego do monitorowania zdarzeń metodą Out-Of-Band w urządzeniach sieciowych jest

Jaka jest maksymalna prędkość przesyłania danych w sieci lokalnej, w której wykorzystano przewód UTP kat.5e do budowy infrastruktury kablowej?

Wymianę uszkodzonych kondensatorów karty graficznej umożliwi

Jakie jest zadanie usługi DNS?

Na ilustracji ukazano kartę

Jakie urządzenie należy zastosować, aby połączyć sieć lokalną wykorzystującą adresy prywatne z Internetem?

Programem służącym do archiwizacji danych w systemie Linux jest

Jakim protokołem komunikacyjnym, który gwarantuje niezawodne przesyłanie danych, jest protokół

Medium transmisyjne oznaczone symbolem S/FTP to skrętka

Licencja Windows OEM nie zezwala na wymianę

Aby zintegrować komputer z siecią LAN, należy użyć interfejsu

Proces zapisu na nośnikach BD-R realizowany jest przy użyciu

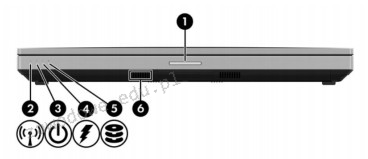

Na ilustracji zaprezentowane jest oznaczenie sygnalizacji świetlnej w dokumentacji technicznej laptopa. Podaj numer kontrolki, która świeci się w czasie ładowania akumulatora?

Jakie oprogramowanie zabezpieczające przed nieautoryzowanym dostępem do sieci powinno być zainstalowane na serwerze, który udostępnia dostęp do internetu?

Bezpośrednio po usunięciu istotnych plików z dysku twardego, użytkownik powinien