Pytanie 1

Przedstawiony na rysunku kolimator stanowi część

Wynik: 39/40 punktów (97,5%)

Wymagane minimum: 20 punktów (50%)

Przedstawiony na rysunku kolimator stanowi część

Parametr dysku twardego określany skrótem MTBF oznacza średni czas

Badanie obrazujące fizyczny rozwój płodu wykonywane jest przy użyciu

Podczas uruchamiania komputera procedura POST testuje poprawność działania

Które polecenie SQL nie modyfikuje tabeli bazy danych?

Który endoskop pozwala na badanie wnętrza tchawicy i oskrzeli?

Który z przedstawionych przyrządów służy do testowania połączeń w sieci LAN?

Który rodzaj promieniowania jonizującego jest całkowicie pochłaniany przez naskórek, nie docierając do głębszych warstw tkanek?

Który przyrząd należy wybrać celem sprawdzenia poprawnej prędkości transmisji danych na łączu RS232 urządzenia elektroniki medycznej?

Za pomocą oscyloskopu nie można zmierzyć bezpośrednio

W programowaniu obiektowym zmienne widoczne w ramach klasy oraz poza nią nazywane są

Zjawisko polegające na zmianie częstotliwości fali odbitej od poruszającego się obiektu jest wykorzystywane w

Wynikiem działania funkcji F(n) będzie

funkcja F(n) jeżeli n>1 F(n)=3*F(n-1) w przeciwnym wypadku F(n)=3 |

Technologia dual channel dotyczy pracy dwóch takich samych

W dokumencie urządzenia elektroniki medycznej podano następujące informacje:

Interfejs obrazu DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. • Szybkość przesyłania obrazów: 2 MB/s. Interfejs RIS/CIS zgodny z DICOM • Maksymalna szybkość przesyłania wg standardu Ethernet: 100 Mb/s. |

Dla sieci o adresie 192.150.160.0/26 pula adresów IP dla urządzeń w tej sieci zawiera się w zakresie

Zapis w dokumentacji układu holterowskiego „metoda pomiaru – oscylometryczna” świadczy o możliwości monitorowania

W celu archiwizacji danych w systemie Windows, jest wymagane kopiowanie z katalogu źródłowego (kat_zrodlowy) do katalogu docelowego (kat_docelowy). Do kopiowania danych należy użyć polecenia

Zestaw przedstawiony na rysunku przeznaczony jest do przeprowadzania testu aparatu

Które polecenie w systemie Windows tworzy folder Dane?

Narzędzie przedstawione na rysunku służy do

Operacja warunkowa w większości języków programowania wysokiego poziomu zaczyna się słowem

Jaki wpływ na organizm ludzki ma krioterapia?

Która tkanka najsilniej pochłania fale ultradźwiękowe?

Jakie jest przeznaczenie drukarki, której dotyczy zamieszczony fragment specyfikacji?

| Głowica drukująca | 24-igłowa |

| Średnica przewodu | 0,2 mm |

| Kierunek druku | Dwukierunkowe/bezkierunkowe drukowanie |

| Rozdzielczość grafiki | Maks. 360 (wys.) x 360 (szer.) dpi |

| Szybkość drukowania | High Speed Draft: 607 znaków/s, tryb Utility: 485 znaków/s, tryb Near Letter Quality: 245 znaków/s, Letter Quality: 165 znaków/s |

| Gęstość przesunięć wierszy | 4,23 mm (1/6"), 3,18 mm (1/8"), n x 0,42 mm (m/60") (m=0-127), n x 0,14 mm (n/180") (n=0-255), n x 0,12 mm (n/216") (n=0-255), n x 0,07 mm (n/360") (n=0-255) |

| Szybkość podajnika | 10 cali na sekundę |

| Pobieranie papieru | Ręczne (góra), traktor pchający (góra), traktor pchający (tył), traktor pchający (dół), podajnik pojedynczych arkuszy (tył) |

| Gęstość znaków | High Speed Draft: 10,0 zn./cal 18,0 zn./cal Jakość użytkowa: 10,0 zn./cal 12,0 zn./cal 15,0 zn./cal 17,1 zn./cal 20 zn./cal Tryb Near Letter Quality: 10,0 zn./cal 12,0 zn./cal 15,0 zn./cal 17,1 zn./cal 20,0 zn./cal Tryb Letter Quality: 10 zn./cal 12 zn./cal 15 zn./cal 17,1 zn./cal 20 zn./cal, proporcjonalnie |

| Szerokość druku | 136 zn./linia przy ANK 10 zn./cal |

Który system plików zapewnia największe bezpieczeństwo danych w systemie Windows?

Ile elektrod wykorzystuje się podczas wykonywania standardowego badania EKG przy pomocy 12 odprowadzeń?

Który sterownik odpowiada za bezpośredni dostęp do pamięci?

W zabiegu jonoforezy leki są transportowane przez skórę do głębiej położonych warstw poprzez zastosowanie

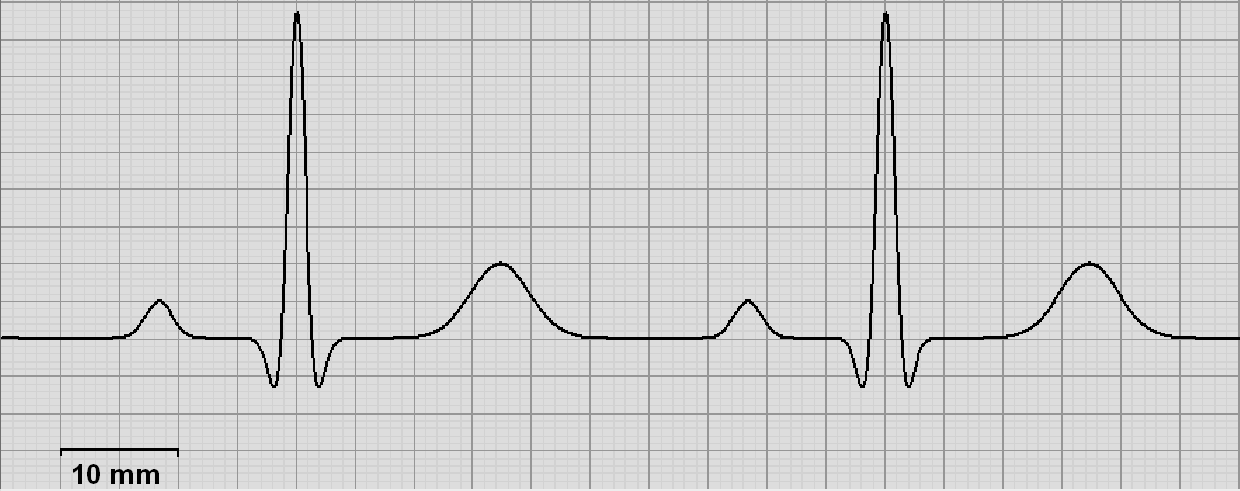

Jaka jest prędkość przesuwu prezentowanego elektrokardiogramu, jeżeli zmierzona częstotliwość rytmu serca wynosi 60 uderzeń na minutę?

Na rysunku przedstawiono badanie za pomocą

Które polecenia są charakterystyczne dla instrukcji iteracyjnych?

Który system plików pozwala na szyfrowanie danych w systemie Windows?

Jaki powinien być ustawiony adres maski podsieci, aby umożliwiał podłączenie maksymalnie 30 urządzeń?

Na zdjęciu przedstawiono

Największą zdolność pochłaniania promieniowania rentgenowskiego o energii 60–160 keV wykazuje tkanka

Która magistrala służy do szeregowej transmisji danych?

Jak nazywa się w programowaniu obiektowym instancję klasy?

Który system informatyki medycznej umożliwia archiwizację obrazów?

W programowaniu, aby przerwać wykonywanie pętli i wyjść z niej, należy użyć polecenia