Pytanie 1

Symbol umieszczony na urządzeniach, który stanowi certyfikat potwierdzający zgodność w zakresie emisji promieniowania, ergonomii, efektywności energetycznej i ekologicznych norm, został przedstawiony na ilustracji

Wynik: 12/40 punktów (30,0%)

Wymagane minimum: 20 punktów (50%)

Symbol umieszczony na urządzeniach, który stanowi certyfikat potwierdzający zgodność w zakresie emisji promieniowania, ergonomii, efektywności energetycznej i ekologicznych norm, został przedstawiony na ilustracji

Do jakiego celu służy program fsck w systemie Linux?

Program firewall nie zapewnia ochrony przed

W systemie operacyjnym Fedora foldery domowe użytkowników znajdują się w folderze

Zastosowanie programu w różnych celach, badanie jego działania oraz wprowadzanie modyfikacji, a także możliwość publicznego udostępniania tych zmian, to charakterystyka licencji typu

Program CHKDSK jest wykorzystywany do

Jakie zdanie charakteryzuje SSH Secure Shell?

Standard magistrali komunikacyjnej PCI w wersji 2.2 (Peripheral Component Interconnect) definiuje maksymalną szerokość szyny danych na

Jaką liczbę komputerów można zaadresować w sieci z maską 255.255.255.224?

Po zainstalowaniu systemu Windows 7 zmieniono konfigurację dysku SATA w BIOS-ie komputera z AHCI na IDE. Przy ponownym uruchomieniu komputera system będzie

Wyświetlony stan ekranu terminala został uzyskany podczas testu realizowanego w środowisku Windows. Techniczny pracownik zdobył w ten sposób informacje o:

Użytkownik systemu Windows doświadcza komunikatów o niewystarczającej pamięci wirtualnej. Jak można rozwiązać ten problem?

Planowanie wykorzystania przestrzeni na dysku komputera do gromadzenia i udostępniania informacji takich jak pliki oraz aplikacje dostępne w sieci, a także ich zarządzanie, wymaga skonfigurowania komputera jako

Po włączeniu komputera wyświetlił się komunikat "Non-system disk or disk error. Replace and strike any key when ready". Może to być spowodowane

W które złącze, umożliwiające podłączenie monitora, wyposażona jest karta graficzna przedstawiona na ilustracji?

Aby naprawić wskazaną awarię, należy

|

Jakie polecenie trzeba wydać w systemie Windows 7, aby uruchomić program Zapora systemu Windows z zabezpieczeniami zaawansowanymi bezpośrednio z wiersza poleceń?

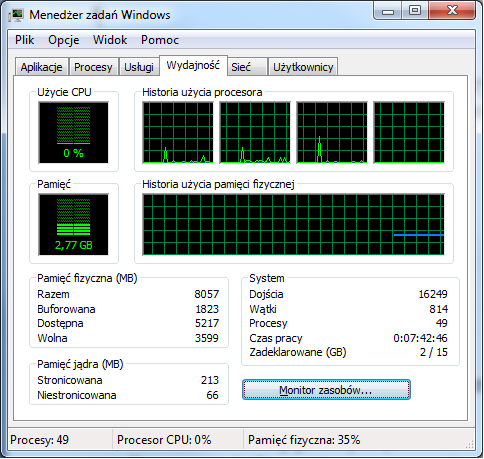

W systemie Windows do uruchomienia przedstawionego narzędzia należy użyć polecenia

Jakie rozwiązanie należy wdrożyć i prawidłowo ustawić, aby chronić lokalną sieć komputerową przed atakami typu Smurf pochodzącymi z Internetu?

Jaką maksymalną liczbę hostów można przypisać w sieci o adresie IP klasy B?

Z jaką informacją wiąże się parametr TTL po wykonaniu polecenia ping?

Na podstawie filmu wskaż z ilu modułów składa się zainstalowana w komputerze pamięć RAM oraz jaką ma pojemność.

W drukarce laserowej do utrwalenia wydruku na papierze stosuje się

Jaki jest adres rozgłoszeniowy w sieci mającej adres IPv4 192.168.0.0/20?

Wskaż interfejsy płyty głównej widoczne na rysunku.

Jakie polecenie trzeba wydać w systemie Windows, aby zweryfikować tabelę mapowania adresów IP na adresy MAC wykorzystywane przez protokół ARP?

W systemie Linux wykonanie komendy passwd Ala spowoduje

Odmianą pamięci, która jest tylko do odczytu i można ją usunąć za pomocą promieniowania ultrafioletowego, jest pamięć

Z powodu uszkodzenia kabla typu skrętka utracono dostęp między przełącznikiem a stacją roboczą. Który instrument pomiarowy powinno się wykorzystać, aby zidentyfikować i naprawić problem bez wymiany całego kabla?

Jakie polecenie umożliwia śledzenie drogi datagramu IP do miejsca docelowego?

W jakim miejscu są przechowywane dane o kontach użytkowników domenowych w środowisku Windows Server?

Na stronie wydrukowanej przez drukarkę laserową występują jaśniejsze i ciemniejsze fragmenty. W celu usunięcia problemów z jakością oraz nieciągłościami w wydruku, należy

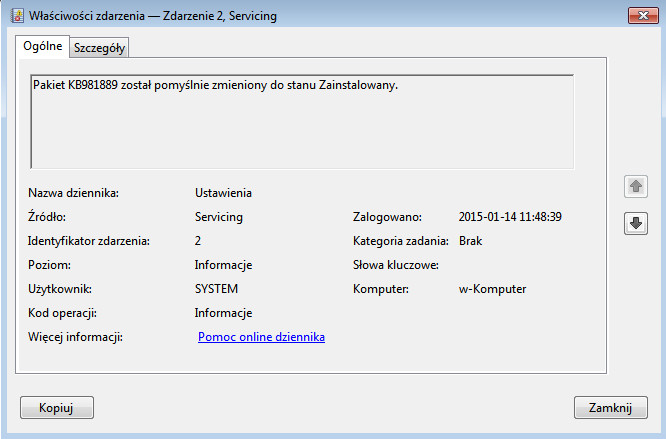

Wpis w dzienniku zdarzeń przedstawiony na ilustracji należy zakwalifikować do zdarzeń typu

W systemach operacyjnych z rodziny Windows, funkcja EFS umożliwia ochronę danych poprzez ich

Jaką funkcję pełni mechanizm umożliwiający przechowywanie fragmentów dużych plików programów i danych, które nie mogą być w pełni załadowane do pamięci?

Proces zapisu na nośnikach BD-R realizowany jest przy użyciu

Która z możliwości konfiguracji ustawień dla użytkownika z ograniczonymi uprawnieniami w systemie Windows jest oferowana przez przystawkę secpol?

Menadżer rozruchu, który umożliwia wybór systemu operacyjnego Linux do załadowania, to

Jakie polecenie w systemie Linux prawidłowo ustawia kartę sieciową, przypisując adres IP oraz maskę sieci dla interfejsu eth1?

Główną czynnością serwisową w drukarce igłowej jest zmiana pojemnika