Pytanie 1

Komunikat biosu POST od firmy Award o treści "Display switch is set incorrectly" sugeruje

Wynik: 26/40 punktów (65,0%)

Wymagane minimum: 20 punktów (50%)

Komunikat biosu POST od firmy Award o treści "Display switch is set incorrectly" sugeruje

Proces zapisu na nośnikach BD-R realizowany jest przy użyciu

W warstwie łącza danych modelu odniesienia ISO/OSI możliwą przyczyną błędów działania lokalnej sieci komputerowej jest

W trakcie normalnego funkcjonowania systemu operacyjnego w laptopie zjawia się informacja o potrzebie sformatowania wewnętrznego dysku twardego. Co to oznacza?

Przedstawiony symbol znajdujący się na obudowie komputera stacjonarnego oznacza ostrzeżenie przed

Diagnostykę systemu Linux można przeprowadzić za pomocą komendy

| Thread(s) per core: | 1 |

| Core(s) per socket: | 4 |

| Socket(s): | 1 |

| NUMA node(s): | 1 |

Jakie medium transmisyjne używają myszki Bluetooth do interakcji z komputerem?

Thunderbolt to interfejs

Wskaż nazwę programu stosowanego w systemie Linux do przekrojowego monitorowania parametrów, między innymi takich jak obciążenie sieci, zajętość systemu plików, statystyki partycji, obciążenie CPU czy statystyki IO.

Programem w systemie Linux, który umożliwia nadzorowanie systemu za pomocą zcentralizowanego mechanizmu, jest narzędzie

Okablowanie strukturalne klasyfikuje się jako część infrastruktury

Jakie urządzenie jest przedstawione na rysunku?

W komunikacie o błędzie w systemie, informacja przedstawiana w formacie heksadecymalnym oznacza

Zgodnie z normą 802.3u w sieciach FastEthernet 100Base-FX stosuje się

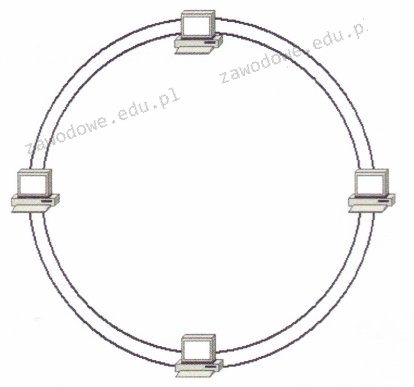

Jaką topologię fizyczną sieci komputerowej przedstawia rysunek?

Urządzenie pokazane na ilustracji ma na celu

Jaką kwotę trzeba będzie zapłacić za wymianę karty graficznej w komputerze, jeśli koszt karty wynosi 250 zł, czas wymiany to 80 minut, a cena za każdą rozpoczętą roboczogodzinę to 50 zł?

Jaki tryb funkcjonowania Access Pointa jest wykorzystywany do umożliwienia urządzeniom bezprzewodowym łączności z przewodową siecią LAN?

Jakie polecenie w systemie Linux prawidłowo ustawia kartę sieciową, przypisując adres IP oraz maskę sieci dla interfejsu eth1?

Jakie urządzenie powinno się zastosować do pomiaru topologii okablowania strukturalnego w sieci lokalnej?

Montaż przedstawionej karty graficznej będzie możliwy na płycie głównej wyposażonej w złącze

Aby przygotować do pracy skaner, którego opis zawarto w tabeli, należy w pierwszej kolejności

| Skaner przenośny IRIScanBook 3 |

| Bezprzewodowy, zasilany baterią i bardzo lekki. Można go przenosić w dowolne miejsce! |

| Idealny do skanowania książek, czasopism i gazet |

| Rozdzielczość skanowania 300/600/900 dpi |

| Prędkość skanowania: 2 sek. dla tekstów biało-czarnych / 3 sek. dla tekstów kolorowych |

| Bezpośrednie skanowanie do formatu PDF i JPEG |

| Zapis skanu na kartę microSD ™ (w zestawie) |

| Kolorowy ekran (do podglądu zeskanowanych obrazów) |

| 3 baterie alkaliczne AAA (w zestawie) |

Jak należy postąpić z wiadomością e-mail od nieznanej osoby, która zawiera podejrzany załącznik?

Jakiego protokołu używa polecenie ping?

Jaka jest podstawowa funkcja protokołu SMTP?

Najskuteczniejszym zabezpieczeniem sieci bezprzewodowej jest

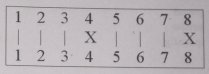

Jaki błąd w okablowaniu można dostrzec na ekranie testera, który pokazuje mapę połączeń żył kabla typu "skrętka"?

Jakie medium transmisyjne powinno być użyte do połączenia dwóch punktów dystrybucyjnych oddalonych o 600m?

Najczęstszym powodem, dla którego toner rozmazuje się na wydrukach z drukarki laserowej, jest

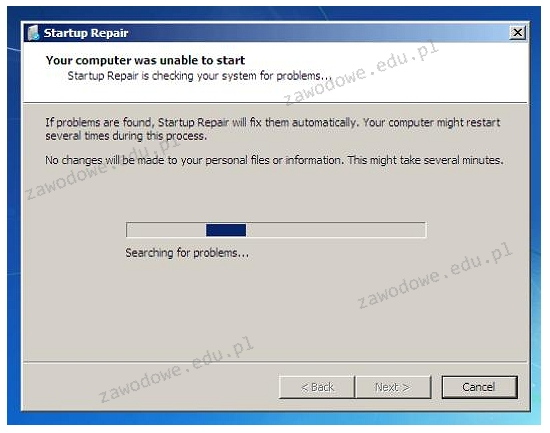

Komunikat, który pojawia się po uruchomieniu narzędzia do przywracania systemu Windows, może sugerować

Zgodnie z normą PN-EN 50174, okablowanie poziome w systemie okablowania strukturalnego to segment okablowania pomiędzy

NAT64 (Network Address Translation 64) to proces, który dokonuje mapowania adresów

Samodzielną strukturą sieci WLAN jest

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Atak DDoS (ang. Disributed Denial of Service) na serwer doprowadzi do

Z jakiego typu pamięci korzysta dysk SSD?

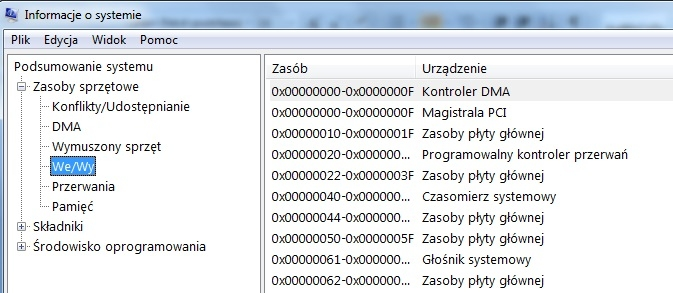

W którym systemie liczbowym zapisano zakresy We/Wy przedstawione na ilustracji?

W przypadku dysku twardego, w jakiej jednostce wyrażana jest wartość współczynnika MTBF (Mean Time Between Failure)?

Po zainstalowaniu Windows 10, aby skonfigurować połączenie internetowe z ograniczeniem danych, w ustawieniach sieci i Internetu należy ustawić typ połączenia

Który rodzaj kopii zapasowej należy wybrać, aby wykonać przyrostową kopię danych?