Pytanie 1

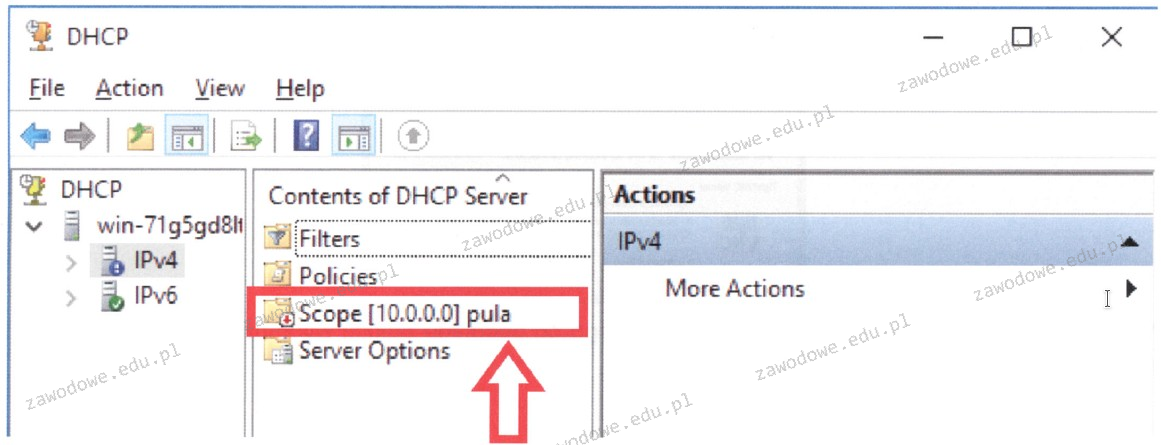

Wykonanie na komputerze z systemem Windows poleceń ipconfig /release oraz ipconfig /renew umożliwia weryfikację, czy usługa w sieci działa poprawnie

Wynik: 23/40 punktów (57,5%)

Wymagane minimum: 20 punktów (50%)

Wykonanie na komputerze z systemem Windows poleceń ipconfig /release oraz ipconfig /renew umożliwia weryfikację, czy usługa w sieci działa poprawnie

W systemie Blu-ray nośnik przeznaczony do jednokrotnego zapisu jest oznaczany jako

Jak sprawdzić, który z programów w systemie Windows generuje największe obciążenie dla procesora?

Jakiego numeru kodu należy użyć w komendzie do zmiany uprawnień folderu w systemie Linux, aby właściciel miał dostęp do zapisu i odczytu, grupa miała prawo do odczytu i wykonania, a pozostali użytkownicy mogli jedynie odczytywać zawartość?

Narzędziem systemu Windows, służącym do sprawdzenia wpływu poszczególnych procesów i usług na wydajność procesora oraz tego, w jakim stopniu generują one obciążenie pamięci czy dysku, jest

W filmie przedstawiono konfigurację ustawień maszyny wirtualnej. Wykonywana czynność jest związana z

Interfejs UDMA to interfejs

Użytkownik napotyka trudności przy uruchamianiu systemu Windows. W celu rozwiązania tego problemu, skorzystał z narzędzia System Image Recovery, które

Obecnie pamięci podręczne drugiego poziomu procesora (ang. "L-2 cache") są zbudowane z układów pamięci

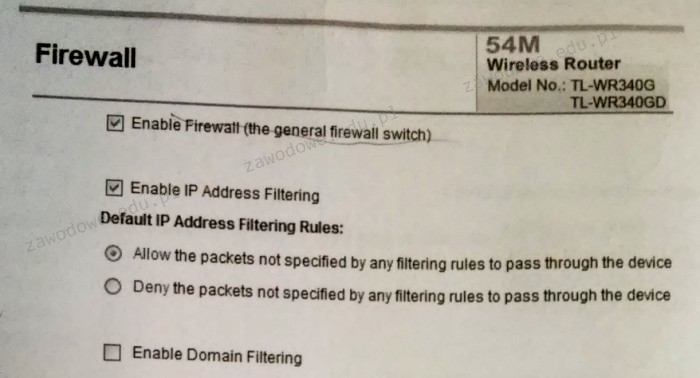

Poniższy rysunek ilustruje ustawienia zapory ogniowej w ruterze TL-WR340G. Jakie zasady dotyczące konfiguracji zapory zostały zastosowane?

Udostępnienie drukarki sieciowej codziennie o tej samej porze należy ustawić we właściwościach drukarki, w zakładce

Optyczna rozdzielczość to jeden z atrybutów

Która z usług musi być aktywna na ruterze, aby mógł on modyfikować adresy IP źródłowe oraz docelowe podczas przekazywania pakietów pomiędzy różnymi sieciami?

Do wyświetlenia daty w systemie Linux można wykorzystać polecenie

W sieci o adresie 192.168.20.0 użyto maski podsieci 255.255.255.248. Jak wiele adresów IP będzie dostępnych dla urządzeń?

Transmisja danych typu półduplex to transmisja

Jaki protokół mailowy pozwala między innymi na przechowywanie odbieranych wiadomości e-mail na serwerze, zarządzanie wieloma katalogami, usuwanie wiadomości oraz przenoszenie ich pomiędzy katalogami?

W specyfikacji procesora można znaleźć informację: "Procesor 32bitowy". Co to oznacza?

Jak należy rozmieszczać gniazda komputerowe RJ45 w odniesieniu do przestrzeni biurowej zgodnie z normą PN-EN 50174?

W biurze należy zamontować 5 podwójnych gniazd abonenckich. Średnia odległość od lokalnego punktu dystrybucyjnego do gniazda abonenckiego wynosi 10m. Jaki będzie przybliżony koszt zakupu kabla UTP kategorii 5e do utworzenia sieci lokalnej, jeśli cena brutto za 1m kabla UTP kategorii 5e wynosi 1,60 zł?

W dokumentacji technicznej głośników komputerowych producent może zamieścić informację, że największe pasmo przenoszenia wynosi

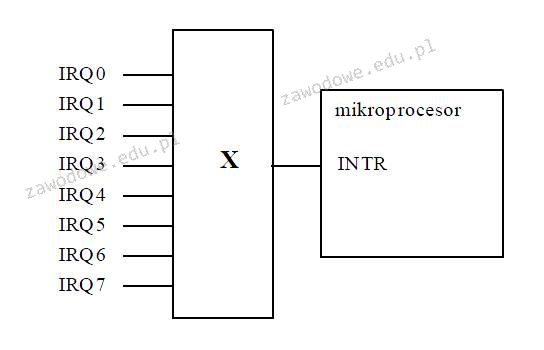

Na podstawie nazw sygnałów sterujących zidentyfikuj funkcję komponentu komputera oznaczonego na schemacie symbolem X?

Pojemność pamięci 100 GiB odpowiada zapisowi

Do wykonania końcówek kabla UTP wykorzystuje się wtyczkę

Jakie polecenie w systemie Linux umożliwia wyświetlenie listy zawartości katalogu?

Pamięć Intel® Smart Cache, która jest wbudowana w procesory o wielu rdzeniach, takie jak Intel® Core TM Duo, to pamięć

Jakie narzędzie służy do delikatnego wyginania blachy obudowy komputera oraz przykręcania śruby montażowej w miejscach trudno dostępnych?

Po wydaniu polecenia route skonfigurowano ```route add 192.168.35.0 MASK 255.255.255.0 192.168.0.2```

W komputerze o parametrach przedstawionych w tabeli konieczna jest wymiana karty graficznej na kartę GeForce GTX 1070 Ti Titanium 8G DDR5, PCI EX-x16 3.0, 256b, 1683 MHz/1607 MHz, Power consumption 180W, 3x DP, 2x HDMI, recommended power supply 500W, DirectX 12, OpenGL 4.5. W związku z tym należy również zaktualizować

| Podzespół | Parametry | Pobór mocy [W] |

|---|---|---|

| Procesor Intel i5 | Cores: 6, Threads: 6, 2.8 GHz, Tryb Turbo: 4.0 GHz, s-1151 | 30 |

| Moduł pamięci DDR3 | Taktowanie: 1600 MHz, 8 GB (1x8 GB), CL 9 | 6 |

| Monitor LCD | Powłoka: matowa, LED, VGA x1, HDMI x1, DP x1 | 40 |

| Mysz i klawiatura | przewodowa, interfejs: USB | 2 |

| Płyta główna | 2x PCI Ex-x16 3.0, D-Sub x1, USB 2.0 x2, RJ-45 x1, USB 3.1 gen 1 x4, DP x1, PS/2 x1, DDR3, s-1151, 4xDDR4 (Max: 64 GB) | 35 |

| Karta graficzna | 3x DP, 1x DVI-D, 1x HDMI, 2 GB GDDR3 | 150 |

| Dysk twardy 7200 obr/min | 1 TB, SATA III (6 Gb/s), 64 MB | 16 |

| Zasilacz | Moc: 300W | --- |

Jaki zapis w systemie binarnym odpowiada liczbie 111 w systemie dziesiętnym?

W normie PN-EN 50174 nie znajdują się wytyczne dotyczące

Jakie jest maksymalne dozwolone promień gięcia przy układaniu kabla U/UTP kat.5E?

Oblicz całkowity koszt kabla UTP Cat 6, który służy do połączenia 5 punktów abonenckich z punktem dystrybucyjnym, wiedząc, że średnia długość między punktem abonenckim a punktem dystrybucyjnym wynosi 8m oraz że cena brutto za 1m kabla to 1zł. W obliczeniach uwzględnij dodatkowy zapas 2m kabla dla każdego punktu abonenckiego.

Technologia opisana w systemach należących do rodziny Windows to

| Jest to technologia obsługująca automatyczną konfigurację komputera PC i wszystkich zainstalowanych w nim urządzeń. Umożliwia ona rozpoczęcie korzystania z nowego urządzenia (na przykład karty dźwiękowej lub modemu) natychmiast po jego zainstalowaniu bez konieczności przeprowadzania ręcznej jego konfiguracji. Technologia ta jest implementowana w warstwach sprzętowej i systemu operacyjnego, a także przy użyciu sterowników urządzeń i BIOS-u. |

Proces aktualizacji systemów operacyjnych ma na celu przede wszystkim

W systemie serwerowym Windows widoczny jest zakres adresów IPv4. Ikona umieszczona obok jego nazwy sugeruje, że

Jaką topologię fizyczną sieci komputerowej przedstawia załączony rysunek?

Jakie narzędzie jest używane do zakończenia skrętki przy pomocy wtyku 8P8C?

Jakim środkiem należy oczyścić wnętrze obudowy drukarki fotograficznej z kurzu?

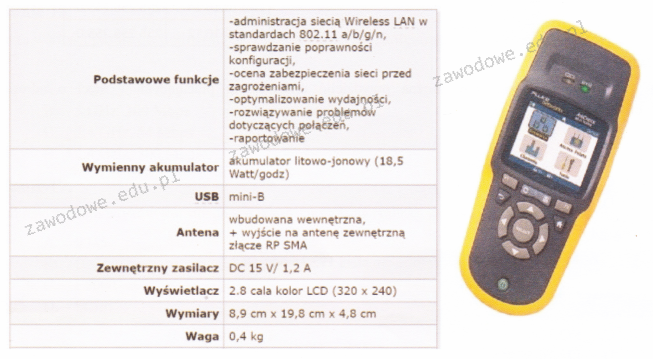

Jakie urządzenie diagnostyczne jest pokazane na ilustracji oraz opisane w specyfikacji zawartej w tabeli?